文章目录

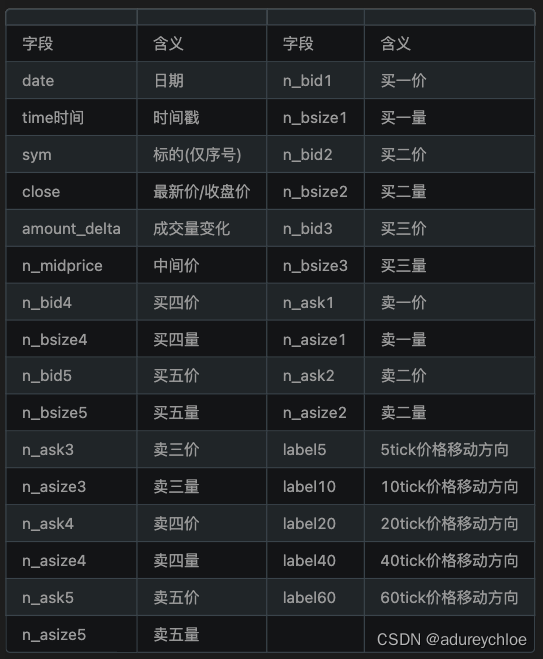

- 赛题分析

- 赛题背景

- 赛事任务

- 赛题数据集

- 评价指标

- Baseline实践

- 导入模块

- EDA

- 特征工程

- 模型训练与验证

- 结果输出

- 改进

赛题分析

赛题背景

量化金融在国外已经有数十年的历程,而在国内兴起还不到十年。这是一个极具挑战的领域。量化金融结合了数理统计、金融理论、社会学、心理学等多学科的精华,同时特别注重实践。由于市场博弈参与个体的差异性和群体效应的复杂性,量化金融极具挑战与重大的机遇的特点。 本赛事通过大数据与机器学习的方法和工具,理解市场行为的原理,通过数据分析和模型创建量化策略,采用历史数据,验证量化策略的有效性,并且通过实时数据进行评测。

赛事任务

给定数据集: 给定训练集(含验证集), 包括10只(不公开)股票、79个交易日的L1snapshot数据(前64个交易日为训练数据,用于训练;后15个交易日为测试数据,不能用于训练), 数据已进行规范化和隐藏处理,包括5档量/价,中间价,交易量等数据(具体可参考后续数据说明)。

预测任务:利用过往及当前数据预测未来中间价的移动方向,在数据上进行模型训练与预测

赛题数据集

行情频率:3秒一个数据点(也称为1个tick的snapshot);

每个数据点包括当前最新成交价/五档量价/过去3秒内的成交金额等数据;

训练集中每个数据点包含5个预测标签的标注;允许利用过去不超过100tick(包含当前tick)的数据,预测未来N个tick后的中间价移动方向。

预测时间跨度:5、10、20、40、60个tick,5个预测任务;即在t时刻,分别预测t+5tick,t+10tick,t+20tick,t+40tick,t+60tick以后:最新中间价相较t时刻的中间价:下跌/不变/上涨。

股票5档是指买1~买5、卖1~卖5十个价格档位,分别标记五个买盘价格和五个卖盘价格。成交顺序是从1到5,未成交的最高买价是买1,最低卖价是卖1。

评价指标

本模型依据提交的结果文件,采用macro-F1 score进行评价,取label_5, label_10, label_20, label_40, label_60五项中的最高分作为最终得分。

Baseline实践

导入模块

import numpy as np

import pandas as pd

from catboost import CatBoostClassifier

from sklearn.model_selection import StratifiedKFold, KFold, GroupKFold

from sklearn.metrics import accuracy_score, f1_score, roc_auc_score, log_loss, mean_squared_log_error

import tqdm, sys, os, gc, argparse, warnings

import matplotlib.pyplot as plt

warnings.filterwarnings('ignore')

EDA

数据探索性分析,是通过了解数据集,了解变量间的相互关系以及变量与预测值之间的关系,从而帮助我们后期更好地进行特征工程和建立模型,是机器学习中十分重要的一步。

# 读取数据

path = 'AI量化模型预测挑战赛公开数据/'

train_files = os.listdir(path+'train')

train_df = pd.DataFrame()

for filename in tqdm.tqdm(train_files): # 读取每个文件

tmp = pd.read_csv(path+'train/'+filename)

tmp['file'] = filename

train_df = pd.concat([train_df, tmp], axis=0, ignore_index=True) # 连接文件成表

test_files = os.listdir(path+'test')

test_df = pd.DataFrame()

for filename in tqdm.tqdm(test_files):

tmp = pd.read_csv(path+'test/'+filename)

tmp['file'] = filename

test_df = pd.concat([test_df, tmp], axis=0, ignore_index=True)

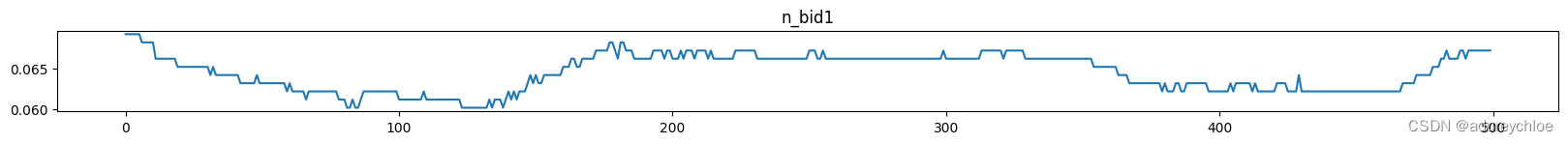

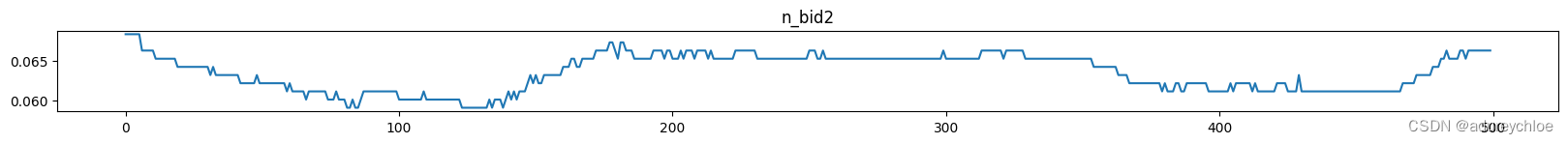

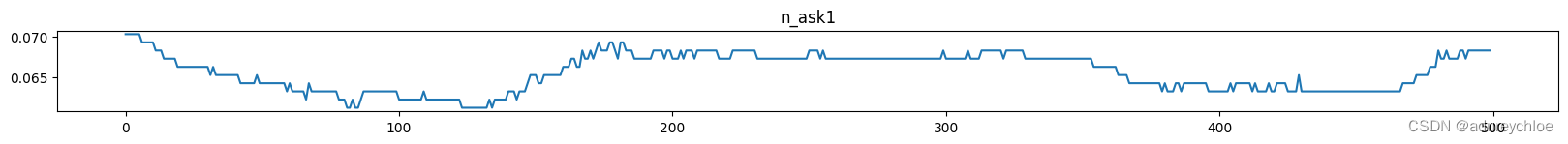

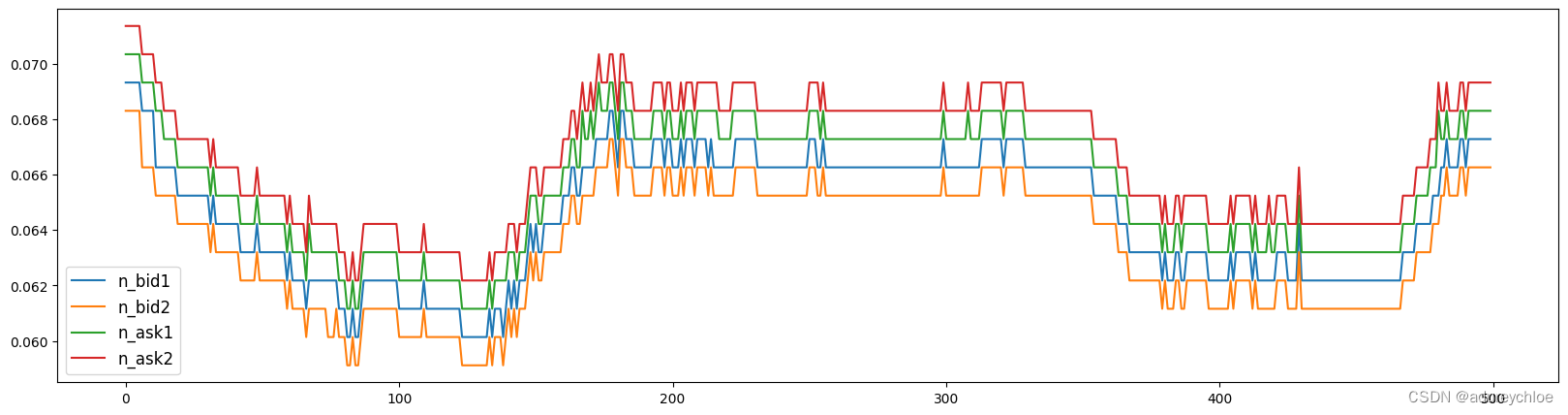

首先可以对买价卖价进行可视化分析

选择任意一个股票数据进行可视化分析,观察买价和卖价的关系。下面是对买价和卖价的简单介绍:

买价指的是买方愿意为一项股票/资产支付的最高价格。

卖价指的是卖方愿意接受的一项股票/资产的最低价格。

这两个价格之间的差异被称为点差;点差越小,该品种的流动性越高。

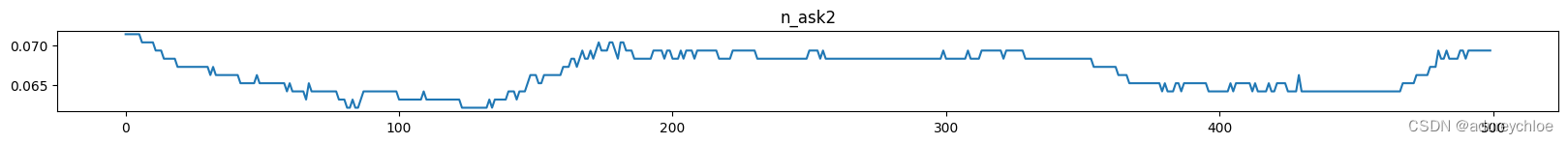

cols = ['n_bid1','n_bid2','n_ask1','n_ask2']

tmp_df = train_df[train_df['file']=='snapshot_sym7_date22_pm.csv'].reset_index(drop=True)[-500:]

tmp_df = tmp_df.reset_index(drop=True).reset_index()

for num, col in enumerate(cols):

plt.figure(figsize=(20,5))

plt.subplot(4,1,num+1)

plt.plot(tmp_df['index'],tmp_df[col])

plt.title(col)

plt.show()

plt.figure(figsize=(20,5))

for num, col in enumerate(cols):

plt.plot(tmp_df['index'],tmp_df[col],label=col)

plt.legend(fontsize=12)

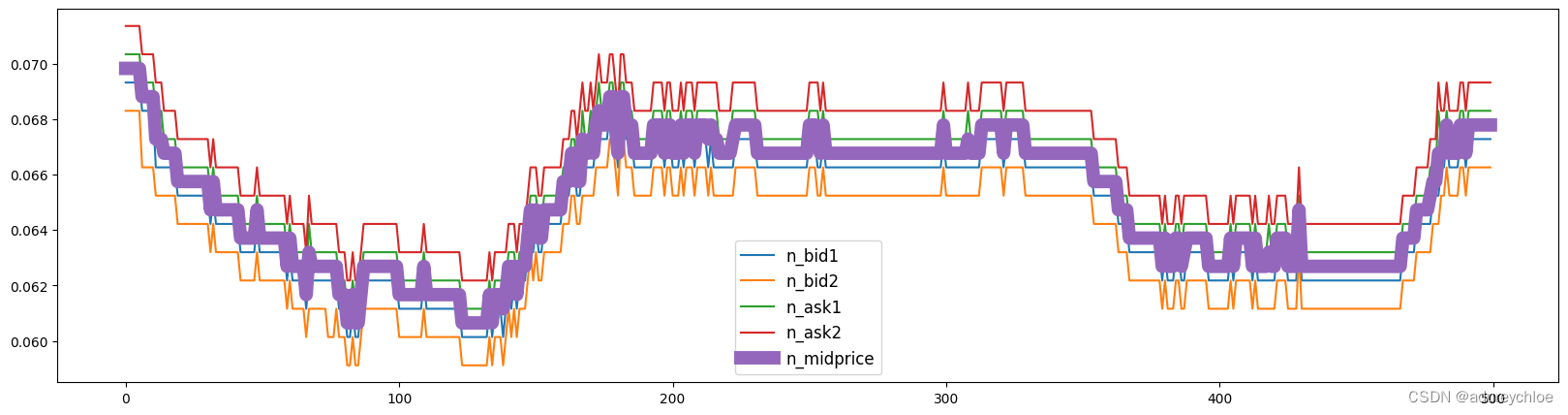

加上中间价继续可视化,中间价即买价与卖价的均值,数据中有直接给到,我们也可以自己计算。

plt.figure(figsize=(20,5))

for num, col in enumerate(cols):

plt.plot(tmp_df['index'],tmp_df[col],label=col)

plt.plot(tmp_df['index'],tmp_df['n_midprice'],label="n_midprice",lw=10)

plt.legend(fontsize=12)

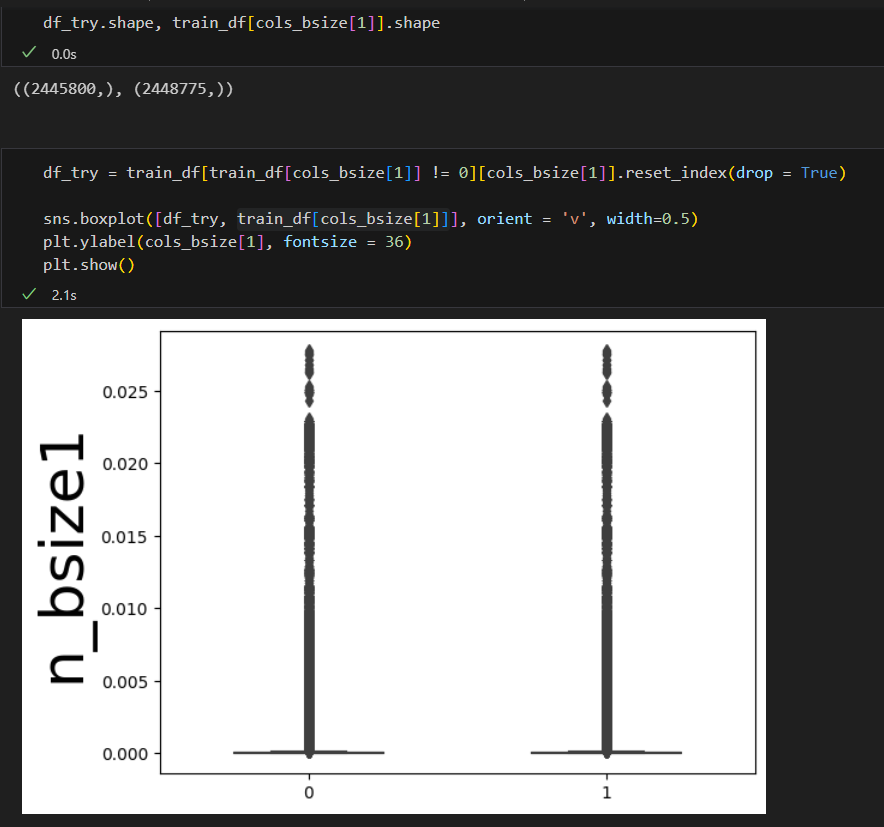

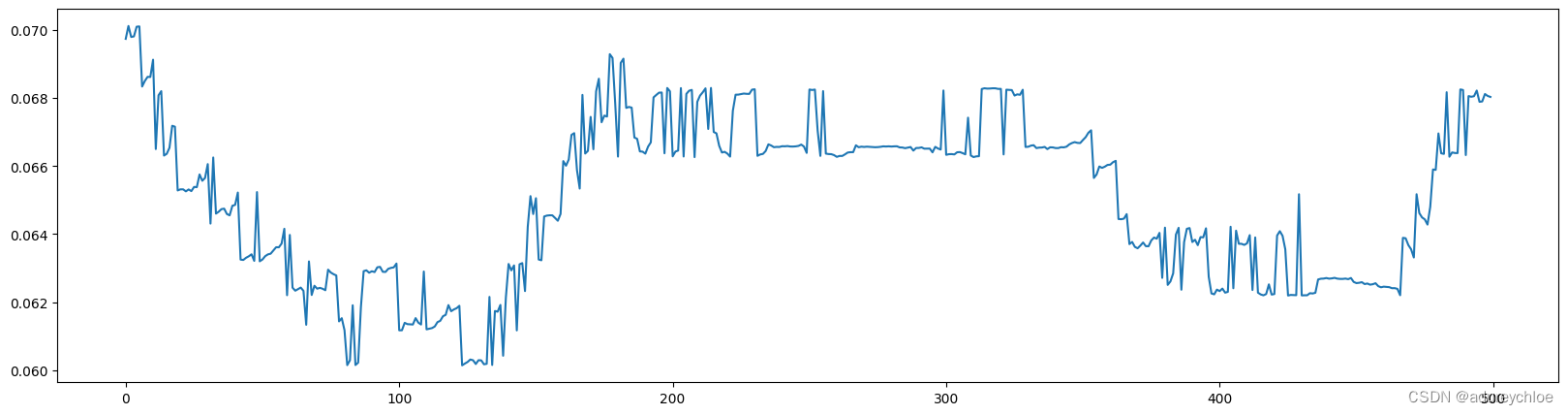

波动率是给定股票价格变化的重要统计指标,因此要计算价格变化,我们首先需要在固定间隔进行股票估值。我们将使用已提供的数据的加权平均价格(WAP)进行可视化,WAP的变化反映股票波动情况。

train_df['wap1'] = (train_df['n_bid1']*train_df['n_bsize1'] + train_df['n_ask1']*train_df['n_asize1'])/(train_df['n_bsize1'] + train_df['n_asize1'])

test_df['wap1'] = (test_df['n_bid1']*test_df['n_bsize1'] + test_df['n_ask1']*test_df['n_asize1'])/(test_df['n_bsize1'] + test_df['n_asize1'])

tmp_df = train_df[train_df['file']=='snapshot_sym7_date22_pm.csv'].reset_index(drop=True)[-500:]

tmp_df = tmp_df.reset_index(drop=True).reset_index()

plt.figure(figsize=(20,5))

plt.plot(tmp_df['index'], tmp_df['wap1'])

特征工程

在特征工程阶段,构建基本的时间特征,提取小时、分钟等相关特征,主要是为了刻画不同时间阶段可能存在的差异性信息。需要注意数据是分多个文件存储的,所以需要进行文件合并,然后在进行后续的工作。

# 时间相关特征

train_df['hour'] = train_df['time'].apply(lambda x:int(x.split(':')[0]))

test_df['hour'] = test_df['time'].apply(lambda x:int(x.split(':')[0]))

train_df['minute'] = train_df['time'].apply(lambda x:int(x.split(':')[1]))

test_df['minute'] = test_df['time'].apply(lambda x:int(x.split(':')[1]))

# 入模特征

cols = [f for f in test_df.columns if f not in ['uuid','time','file']]

模型训练与验证

选择使用CatBoost模型,也是通常作为机器学习比赛的基线模型,在不需要过程调参的情况下也能得到比较稳定的分数。这里使用五折交叉验证的方式进行数据切分验证,最终将五个模型结果取平均作为最终提交。

def cv_model(clf, train_x, train_y, test_x, clf_name, seed = 2023):

folds = 5

kf = KFold(n_splits=folds, shuffle=True, random_state=seed)

oof = np.zeros([train_x.shape[0], 3]) # 验证结果,3代表3种类别,会得到3种类别的概率

test_predict = np.zeros([test_x.shape[0], 3]) # 测试结果

cv_scores = []

for i, (train_index, valid_index) in enumerate(kf.split(train_x, train_y)):

print('************************************ {} ************************************'.format(str(i+1)))

trn_x, trn_y, val_x, val_y = train_x.iloc[train_index], train_y[train_index], train_x.iloc[valid_index], train_y[valid_index]

if clf_name == "cat":

params = {'learning_rate': 0.2, 'depth': 6, 'bootstrap_type':'Bernoulli','random_seed':2023,

'od_type': 'Iter', 'od_wait': 100, 'random_seed': 11, 'allow_writing_files': False,

'loss_function': 'MultiClass'}

model = clf(iterations=100, **params)

model.fit(trn_x, trn_y, eval_set=(val_x, val_y),

metric_period=20,

use_best_model=True,

cat_features=[],

verbose=1)

val_pred = model.predict_proba(val_x)

test_pred = model.predict_proba(test_x)

oof[valid_index] = val_pred

test_predict += test_pred / kf.n_splits

F1_score = f1_score(val_y, np.argmax(val_pred, axis=1), average='macro')

cv_scores.append(F1_score)

print(cv_scores)

return oof, test_predict

for label in ['label_5','label_10','label_20','label_40','label_60']:

print(f'=================== {label} ===================')

cat_oof, cat_test = cv_model(CatBoostClassifier, train_df[cols], train_df[label], test_df[cols], 'cat')

train_df[label] = np.argmax(cat_oof, axis=1)

test_df[label] = np.argmax(cat_test, axis=1)

本次比赛采用macro-F1 score进行评价,取label_5, label_10, label_20, label_40, label_60五项中的最高分作为最终得分,所以在初次建模的时候对应五个目标都需要进行建模,确定分数最高的目标,之后进行优化的时候仅需对最优目标进行建模即可,大大节省时间,聚焦单个目标优化。

结果输出

提交结果需要符合提交样例结果,然后将文件夹进行压缩成zip格式提交。

import pandas as pd

import os

# 指定输出文件夹路径

output_dir = './submit'

# 如果文件夹不存在则创建

if not os.path.exists(output_dir):

os.makedirs(output_dir)

# 首先按照'file'字段对 dataframe 进行分组

grouped = test_df.groupby('file')

# 对于每一个group进行处理

for file_name, group in grouped:

# 选择你所需要的列

selected_cols = group[['uuid', 'label_5', 'label_10', 'label_20', 'label_40', 'label_60']]

# 将其保存为csv文件,file_name作为文件名

selected_cols.to_csv(os.path.join(output_dir, f'{file_name}'), index=False)