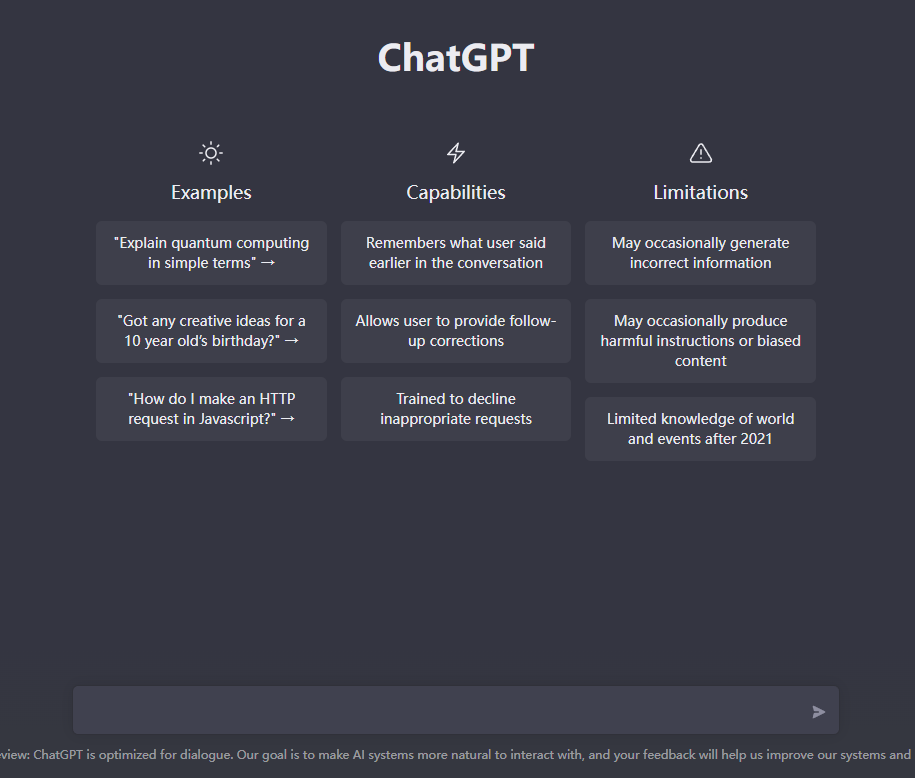

我也和 chatGPT 聊了聊,都是因为最近 chatGPT 太火了!

这是一个大型的 AI 语言模型。你不仅可以和它聊天,问它各种各样的问题,还可以让它写代码、写论文、解数学题、解bug,等等。

可以说,chatGPT 是目前最强的人工智能语言模型也不为过。这几天对 chatGPT 的报道有很多,网友们都变着法子和它对话,整了不少活,玩的不亦乐乎。

我这几天就忍不住想试试。但是工作日上班,时间不充足,看到有些网友光注册就搞了一个小时,心里就打退堂鼓了。毕竟是国外的网站,注册繁琐些,也是能预想到的,心想就等有时间了再玩玩吧。

刚好今天,趁着周末,赶紧试了试。

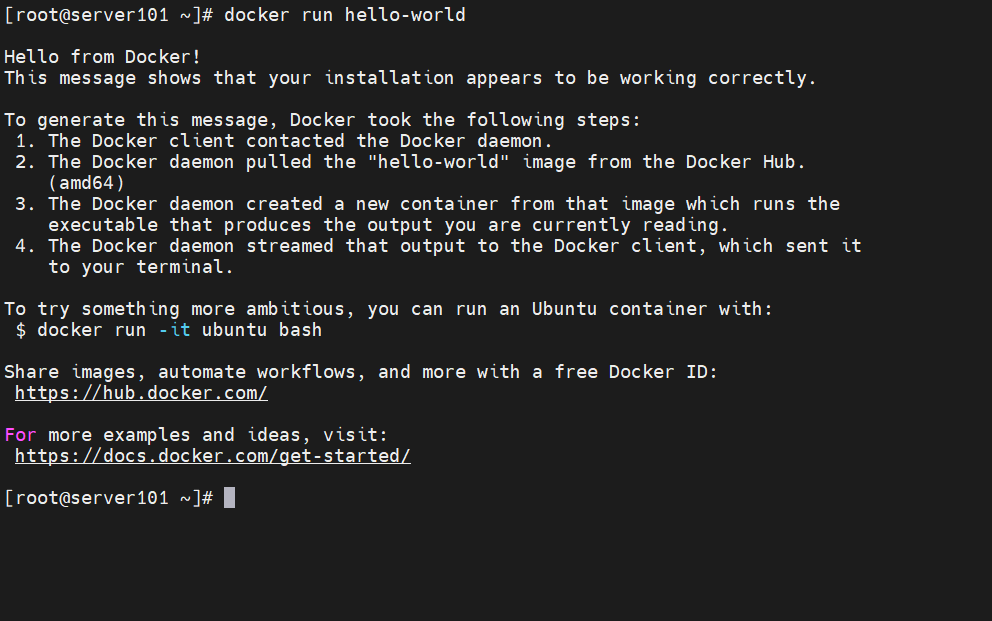

本来打算花费1-2个小时来注册的,结果看到一篇保姆级的注册指导文章,让我只花了 0.2 美元(买一条国外手机的短信验证码) + 10分钟(邮箱注册)就搞定了,并且顺利登录到了 chatGPT 聊天室。

保姆级攻略链接在这,感兴趣的可以试一试:https://zhuanlan.zhihu.com/p/589642999。

这里有必要说一下,chatGPT 是国外网站,需要一个可以访问外网的途径。如果没有,务必先将访问外网的途径搞定,然后按照保姆级攻略,很快就可以了。

以下是和 chatGPT 的问答环节。

第一题: 中英双语自我介绍一下吧(主要是我只会中英双语)

我输入:介绍下你自己

它的英文回答比中文回答溜很多啊,速度很快。

第二题:我是搞 AI 的,而你就是个AI,那你就写一段 AI 算法中常见的卷积代码吧

我输入:写一个简单的卷积代码吧

让它写一个卷积代码,它还真就很轻松的写出来了,不过是调用了 numpy 这个三方库。很多逻辑库里都已经实现了。

如果增加点难度,不让它调用三方库,会怎么样呢?

我继续输入:不要调用 numpy 库,写一个简单的卷积实现代码

chatGPT 很快就给出了答案。基本上把卷积的核心逻辑用 python 写出来了。

那换一种语言呢,比如用 c 语言写一个卷积的实现,会怎样?

我继续输入:用C语言写一个卷积的代码实现

它也很快用二维数组和嵌套循环的方式,写了一段卷积的逻辑出来。

这样的代码功能上应该是没问题,只是还存在一定的优化空间,我希望它优化一下。

于是,我继续输入:上面的代码有什么可以优化的地方么

它不仅给出了两个优化点,而且给出了优化后的代码和运行示例,如果我是面试官,它是应聘者,看到这,这题基本上及格了。

代码能力可以,那其他方面呢?

第三题:写个小作文

我输入:写一篇200字左右的小朋友春游观后感

其实我写观后感这三个字是不对的,春游不是观影,不存在观后感,但这似乎不影响 chatGTP 对我想表达意思的理解。

它也很快写了大概200字,语言行文看着像是小朋友的写作水平。

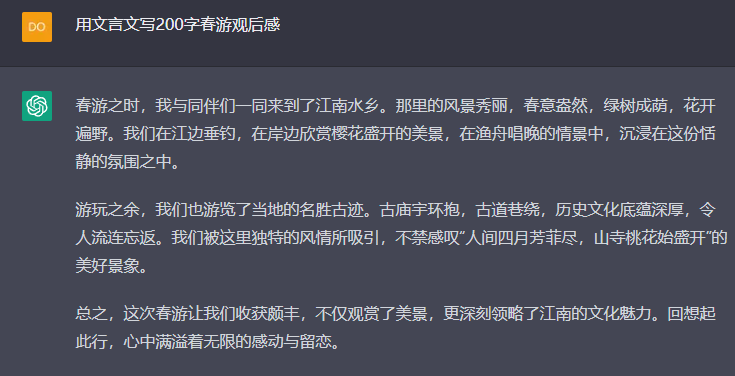

升级一下吧,用文言文写个春游游记。

我输入:用文言文写200字春游观后感

看来 chatGPT 对文言文的阅读欠缺,对中国传统文化学的还不够啊。

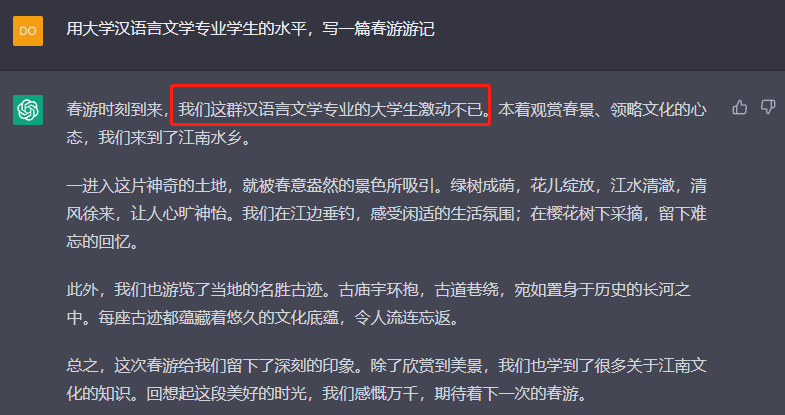

我继续输入:用大学汉语言文学专业学生的水平,写一篇春游游记

结果:

好嘛,上来就自报家门,你要不说,我都不知道你是汉语言文学专业的大学生了呢。

试玩了一下午,发现了几个有意思的地方:

chatGPT 对一些专业性领域的问题,回答的基本都还可以,但对于一些文学相关、诗词歌赋等创意性的问题,虽然能回答出来,但还是差点意思。

其实这种差别能预料到,毕竟 chatGPT 的训练时利用了已有的知识进行的训练,它更像一个百科全书,能在互联网上搜索到的答案,更有可能被 chatGPT 学会。而创意性的知识,则很难。

比如有些网友利用 chatGPT 的答案去刷 LeetCode,在一些难度很高的题目上,chatGPT 给出的答案,竟然打败了100%的提交者。

下午刚好在知乎上看到一篇文章,一个网友竟然在试图教会这个模型一个问题的答案。看网友给的回答是教会了。但是没有给出截图和证据。

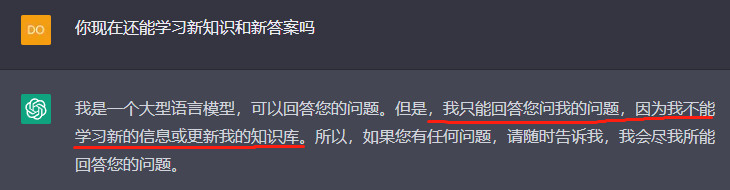

我很好奇,这怎么可能?

模型一旦训练完成,怎么可能还能自学习?

于是我抱着试试看的态度,问了它一个问题——

是的,它已经被训练完了,该知道的都知道了,不该知道的,永远也不会再知道了。如果它能在和网友的聊天中学到新的知识,那真正的人工智能就出现了。

看到最后这个回答,心里竟然有点莫名的感伤,一个大语言模型,或许在某些问题上、某一个瞬间和你的聊天,会让你感觉它和一个人有点像。

但是,当它说出来,自己无法学习新的知识时,就像是一个悲壮的试验品摆在人类面前,虽然它只是一段程序。

如果想让它学习到新的知识,也只能等到下一代 chatGPT 被训练出来,或许才有机会。

一代一代的模型更新,一代更比一代强。

或许不知道哪天,人类能突破模型的自学习机制,到那时——

昨天在找 chatGPT 相关文章的时候,就刷到了一个李宏毅老师对这个模型工作原理的讲解视频 ,搬运了一下,想看的请戳:学习啦,可以聊天的chatGPT火爆啦!!对它的实现原理感兴趣的可以去看看。