仿佛一声惊雷炸响,7月24日Runway 宣布,Gen-1 和 Gen-2 已经彻底开放,任何人都可以注册一个账号免费尝试。生成的视频长度为 4 秒,每秒消耗 5 个积分,利用免费额度可以生成二十六个视频。如果免费积分耗尽,付费标准为 0.01 美元 / 积分,也就是生成一个视频需要 0.2 美元

笔者体验了一下Gen-2,其生成的视频对于普通人来说,无需使用AE、Blender等专业软件就能轻松实现酷炫特效。但用专业视角来看,存在模糊、颗粒感较重、光线穿透差、帧率不稳定、视频动物/人物的动作诡异等问题.

什么是Gen-2

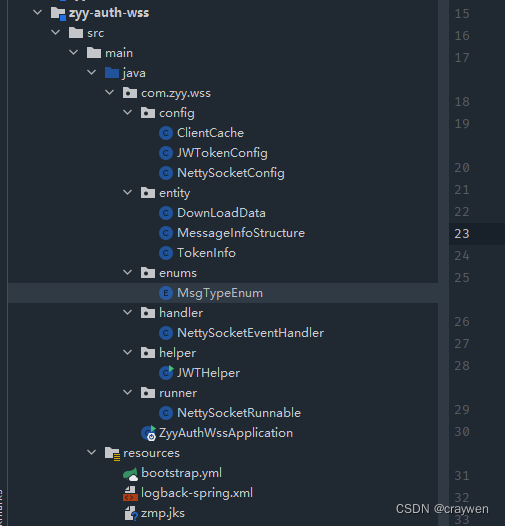

Gen-2是Runway在今年3月最新发布的,可以通过文本、图片、文本+图片直接生成视频,同时支持风格化和渲染添加好莱坞式大片特效,仅需要几分钟即可完成所有操作。

据Runway介绍,Gen-2采用的是扩散模型,生成的过程从完全由噪声构成的起始图像中逐渐消除噪声,以接近用户的文本提示。Gen-2的训练数据包括2.4亿张图片、640万个视频剪辑片段以及数亿个学习示例。

如何使用Gen-2

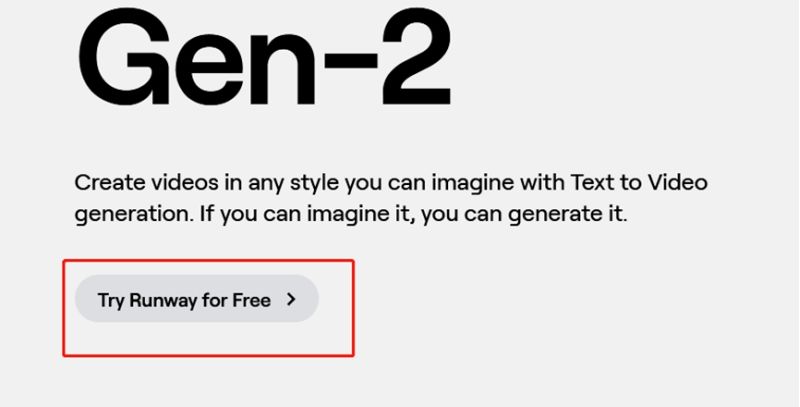

目前,Runway 已经开放了网页端的免费体验窗口,相关应用(RunwayML)也已经在苹果的应用商店上线。网址:https://research.runwayml.com/gen2

使用流程:

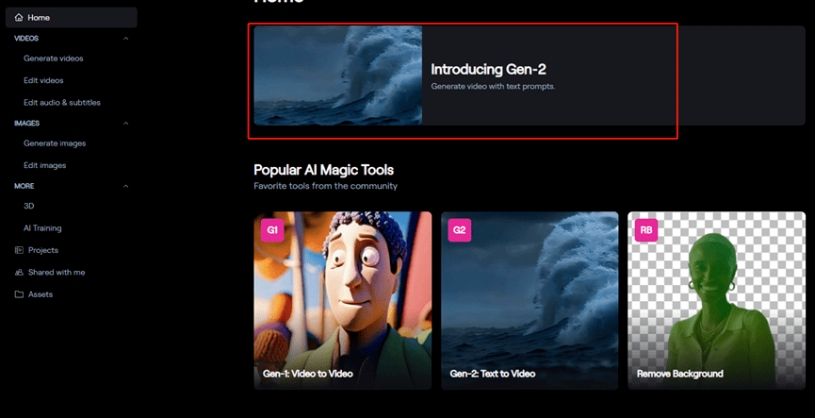

1)在https://research.runwayml.com/gen2/选择【Try Runway for Free】免费注册登录到Runway平台。

2)在主页选择Gen-2。

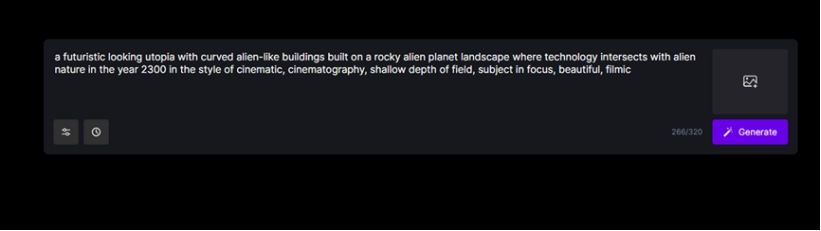

3)输入文字进行制作,目前Gen-2限制320个字符。例如,一个未来的乌托邦时代,有弯曲的外星人般的建筑,建在岩石般的外星景观上,2300年,电影风格,电影摄影,浅景深,聚焦主题,美丽。

4)直接生成视频在线预览,也可以下载到本地。

一句话,一张图,三秒视频无中生有

Gen-2的功能非常丰富,包括风格化、故事版、蒙版、渲染、自定义等等。

风格化可以理解为参考某张图像修改视频风格。比如给出以下原始视频:

再给定一张参考图像: Gen-1 就能将视频编辑成上述图像的风格:

Gen-1 就能将视频编辑成上述图像的风格: 故事版是一个电影学名词,指在影片的实际拍摄或绘制之前,将剧本的文字描述转换成一格一格叙述故事进展的图画。Gen-1 可以将一个类似故事版的视频转换为具有特定场景的视频。

故事版是一个电影学名词,指在影片的实际拍摄或绘制之前,将剧本的文字描述转换成一格一格叙述故事进展的图画。Gen-1 可以将一个类似故事版的视频转换为具有特定场景的视频。

蒙版(mask)可以理解为修改视频中的指定部分,而其他部分保持不变。比如,给定以下原始视频: 然后向 Gen-1 输入文字指令「白毛上有黑点的狗。」我们就可以得到编辑后的视频。

然后向 Gen-1 输入文字指令「白毛上有黑点的狗。」我们就可以得到编辑后的视频。 渲染是指将计算机生成的 3D 场景或特效图像转换成最终影像。比如,给定以下原始视频:

渲染是指将计算机生成的 3D 场景或特效图像转换成最终影像。比如,给定以下原始视频: 可以生成渲染后的视频:

可以生成渲染后的视频: 此外,Gen-2 还支持自定义视频编辑:

此外,Gen-2 还支持自定义视频编辑: 同时,它还新增了文字、图片生成视频功能。也就是说,仅需输入文字、图像或文字加图像的描述,Gen-2 即可在很短的时间内生成相关视频。它是市场上第一个公开可用的文本到视频模型。

同时,它还新增了文字、图片生成视频功能。也就是说,仅需输入文字、图像或文字加图像的描述,Gen-2 即可在很短的时间内生成相关视频。它是市场上第一个公开可用的文本到视频模型。

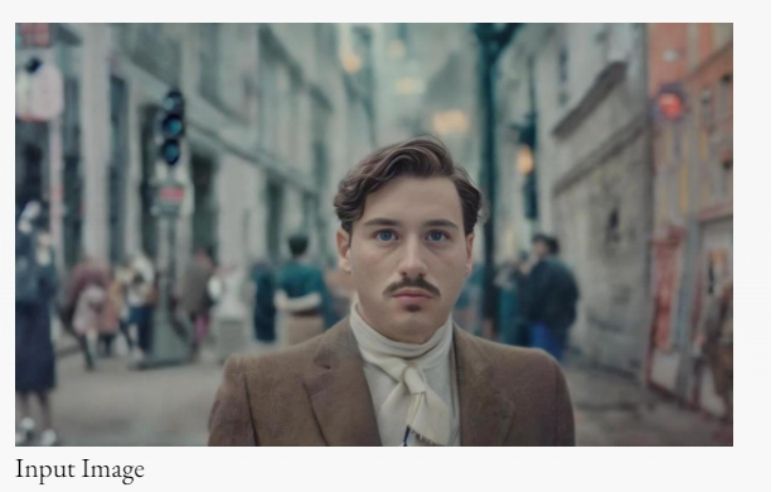

比如,我们输入一段纯文字:「午后的阳光透过纽约阁楼的窗户照进来。」Gen-2 会直接「脑补」出视频: 输入一张照片 + 文字「低角度镜头:一个男人走在街上,被他周围酒吧的霓虹灯照亮。」

输入一张照片 + 文字「低角度镜头:一个男人走在街上,被他周围酒吧的霓虹灯照亮。」 Gen-2 会返回以下结果:

Gen-2 会返回以下结果: 仅输入一张图像,Gen-2 也可以将其扩展为视频:

仅输入一张图像,Gen-2 也可以将其扩展为视频: