PIAFusion: A progressive infrared and visible image fusion network based on illumination aware

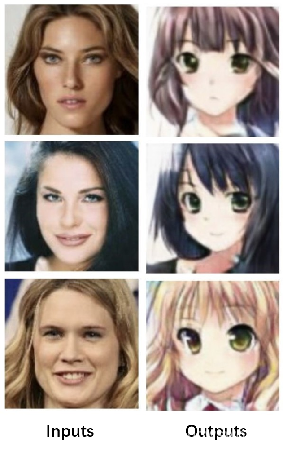

本文提出了一种基于光照感知的渐进式图像融合网络PIAFusion,自适应地保持显著目标的亮度分布和背景的纹理信息。具体而言,我们设计了一个光照感知子网络来估计光照分布并计算光照概率。此外,利用光照概率构造光照感知损失,指导融合网络的训练。跨模态差分感知融合模块和中间融合策略在光照感知损失约束下,充分融合了公共信息和互补信息。此外,还建立了一个新的红外与可见光图像融合基准数据集,发布多光谱道路场景,以支持网络训练和综合评估。

介绍

(对于红外和可见光的有一些基本描述不在赘述)

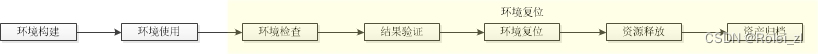

提出了一种基于光照感知的渐进式红外与可见光图像融合框架PIAFusion,并发布了一个用于红外与可见光图像融合的大型基准数据集。首先,我们从现有的MFNet数据集中收集大量红外和可见光图像对,该数据集是为多模态图像语义分割拍摄的。MFNet数据集包含大量低对比度和低信噪比的红外图像以及一些未对准的图像对。因此,我们对红外图像进行锐化和增强,并去除未对齐的图像对。随后,我们设计了一个光照感知子网络来评估光照条件。更具体地,预先训练的照明感知子网络计算当前场景是白天还是夜晚的概率。然后,利用这些概率构造光照感知损失,用于指导融合网络的训练。最后,采用一个包含跨模态差分感知融合(cross-modality

differential aware fusion (CMDAF))模块的渐进式特征提取器,充分提取和融合多模态图像中的互补信息。然后,通过半融合方式融合互补特征和共同特征,图像重建器将融合后的特征变换到融合后的图像域。在光照感知损失的指导下,该融合框架能够根据光照条件自适应地融合特征目标和纹理细节等重要信息。此外,CMDAF模块和半融合策略允许我们的网络在各个阶段融合共同和互补的信息。因此,我们的融合图像可以完全保持纹理,同时强调突出的目标,无论光照条件。

贡献

1)提出了一种基于光照引导的红外与可见光图像融合框架,该框架通过感知光照情况,全天候融合源图像的有意义信息。

2)我们将跨模态差分感知融合模块与中间融合策略相结合,以整合各个阶段的互补信息和共同信息。

3)在MFNet数据集的基础上,构建了一个新的基准数据集,称为多光谱道路场景(Multi-Spectral Road Scenarios (MSRS)),用于红外和可见光图像融合的训练和评估。

相关工作

(红外和可见光的融合方法不在赘述)

Illumination aware-based vision applications

事实上,一些实际的计算机视觉应用在建模时已经考虑了照明因素。Wang等人提出了一种全局光照感知和细节保持网络(GLADNet)用于弱光图像增强。GLADNet首先计算低光照图像的全局光照估计,然后根据估计调整光照,并使用与原始图像的级联来增强细节。此外,Sakkos等人开发了一种三重多任务生成对抗网络,将具有不同光照的特征集成到分割分支中,极大地提高了前景分割的性能。此外,许多研究人员探索了利用光照信息来提高多光谱行人检测性能的可行性。例如,Li等人提出了一种光照感知更快的R-CNN,以通过在光照感知网络的输出上定义的门函数来自适应地融合红外和可见光子网络。巧合的是,Guan等人提出了一种基于光照感知行人检测和语义分割的多光谱行人检测框架。他们利用一种新颖的光照感知加权机制来描述光照条件,并将光照信息集成到双流CNN中,以获得不同光照条件下的人体相关特征。此外,MBNet促进了优化过程,并以更灵活和平衡的方式改善了探测器的性能。特别地,光照感知特征对准模块用于根据光照条件自适应地选择互补信息。

本文提出一种基于光照感知的渐进式红外与可见光融合框架,以消除光照不平衡问题。更具体地说,我们首先开发一个光照感知子网络来估计光照条件。然后,利用光照概率构造光照感知损失。最后,在光照感知损失的指导下,精细的渐进网络自适应地集成红外和可见光图像的有意义信息。

方法

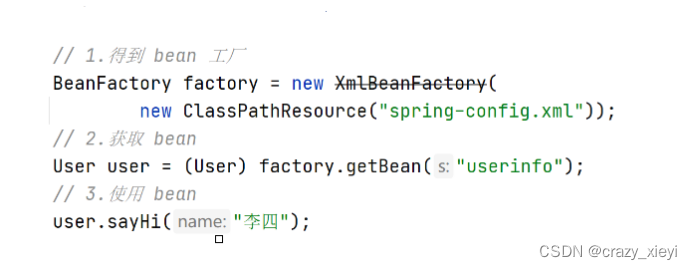

Problem analysis

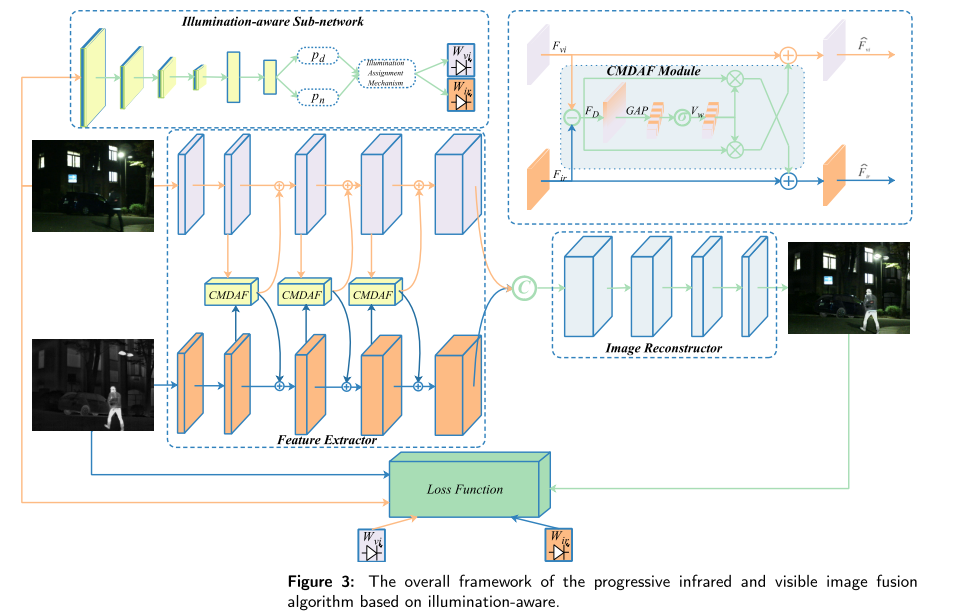

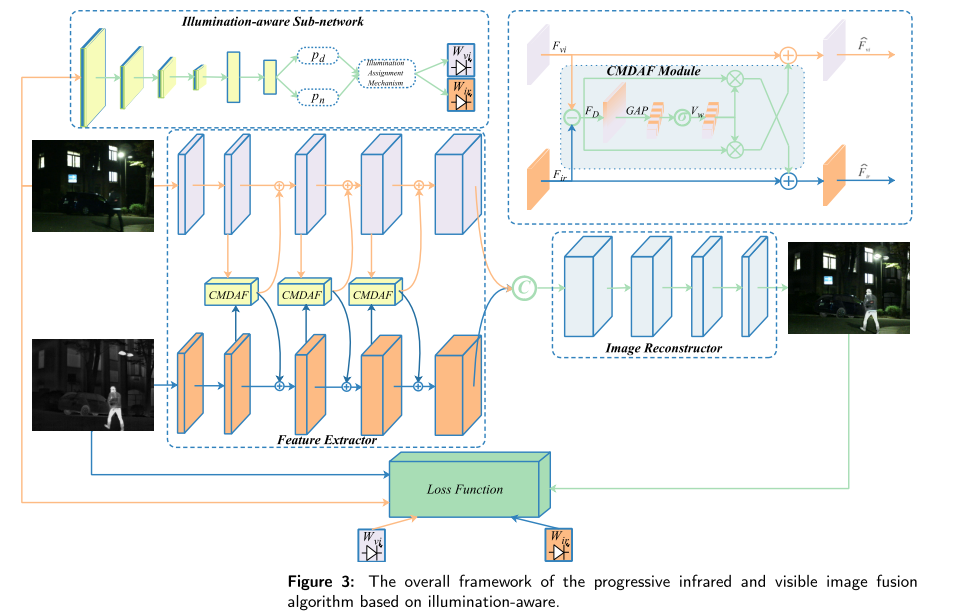

给定一幅红外图像Iir和一幅可见光图像Ivi,通过特征提取、融合和重构可以生成融合图像If。为了提高融合性能,我们设计了一个光照感知的损失来约束上述三个步骤。渐进式照明引导的红外和可见光图像融合网络如图3所示。

考虑到光照不平衡对信息分布的影响,我们设计了一个光照感知子网络来估计可见光图像的光照。给定一个可见图像Ivi,光照感知过程定义为:

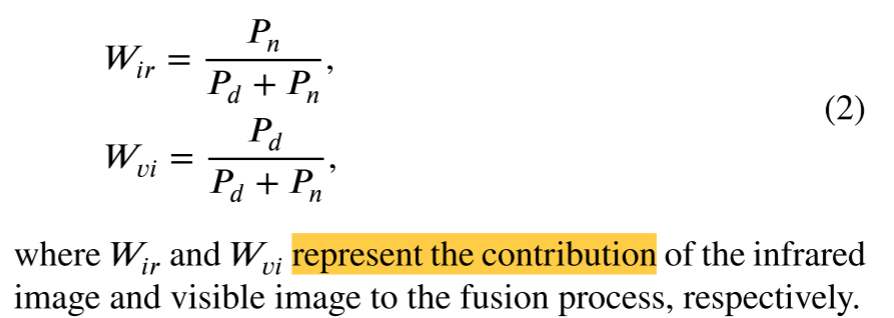

其中NIA表示照明感知子网络,Pd和Pn分别表示图像属于白天和夜晚的概率。值得一提的是,Pd和Pn是非负标量。由于白天可见光图像中的大部分信息都集中在可见光图像中,而夜间红外图像中包含更多有意义的信息,因此光照概率从侧面反映了源图像中信息的丰富程度。因此,我们利用光照概率来计算光照感知权重,该权重通过光照分配机制来表示源图像的贡献。为了简化计算,我们的照明分配机制采用如下定义的简单归一化函数:

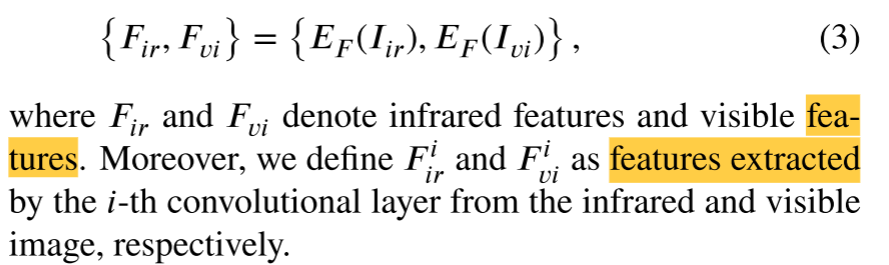

此外,我们还设计了一个渐进式融合网络,将互补信息和共同信息完全融合。更具体地,我们首先应用特征编码器EF从红外和可见光图像中提取深度特征,其可以表示为:

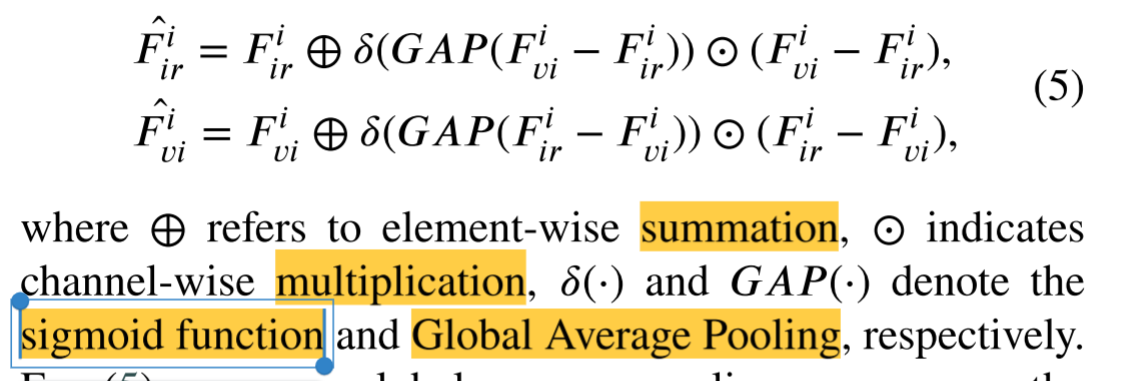

此外,我们提出一个跨模态差异感知融合(CMDAF)模块来补偿差异信息。特别地,

F

i

F^i

Fiir和

F

i

F^i

Fivi可以用公共部分和互补部分来表示,如下所示:

其中公共部分表示公共特征,而互补部分反映不同模态的互补特征。

Eq.(4)说明了差分分解的原理,它类似于差分放大电路。CMDAF模块的核心思想是将互补信息与渠道权重充分融合。因此,CMDAF模块可精确定义为:

Eq.(5)全局平均汇集将互补特征压缩到向量中。然后,通过Sigmoid函数将该向量归一化为[0,1]以生成通道权重。

另外,本文采用半融合的方式,将红外和可见光图像的共同和互补特征完全融合,连接。中途融合策略表示如下:

最后,通过图像重建器RI从融合特征Ff恢复融合图像If,其表示为Eq.(7):

Loss function

Loss function ofprogressive fusion network

为了促进渐进式融合框架根据光照条件自适应地融合有意义的信息,我们创新性地提出了光照感知损失。光照感知损耗Lillum精确定义如下:

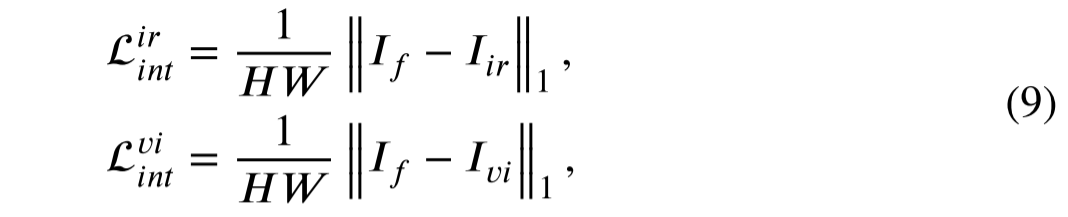

强度损失在像素级测量融合图像和源图像之间的差异。因此,我们将红外和可见光图像的强度损失定义为:

H和W输入图像的高度和宽度,分别为||⋅||1代表L1-norm。事实上,融合图像的强度分布应符合不同源图像根据照明情况。因此,我们使用illumination-aware权重,即Wir和Wvi调整强度约束的融合图像。

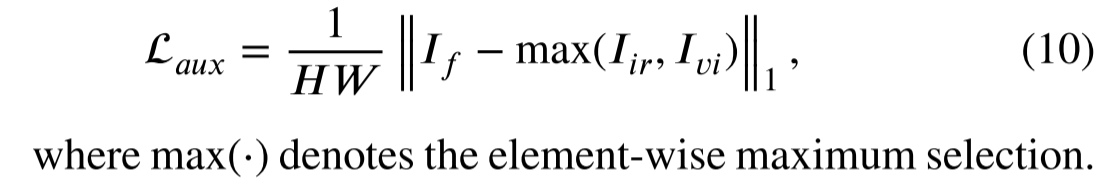

光照损失驱动渐进融合网络基于光照条件动态地保存来自源图像的强度信息,然而其并不维持融合图像的最佳强度分布。为此,我们进一步引入辅助强度损失,表示为:

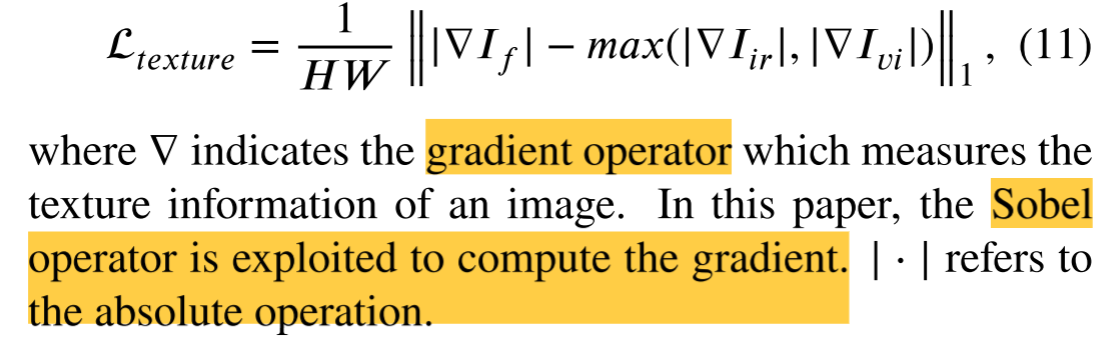

此外,我们期望融合后的图像能在保持最佳亮度分布的同时,保留丰富的纹理细节。基于大量的实验,我们发现的最佳纹理融合图像可以表示为红外和可见光图像纹理的最大聚合。因此,引入纹理损失以迫使融合图像包含更多的纹理信息,其定义如下:

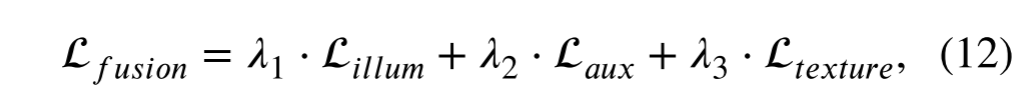

最后,渐进融合网络的全目标函数是光照损失、辅助强度损失和纹理损失的加权,表示为:

实验结果表明,该渐进融合网络能够根据光照场景的变化,在光照损失和辅助亮度损失的指导下,动态地保持最优的亮度分布。并在纹理损失的指导下获得理想的纹理细节。因此,融合网络可以全天候地融合来自红外和可见光图像的有意义的信息。

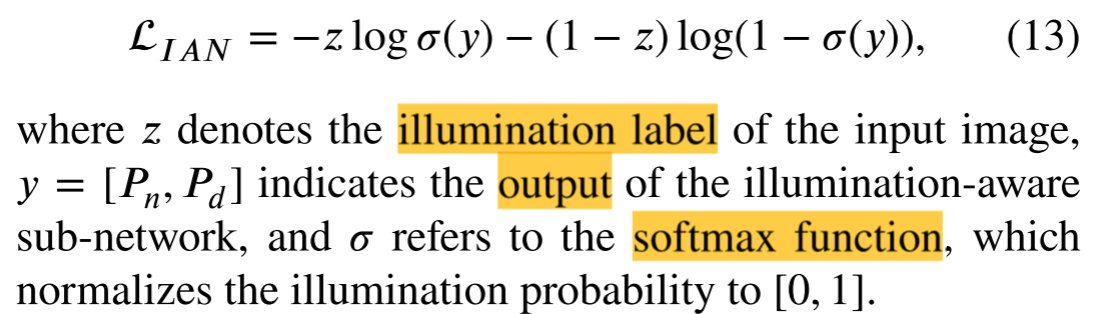

Loss function of illumination-aware sub-network

在我们的方法中,融合性能严重依赖于光照感知子网络的准确性。光照感知网络本质上是一个分类器,它计算图像属于白天和夜间的概率。因此,我们使用交叉熵损失LIAN来约束光照感知子网络的训练过程,其表示如下:

Network architecture

Progressive fusion network architecture

如图3所示,我们采用基于端到端CNN的框架作为我们的主干,我们的渐进网络由特征提取器和图像重建器组成。

有五个卷积层特征提取器,旨在充分提取互补和共同的特征。首先,1×1卷积层的目的是减少红外和可见图像模态区别。因此,我们的火车第一层分别为红外和可见图像。之后,四个卷积层共享重量用来提取红外和可见图像的深度特性。值得注意的是,第二、第三和第四层的输出之后是CMDAF模块,以交换模态互补特征。CMDAF模块使我们的网络能够以渐进的方式在特征提取阶段集成互补信息。因此,我们的特征提取器可以完整地提取红外和可见光图像的共同和互补特征。表1中给出了特征提取器中所有卷积层的更多细节,例如内核大小、输出通道和激活函数。

除第一层外,所有卷积层的核大小均为3。特征提取器的所有层都使用LeakyRelu作为激活函数。

随后,从红外和可见光图像中提取的深度特征被连接起来,作为图像重建器的输入。图像重建器包含5个卷积层,负责充分整合公共信息和互补信息,生成融合图像。图像重建器的详细配置示于表1中。除最后一层的核大小为1 × 1外,其余各层的核大小均为3 × 3。此外,图像重建器在图像重建过程中逐渐减少特征图的通道数。图像重建器中除最后一层卷积层的激活函数为Tanh外,其余卷积层均采用Leaky Relu作为激活函数。在图像融合过程中,信息丢失是一个灾难性的问题。因此,在渐进融合网络的所有卷积层中,填充被设置为相同,并且除了第一层和最后一层之外,跨距被设置为1。因此,我们的网络没有引入任何下采样,并且融合图像的大小与源图像一致。

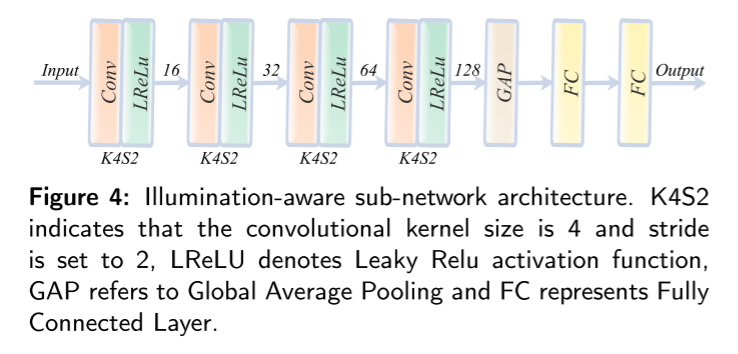

Illumination-aware sub-network architecture

光照感知子网络以场景中的可见光图像为输入,以光照概率为输出,对场景中的光照分布进行估计。图4中示出了光照感知子网的体系结构。

它由四个卷积层、一个全局平均池和两个全连接层组成。跨距设置为2的4 × 4卷积层压缩空间信息并提取光照信息。所有卷积层采用Leaky Relu作为激活函数,并将填充设置为相同。然后,利用全局平均池操作来整合光照信息。最后,两个完全连接的层根据照明信息计算光照概率。