ResNet网络结构入门

- 一、传统卷积神经存在的问题

- 二、Residual 结构(残差结构)

- ResNet 中的残差结构

- ResNet 中的 short cut

- 三、Batch Normalization

Resnet 网络创新点

- 提出 Residual 结构(残差结构),可搭建超深的网络结构(可突破1000层)

- 使用 Batch Normalization 加速训练(丢弃dropout)

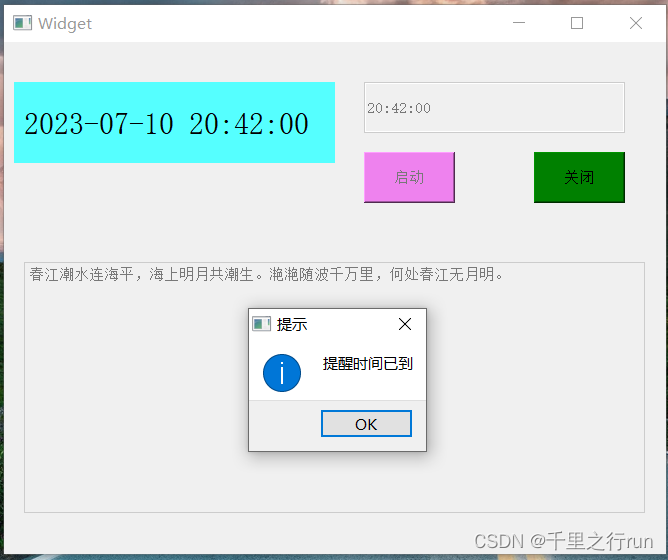

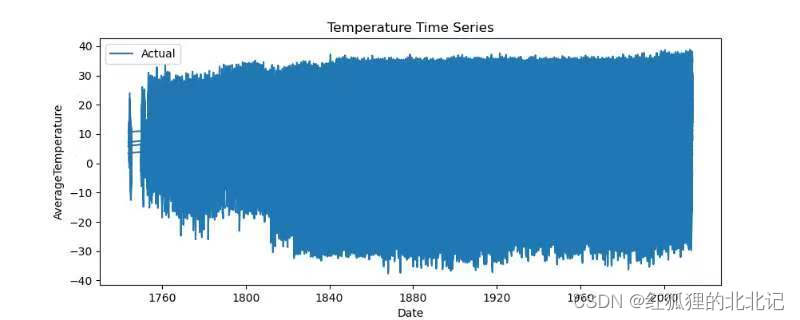

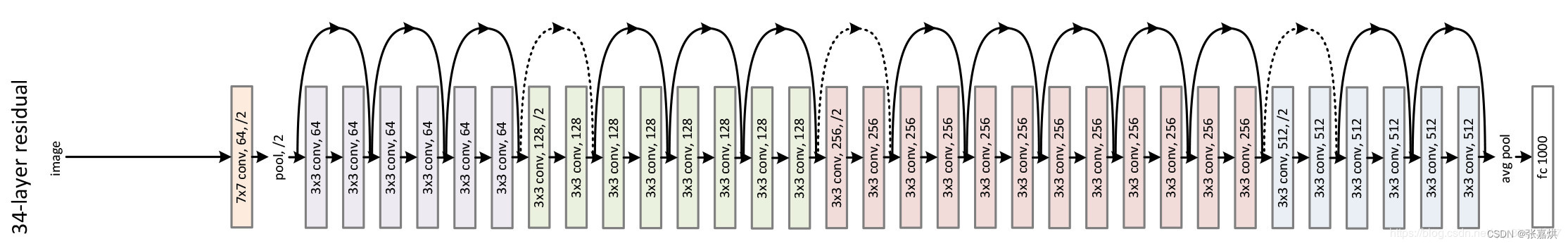

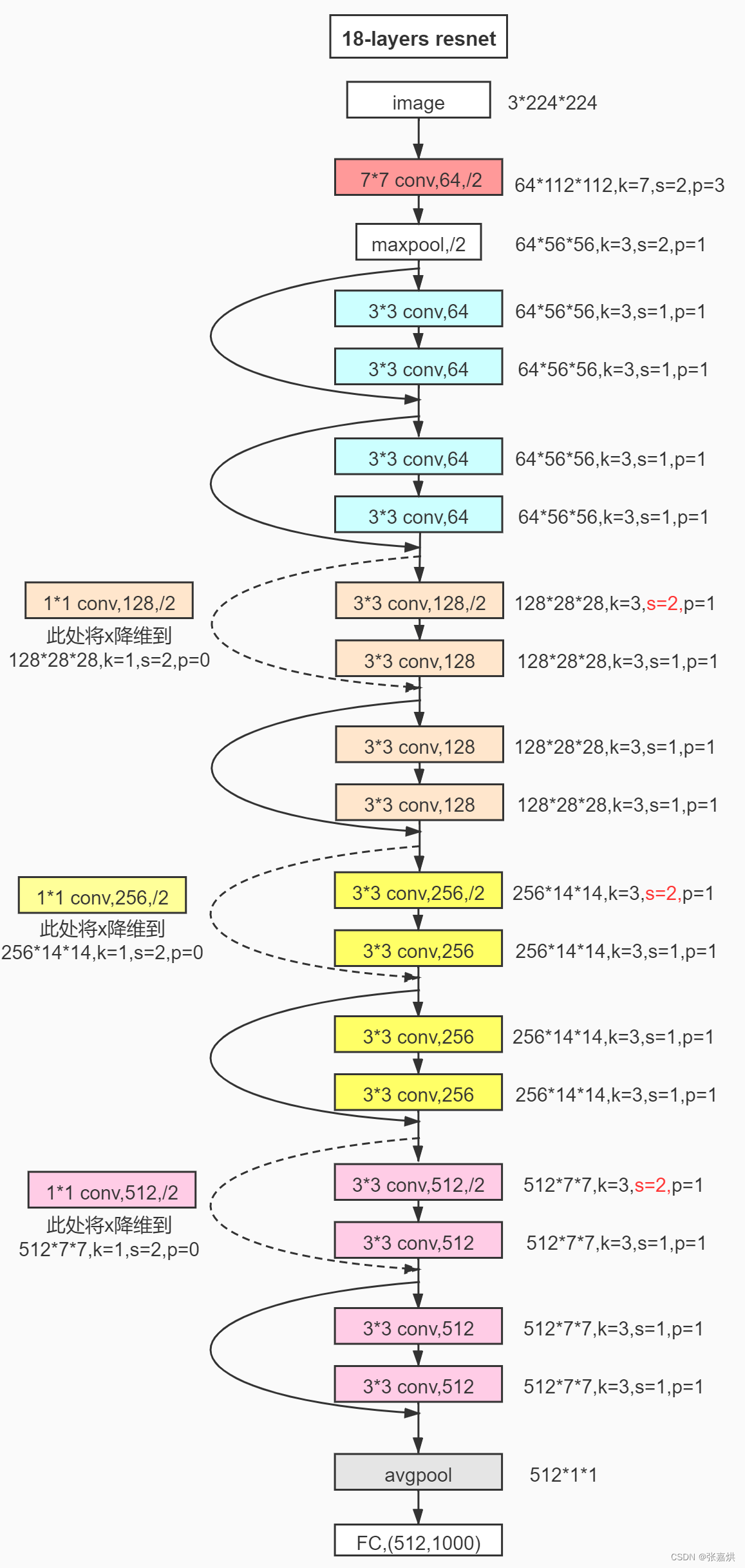

下图是 ResNet34 层模型的结构简图:

一、传统卷积神经存在的问题

在ResNet网络提出之前,传统的卷积神经网络都是通过将一系列卷积层与池化层进行堆叠得到的。

这时容易出现错误认知,觉得网络越深,特征信息越丰富,模型效果应该越好。实验证明,当网络堆叠到一定深度时,会出现两个问题:

- 退化问题(degradation problem):存在深层网络的效果可能比浅层网络差的现象

- 梯度消失或梯度爆炸

梯度消失指每一层的误差梯度小于 1 时,反向传播时网络越深,梯度越趋近于0

反之,梯度爆炸指每一层的误差梯度大于 1 时,反向传播时网路越深,梯度越来越大

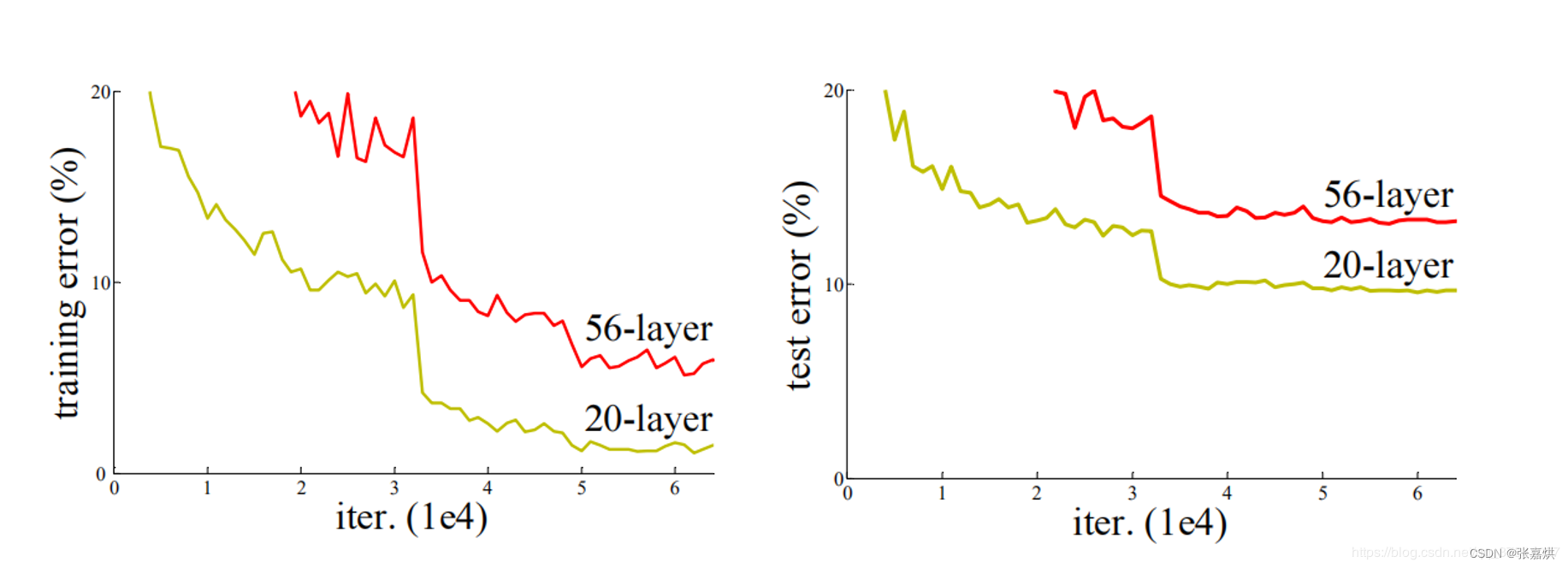

如下图所示,20层网络 反而比 56层网络 的误差更小:

总结:当网络堆叠到一定深度时,深层网络的效果可能比浅层网络效果差

二、Residual 结构(残差结构)

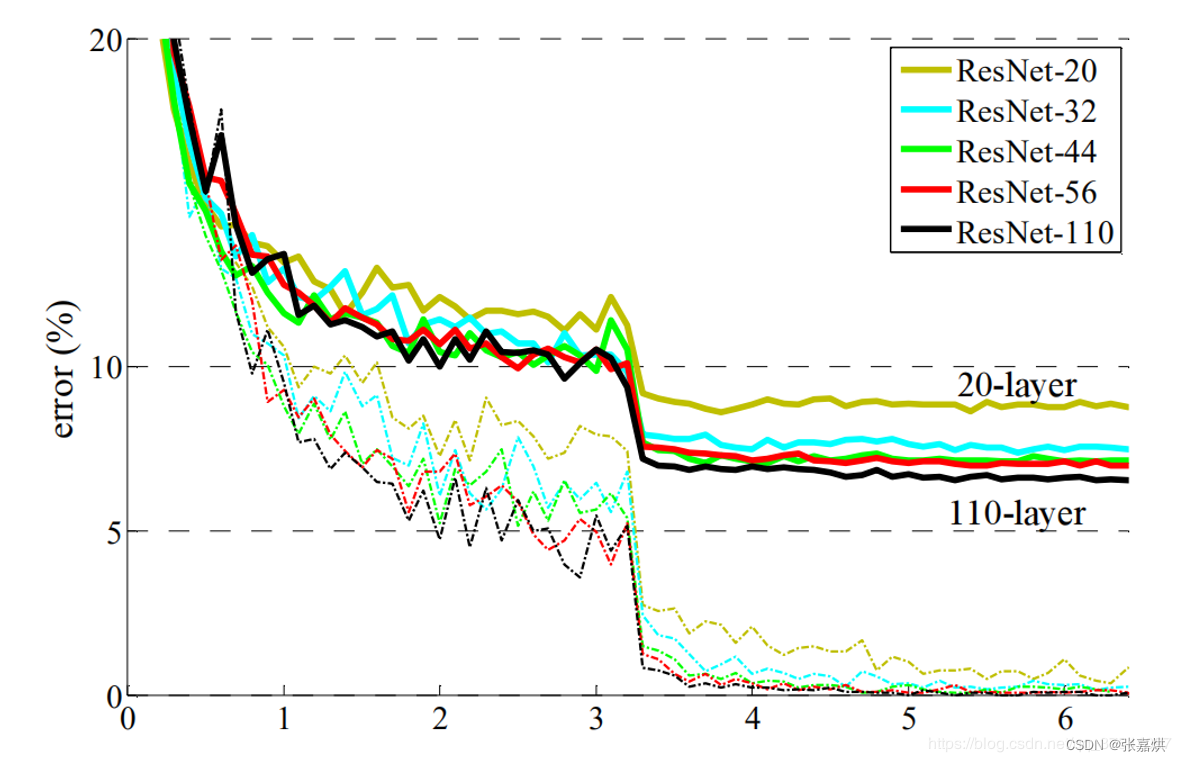

对于退化问题,ResNet提出了 residual结构(残差结构)来减轻退化问题,下图是使用residual结构的卷积网络,可以看到随着网络的不断加深,效果并没有变差,而是变的更好了。(虚线是train error,实线是test error)

人为地让神经网络某些层跳过下一层神经元的连接,隔层相连,弱化每层之间的强联系。这种神经网络被称为 残差网络 (ResNets)。

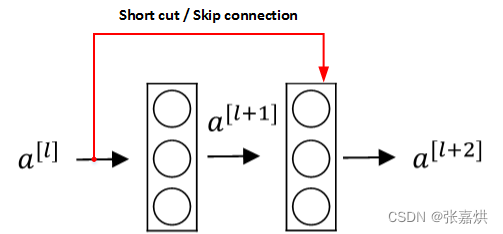

残差网络由许多隔层相连的神经元子模块组成,我们称之为 残差块 Residual block。单个残差块的结构如下图所示:

上图中红色部分称为 short cut 或者 skip connection(捷径分支),直接建立 a[ l] 与 a[l+2] 之间的隔层联系。a[l] 直接隔层与下一层的线性输出相连,与 z[l+2] 共同通过激活函数(ReLU)输出 a[l+2]。

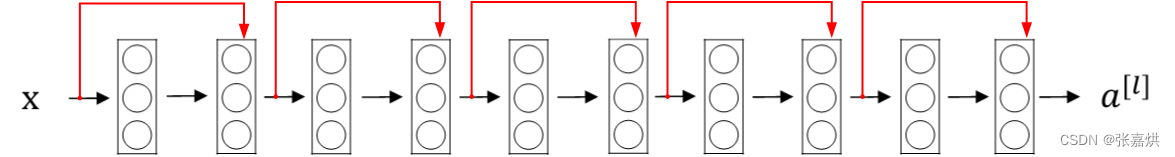

由多个 残差块 组成的神经网络就是 残差网络 。其结构如下图所示:

实验表明,这种模型结构对于训练非常深的神经网络效果很好。

ResNet 中的残差结构

实际应用中,残差结构的 short cut 不一定是隔一层连接,也可以中间隔多层,ResNet所提出的残差网络中就是隔多层。

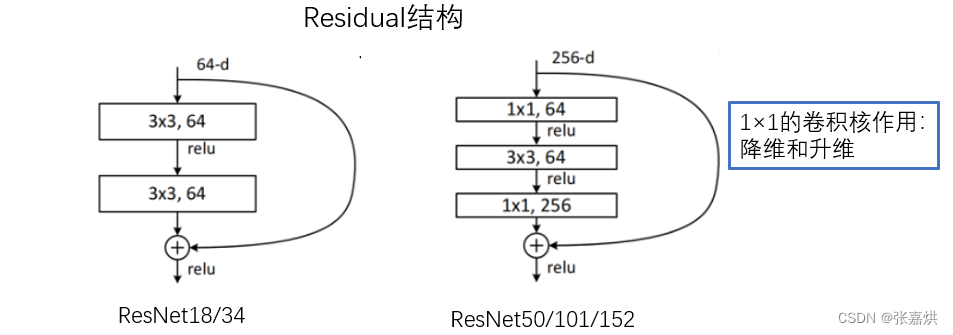

跟 Vgg 网络类似,ResNet也有多个不同层的版本,而残差结构也有两种对应浅层和深层网络:

| ResNet | 残差结构 | |

|---|---|---|

| 浅层网络 | ResNet18/34 | BasicBlock |

| 深层网络 | ResNet50/101/152 | Bottleneck |

下图中左侧残差结构称为 BasicBlock,右侧残差结构称为 Bottleneck

对于深层的 Bottleneck,1×1的卷积核起到降维和升维(特征矩阵深度)的作用,同时可以大大减少网络参数。

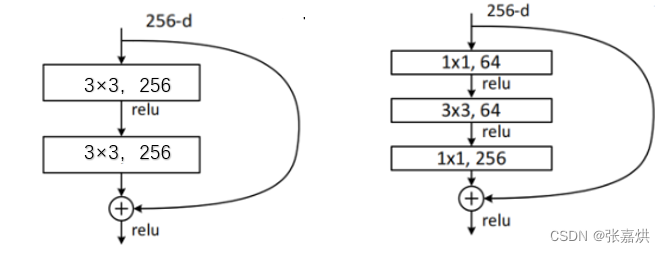

如下所示,假设两个残差结构的输入特征和输出特征矩阵的深度都是 256

那么两个残差结构所需的参数为

- 左侧:3 × 3 × 256 × 256 + 3 × 3 × 256 × 256 = 1 , 179 , 648

- 右侧:1 × 1 × 256 × 64 + 3 × 3 × 64 × 64 + 1 × 1 × 64 × 256 = 69 , 632

注:CNN参数个数 = 卷积核尺寸×卷积核深度 × 卷积核组数 = 卷积核尺寸 × 输入特征矩阵深度 × 输出特征矩阵深度

所以搭建深层网络时,使用右侧的残差结构更合适

ResNet 中的 short cut

观察下图的 ResNet18层网络,可以发现有些残差块的 short cut 是实线的,而有些则是虚线的。

虚线的 short cut 上通过1×1的卷积核进行了维度处理(特征矩阵在长宽方向降采样,深度方向调整成下一层残差结构所需要的channel)。

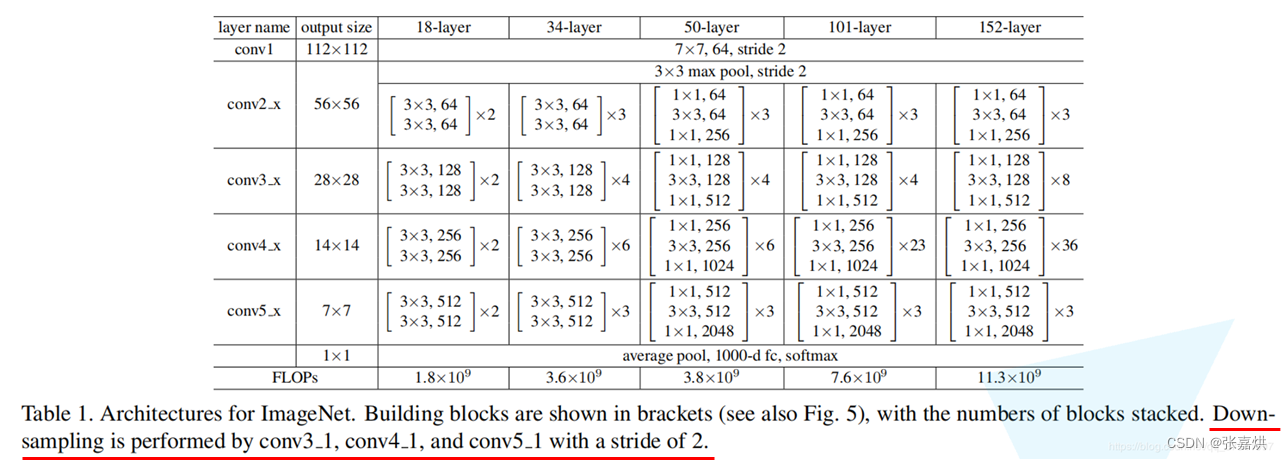

下图是原论文给出的不同深度的ResNet网络结构配置,表中 残差块×N 表示将该残差结构重复N次。

注:

对于ResNet50/101/152,conv2_x所对应的一系列残差结构的第一层是虚线残差结构,因为它需要调整输入特征矩阵的channel,将shape从[56, 56, 64] --> [56, 56, 256]。

根据表格可知通过3x3的max pool之后输出的特征矩阵shape应该是[56, 56, 64],但conv2_x中的实线残差结构期望的输入特征矩阵shape是[56, 56, 256](因为输入输出特征矩阵shape相同才能将捷径分支输出与主分支输出相加)。

另外需要注意,上面只调整channel维度,高和宽不变,而conv3_x, conv4_x, conv5_x所对应的一系列残差结构的第一层虚线残差结构不仅要调整channel还要将高和宽缩减为原来的一半。

三、Batch Normalization

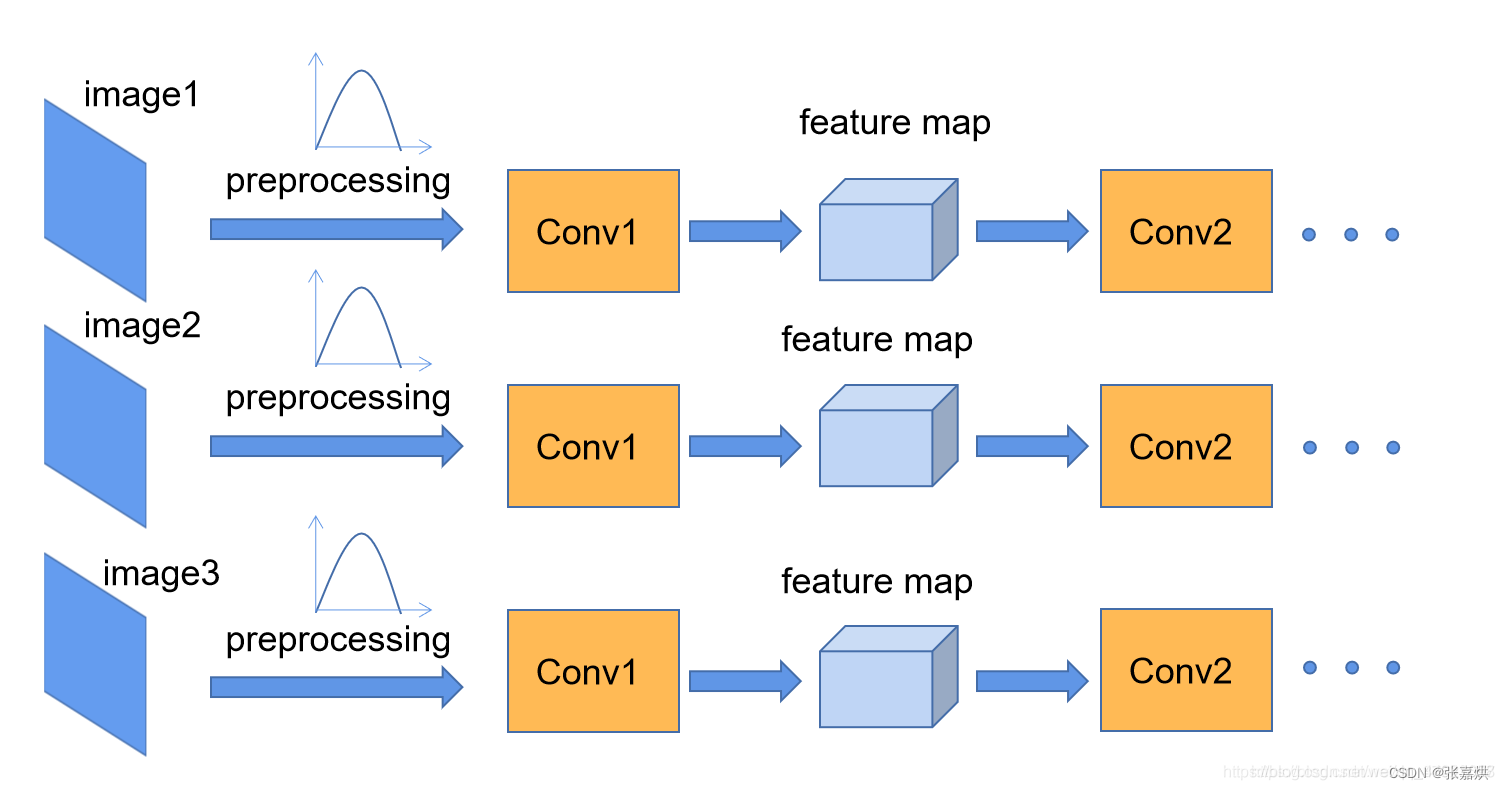

对于梯度消失或梯度爆炸问题,ResNet论文提出通过数据的预处理以及在网络中使用 BN(Batch Normalization)层来解决。

Batch Normalization,简称BatchNorm或BN,翻译为“批归一化”,是神经网络中一种特殊的层,如今已是各种流行网络的标配。BN被建议插入在(每个)ReLU激活层前面。

如下图所示,对于 Conv1 来说输入满足某一分布,但对于 Conv2 而言输入的feature map就不一定满足某一分布规律了。而我们Batch Normalization的目的就是使我们的feature map满足均值为0,方差为1的分布规律。