【MATLAB第52期】#源码分享 | 基于MATLAB的高斯过程GPR超参数(sigma)自动优化算法 时间序列预测模型 五折交叉验证

后台私信回复“52期”即可免费获取数据及代码。

一、效果展示

二、优化思路

1.数据

一列时间序列数据 ,滑动窗口尺寸为15。

2.思路

使用GPR自动优化函数,对sigma进行自动寻优。

适应度值log(1+loss)。

迭代次数默认30.

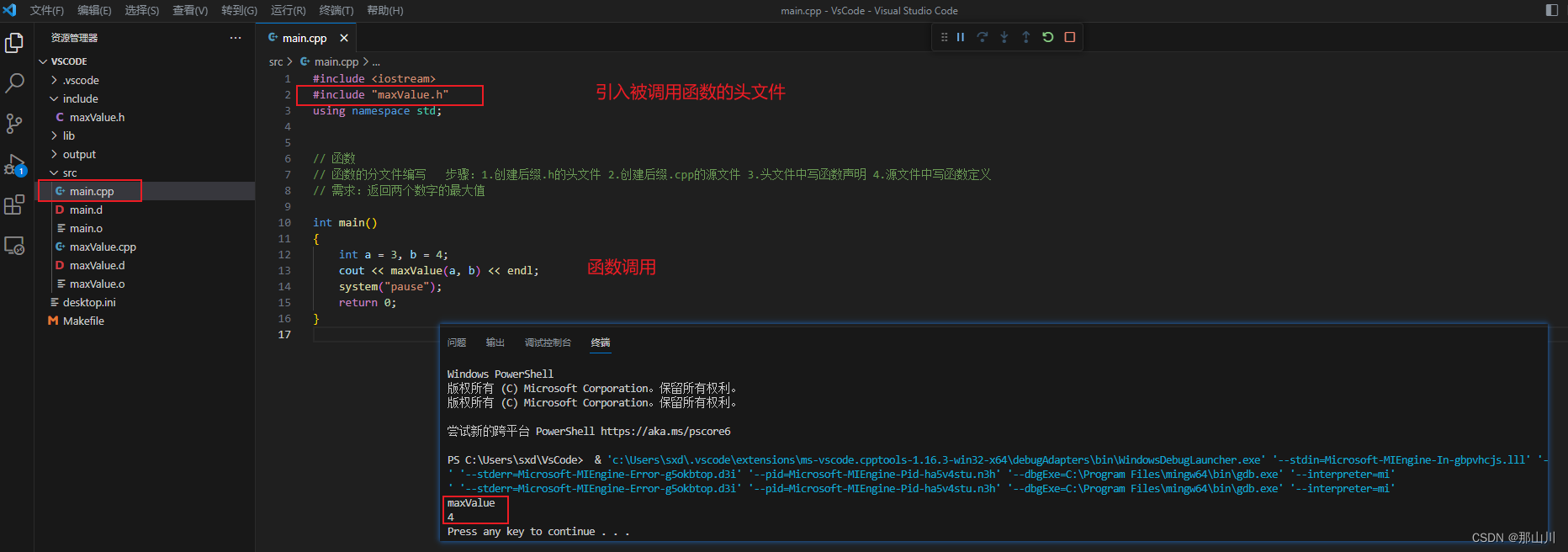

三、代码展示

%% 清空环境变量

warning off % 关闭报警信息

close all % 关闭开启的图窗

clear % 清空变量

clc % 清空命令行

%% 导入数据(时间序列的单列数据)

result = xlsread('数据集.xlsx');

%% 数据分析

num_samples = length(result); % 样本个数

kim = 15; % 延时步长(kim个历史数据作为自变量)

zim = 1; % 跨zim个时间点进行预测

%% 构造数据集

for i = 1: num_samples - kim - zim + 1

res(i, :) = [reshape(result(i: i + kim - 1), 1, kim), result(i + kim + zim - 1)];

end

%% 划分训练集和测试集

temp = 1: 1: 922;

P_train = res(temp(1: 700), 1: 15)';

T_train = res(temp(1: 700), 16)';

M = size(P_train, 2);

P_test = res(temp(701: end), 1: 15)';

T_test = res(temp(701: end), 16)';

N = size(P_test, 2);

%% 数据归一化

[p_train, ps_input] = mapminmax(P_train, 0, 1);

p_test = mapminmax('apply', P_test, ps_input);

[t_train, ps_output] = mapminmax(T_train, 0, 1);

t_test = mapminmax('apply', T_test, ps_output);

%% 转置以适应模型

p_train = p_train'; p_test = p_test';

t_train = t_train'; t_test = t_test';

%训练模型 这个是模型参数 ,运行较好地结果

gprMdl= fitrgp(p_train,t_train,'OptimizeHyperparameters','auto','HyperparameterOptimizationOptions',...

struct('Optimizer','randomsearch'));%训练高斯过程模型 HyperparameterOptimizationOptions 五折交叉验证自动优化超参数sigma

%gprMdl = fitrgp(p_train,t_train,'Basis','None','KernelFunction','Exponential');

[t_sim1] = gprpre(gprMdl);

T_sim1=mapminmax('reverse',t_sim1, ps_output);%训练集拟合结果

[t_sim2,~,~] = predict(gprMdl,p_test);

T_sim2=mapminmax('reverse',t_sim2, ps_output);

%% 均方根误差

error1 = sqrt(sum((T_sim1' - T_train).^2) ./ M);

error2 = sqrt(sum((T_sim2' - T_test ).^2) ./ N);

%% 绘图

figure()

subplot(211)

plot(1: M, T_train, 'r-', 1: M, T_sim1, 'b-', 'LineWidth', 1)

legend('真实值','预测值')

xlabel('预测样本')

ylabel('预测结果')

string = {'优化后训练集预测结果对比'; ['RMSE=' num2str(error1)]};

title(string)

xlim([1, M])

grid

subplot(212)

plot(1: N, T_test, 'r-', 1: N, T_sim2, 'b-', 'LineWidth', 1)

legend('真实值','预测值')

xlabel('预测样本')

ylabel('预测结果')

string = {'优化后测试集预测结果对比';['RMSE=' num2str(error2)]};

title(string)

xlim([1, N])

grid

%% 相关指标计算

% R2

R1 = 1 - norm(T_train - T_sim1')^2 / norm(T_train - mean(T_train))^2;

R2 = 1 - norm(T_test - T_sim2')^2 / norm(T_test - mean(T_test ))^2;

disp(['优化后训练集数据的R2为:', num2str(R1)])

disp(['优化后测试集数据的R2为:', num2str(R2)])

% MAE

mae1 = sum(abs(T_sim1' - T_train)) ./ M ;

mae2 = sum(abs(T_sim2' - T_test )) ./ N ;

disp(['优化后训练集数据的MAE为:', num2str(mae1)])

disp(['优化后测试集数据的MAE为:', num2str(mae2)])

% MBE

mbe1 = sum(T_sim1' - T_train) ./ M ;

mbe2 = sum(T_sim2' - T_test ) ./ N ;

disp(['优化后训练集数据的MBE为:', num2str(mbe1)])

disp(['优化后测试集数据的MBE为:', num2str(mbe2)])

%% 优化前 Sigma = 0.5

%gprMdl1 = fitrgp(p_train,t_train,'Basis','None','KernelFunction','Exponential');

[t_sim11] = gprpre(gprMdl1);

T_sim11=mapminmax('reverse',t_sim11, ps_output);%训练集拟合结果

L1 = resubLoss(gprMdl1)%损失函数

[t_sim22,~,~] = predict(gprMdl1,p_test);

T_sim22=mapminmax('reverse',t_sim22, ps_output);

%% 均方根误差

error11 = sqrt(sum((T_sim11' - T_train).^2) ./ M);

error22 = sqrt(sum((T_sim22' - T_test ).^2) ./ N);

%% 绘图

figure()

subplot(211)

plot(1: M, T_train, 'r-', 1: M, T_sim11, 'b-', 'LineWidth', 1)

legend('真实值','预测值')

xlabel('预测样本')

ylabel('预测结果')

string = {'优化前训练集预测结果对比'; ['RMSE=' num2str(error11)]};

title(string)

xlim([1, M])

grid

subplot(212)

plot(1: N, T_test, 'r-', 1: N, T_sim22, 'b-', 'LineWidth', 1)

legend('真实值','预测值')

xlabel('预测样本')

ylabel('预测结果')

string = {'优化前测试集预测结果对比';['RMSE=' num2str(error22)]};

title(string)

xlim([1, N])

grid

%% 相关指标计算

% R2

R11 = 1 - norm(T_train - T_sim11')^2 / norm(T_train - mean(T_train))^2;

R22 = 1 - norm(T_test - T_sim22')^2 / norm(T_test - mean(T_test ))^2;

disp(['优化前训练集数据的R2为:', num2str(R11)])

disp(['优化前测试集数据的R2为:', num2str(R22)])

% MAE

mae11 = sum(abs(T_sim11' - T_train)) ./ M ;

mae22 = sum(abs(T_sim22' - T_test )) ./ N ;

disp(['优化前训练集数据的MAE为:', num2str(mae11)])

disp(['优化前测试集数据的MAE为:', num2str(mae22)])

% MBE

mbe11 = sum(T_sim11' - T_train) ./ M ;

mbe22 = sum(T_sim22' - T_test ) ./ N ;

disp(['优化前训练集数据的MBE为:', num2str(mbe11)])

disp(['优化前测试集数据的MBE为:', num2str(mbe22)])

四、代码免费获取

后台私信回复“52期”即可获取数据及代码下载链接。