Multi-Partition Embedding Interaction with Block Term Format for Knowledge Graph Completion

- - Introduction

- - Algorithm

- - Experiment

- - Conclusion

- - Code

Hung-Nghiep Tran, Atsuhiro Takasu

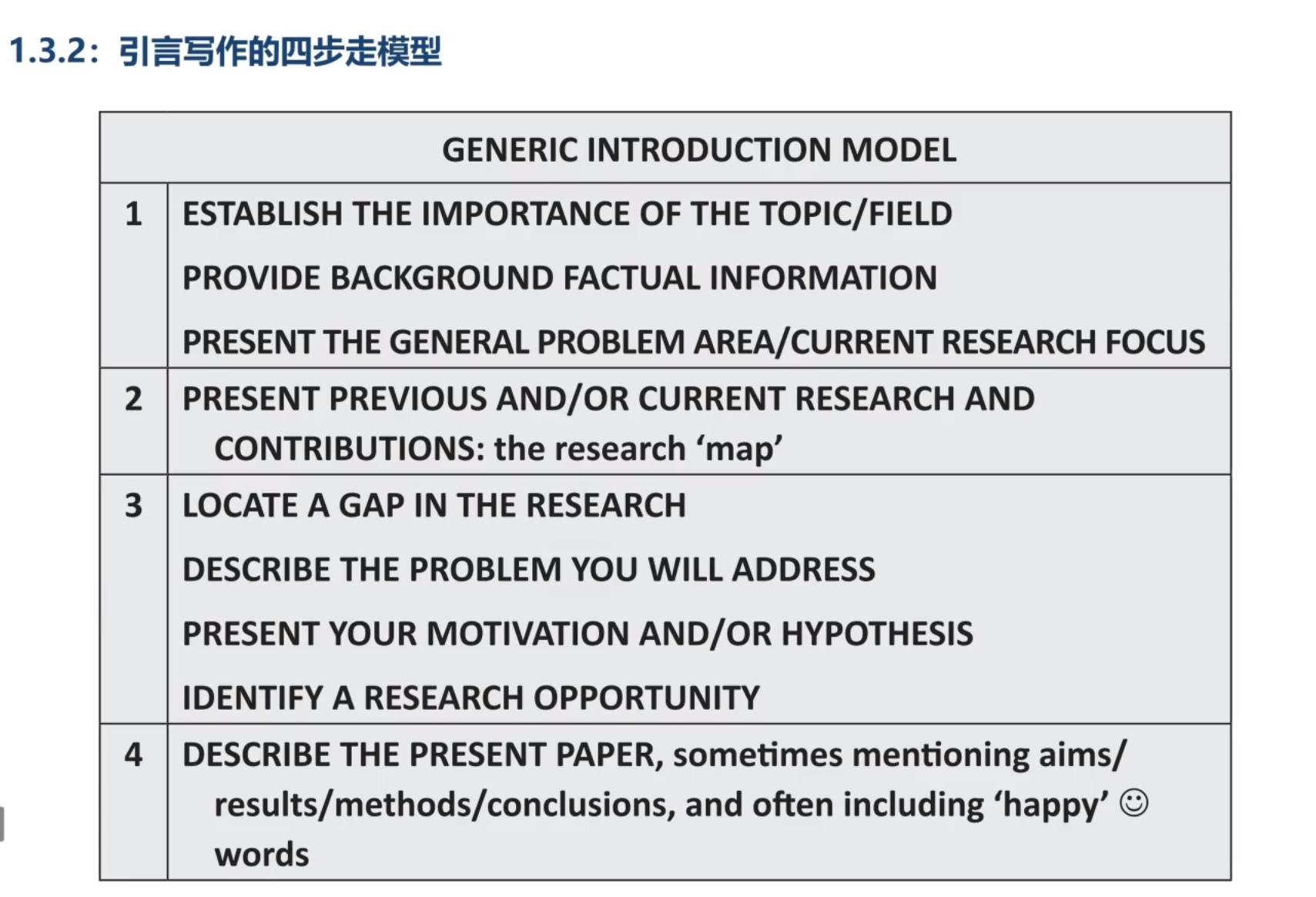

- Introduction

以前的工作通常将每个嵌入视为一个整体,并对这些整体嵌入之间的交互进行建模,这可能使模型过于昂贵或需要特别设计的交互机制。

本文提出了块项格式的多分区嵌入交互(MEI)模型。MEI将每个嵌入划分为一个多分区向量,以有效地限制交互。

每个局部交互都采用Tucker张量格式建模,全交互采用块项张量格式建模,使得MEI能够控制表达性和计算成本之间的权衡

- Algorithm

MEI的打分函数被定义为K个局部相互作用的评分之和,每个局部相互作用用Tucker格式建模:

-

局部交互模型

Tucker形式:

双线性形式:

神经网络形式:

通过双线性形式最后推到的结果,可以视为一个线性神经网络,h为输入,M为隐藏层权重,t为输出层权重,S则为网络最后的输出。 -

全局交互模型

完整的MEI模型可以看作是稀疏参数化双线性模型的一种特殊形式,由所有局部MEI模型的匹配矩阵的直接和构造,结果是一个稀疏参数化块对角矩阵:

本文对MEI模型优势的解释与分析:

- 其为知识图谱中的头尾实体之间的多个相对独立的交互建模,所以局部模型都是一起优化的,同时区块数K>1时,是优于Tucker的整体优化策略;

- MEi的嵌入可以视为向量的向量,意味着一个元向量其中所对应的局部分区的每个向量中都含有向量项而不是标量项,与标量相比,向量包含着跟股东的信息。

损失函数:

- Experiment

链接预测实验:

本文MEI模型有两类,当k=1时,其实就是Tucker,当k=3时,为本文的分区交互的模型。

参数尺度实验:

参数的性能平衡实验:

- Conclusion

- 提出了基于块项格式的多分区嵌入交互模型MEI,以系统地控制表达性和计算成本之间的权衡,自动从数据中学习交互机制,并在链路预测任务中实现最先进的性能。

- 从理论上研究了参数效率问题,导出了一个简单的最优参数权衡准则。

- 并应用MEI模型的框架对以前模型中专门设计的几种交互机制提出了一种新的广义解释

本文的模型其实标比较一般,创新型也是在Tucker的之基础上展开的,同时效果并不是很好。比较滑稽的一点是明明就是Tukcer模型,但作者改写成自己的模型MEI(1x100)。同时自己的模型几乎在所有指标上都不如Tucker,唯独一两个指标就高0.001。但本文在ccf-b上发表,并不是因为模型多么优秀,而是在于论文的写法非常的老套,对自己的模型变体到不同的表达方式上,增加了复杂度的分析。其实从这些论文看下来,模型方法不足展开写的,作者往往都会在时间或者空间复杂度上展开 哈哈~

- Code

https://github.com/tranhungnghiep/MEI-KGE

![[AI] 优先级LRTA*搜索算法 Prioritized-LRTA*](https://img-blog.csdnimg.cn/3ad85f9603fb485f96ec0f5b7235aa80.png#pic_center)

![[附源码]计算机毕业设计JAVA疫情状态下病房管理平台](https://img-blog.csdnimg.cn/80387c4a412143b29fb4e0270bbae0d1.png)