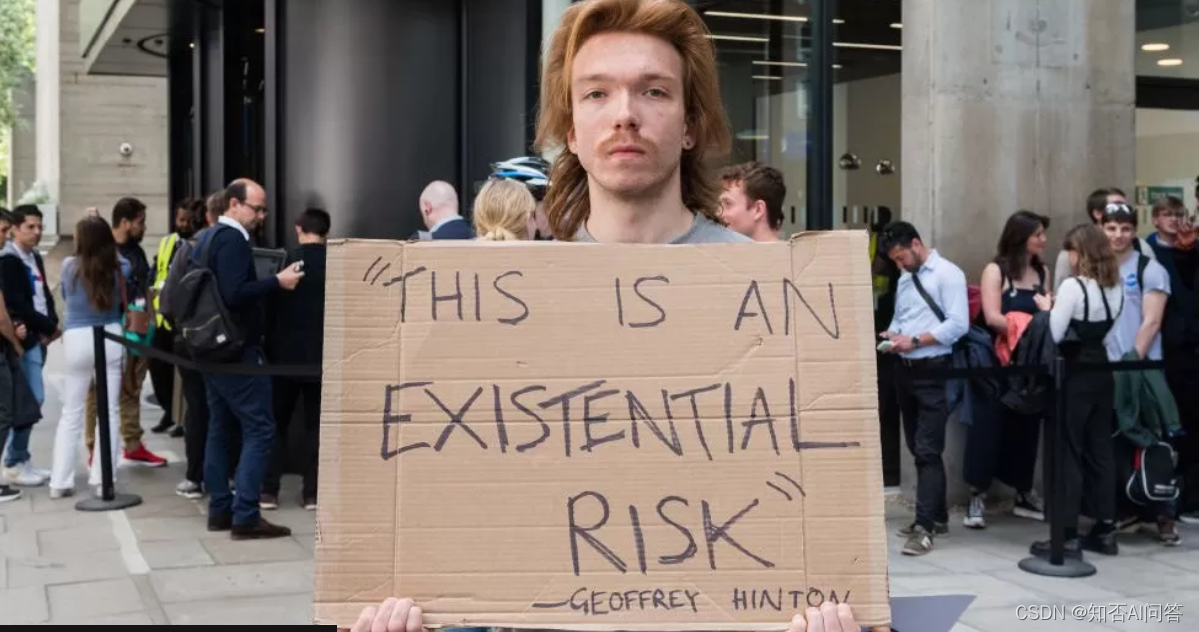

人工智能可能导致人类灭绝,包括 OpenAI 和 Google Deepmind 负责人在内的专家警告说

数十人支持在人工智能安全中心

的网页上发表的声明。

它写道:“减轻人工智能灭绝的风险应该与其他社会规模的风险(如流行病和核战争)一起成为全球优先事项。”

但其他人表示,恐惧被夸大了。

ChatGPT 制造商 OpenAI 的首席执行官 Sam Altman、Google DeepMind 的首席执行官 Demis Hassabis 和 Anthropic 的 Dario Amodei 都支持这一声明。

杰弗里·辛顿 (Geoffrey Hinton) 博士早些时候曾就超级智能人工智能的风险发出警告,他也支持这一呼吁。

蒙特利尔大学计算机科学教授 Yoshua Bengio 也签名了。

(来自BBC news:)

Hinton 博士、Bengio 教授和纽约大学 Yann LeCunn 教授因其在该领域的开创性工作而常被称为“AI 教父”——为此他们共同获得了 2018 年图灵奖,该奖项旨在表彰计算机科学领域的杰出贡献。

但同样在 Meta 工作的 LeCunn 教授表示,这些世界末日般的警告被夸大了。

这是绝对正确的。

人工智能研究人员对这些厄运预言最常见的反应是捂脸。- Yann LeCun (@ylecun) 2023 年 5 月 4 日

许多其他专家同样认为,人工智能灭绝人类的恐惧是不现实的,并且是对已经存在的系统偏见等问题的一种分散注意力的方式。普林斯顿大学的计算机科学家阿文德·纳拉亚南曾告诉BBC,类似科幻灾难场景是不现实的:“当前的人工智能远远没有足够的能力让这些风险成为现实。因此,它将注意力从人工智能的近期危害上分散了出去。”

自 2023 年 3 月以来,包括特斯拉老板埃隆·马斯克在内的专家签署了一封公开信,敦促停止开发下一代人工智能技术,媒体对人工智能所谓的“生存”威胁的报道如滚雪球般增加。

那封信询问我们是否应该“发展最终可能超过我们、超越我们、过时并取代我们的非人类思维”。

相比之下,新的竞选活动有一个非常简短的声明,旨在“展开讨论”。

PS:

如果大家还没有用户ChatGPT,那么在人类毁灭之前,可以用下我们精心为您准备的ChatGPT中文版-知否AI问答。

![[原创]集权设施保护之LDAP协议](https://img-blog.csdnimg.cn/img_convert/c89684aa348c07154a7dec27722a3c33.png)