眼见为实?耳听为真?当心AI诈骗!

只需要提供一张带脸的照片,就可以把自己置换成视频、电视剧中的男(女)主角,拟真度非常高,毫无违和感,这是最近爆火的AI换脸。

然而随着人工智能的迅猛发展,诈骗团伙的诈骗手段也越来越科技化,竟然也用上了AI换脸技术。

5月22日,话题#AI诈骗正在全国爆发#冲上微博热搜。

据“平安包头”消息,近日,包头市公安局电信网络犯罪侦查局发布一起使用智能AI技术进行电信诈骗的案件,福州市某科技公司法人代表郭先生10分钟内被骗430万元。

一、AI诈骗被骗过程

4月20日,郭先生的好友突然通过微信视频联系他,自己的朋友在外地竞标,需要430万保证金,且需要公对公账户过账,想要借郭先生公司的账户走账。

基于对好友的信任,加上已经视频聊天核实了身份,郭先生没有核实钱款是否到账,就分两笔把430万转到了好友朋友的银行卡上。郭先生拨打好友电话,才知道被骗。骗子通过智能AI换脸和拟声技术,佯装好友对他实施了诈骗。

为什么被骗?

显然,郭先生遇到的是高端骗子,针对他定制了一个专门的诈骗剧本。

-

诈骗团伙在给郭先生打视频电话时,使用的就是他好友的微信号,把他朋友的微信号盗了;

-

骗子掌握了比较多的郭先生朋友的图片、音频、视频信息,用来训练模型;

-

骗子拥有实时渲染数字人的技术,因为警方新闻中提到了郭先生和他朋友打的是微信视频;

-

骗子应该对郭先生及其朋友的过往对话风格有比较深入的了解,知道怎么跟郭先生沟通。

以上所有的条件,无论哪一个,具体到实施上,都是很有难度的操作。但骗子做到了,他们不仅懂AI换脸和声纹技术,还精准掌握了郭先生和好友的关系信息,并为此准备了对公账户收款。

AI换脸再加上声纹模拟技术,生出了天生的诈骗神器一模拟视频聊天。如果再掌握了受害人足够多的个人信息,盗取了微信号,定制针对一个人的诈骗剧本,理论上成功率可以达到100%。

二、AI诈骗如何识别

科学技术的发展造福了人类,也带来了一些副作用。利用高科技实施电信诈骗,对普通老百姓来说,等同于降维打击,完全是跨领域的碾压。

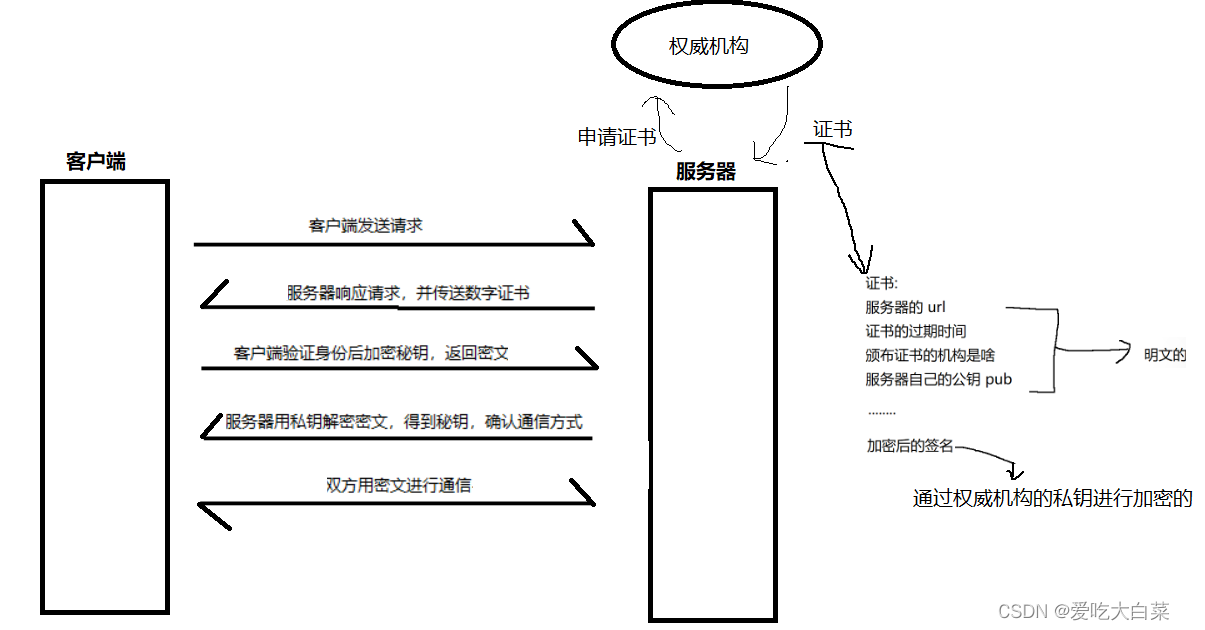

AI换脸中的Deepfake技术,只需要一张正脸照片,就能够将视频中的人脸进行置换,更可怕的是一种视频聊天实时换脸技术,可以将人脸照片直接替换视频聊天中,让照片根据你的人脸做动作,挤眉弄眼、聊天都不是问题。

(视频中的马斯克不是本人,为AI实时合成)

看完这篇文章后,你可能拍着胸脯信誓旦旦地说不会被骗,没看这篇文章之前呢?

你目前还没被骗,并不是因为你多聪明,也不是因为你没钱,而是适合你的“剧本”还在路上。

根据最近流行的AI诈骗,小编总结了预防此类智能化、定制化诈骗的几个要点,请大家牢记:

1.对网络上任何东西,无论是视频、语音,还是视频聊天,都要持怀疑态度,这是第一条基本原则。

2.但凡遇到有关钱的问题,一定要再从侧面核实情况,可以通过打电话的方式核实,但不要打对方提供的电话。

3.如果有人要你帮忙过账,无论多大的领导,多熟悉的人,必须核实,而且要等钱到账之后再进行转账。

4.公检法没有安全账户,警察不会网上办案,如果有网络警察说你犯事了,让他联系你当地的派出所,你也可以主动打110咨询。

5.陌生链接不要点,陌生软件不要下载,陌生好友不要随便加,防止手机、电脑中病毒,微信、QQ等被盗号。

眼见不一定为真,耳听也不一定为实。诈骗分子的骗术一直在更新迭代,朋友们一定要擦亮双眼,提高警惕!要不断学习了解防诈骗知识,千万不要成为电信网络诈骗犯罪团伙的帮凶!