期刊会议:IEEE TRANSACTIONS ON KNOWLEDGE AND DATA ENGINEERING

时间:2010

级别:CCF A

1、为什么需要迁移

许多机器学习和数据挖掘算法的一个主要假设是,训练数据和未来数据必须在相同的特征空间中,并且具有相同的分布。然而,在许多实际应用程序中,这种假设可能不成立。

2、迁移学习的目的

将已有的源域中的知识迁移到目标域中,解决:

- 目标域数据标签较少或者无标签的问题

- 重新训练模型耗费大量训练资源的问题

- 数据变化较大一段时间后模型失效的问题

3、范式

4、每一个步骤的目的

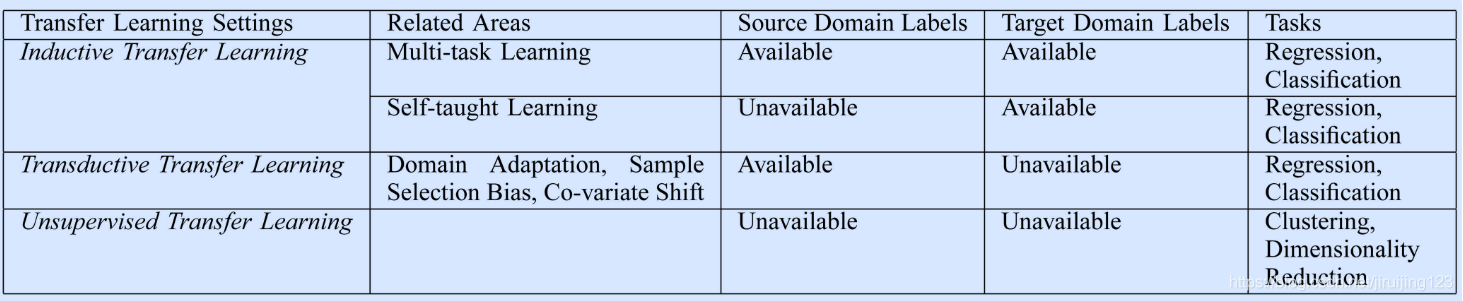

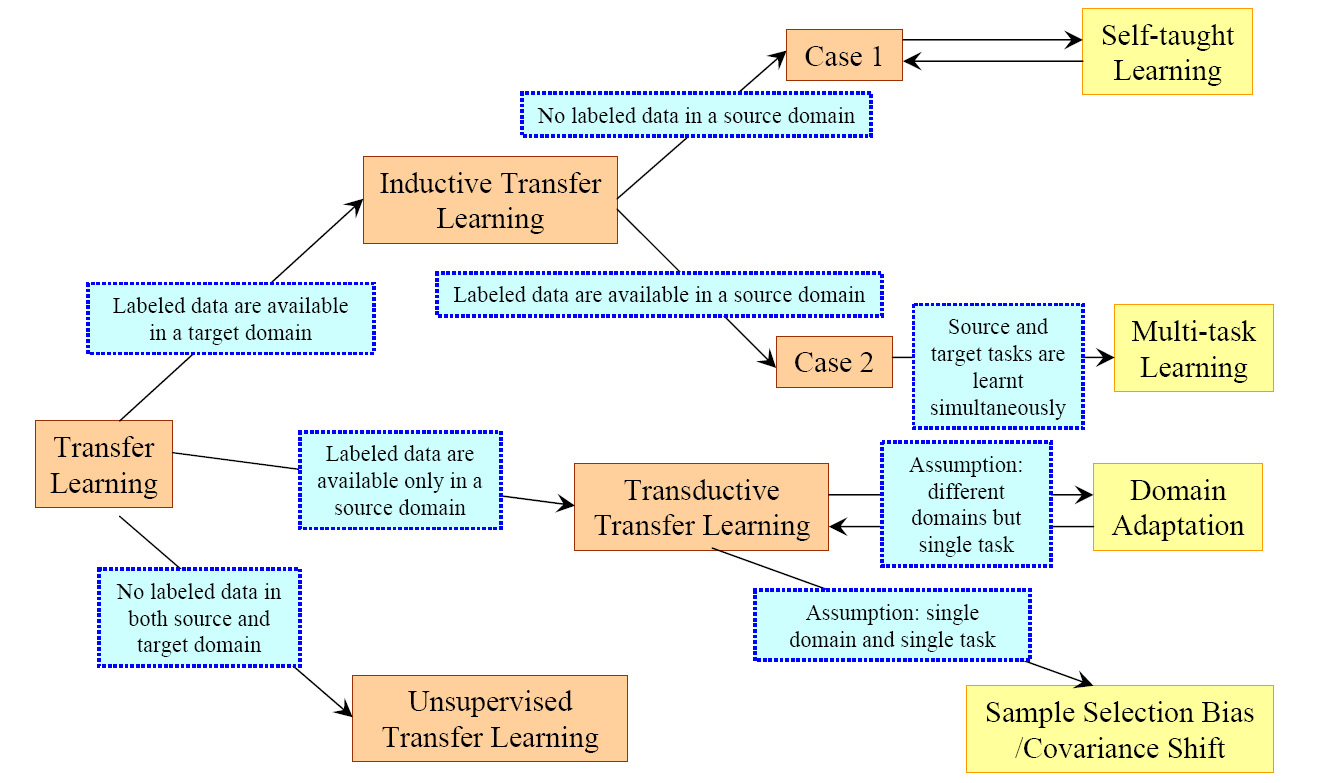

5、为什么这么分类

- 基于源域和目标域和任务之间的不同情况

- (归纳)推导迁移学习(inductive transfer learning):目标任务和源任务不同,无论目标域与源域是否相同。在这种情况下,需要目标域中的一些标记数据来导出用于目标域的客观预测模型 f T ( ⋅ ) f_T (·) fT(⋅)

- (直推式)转导迁移学习(transductive transfer learning): 源任务和目标任务相同,源域和目标域不同。

- 无监督迁移学习(unsupervised transfer learning):目标任务与源任务不同但相关。然而,无监督迁移学习专注于解决目标域中的无监督学习问题,如聚类、降维、密度估计。这种情况下,训练中源域和目标域都无已标注数据可用

- 迁移什么

- 基于实例的迁移学习

- 基于特征表示的迁移学习

- 基于参数的迁移学习

- 关系知识迁移学习

6、每个流派解决的问题