卷积神经网络可以直接从原始数据中学习其特征表示并完成最终任务,可以说卷积网络是“端”到“端”的思想,在整个学习流程中并进行认为的子问题划分,而是交给深度学习模型直接学得从原始输入到期望输出得映射。

卷积神经网络是包含卷积层,该卷积层得运算是组成卷积神经网络的基础。

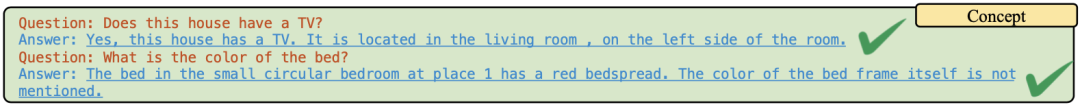

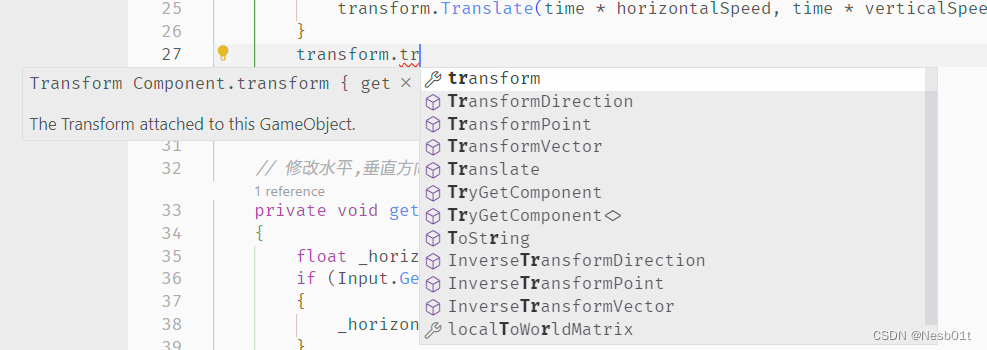

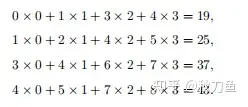

卷积层中使⽤更加直观的互相关(crosscorrelation)运算,在⼆维卷积层中,⼀个⼆维输⼊数组和⼀个⼆维核(kernel)数组通过互相 运算输出⼀个⼆维数组。我们⽤⼀个具体例⼦来解释⼆维互相关运算的含义。如下图所示,输入是一个高和宽为都为3的二维数组;核的高核宽都为2。其中数组的运算称其为卷积核或过滤器,而卷积核窗口取决于卷积核的高和宽。

在⼆维互相关运算中,卷积窗口从输⼊数组的最左上⽅开始,按从左往右、从上往下的顺序,依次在输⼊数组上滑动。具体的每一个窗口位置的运算如下:

以上是我们数学模型的演练计算,下面使用python实现这一过程:

#卷积神经网络基础学习----卷积层运算

from mxnet import autograd, nd

from mxnet.gluon import nn

def corr2d(X, K): # 本函数已保存在d2lzh包中⽅便以后使⽤

h, w = K.shape #读取核的行与列

#print(h,w)

Y = nd.zeros((X.shape[0] - h + 1, X.shape[1] - w + 1)) #给输出创建空间

#print(Y)

for i in range(Y.shape[0]):

for j in range(Y.shape[1]):

Y[i, j] = (X[i: i + h, j: j + w] * K).sum()

return Y

#调用corr2d进行卷积运算

X = nd.array([[0, 1, 2], [3, 4, 5], [6, 7, 8]]) #卷积的输入

K = nd.array([[0, 1], [2, 3]]) #卷积核

Y=corr2d(X, K) #卷积运算的输出

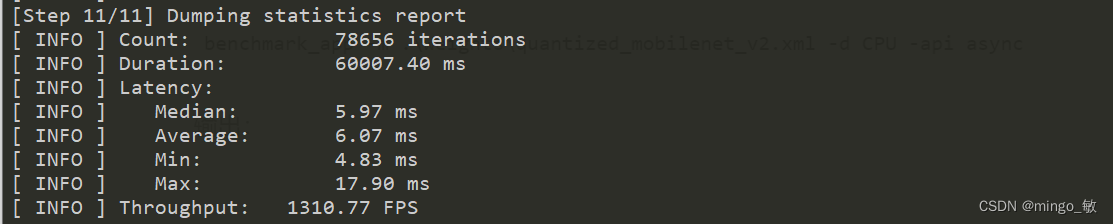

print(Y)输出结果如下:

[[19. 25.]

[37. 43.]]

<NDArray 2x2 @cpu(0)>使用python进行这个神经网络的卷积运算的时候,需要导入mxnet库,这是专门针对卷积神经网络的一个库。对于如何安装库,大家可以在cmd中输入:

pip install mxnet -f https://dist.mxnet.io/python既可以成功安装mxnet库。如果不能直接安装可能是pip版本问题,可以在cmd中输入下面的命令:

python -m pip install --upgrade pip