💥💥💞💞欢迎来到本博客❤️❤️💥💥

🏆博主优势:🌞🌞🌞博客内容尽量做到思维缜密,逻辑清晰,为了方便读者。

⛳️座右铭:行百里者,半于九十。

📋📋📋本文目录如下:🎁🎁🎁

目录

💥1 概述

📚2 运行结果

🎉3 参考文献

🌈4 Matlab代码实现

💥1 概述

文献来源:

从甚高分辨率 (VHR) 航空和卫星图像检测建筑物在地图制作、城市规划和土地利用分析中非常有用。虽然可以从这些VHR图像中手动定位建筑物,但此操作可能不可靠且快速。因此,需要自动化系统从VHR航空和卫星图像中检测建筑物。不幸的是,这种系统必须处理重大问题。首先,建筑物具有不同的特征,它们的外观(照明,视角等)在这些图像中不受控制。其次,城市地区的建筑物通常密集而复杂。很难从它们中检测到单独的建筑物。为了克服这些困难,我们提出了一种使用局部特征向量和概率框架的新型建筑检测方法。我们首先介绍四种不同的局部特征向量提取方法。提取的局部特征向量用作要估计的概率密度函数 (pdf) 的观测值。使用可变核密度估计方法,我们估计相应的pdf。换句话说,我们将图像中的建筑物位置(待检测)表示为联合随机变量并估计它们的pdf。使用估计密度的模式以及其他概率属性,我们检测图像中的建筑物位置。我们还引入了基于概率框架的数据和决策融合方法来检测建筑物位置。我们挑选了VHR全色航空和Ikonos卫星图像的某些作物来测试我们的方法。我们假设这些作物是使用我们以前的城市区域检测方法检测的。我们的测试图像由两个不同的传感器采集,它们具有不同的空间分辨率。此外,这些图像中的建筑物具有不同的特征。因此,我们可以在不同的数据集上测试我们的方法。广泛的测试表明,我们的方法可用于在Ikonos卫星和我们的航空图像中以稳健和快速的方式自动检测建筑物。

原文摘要:

Abstract:

Detecting buildings from very high resolution (VHR) aerial and satellite images is extremely useful in map making, urban planning, and land use analysis. Although it is possible to manually locate buildings from these VHR images, this operation may not be robust and fast. Therefore, automated systems to detect buildings from VHR aerial and satellite images are needed. Unfortunately, such systems must cope with major problems. First, buildings have diverse characteristics, and their appearance (illumination, viewing angle, etc.) is uncontrolled in these images. Second, buildings in urban areas are generally dense and complex. It is hard to detect separate buildings from them. To overcome these difficulties, we propose a novel building detection method using local feature vectors and a probabilistic framework. We first introduce four different local feature vector extraction methods. Extracted local feature vectors serve as observations of the probability density function (pdf) to be estimated. Using a variable-kernel density estimation method, we estimate the corresponding pdf. In other words, we represent building locations (to be detected) in the image as joint random variables and estimate their pdf. Using the modes of the estimated density, as well as other probabilistic properties, we detect building locations in the image. We also introduce data and decision fusion methods based on our probabilistic framework to detect building locations. We pick certain crops of VHR panchromatic aerial and Ikonos satellite images to test our method. We assume that these crops are detected using our previous urban region detection method. Our test images are acquired by two different sensors, and they have different spatial resolutions. Also, buildings in these images have diverse characteristics.Therefore, we can test our methods on a diverse data set. Extensive tests indicate that our method can be used to automatically detect buildings in a robust and fast manner in Ikonos satellite and our aerial images.

甚高分辨率(VHR)航空和卫星图像提供了有价值的信息。特别是,从这些图像中检测建筑物需要特别考虑,因为这些信息可用于多种遥感应用,例如自动地图制作、城市规划和土地利用分析。不幸的是,出于多种原因,人类专家在给定的航空或卫星图像中手动标记建筑物是乏味的。首先,可以从不同的视角对建筑物进行成像。它们可能没有唯一的表示形式。其次,建筑物可能与环境有复杂的相互作用(例如树木的遮挡)。此外,它们可能会相互遮挡。第三,图像中的照明和对比度可能不足以可靠地检测建筑物。第四,这些图像可能覆盖了大片地理区域,其中有许多建筑物。分析图像可能需要一些时间。最后,建筑物没有标准的大小和形状。因此,在VHR航空和卫星图像上开发鲁棒且快速的建筑检测算法已成为必要。

在过去的二十年中,研究人员开发了使用航空和卫星图像的自动建筑检测方法。在航空和卫星图像中对建筑物检测有很好的评论[23],[38]。有兴趣的读者可以从这些研究中获得有关大多数自动化建筑检测方法的详细信息。接下来,我们总结了最近引入的建筑检测方法,重点介绍了与本文所提出的方法相关的方法。Kim和Muller[17]使用图论来检测航空图像中的建筑物。他们提取给定图像中的线性特征,并将它们用作图形的顶点。然后,他们通过将子图与模型建筑图进行匹配来提取建筑物。最后,他们使用强度和阴影信息来验证建筑物的外观。与我们不同的是,他们使用彩色航拍图像和线性特征。Krishnamachari和Chellappa[18]在航空图像中引入了一种基于马尔可夫随机场(MRF)的建筑物检测方法。它们受益于图像中的直线段,并在相互作用上形成基于MRF的检测方法。与我们的系统相比,这个系统更复杂。Segl和Kaufmann [29]以迭代方式将监督形状分类与无监督图像分割相结合。他们的方法允许在高分辨率卫星图像中搜索小物体(如建筑物)。Molinier等人[25]考虑通过训练自组织地图来检测卫星图像中人造结构的边界。Gamba等人[11]使用边界信息提取城市区域的地图。他们将边界和非边界数据提供给两个不同的分类器。然后,他们将结果结合起来,在VHR图像上检测城市地区的建筑物。在这些研究中,总是需要一个训练集。Benediktsson等人[6]使用数学形态学运算来提取结构信息,以检测卫星图像中的城市区域。此方法可用于检测影像中的建筑物。Ünsalan和Boyer[38]研究了多光谱卫星图像,以检测居民区的建筑物和街道网络。他们的方法使用植被指数,聚类,分解二进制图像和图论。虽然这种方法很有前途,但需要多光谱信息来检测建筑物。Akçay和Aksoy [1]还提出了一种在高分辨率卫星图像中进行无监督分割和目标检测的新方法。这种方法还需要多光谱信息。Idrissa等人[13]使用Gabor滤波器和SPOT5图像中的归一化差异植被指数提取人造结构(建筑物和道路)的边缘。通过比较从同一区域拍摄的两个图像序列的边缘,他们还检测到了变化。与我们不同,他们受益于多光谱信息。在最近的一项研究中,我们引入了一种使用尺度不变特征变换(SIFT)关键点和图论形式化来检测全色Ikonos卫星图像中建筑物的方法[32]。此方法给出了良好的结果,但它的计算负载很高。它还依赖于模板构建图像作为训练集。在类似的框架中,Xiong和Zhang[41]使用兴趣点进行卫星图像匹配。还有各种研究侧重于航空和卫星图像中的建筑物形状提取[5],[11],[15],[16],[40]。与建筑物检测相比,这是一个更复杂的问题。但是,检测建筑物位置可能有助于从图像中提取建筑物形状。

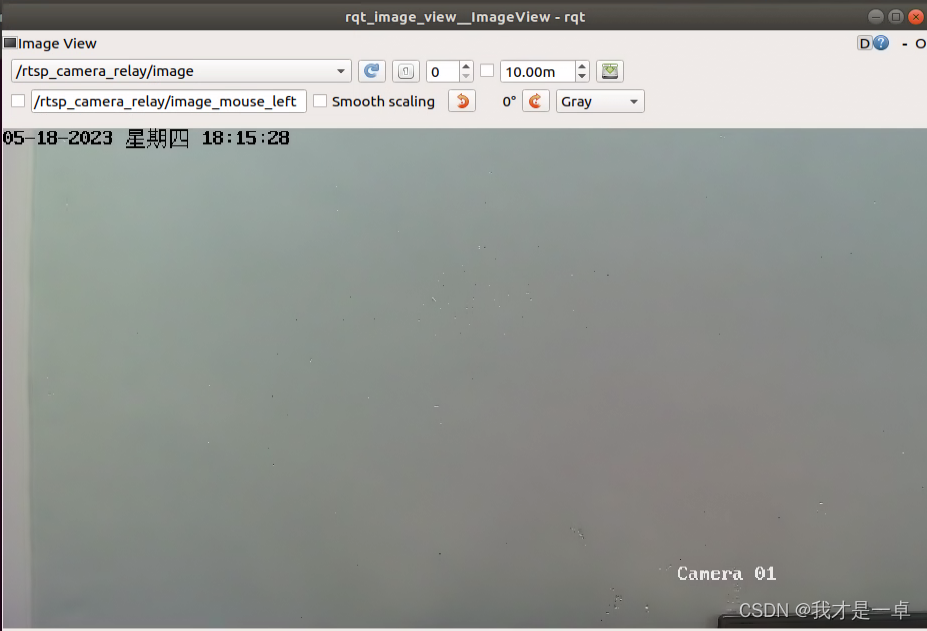

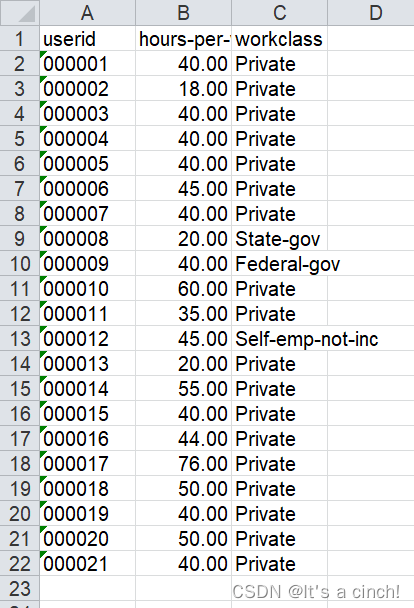

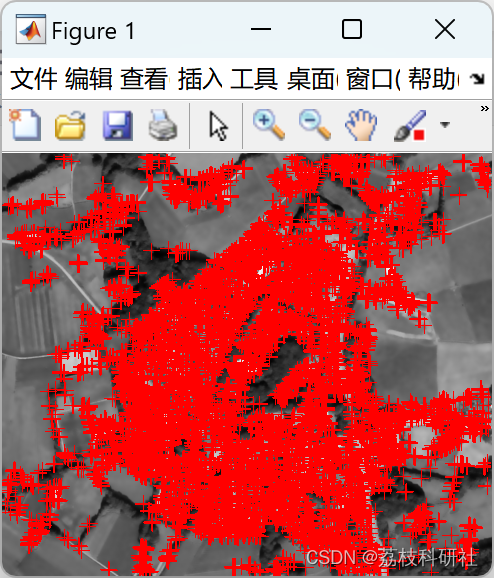

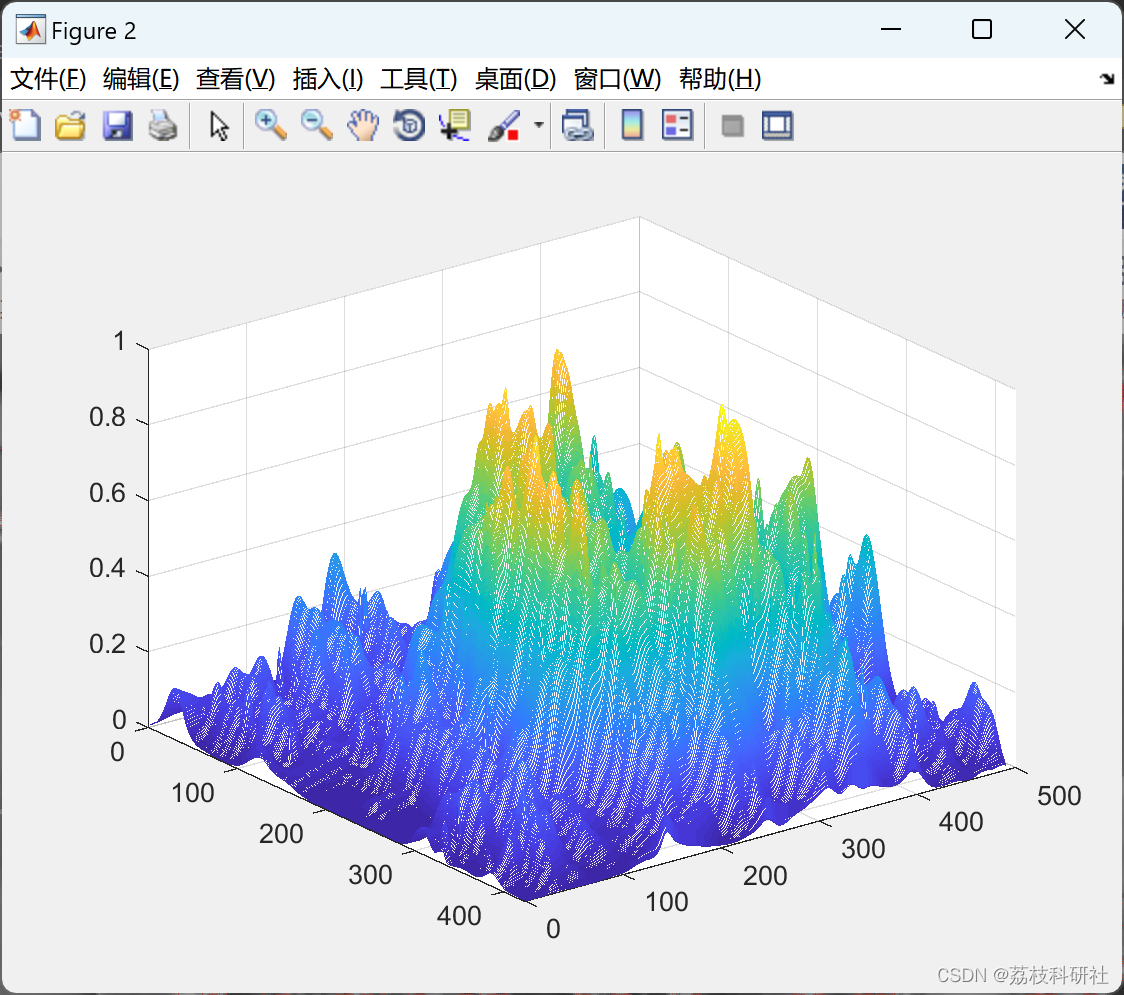

📚2 运行结果

放大:

放大:

放大图:

部分代码:

%

% INPUT

% =====

% im : the graylevel image

%

% OUTPUT

% ======

% points : the interest points extracted

%

% REFERENCES

% ==========

% C.G. Harris and M.J. Stephens. "A combined corner and edge detector",

% Proceedings Fourth Alvey Vision Conference, Manchester.

% pp 147-151, 1988.

%

% Alison Noble, "Descriptions of Image Surfaces", PhD thesis, Department

% of Engineering Science, Oxford University 1989, p45.

%

% C. Schmid, R. Mohrand and C. Bauckhage, "Evaluation of Interest Point Detectors",

% Int. Journal of Computer Vision, 37(2), 151-172, 2000.

%

% EXAMPLE

% =======

% points = kp_harris(im)

% only luminance value

im = double(im(:,:,1));

sigma = 1.5;

% derivative masks

s_D = 0.7*sigma;

x = -round(3*s_D):round(3*s_D);

dx = x .* exp(-x.*x/(2*s_D*s_D)) ./ (s_D*s_D*s_D*sqrt(2*pi));

dy = dx';

% image derivatives

Ix = conv2(im, dx, 'same');

Iy = conv2(im, dy, 'same');

% sum of the Auto-correlation matrix

s_I = sigma;

g = fspecial('gaussian',max(1,fix(6*s_I+1)), s_I);

Ix2 = conv2(Ix.^2, g, 'same'); % Smoothed squared image derivatives

Iy2 = conv2(Iy.^2, g, 'same');

Ixy = conv2(Ix.*Iy, g, 'same');

% interest point response

% cim = (Ix2.*Iy2 - Ixy.^2)./(Ix2 + Iy2 + eps); % Alison Noble measure.

%k=0.31;

%k=0.26;

%k=0.21;

%k=0.16;

%k=0.11;

k=0.06;

%k=0.01;

%k=0.001;

cim = (Ix2.*Iy2 - Ixy.^2) - k*(Ix2 + Iy2).^2; % Original Harris measure.

% find local maxima on 3x3 neighborhood

[r,c,max_local] = findLocalMaximum(cim,3*s_I);

% set threshold 1% of the maximum value

% t = 0.01*max(max_local(:));

t = 0.1*max(max_local(:));

% find local maxima greater than threshold

[r,c] = find(max_local>=t);

% build interest points

points = [r,c];

🎉3 参考文献

部分理论来源于网络,如有侵权请联系删除。

[1]B. Sirmacek and C. Unsalan, "A Probabilistic Framework to Detect Buildings in Aerial and Satellite Images," in IEEE Transactions on Geoscience and Remote Sensing, vol. 49, no. 1, pp. 211-221, Jan. 2011, doi: 10.1109/TGRS.2010.2053713.