一、什么是npu算力盒子?该怎么选?

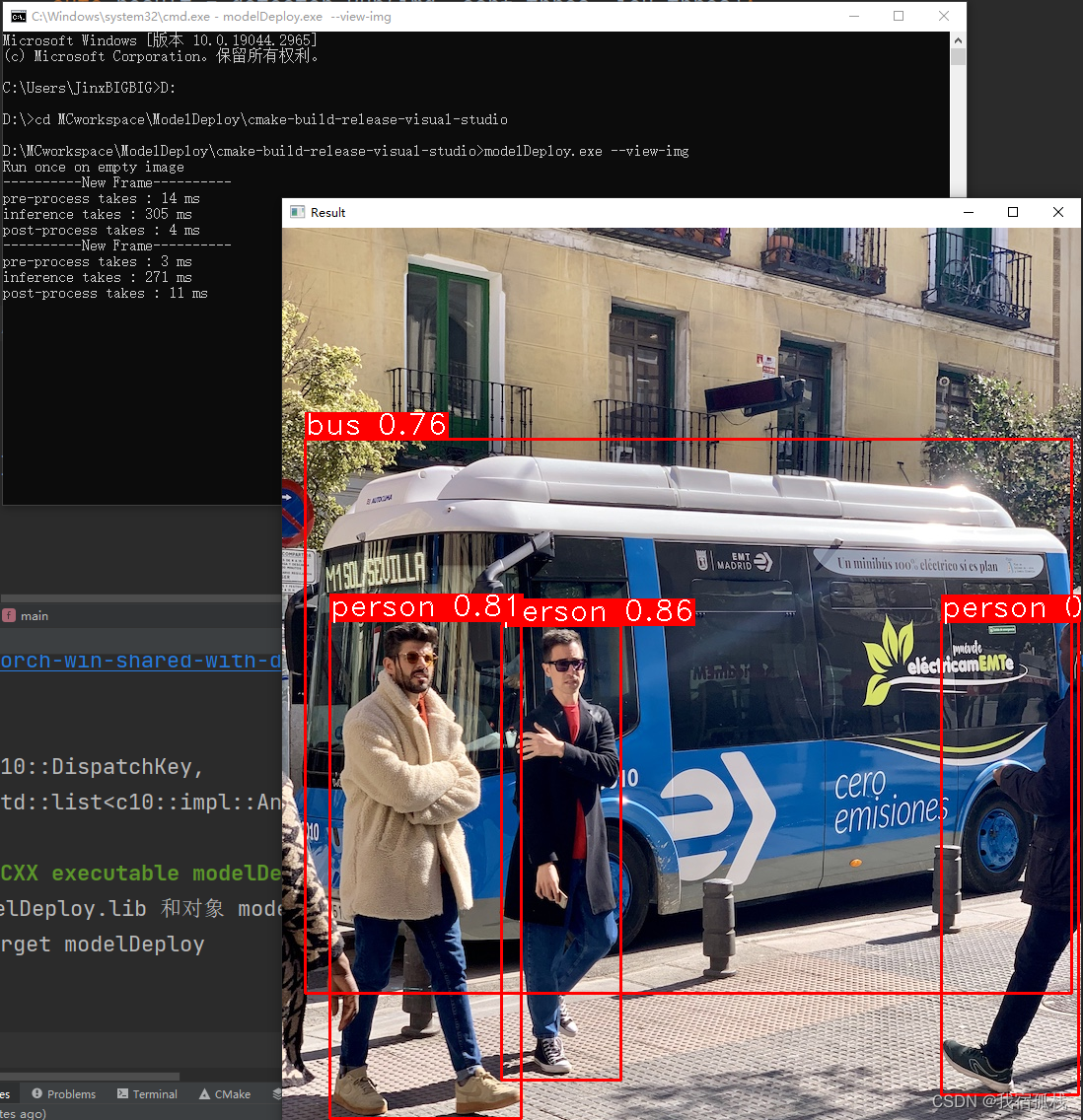

NPU(神经处理单元)算力盒子是一种专门用于进行人工智能计算的硬件设备,其中集成了高性能的NPU芯片。NPU是一种针对深度学习任务进行优化的处理器,具备高度并行计算和低功耗的特性,能够快速高效地执行神经网络模型的推理和训练任务。

算力指的是计算设备能够执行的计算操作数量,通常以浮点运算(FLOPs)为单位来衡量。在人工智能领域,算力的大小通常与模型的训练和推理速度相关。较大的算力意味着设备能够更快地完成计算任务,加速模型的训练和推理过程。

算力盒子有小到2TOPS算力盒子。

例如:IVP06A算力盒子基于 RV1126 设计的一款支持深度智能边缘计算的终端设备。基于四核 ARM Cortex-A7@1.5GHz & RISC-V 架构,内置独立的 NPU,提供 2.0TOPS 算力,支持 INT8/INT16 混合操作。

内置独立 NPU,提供 2.0TOPs@INT8/INT16 算力,单独执行 AI 运算,效率更高,功耗更低,完全满足轻量场景的应用。

支持 TensorFlow/MXNet/PyTorch/Caffe 等一系列深度学习框架。

也有高达32TOPS的算力盒子。

例如:DEP02A算力盒子基于 RK3568 设计的一款高性能、低功耗的边缘计算盒子,内置1.0TOPS 的 RKNN,拥有 GPU Mail-G52 22E,内嵌高性能 2D 加速硬件,图形处理能力优秀;支持 4k@60fps HDMI 图像输出,可视化界面开发;

可扩展 1~2 个 AI 加速模组,最高可扩展算力 32TOPS@INT8 。

支持 TensorFlow、Caffe、Pytorch 等主流深度框架,支持目标检测、跟踪、识别等网络模型。

那算力盒子要怎么选呢?算力是越大越好吗?

二、算力是越大越好吗

算力并非越大越好是绝对的。选择适合的算力取决于具体的应用场景和需求。对于一些轻量级的任务或者较小规模的模型,较低的算力可能已经足够。而对于更复杂的任务、大规模的模型或者实时性要求较高的场景,较大的算力则可以提供更快的计算速度和更高的效率。

此外,除了算力大小,还有其他因素也需要考虑,例如功耗、散热、价格等。因此,在选择NPU算力盒子时,需要综合考虑各种因素,并根据具体需求来确定最适合的算力水平。