Py之onnx:onnx/onnxruntime库的简介、安装、使用方法之详细攻略

目录

onnx/onnxruntime库的简介

onnx/onnxruntime库的安装

onnx/onnxruntime库的使用方法

1、基础用法

onnx/onnxruntime库的简介

Open Neural Network Exchange(ONNX)是一个开放的生态系统,赋予AI开发者选择正确工具的能力,以满足项目的不断发展。ONNX为AI模型提供了开源格式,涵盖深度学习和传统ML。它定义了一个可扩展的计算图模型,以及内置运算符和标准数据类型的定义。目前,我们专注于推理(评分)所需的功能。

ONNX被广泛支持,并可在许多框架、工具和硬件中找到。在不同框架之间实现互操作性并简化从研究到生产的路径,有助于增加AI社区的创新速度。我们邀请社区加入我们,并进一步发展ONNX。

GitHub地址:GitHub - onnx/onnx: Open standard for machine learning interoperability

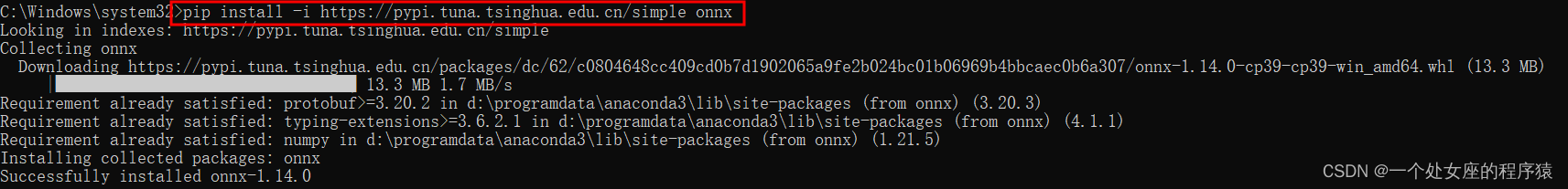

onnx/onnxruntime库的安装

pip install onnx

pip install -i https://pypi.tuna.tsinghua.edu.cn/simple onnx

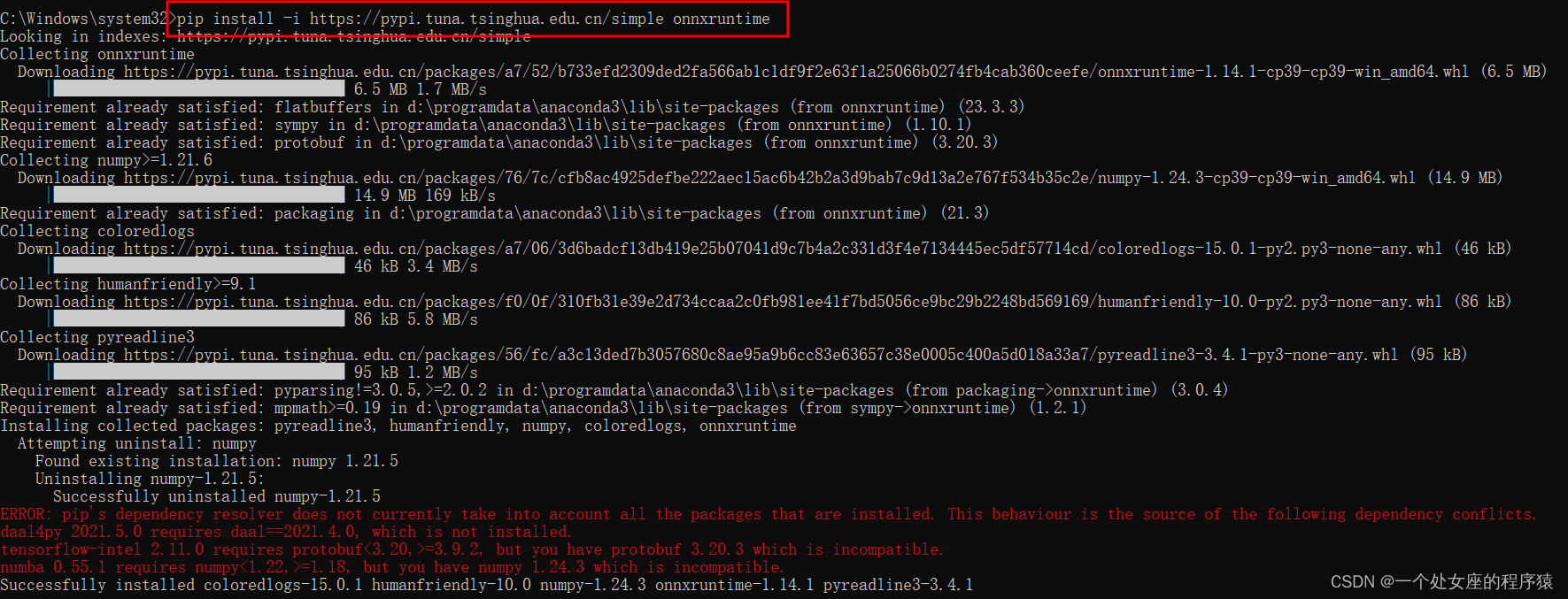

pip install -i https://pypi.tuna.tsinghua.edu.cn/simple onnxruntime

onnx/onnxruntime库的使用方法

1、基础用法

import onnx

import onnxruntime as ort

# 加载ONNX模型

model = onnx.load("model.onnx")

# 打印模型信息

print(onnx.helper.printable_graph(model.graph))

# 创建ONNX运行时

ort_session = ort.InferenceSession("model.onnx")

# 准备输入数据

input_data = np.random.rand(1, 3, 224, 224).astype(np.float32)

# 推理

ort_inputs = {ort_session.get_inputs()[0].name: input_data}

ort_outputs = ort_session.run(None, ort_inputs)

# 输出结果

print(ort_outputs)