1. Polarized Self-Attention

论文:https://export.arxiv.org/pdf/2107.00782.pdf

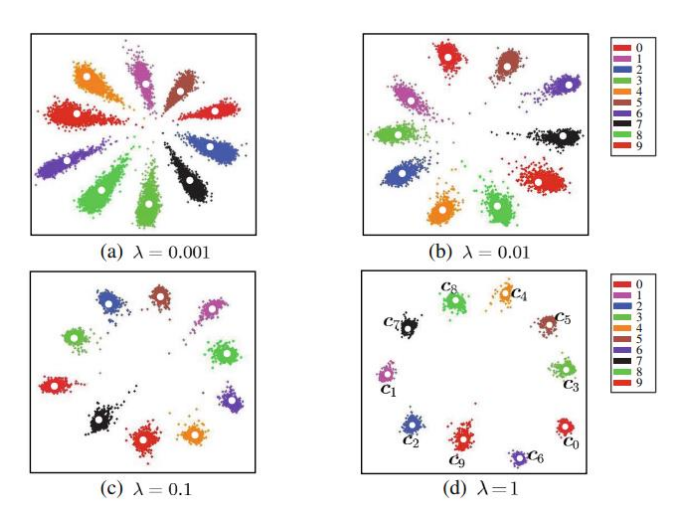

Polarized self-attention是一种改进的自注意力机制,旨在提高自注意力模型的效率和准确性。传统的自注意力机制通常需要计算所有位置对所有位置的注意力,这会导致计算复杂度的增加和模型的训练时间的延长。Polarized self-attention通过引入极化因子来减少需要计算的位置对之间的注意力,从而提高自注意力模型的效率。极化因子是一个向量,可以将其与每个位置的向量点积,以确定哪些位置需要进行注意力计算。这种方法可以通过在保持准确度的同时减少计算量来提高自注意力模型的效率。