目录

一、前言与数据集

二、划分数据集以及配置文件的修改

1.把图片和.txt标注文件放入对应VOCData文件夹下

2..txt文件转为.xml文件

3.在VOCData目录下创建程序 split_train_val.py 并运行

4.将xml格式转为yolo_txt格式

5.设置测试文件

6.配置文件

三、聚类获得先验框

1.生成anchors文件

2.修改模型配置文件

四、模型训练

1.开始训练

2.训练过程

五、测试文件

1.调用val.py测试

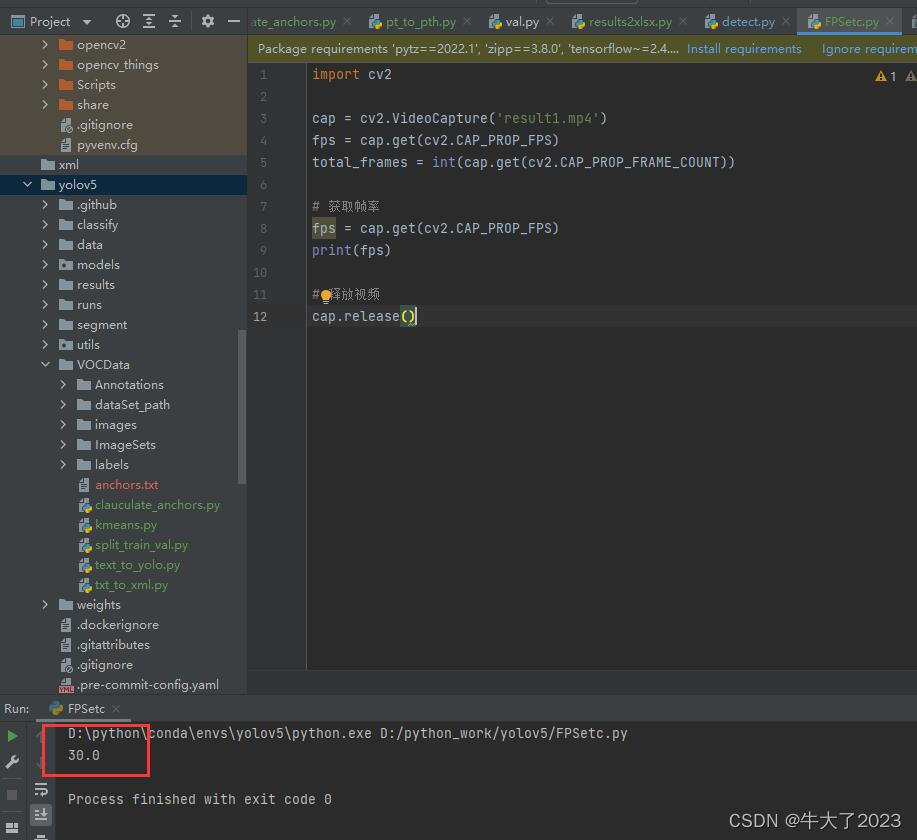

2.测试视频帧率

六、其他

1.权重文件.pt转.pth

2.文件格式.xml转.json

一、前言与数据集

我的这篇教程获得了许多朋友的支持,在这里非常感谢大家,今天再发一篇微微拔高的文章

小白YOLOv5全流程-训练+实现数字识别_在yolov5的根目录下创建一个脚本,创建一个split_train_val.py文件_牛大了2023的博客-CSDN博客

上面这篇文章是教大家从无到有如何diy一个权重模型用于目标检测,对水项目的本科生而言(比如我),大头时间都花在找数据集和标注数据集上了。

许多朋友问过我数据集在哪找,这篇教程是我的想法,但许多也都是图片集,缺少标注文件。目标检测YOLOv5数据集怎么找?_牛大了2023的博客-CSDN博客

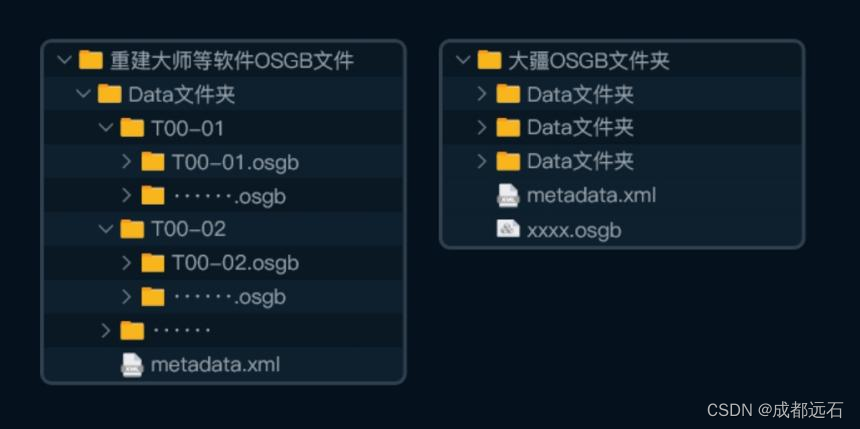

但有一些比赛和开源项目会提供图片+标注数据集供参赛选手,比如这个小比赛提供了现成的数据集,附上说明图片

训练集:28773 幅结直肠息肉内镜图像(原始图像、标签和 Readme 文件)。网盘链接如下:链接: https://pan.baidu.com/s/1n08y04DokW5LyF0t7tMIog提取码: tmkn

最后教大家调用val.py进行测试并得到相关数据。

二、划分数据集以及配置文件的修改

整体结构仍如这篇文档,小白YOLOv5全流程-训练+实现数字识别_在yolov5的根目录下创建一个脚本,创建一个split_train_val.py文件_牛大了2023的博客-CSDN博客

1.把图片和.txt标注文件放入对应VOCData文件夹下

2..txt文件转为.xml文件

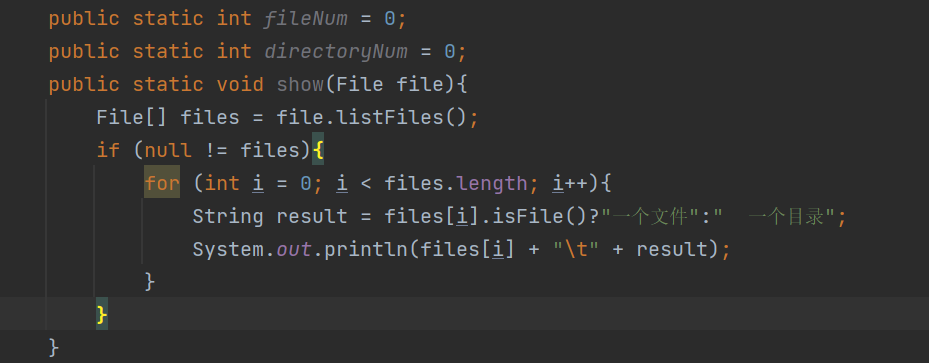

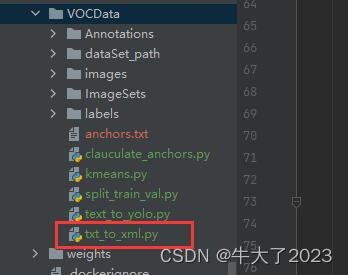

在VOCData文件夹下创建txt_to_xml.py文件,复制粘贴下面代码,注意路径和类别要修改

import os

import xml.etree.ElementTree as ET

from PIL import Image

import numpy as np

# 图片文件夹,后面的/不能省

img_path = 'D:/python_work/yolov5/VOCData/images/'

# txt文件夹,后面的/不能省

labels_path = 'D:/python_work/yolov5/VOCData/labels/'

# xml存放的文件夹,后面的/不能省

annotations_path = 'D:/python_work/yolov5/VOCData/Annotations/'

labels = os.listdir(labels_path)

# 类别

classes = ["GHP","APC"] #类别名

# 图片的高度、宽度、深度

sh = sw = sd = 0

def write_xml(imgname, sw, sh, sd, filepath, labeldicts):

'''

imgname: 没有扩展名的图片名称

'''

# 创建Annotation根节点

root = ET.Element('Annotation')

# 创建filename子节点,无扩展名

ET.SubElement(root, 'filename').text = str(imgname)

# 创建size子节点

sizes = ET.SubElement(root,'size')

ET.SubElement(sizes, 'width').text = str(sw)

ET.SubElement(sizes, 'height').text = str(sh)

ET.SubElement(sizes, 'depth').text = str(sd)

for labeldict in labeldicts:

objects = ET.SubElement(root, 'object')

ET.SubElement(objects, 'name').text = labeldict['name']

ET.SubElement(objects, 'pose').text = 'Unspecified'

ET.SubElement(objects, 'truncated').text = '0'

ET.SubElement(objects, 'difficult').text = '0'

bndbox = ET.SubElement(objects,'bndbox')

ET.SubElement(bndbox, 'xmin').text = str(int(labeldict['xmin']))

ET.SubElement(bndbox, 'ymin').text = str(int(labeldict['ymin']))

ET.SubElement(bndbox, 'xmax').text = str(int(labeldict['xmax']))

ET.SubElement(bndbox, 'ymax').text = str(int(labeldict['ymax']))

tree = ET.ElementTree(root)

tree.write(filepath, encoding='utf-8')

for label in labels:

with open(labels_path + label, 'r') as f:

img_id = os.path.splitext(label)[0]

contents = f.readlines()

labeldicts = []

for content in contents:

# !!!这里要看你的图片格式了,我这里是png,注意修改

img = np.array(Image.open(img_path + label.strip('.txt') + '.jpg'))

# 图片的高度和宽度

sh, sw, sd = img.shape[0], img.shape[1], img.shape[2]

content = content.strip('\n').split()

x = float(content[1])*sw

y = float(content[2])*sh

w = float(content[3])*sw

h = float(content[4])*sh

# 坐标的转换,x_center y_center width height -> xmin ymin xmax ymax

new_dict = {'name': classes[int(content[0])],

'difficult': '0',

'xmin': x+1-w/2,

'ymin': y+1-h/2,

'xmax': x+1+w/2,

'ymax': y+1+h/2

}

labeldicts.append(new_dict)

write_xml(img_id, sw, sh, sd, annotations_path + label.strip('.txt') + '.xml', labeldicts)

#[转载链接](https://zhuanlan.zhihu.com/p/383660741)生成的.xml文件会存在VOCData\Annotations文件夹下

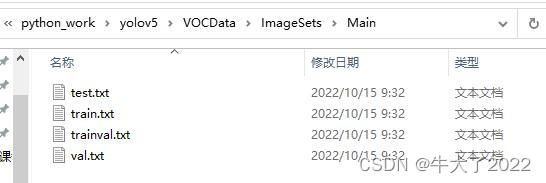

3.在VOCData目录下创建程序 split_train_val.py 并运行

不用修改

# coding:utf-8

import os

import random

import argparse

parser = argparse.ArgumentParser()

#xml文件的地址,根据自己的数据进行修改 xml一般存放在Annotations下

parser.add_argument('--xml_path', default='Annotations', type=str, help='input xml label path')

#数据集的划分,地址选择自己数据下的ImageSets/Main

parser.add_argument('--txt_path', default='ImageSets/Main', type=str, help='output txt label path')

opt = parser.parse_args()

trainval_percent = 1.0 # 训练集和验证集所占比例。 这里没有划分测试集

train_percent = 0.9 # 训练集所占比例,可自己进行调整

xmlfilepath = opt.xml_path

txtsavepath = opt.txt_path

total_xml = os.listdir(xmlfilepath)

if not os.path.exists(txtsavepath):

os.makedirs(txtsavepath)

num = len(total_xml)

list_index = range(num)

tv = int(num * trainval_percent)

tr = int(tv * train_percent)

trainval = random.sample(list_index, tv)

train = random.sample(trainval, tr)

file_trainval = open(txtsavepath + '/trainval.txt', 'w')

file_test = open(txtsavepath + '/test.txt', 'w')

file_train = open(txtsavepath + '/train.txt', 'w')

file_val = open(txtsavepath + '/val.txt', 'w')

for i in list_index:

name = total_xml[i][:-4] + '\n'

if i in trainval:

file_trainval.write(name)

if i in train:

file_train.write(name)

else:

file_val.write(name)

else:

file_test.write(name)

file_trainval.close()

file_train.close()

file_val.close()

file_test.close()运行完后会在VOCData\ImagesSets\Main下生成 测试集、训练集、训练验证集和验证集

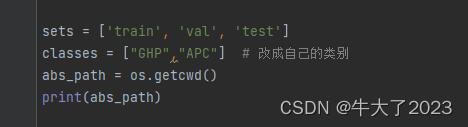

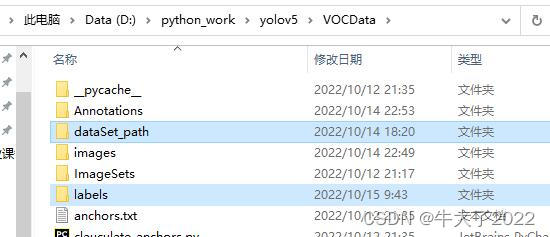

4.将xml格式转为yolo_txt格式

在VOCData目录下创建程序 text_to_yolo.py 并运行

开头classes部分改成自己的类别

之后路径也要改成自己的,注意倒数第三行后缀是.png还是.jpg

# -*- coding: utf-8 -*-

import xml.etree.ElementTree as ET

import os

from os import getcwd

sets = ['train', 'val', 'test']

classes = ["GHP","APC"] # 改成自己的类别

abs_path = os.getcwd()

print(abs_path)

def convert(size, box):

dw = 1. / (size[0])

dh = 1. / (size[1])

x = (box[0] + box[1]) / 2.0 - 1

y = (box[2] + box[3]) / 2.0 - 1

w = box[1] - box[0]

h = box[3] - box[2]

x = x * dw

w = w * dw

y = y * dh

h = h * dh

return x, y, w, h

def convert_annotation(image_id):

in_file = open('D:/python_work/yolov5/VOCData/Annotations/%s.xml' % (image_id), encoding='UTF-8')

out_file = open('D:/python_work/yolov5/VOCData/labels/%s.txt' % (image_id), 'w')

tree = ET.parse(in_file)

root = tree.getroot()

size = root.find('size')

w = int(size.find('width').text)

h = int(size.find('height').text)

for obj in root.iter('object'):

difficult = obj.find('difficult').text

# difficult = obj.find('Difficult').text

cls = obj.find('name').text

if cls not in classes or int(difficult) == 1:

continue

cls_id = classes.index(cls)

xmlbox = obj.find('bndbox')

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text),

float(xmlbox.find('ymax').text))

b1, b2, b3, b4 = b

# 标注越界修正

if b2 > w:

b2 = w

if b4 > h:

b4 = h

b = (b1, b2, b3, b4)

bb = convert((w, h), b)

out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n')

wd = getcwd()

for image_set in sets:

if not os.path.exists('D:/python_work/yolov5/VOCData/labels/'):

os.makedirs('D:/python_work/yolov5/VOCData/labels/')

image_ids = open('D:/python_work/yolov5/VOCData/ImageSets/Main/%s.txt' % (image_set)).read().strip().split()

if not os.path.exists('D:/python_work/yolov5/VOCData/dataSet_path/'):

os.makedirs('D:/python_work/yolov5/VOCData/dataSet_path/')

list_file = open('dataSet_path/%s.txt' % (image_set), 'w')

for image_id in image_ids:

list_file.write('D:/python_work/yolov5/VOCData/images/%s.jpg\n' % (image_id))

convert_annotation(image_id)

list_file.close()

其中 labels 中为不同图像的标注文件。每个图像对应一个txt文件,文件每一行为一个目标的信息,包括class, x_center, y_center, width, height格式,这种即为 yolo_txt格式。

dataSet_path文件夹包含三个数据集的txt文件,train.txt等txt文件为划分后图像所在位置的绝对路径,如train.txt就含有所有训练集图像的绝对路径。

5.设置测试文件

这里我没单独找测试集(懒),直接从train.txt中找了100行放在了test.txt中,作为测试文件

6.配置文件

在 yolov5 目录下的 data 文件夹下 新建一个 myvoc.yaml文件(可以自定义命名),用记事本打开。

内容是:训练集、验证集和测试集(train.txt、val.txt和test.txt)的路径(可以改为相对路径)

以及 目标的类别数目和类别名称。

三、聚类获得先验框

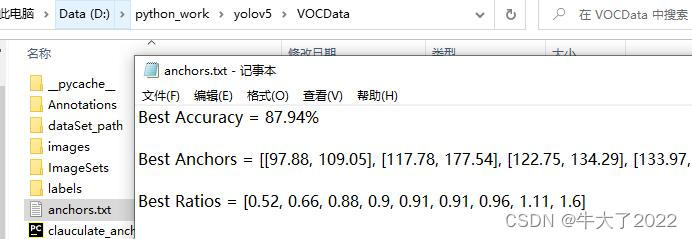

1.生成anchors文件

在VOCData目录下创建程序两个程序 kmeans.py 以及 clauculate_anchors.py

不需要运行 kmeans.py,运行 clauculate_anchors.py 即可。

kmeans.py 程序如下:这不需要运行,也不需要更改,报错则查看第十三行内容。

import numpy as np

def iou(box, clusters):

"""

Calculates the Intersection over Union (IoU) between a box and k clusters.

:param box: tuple or array, shifted to the origin (i. e. width and height)

:param clusters: numpy array of shape (k, 2) where k is the number of clusters

:return: numpy array of shape (k, 0) where k is the number of clusters

"""

x = np.minimum(clusters[:, 0], box[0])

y = np.minimum(clusters[:, 1], box[1])

if np.count_nonzero(x == 0) > 0 or np.count_nonzero(y == 0) > 0:

raise ValueError("Box has no area") # 如果报这个错,可以把这行改成pass即可

intersection = x * y

box_area = box[0] * box[1]

cluster_area = clusters[:, 0] * clusters[:, 1]

iou_ = intersection / (box_area + cluster_area - intersection)

return iou_

def avg_iou(boxes, clusters):

"""

Calculates the average Intersection over Union (IoU) between a numpy array of boxes and k clusters.

:param boxes: numpy array of shape (r, 2), where r is the number of rows

:param clusters: numpy array of shape (k, 2) where k is the number of clusters

:return: average IoU as a single float

"""

return np.mean([np.max(iou(boxes[i], clusters)) for i in range(boxes.shape[0])])

def translate_boxes(boxes):

"""

Translates all the boxes to the origin.

:param boxes: numpy array of shape (r, 4)

:return: numpy array of shape (r, 2)

"""

new_boxes = boxes.copy()

for row in range(new_boxes.shape[0]):

new_boxes[row][2] = np.abs(new_boxes[row][2] - new_boxes[row][0])

new_boxes[row][3] = np.abs(new_boxes[row][3] - new_boxes[row][1])

return np.delete(new_boxes, [0, 1], axis=1)

def kmeans(boxes, k, dist=np.median):

"""

Calculates k-means clustering with the Intersection over Union (IoU) metric.

:param boxes: numpy array of shape (r, 2), where r is the number of rows

:param k: number of clusters

:param dist: distance function

:return: numpy array of shape (k, 2)

"""

rows = boxes.shape[0]

distances = np.empty((rows, k))

last_clusters = np.zeros((rows,))

np.random.seed()

# the Forgy method will fail if the whole array contains the same rows

clusters = boxes[np.random.choice(rows, k, replace=False)]

while True:

for row in range(rows):

distances[row] = 1 - iou(boxes[row], clusters)

nearest_clusters = np.argmin(distances, axis=1)

if (last_clusters == nearest_clusters).all():

break

for cluster in range(k):

clusters[cluster] = dist(boxes[nearest_clusters == cluster], axis=0)

last_clusters = nearest_clusters

return clusters

if __name__ == '__main__':

a = np.array([[1, 2, 3, 4], [5, 7, 6, 8]])

print(translate_boxes(a))运行:clauculate_anchors.py

会调用 kmeans.py 聚类生成新anchors的文件

程序如下:

需要更改第 9 、13行文件路径 以及 第 16 行标注类别名称

# -*- coding: utf-8 -*-

# 根据标签文件求先验框

import os

import numpy as np

import xml.etree.cElementTree as et

from kmeans import kmeans, avg_iou

FILE_ROOT = "D:/python_work/yolov5/VOCData/" # 根路径

ANNOTATION_ROOT = "Annotations" # 数据集标签文件夹路径

ANNOTATION_PATH = FILE_ROOT + ANNOTATION_ROOT

ANCHORS_TXT_PATH = "D:/python_work/yolov5/VOCData/anchors.txt" # anchors文件保存位置

CLUSTERS = 9

CLASS_NAMES = ['GHP','APC'] # 类别名称

def load_data(anno_dir, class_names):

xml_names = os.listdir(anno_dir)

boxes = []

for xml_name in xml_names:

xml_pth = os.path.join(anno_dir, xml_name)

tree = et.parse(xml_pth)

width = float(tree.findtext("./size/width"))

height = float(tree.findtext("./size/height"))

for obj in tree.findall("./object"):

cls_name = obj.findtext("name")

if cls_name in class_names:

xmin = float(obj.findtext("bndbox/xmin")) / width

ymin = float(obj.findtext("bndbox/ymin")) / height

xmax = float(obj.findtext("bndbox/xmax")) / width

ymax = float(obj.findtext("bndbox/ymax")) / height

box = [xmax - xmin, ymax - ymin]

boxes.append(box)

else:

continue

return np.array(boxes)

if __name__ == '__main__':

anchors_txt = open(ANCHORS_TXT_PATH, "w")

train_boxes = load_data(ANNOTATION_PATH, CLASS_NAMES)

count = 1

best_accuracy = 0

best_anchors = []

best_ratios = []

for i in range(10): ##### 可以修改,不要太大,否则时间很长

anchors_tmp = []

clusters = kmeans(train_boxes, k=CLUSTERS)

idx = clusters[:, 0].argsort()

clusters = clusters[idx]

# print(clusters)

for j in range(CLUSTERS):

anchor = [round(clusters[j][0] * 640, 2), round(clusters[j][1] * 640, 2)]

anchors_tmp.append(anchor)

print(f"Anchors:{anchor}")

temp_accuracy = avg_iou(train_boxes, clusters) * 100

print("Train_Accuracy:{:.2f}%".format(temp_accuracy))

ratios = np.around(clusters[:, 0] / clusters[:, 1], decimals=2).tolist()

ratios.sort()

print("Ratios:{}".format(ratios))

print(20 * "*" + " {} ".format(count) + 20 * "*")

count += 1

if temp_accuracy > best_accuracy:

best_accuracy = temp_accuracy

best_anchors = anchors_tmp

best_ratios = ratios

anchors_txt.write("Best Accuracy = " + str(round(best_accuracy, 2)) + '%' + "\r\n")

anchors_txt.write("Best Anchors = " + str(best_anchors) + "\r\n")

anchors_txt.write("Best Ratios = " + str(best_ratios))

anchors_txt.close()运行生成anchors文件。如果生成文件为空,重新运行即可。

第二行 Best Anchors 后面需要用到。(这就是手动获取到的anchors的值)

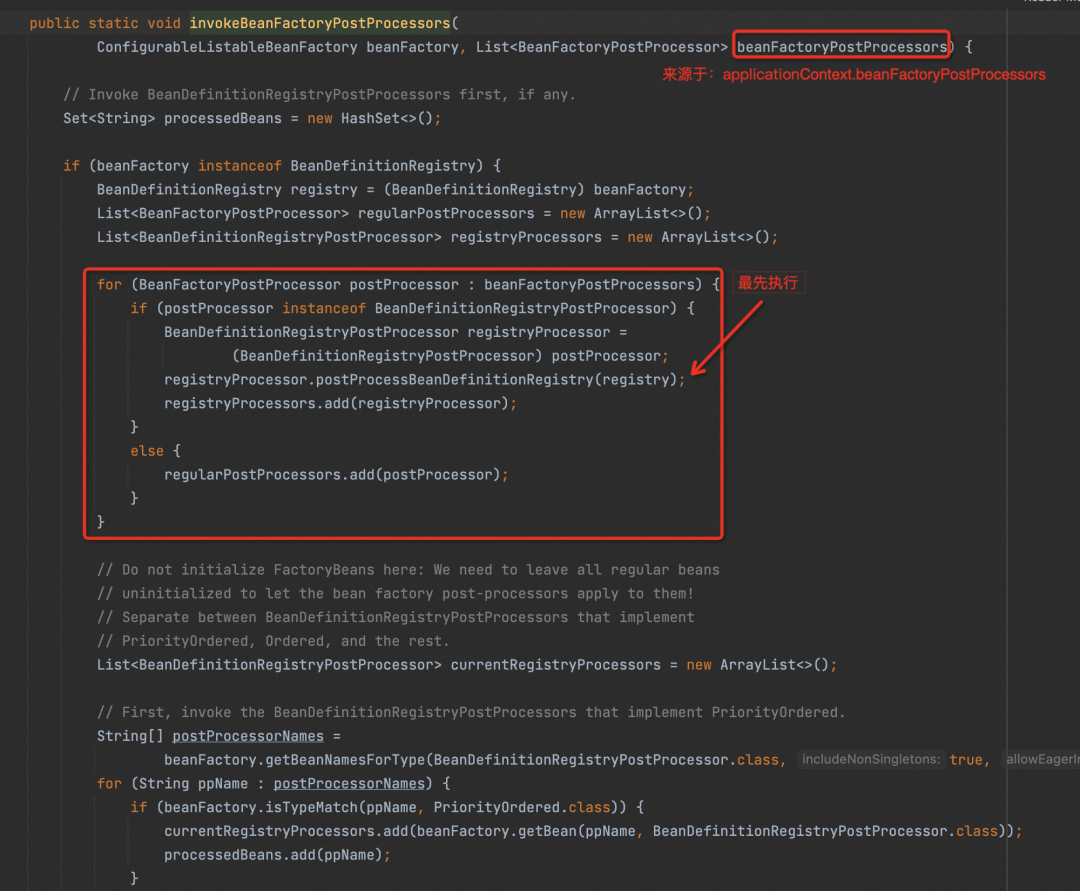

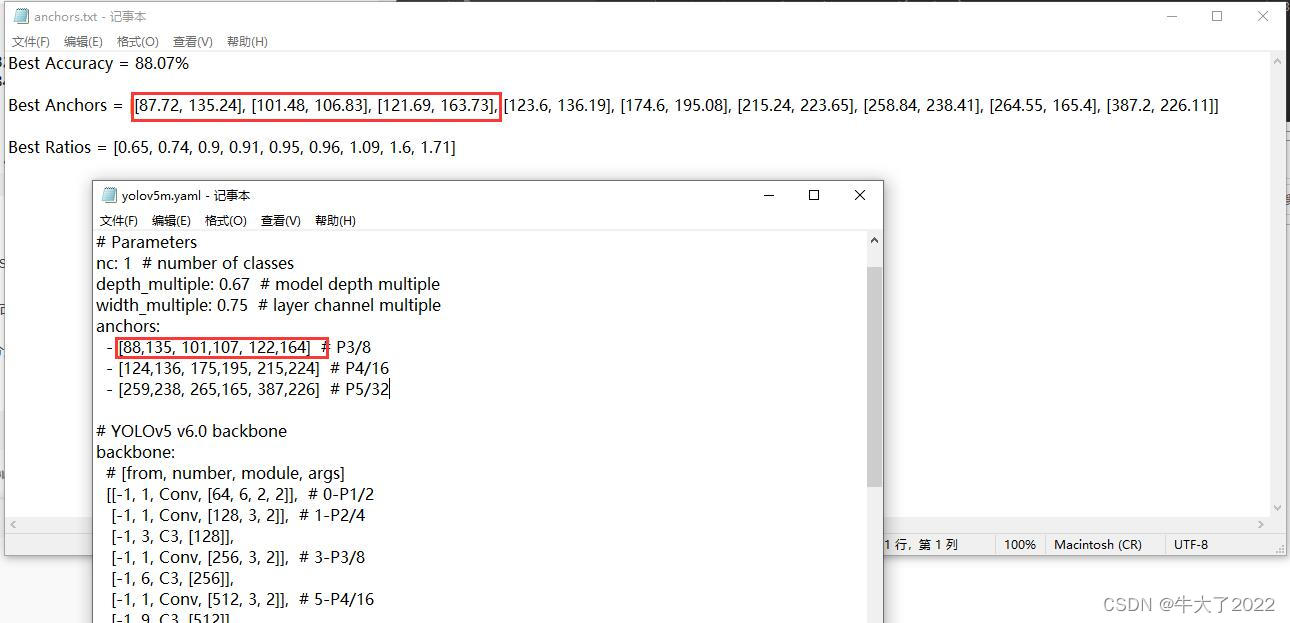

2.修改模型配置文件

选择一个模型,在yolov5目录下的model文件夹下是模型的配置文件,有n、s、m、l、x版本,逐渐增大(随着架构的增大,训练时间也是逐渐增大)。

这里选用 yolov5s.yaml 用记事本打开

主要改两个参数:

把 nc:后面改成自己的标注类别数(图里还没改,而且图里错打开yolov5m了...)

修改anchors,根据 anchors.txt 中的 Best Anchors 修改,需要取整(四舍五入、向上、向下都可以)。

保持yaml中的anchors格式不变,按顺序一对一即可,如我框出的六个和anchors的第一行6个(18个都要改)

四、模型训练

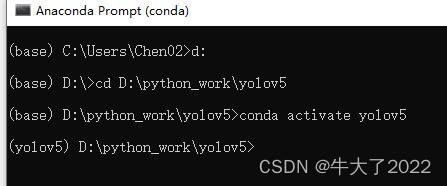

1.开始训练

打开anaconda终端,选到yolov5的文件下,并激活相应的环境(我起名是yolov5)

接着输入如下训练命令:(因为数据集近3w,我的小显卡跑冒烟了也跑不完,为了演示训练二十来轮意思意思,正常训练至少五十轮以上)

python train.py --weights weights/yolov5s.pt --cfg models/yolov5s.yaml --data data/myvoc.yaml --epoch 22 --batch-size 8 --img 640 --device 0

参数解释:

–weights weights/yolov5s.pt :这个也许你需要更改路径。我是将yolov5的pt文件都放在weights目录下,你可能没有,需要更改路径。

–epoch 22 :训练22轮

–batch-size 8:训练8张图片后进行权重更新

–device cpu:使用CPU训练。//这里device 0为gpu训练

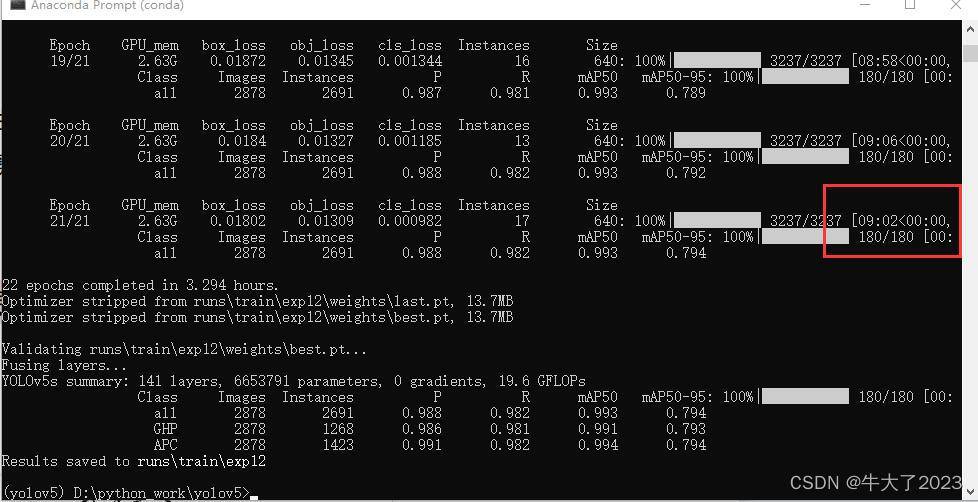

2.训练过程

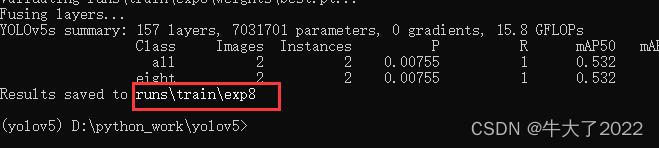

22轮花了3个多小时…

训练好的模型会被保存在 yolov5 目录下的 runs/train/weights/expxx下。

五、测试文件

不同于以往的找图片、找视频看效果,这次调用测试集,并返回相关数据

1.调用val.py测试

还在anaconda的控制台输入

(yolov5) D:\python_work\yolov5>python val.py --weights runs/train/exp12/weights/best.pt --data data/myvoc.yaml --img-size 640 --iou-thres 0.5 --conf-thres 0.4 --batch-size 8 --task test

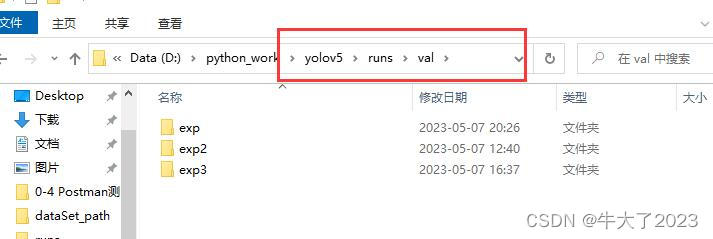

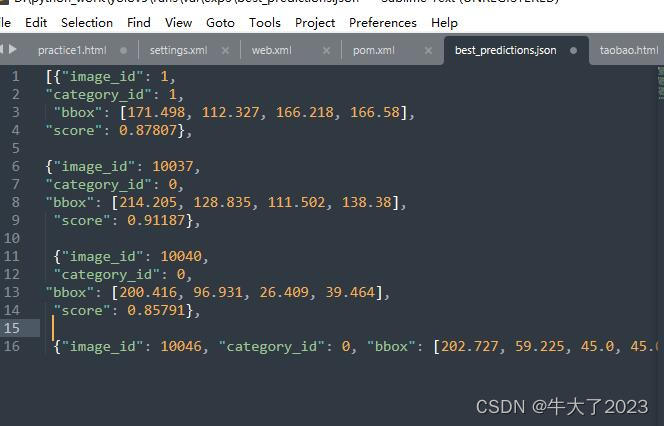

测试文件会在如下路径生成

会生成这些数据,预测的json数据、F1、P、PR、R等

2.测试视频帧率

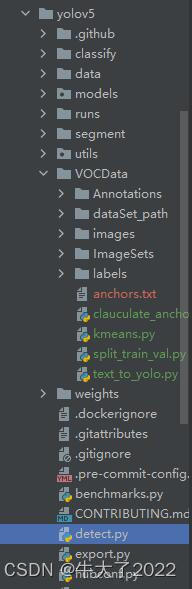

yolov5主目录下找到detect.py文件,打开该文件。

主要是weights和source处修改:(218行左右)测试视频,测试结果会在yolov5\runs\detect\exp…下

parser.add_argument('--weights', nargs='+', type=str, default='runs/train/exp12/weights/best.pt', help='model.pt path(s)')

parser.add_argument('--source', type=str, default='sytest1.mp4', help='source') #file/dir/URL/glob/screen/0(webcam)

最后用下面的函数查看帧率(不过我感觉这个方法不严谨,恳请大牛指正)

import cv2

cap = cv2.VideoCapture('result1.mp4')

fps = cap.get(cv2.CAP_PROP_FPS)

total_frames = int(cap.get(cv2.CAP_PROP_FRAME_COUNT))

# 获取帧率

fps = cap.get(cv2.CAP_PROP_FPS)

print(fps)

# 释放视频

cap.release()

六、其他

1.权重文件.pt转.pth

import torch

# 将pt文件转换为pth文件

pt_file_path = 'D:/python_work/yolov5/runs/train/exp12/weights/last.pt'

pth_file_path = 'D:/python_work/yolov5/runs/train/exp12/weights/last.pth'

model_weights = torch.load(pt_file_path)

torch.save(model_weights, pth_file_path)2.文件格式.xml转.json

import os

import json

import xml.etree.ElementTree as ET

# 指定包含所有.xml文件的文件夹路径

xml_folder = "data/test/labels"

# 定义解析XML文件的函数

def parse_xml(xml_path):

tree = ET.parse(xml_path)

root = tree.getroot()

# 从XML文件中获取需要的信息,存储在字典中

filename = root.find("filename").text

width = int(root.find("size/width").text)

height = int(root.find("size/height").text)

object_list = []

for obj in root.findall("object"):

name = obj.find("name").text

xmin = int(obj.find("bndbox/xmin").text)

ymin = int(obj.find("bndbox/ymin").text)

xmax = int(obj.find("bndbox/xmax").text)

ymax = int(obj.find("bndbox/ymax").text)

obj_dict = {

"name": name,

"xmin": xmin,

"ymin": ymin,

"xmax": xmax,

"ymax": ymax

}

object_list.append(obj_dict)

# 返回字典

return {

"filename": filename,

"width": width,

"height": height,

"objects": object_list

}

# 解析所有.xml文件并将结果存储在列表中

annotation_list = []

for xml_file in os.listdir(xml_folder):

if xml_file.endswith(".xml"):

xml_path = os.path.join(xml_folder, xml_file)

annotation = parse_xml(xml_path)

annotation_list.append(annotation)

# 将列表写入.json文件中

json_path = "data/test/output.json"

with open(json_path, "w") as f:

json.dump(annotation_list, f)