摘要:

目前国内一般直接将高速NOA成为“L2+”;因此,复杂度更高的城区NOA,就自然的映射到了“L2++”。

一、概述:

特斯拉Autopilot系统首创了NOA这种淡化脱手/脱眼/脱脑(驾驶自动化程度)逻辑的功能,致力于与导航结合后,完成从A点到B点的全程进行辅助驾驶(L2,不脱手)的能力,功能实用性大大增加。

鉴于ICA、LCC这种功能也是L2,为了体现特斯拉NOA良好的高速和城区的变道、匝道汇入汇出、复杂场景通行能力,用“L2+”来形容特斯拉NOA的先进性,也是被行业接受的。但是这个L2+,并不是在脱手/脱眼/脱脑这个维度体现的。

补:一般L几与XXX-off的对应关系是

-

无L,没有智驾功能;

-

L0,无控制(只报警提醒、提示),Warning;

-

L1,单向控制(纵向,或横向),Single-direction control;

-

L2,横纵向控制,不脱手,Hands-on;【横纵向都具备后,就开始拼是否脱手/脱眼/脱脑了】

-

L2+,横纵向控制,脱手,Hands-off;

-

L3,横纵向控制,脱眼,Eyes-off;

-

L4,横纵向控制,脱脑,Minds-off;

-

L5,横纵向控制,无人,Driver-off;车辆不再为驾驶员提供底盘控制接口(如制动踏板、油门踏板、方向盘等人类直接控制车辆的装置);

另,国内也有不少厂商习惯用场景复杂度来定义功能。目前国内一般直接将高速NOA成为“L2+”;因此,复杂度更高的城区NOA,就自然的映射到了“L2++”。

二、系统介绍:

根据相关信息,对基于HW3.0的Autopilot系统方案统计如下:【注:特斯拉OTA很快,信息经常变,只能大致参考下】

| Item | Description | Comment |

|---|---|---|

| 功能:SAE驾驶自动化程度 | “L2++”级 | 高速、城区、停车场等多场景通行/变道能力很强 |

| 功能:驾驶自动化程度描述 | 不脱手 | EAP脱手间隔与车速相关; 车速在60-80kph时候,约45s-65s之间; 低速最长时间可达3分钟; |

| 功能:功能描述 | NOA | 基于导航的辅助驾驶 |

| 功能:车速区间 | 0-130kph; | 全速域 |

| 功能:电子围栏 | EAP:高速NOA; FSD:城区NOA;HW3.0的主要价值在于FSD功能 | 特斯拉能力的体现,主要在电子围栏指标上。场景泛化能力很强,功能开启后的通行能力也很强 |

| 功能:变道约束 | 支持变道 | 细分场景方面:汇入、汇出、匝道同行等 |

| 功能:路口通行 | 支持十字路口通行 | 高速和城区,最大的区别有两个:路口通行,以及VRU的处理。FSD的路口的通行能力很强;典型能力:无保护左转、高速车流的汇入 |

| 功能:DDT后援任务用户有效性 | 需要驾驶员随时接管 | |

| 功能:环境条件 | 不支持下雨下雪等恶劣天气; | 无车道线时,可利用路沿检测保证车辆正常行驶(而不退出); |

| 功能:前置条件 | ICA(或叫LCC)已开启; | 满足条件后,系统通过HMI提示用户可以开启NOA功能,用户确认后进入NOA功能 |

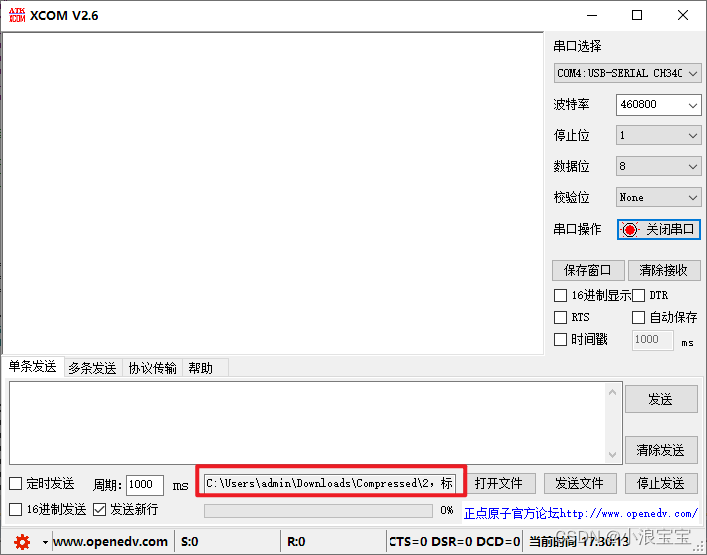

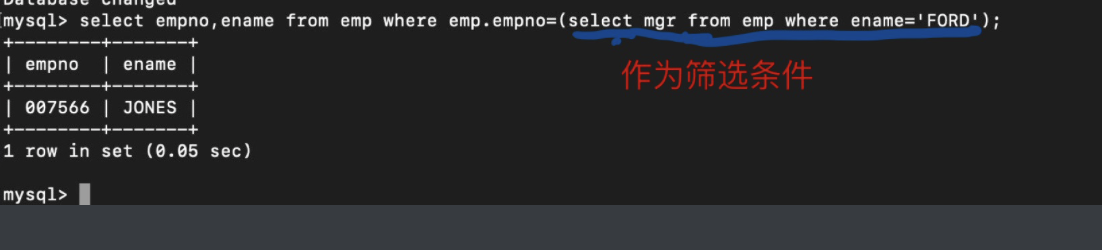

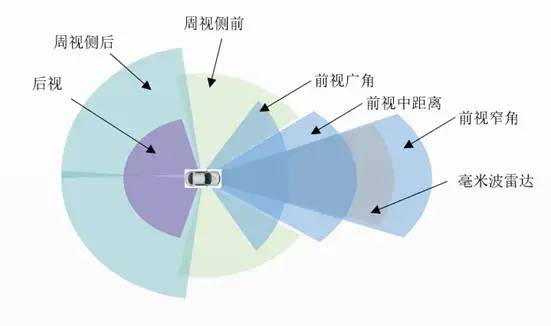

| 功能:感知系统(OEDR) | 8V | 传感器布置位置见图1所示 |

| 功能:接管(Takeover) | 需要驾驶员随时接管车辆; | |

| 功能:降级(Degradation) | 未知 | |

| 功能:MRM | 未知 | |

| 功能:HMI | a. 系统入口:方向盘按键; b. 状态提示:仪表(如果有)+中控屏提示 + 蜂鸣声+语音提醒; | |

| 功能:DSSAD | 未知 | |

| 功能:OTA | 支持 | |

| 功能:操作系统 | Safety Linux | |

| 功能:数据上传(及车端触发器) | 支持 | |

| 功能:其他 | ||

| 系统:系统类型 | 集中式系统 | 特斯拉为中央&区集中式EEA; 智驾系统ECU为HW3.0域控,集中式计算 |

| 系统:智能传感器种类与数量 | 无 | 集中式计算,无分布式智能传感器 |

| 系统:控制器个数与种类 | 集中式系统,AutoPilot ECU with HW3.0;使用自家FSD SOC; | |

| 系统:软件服务-RTK | 无 | |

| 系统:软件服务-数字地图 | 无 | 依赖SD map给route,剩下的全交给视觉系统 |

| 系统:软件服务-车联网服务(V2C) | 有,4G(LTE) | |

| 系统:软件服务-V2V&V2I服务 | 无 | |

| 系统:Fail Operational方案 | 无 | |

| 系统:Fail Operational-电源 | 无 | |

| 系统:Fail Operational-通信 | 无 | |

| 系统:Fail Operational-制动系统 | 无 | |

| 系统:Fail Operational-转向系统 | 无 | |

| 系统:Fail Operational-计算&感知 | SOC层面的部分冗余,非ECU层面 | 两个FSD SOC在某些功能&算法上,进行冗余; |

| 系统:其他 | ||

| 传感器:摄像头-前视主摄像头 | 有 | AR0136/AR0138-1.2MP-RCCB-HFOV52° |

| 传感器:摄像头-前视宽角摄像头 | 有 | AR0136/AR0138-1.2MP-RCCB-HFOV120° |

| 传感器:摄像头-前视窄角摄像头 | 有 | AR0136/AR0138-1.2MP-RCCB-HFOV28° |

| 传感器:摄像头-前视双目摄像头 | 无 | |

| 传感器:摄像头-侧前摄像头(x2) | 有 | AR0136/AR0138-1.2MP-RCCB-HFOV90° |

| 传感器:摄像头-侧后摄像头(x2) | 有 | AR0136/AR0138-1.2MP-RCCB-HFOV80° |

| 传感器:摄像头-后视摄像头 | 无 | |

| 传感器:摄像头-环视摄像头(x4) | 有,只有一个后鱼眼摄像头 | OV10635-1MP-RGGB-HFOV140° |

| 传感器:Radar-前向主雷达 | 有,后又取消 | 基于纯视觉。HW4.0预计会重新安装4D radar |

| 传感器:Radar-侧前角雷达(x2) | 无 | |

| 传感器:Radar-侧后角雷达(x2) | 无 | |

| 传感器:Radar-后向雷达 | 无 | |

| 传感器:Lidar-前向主Lidar | 无 | |

| 传感器:Lidar-侧前角Lidar(x2) | 无 | |

| 传感器:Lidar-侧向补盲Lidar(x2) | 无 | |

| 传感器:超声波传感器(x12) | 有,后续会取消 | 基于视觉的占用网络算法来替代 |

| 传感器:IMU | 有 | |

| 传感器:GNSS | 有 | |

| 传感器:地面湿度传感器 | 无 | |

| 传感器:DMS摄像头 | 有 | 安装位置较为少见,单颗camera应该可以兼顾DMS+OMS的作用; |

| 传感器:后风挡麦克风 | 无 | |

| 传感器:地面湿度传感器 | 无 | |

| 传感器:其他 | ||

| 主控制器:控制器描述 | HW3.0,双SOC + MCU方案 | |

| 主控制器:散热方式 | 液冷 | |

| 主控制器:功耗 | >72W | |

| 主控制器:MPU1子系统-MPU型号 | FSD chip | |

| 主控制器:MPU1子系统-MPU数量 | 2个 | |

| 主控制器:MPU1子系统-MPU内存规格 | LPDDR4 | |

| 主控制器:MPU1子系统-MPU内存容量 | 1GB | |

| 主控制器:MPU1子系统-MPU内存数量 | 8个,一个SOC接4个 | |

| 主控制器:MPU1子系统-MPU存储规格 | UFS | |

| 主控制器:MPU1子系统-MPU存储容量 | 32GB | |

| 主控制器:MPU1子系统-MPU存储数量 | 2个,一个SOC接一个 | |

| 主控制器:MPU2子系统-MPU型号 | 无 | |

| 主控制器:MPU2子系统-MPU数量 | 无 | |

| 主控制器:MPU2子系统-MPU内存规格 | 无 | |

| 主控制器:MPU2子系统-MPU内存容量 | 无 | |

| 主控制器:MPU2子系统-MPU内存数量 | 无 | |

| 主控制器:MPU2子系统-MPU存储规格 | 无 | |

| 主控制器:MPU2子系统-MPU存储容量 | 无 | |

| 主控制器:MPU2子系统-MPU存储数量 | 无 | |

| 主控制器:MCU子系统-MCU型号 | TC297 | |

| 主控制器:MCU子系统-Flash型号 | 未知 | |

| 主控制器:MCU子系统-Flash容量 | 300MB | |

| 主控制器:片间通信-PCIe Switch型号 | 无 | |

| 主控制器:片间通信-Ethernet Switch型号 | Marvell 88EA 6321 | |

| 主控制器:其他 | ||

| 冗余控制器 | 无 |

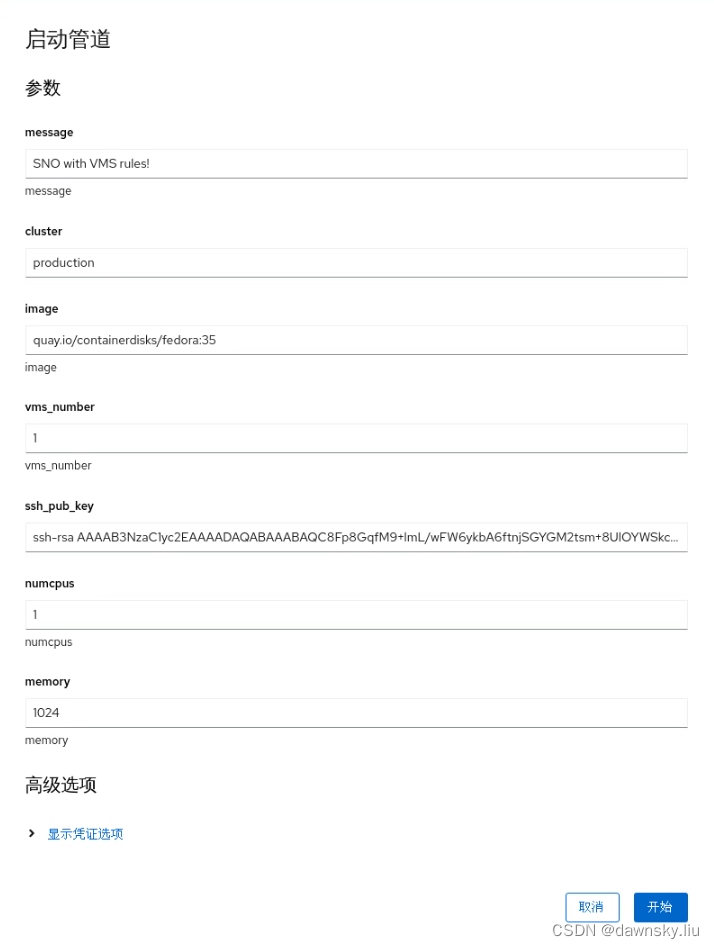

其中,针对上表中的图例,附在下方:

图1 传感器安装位置和FOV视角

三、部署车型和地区:

| Vehicle Type | Region | Geo-fencing | Comment |

| Model S/3/X/Y | 北美 | 城区;V11后统一了高速和城区道路,形成全场景FSD | 选装价格:15000美元; 或 订阅价格:199美元/月 |

四、总结:

按照上述维度评价Autopilot HW3.0不太适合。特斯拉主要是在算法上进展很快。从HW2.0/2.5升级到HW3.0以后,带来的FSD算法方案,应用了很多新AI技术,比如BEV多摄感知方案 + learning based 规控 + 4D标注等;目前又增加了占用网络技术,提升一般静态障碍物的检测能力。迭代速度很快。期待特斯拉在算法领域的持续创新。

另外,需要关注Camera-only系统的状态,是否能根据vision only系统迭代出L3级以上智驾系统。目前常见的说法,比如“人是靠视觉感知世界的,所以视觉系统理论上靠算法迭代也能做到自动驾驶”这类“朴素”的价值判断,并不太能让人信服。因为如果按照这种价值判断去“比喻”工程实践的话,人类就不需要仿生学了。具体地,飞机现在应该都是扇动翅膀的扑翼机,而不是固定翼飞机。因此,需要时刻关注算法创新的进展(这个才是能够证明可行的原因),以及特斯拉对其他传感器的增减尝试。但是,从整车层面看,如果vision only系统能够实现L3,那对智驾系统的推广,是极其有利的。

反过来看,基于4D radar或Lidar等主动性传感器为主的智驾系统(比如1V-5R-1L这种系统,可以保留前向视觉传感器),实现L2+和L3的可能性较小。奔驰的Drive Pilot系统的L3功能(TJP),目前是单车道场景,还可以handle,一旦涉及到频繁变道,比较担心基于Radar/Lidar等主动性传感器的能力(反过来说,也很期待以售卖4D Radar + Lidar部件的厂商,尽快能够推出基于Radar/Lidar为主传感器的高端智驾系统,来证明该技术路线的是可行的)。

来源 | 智能驾驶与人形机器人