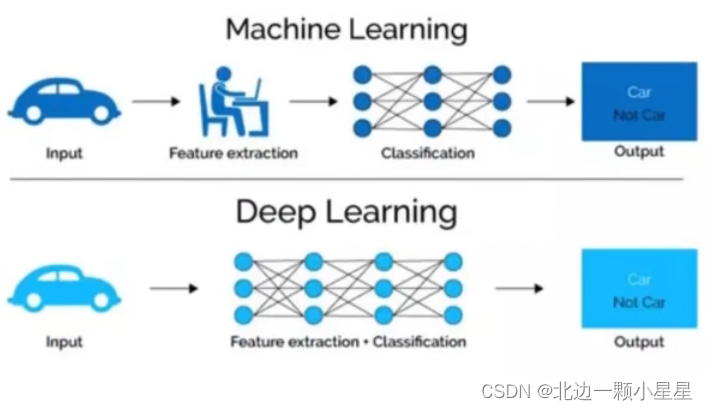

深度学习与机器学习的区别

深度学习由机器学习中的神经网络发展而来,机器学习多用于处理数值数据,而深度学习还可处理图片、音频等数据。

特征提取方面

- 机器学习的特征工程步骤需要靠手动完成,需要大量专业领域知识。

- 深度学习通常由多个层组成,它们通常将更简单的模型组合在一起,将数据从一层传递到另一层来构建更复杂的模型,通过训练大量数据自动得出模型而不用人工特征提取。

数据量和计算性能要求

机器学习需要的执行时间远少于深度学习,深度学习的参数往往很庞大,需要通过大量数据的多次优化来训练参数。

算法代表

- 机器学习

朴素贝叶斯、决策树等

- 深度学习

神经网络

神经网络

人工神经网络(Artificial Neural Network,简写为ANN)也简称为神经网络(NN)。它是一种模仿生物神经网络(动物的中枢神经系统,特别是大脑)结构和功能的计算模型。经典的神经网络结构包括三个层次的神经网络,分别为输入层、输出层以及隐藏层。

其中每层的圆圈代表一个神经元(以前也称之为感知机),隐藏层和输出层的神经元由输入的数据计算后输出,输入层的神经元只是输入。

神经网络的特点

- 每个链接都有权值

- 同一层神经元之间没有连接

- 最后的输出结果对应的层也称之为全连接层

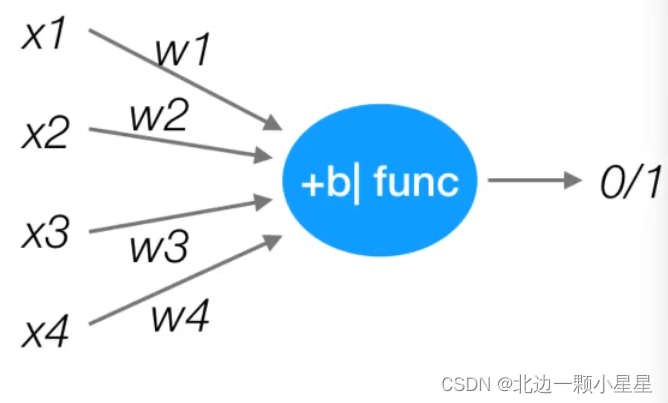

感知机(PLA:Perceptron Learning Algorithm)

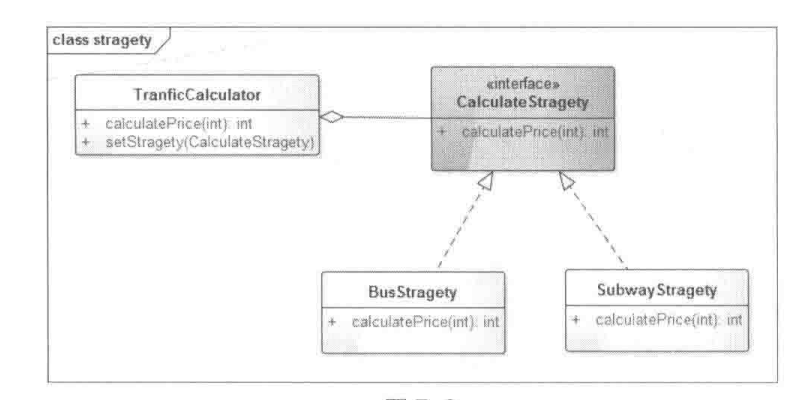

感知机就是模拟大脑神经网络处理数据的过程。

感知机是一种最基础的分类模型,类似于逻辑回归,不同的是,感知机的激活函数用的是sign,而逻辑回归用的是sigmoid。感知机也具有连接的权重和偏置。

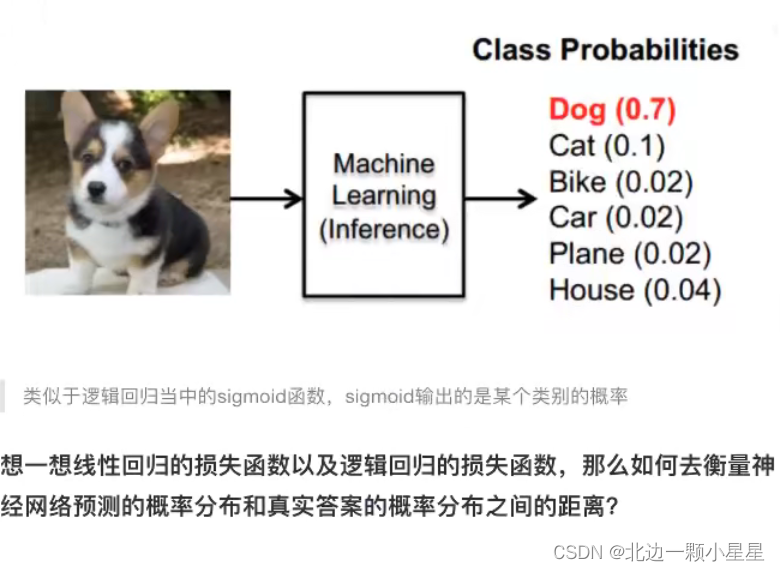

softmax回归

Softmax回归将神经网络输出转换成概率结果。

交叉熵损失

神经网络最后的损失为平均每个样本的损失大小。

卷积神经网络

传统意义上的多层神经网络只有输入层、隐藏层和输出层。其中隐藏层的层数根据需要而定,没有明确的理论推导来说明到底多少层合适。

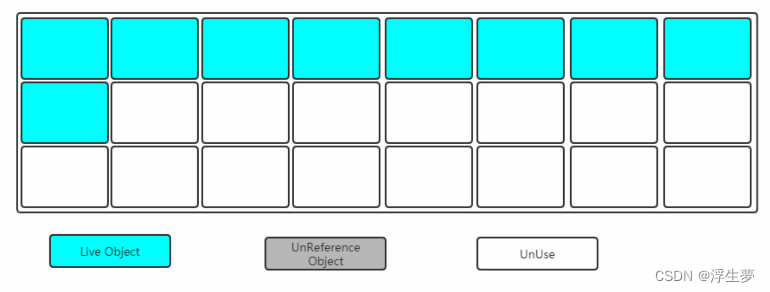

卷积神经网络CNN,在原来多层神经网络的基础上,加入了更加有效的特征学习部分,具体操作就是在原来的全连接层前面加入了卷积层和池化层。卷积神经网络的出现,使得神经网络层数得以加深,“深度”学习由此而来。

卷积神经网络的结构

神经网络的基本组成包括输入层、隐藏层和输出层,而卷积神经网络的特点在于隐藏层分为卷积层和池化层(pooling layer,又叫下采样层)以及激活层。

- 卷积层:通过在原始图像上平移来提取特征

- 激活层:增加非线性分割能力

- 池化层:减少学习的参数,降低网络的复杂度(最大池化和平均池化)

为了能够达到分类效果,还会有一个全连接层(Full Connection)也就是最后的输出层,进行损失计算并输出分类结果。