目录

- 1 ClickHouse 的安装

- 1.1 准备工作

- 1.1.1 确定防火墙处于关闭状态

- 1.1.2 CentOS 取消打开文件数限制

- 1.1.3 安装依赖

- 1.1.4 CentOS 取消 SELINUX

- 1.2 单机安装

- 1.2.1 在 hadoop102 的/opt/software 下创建 clickhouse 目录

- 1.2.2 将安装文件上传到 hadoop102 的software/clickhouse 目录下

- 1.2.3 将安装文件同步到 hadoop103、hadoop104

- 1.2.4 分别在三台机子上安装这 4 个 rpm 文件

- 1.2.5 修改配置文件

- 1.2.6 启动 Server

- 1.2.7 三台机器上关闭开机自启

- 1.2.8 使用 client 连接 server

- 2 副本

- 2.1 副本写入流程

- 2.2 配置步骤

- 3 分片集群

- 3.1 集群写入流程(3 分片 2 副本共 6 个节点)

- 3.2 集群读取流程(3 分片 2 副本共 6 个节点)

- 3.3 3 分片 2 副本共 6 个节点集群配置(供参考)

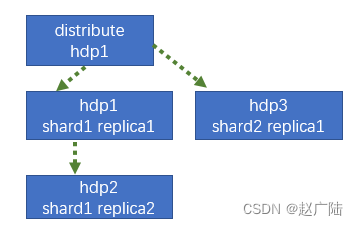

- 3.4 配置三节点版本集群及副本

- 3.4.1 集群及副本规划(2 个分片,只有第一个分片有副本)

- 3.4.2 配置步骤

1 ClickHouse 的安装

1.1 准备工作

1.1.1 确定防火墙处于关闭状态

1.1.2 CentOS 取消打开文件数限制

(1)在 hadoop102 的 /etc/security/limits.conf 文件的末尾加入以下内容

[careate@hadoop102 ~]$ sudo vim /etc/security/limits.conf

* soft nofile 65536

* hard nofile 65536

* soft nproc 131072

* hard nproc 131072

(3)执行同步操作

[careate@hadoop102 ~]$ sudo /home/careate/bin/xsync /etc/security/limits.conf

[careate@hadoop102 ~]$ sudo /home/careate/bin/xsync

/etc/security/limits.d/20-nproc.conf

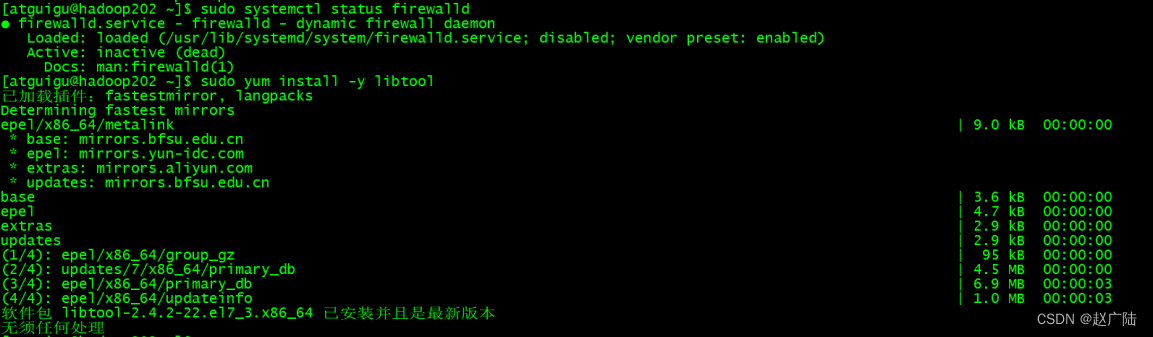

1.1.3 安装依赖

[careate@hadoop102 ~]$ sudo yum install -y libtool

在 hadoop103、hadoop104 上执行以上操作

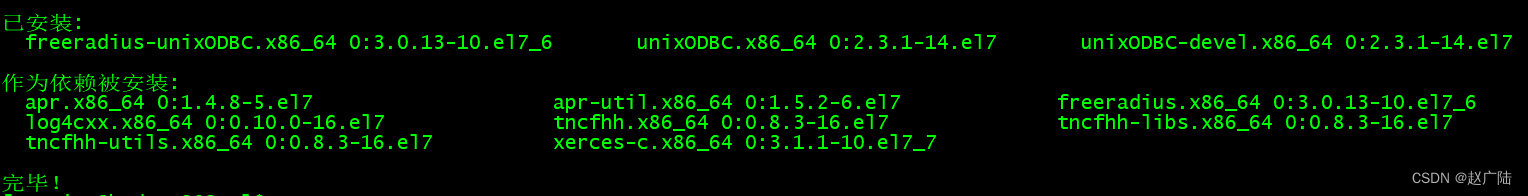

[careate@hadoop102 ~]$ sudo yum install -y *unixODBC*

1.1.4 CentOS 取消 SELINUX

(1)修改/etc/selinux/config 中的 SELINUX=disabled

[careate@hadoop102 ~]$ sudo vim /etc/selinux/config

SELINUX=disabled

(2)执行同步操作

[careate@hadoop102 ~]$ sudo /home/careate/bin/xsync /etc/selinux/config

(3)重启三台服务器

1.2 单机安装

官网:https://clickhouse.tech/

下载地址:http://repo.red-soft.biz/repos/clickhouse/stable/el7/

1.2.1 在 hadoop102 的/opt/software 下创建 clickhouse 目录

[careate@hadoop102 software]$ mkdir clickhouse

1.2.2 将安装文件上传到 hadoop102 的software/clickhouse 目录下

1.2.3 将安装文件同步到 hadoop103、hadoop104

[careate@hadoop102 software]$ xsync clickhouse

1.2.4 分别在三台机子上安装这 4 个 rpm 文件

[careate@hadoop102 clickhouse]$ sudo rpm -ivh *.rpm

1.2.5 修改配置文件

[careate@hadoop102 clickhouse]$ sudo vim /etc/clickhouse-server/config.xml

(1)把 <listen_host>::</listen_host> 的注释打开,这样的话才能让 ClickHouse 被除本机以外的服务器访问

(2)分发配置文件

sudo /home/careate/bin/xsync /etc/clickhouse-server/config.xml

在这个文件中,有 ClickHouse 的一些默认路径配置,比较重要的

数据文件路径: /var/lib/clickhouse/

日志文件路径:/var/log/clickhouse-server/clickhouse-server.log</log

1.2.6 启动 Server

[careate@hadoop102 clickhouse]$ sudo systemctl start clickhouse-server

1.2.7 三台机器上关闭开机自启

[careate@hadoop102 clickhouse]$sudo systemctl disable clickhouse-server

1.2.8 使用 client 连接 server

[careate@hadoop102 clickhouse]$ clickhouse-client -m

-m :可以在命令窗口输入多行命令

2 副本

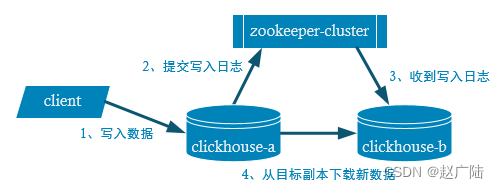

副本的目的主要是保障数据的高可用性,即使一台 ClickHouse 节点宕机,那么也可以从其他服务器获得相同的数据。

https://clickhouse.tech/docs/en/engines/table-engines/mergetree-family/replication/

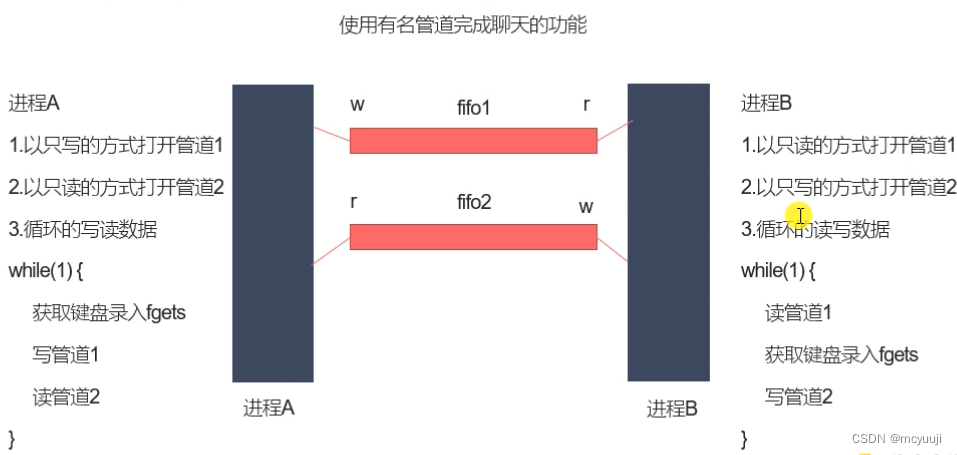

2.1 副本写入流程

2.2 配置步骤

(1)启动 zookeeper 集群

(2)在 hadoop102 的/etc/clickhouse-server/config.d 目录下创建一个名为 metrika.xml

的配置文件,内容如下:

注:也可以不创建外部文件,直接在 config.xml 中指定

<?xml version="1.0"?>

<yandex>

<zookeeper-servers>

<node index="1">

<host>hadoop102</host>

<port>2181</port>

</node>

<node index="2">

<host>hadoop103</host>

<port>2181</port>

</node>

<node index="3">

<host>hadoop104</host>

<port>2181</port>

</node>

</zookeeper-servers>

</yandex>

(3)同步到 hadoop103 和 hadoop104 上

sudo /home/careate/bin/xsync /etc/clickhouse-server/config.d/metrika.xml

(4)在 hadoop102 的/etc/clickhouse-server/config.xml 中增加

<zookeeper incl="zookeeper-servers" optional="true" />

<include_from>/etc/clickhouse-server/config.d/metrika.xml</include_from>

(5)同步到 hadoop103 和 hadoop104 上

sudo /home/careate/bin/xsync /etc/clickhouse-server/config.xml

分别在 hadoop102 和 hadoop103 上启动 ClickHouse 服务

注意:因为修改了配置文件,如果以前启动了服务需要重启

[careate@hadoop102|3 ~]$ sudo clickhouse restart

注意:我们演示副本操作只需要在 hadoop102 和 hadoop103 两台服务器即可,上面的操作,我们 hadoop104 可以你不用同步,我们这里为了保证集群中资源的一致性,做了同步。

(6)在 hadoop102 和 hadoop103 上分别建表

副本只能同步数据,不能同步表结构,所以我们需要在每台机器上自己手动建表

①hadoop102

create table t_order_rep2 (

id UInt32,

sku_id String,

total_amount Decimal(16,2),

create_time Datetime

) engine =ReplicatedMergeTree('/clickhouse/table/01/t_order_rep','rep_102')

partition by toYYYYMMDD(create_time)

primary key (id)

order by (id,sku_id);

②hadoop103

create table t_order_rep2 (

id UInt32,

sku_id String,

total_amount Decimal(16,2),

create_time Datetime

) engine =ReplicatedMergeTree('/clickhouse/table/01/t_order_rep','rep_103')

partition by toYYYYMMDD(create_time)

primary key (id)

order by (id,sku_id);

③参数解释

ReplicatedMergeTree 中,第一个参数是分片的 zk_path 一般按照:/clickhouse/table/{shard}/{table_name} 的格式写,如果只有一个分片就写 01 即可

第二个参数是副本名称,相同的分片副本名称不能相同。

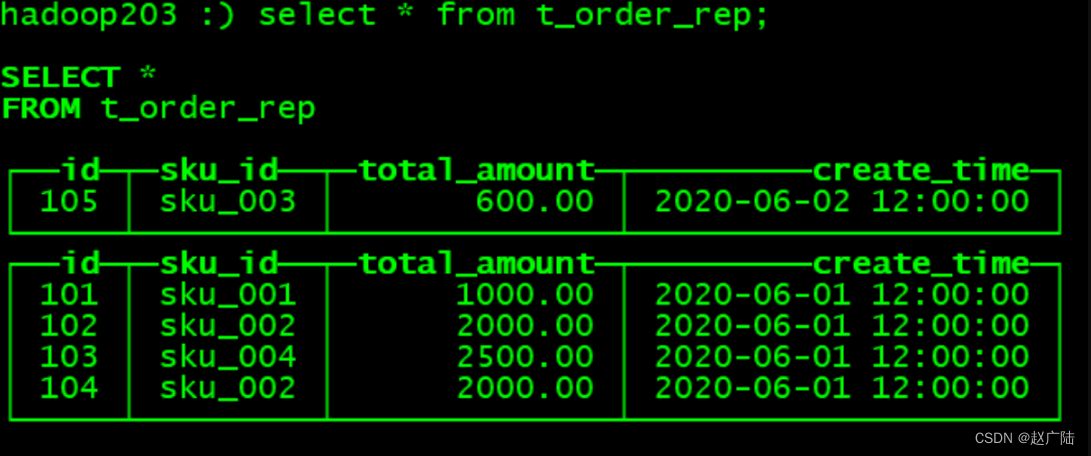

(7)在 hadoop102 上执行 insert 语句

insert into t_order_rep2 values

(101,'sku_001',1000.00,'2020-06-01 12:00:00'),

(102,'sku_002',2000.00,'2020-06-01 12:00:00'),

(103,'sku_004',2500.00,'2020-06-01 12:00:00'),

(104,'sku_002',2000.00,'2020-06-01 12:00:00'),

(105,'sku_003',600.00,'2020-06-02 12:00:00');

(8)在 hadoop103 上执行 select,可以查询出结果,说明副本配置正确

3 分片集群

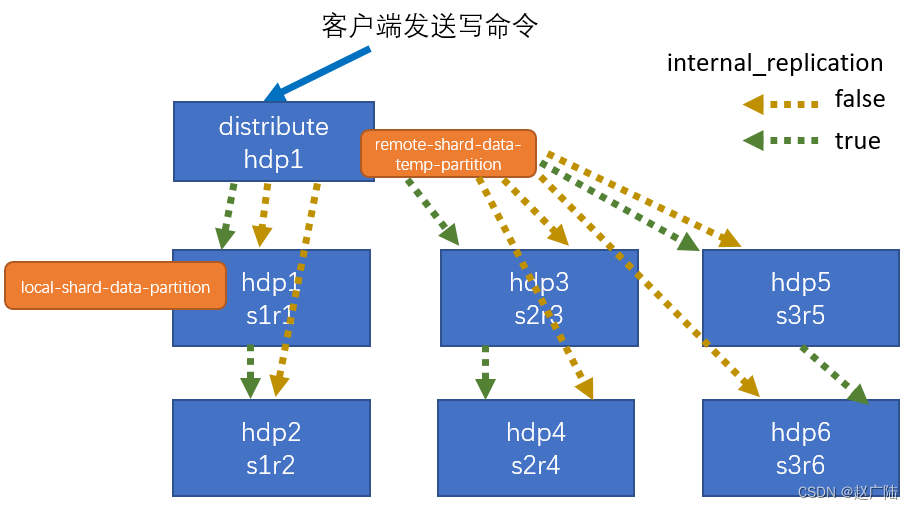

副本虽然能够提高数据的可用性,降低丢失风险,但是每台服务器实际上必须容纳全量数据,对数据的横向扩容没有解决。

要解决数据水平切分的问题,需要引入分片的概念。通过分片把一份完整的数据进行切分,不同的分片分布到不同的节点上,再通过 Distributed 表引擎把数据拼接起来一同使用。

Distributed 表引擎本身不存储数据,有点类似于 MyCat 之于 MySql,成为一种中间件,通过分布式逻辑表来写入、分发、路由来操作多台节点不同分片的分布式数据。

注意:ClickHouse 的集群是表级别的,实际企业中,大部分做了高可用,但是没有用分片,避免降低查询性能以及操作集群的复杂性。

3.1 集群写入流程(3 分片 2 副本共 6 个节点)

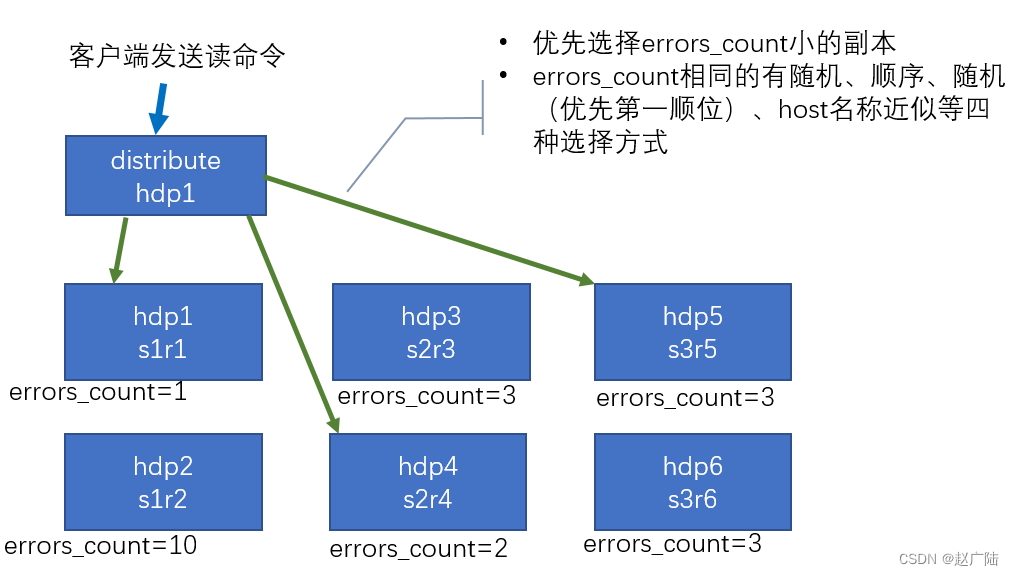

3.2 集群读取流程(3 分片 2 副本共 6 个节点)

3.3 3 分片 2 副本共 6 个节点集群配置(供参考)

配置的位置还是在之前的/etc/clickhouse-server/config.d/metrika.xml,内容如下

注:也可以不创建外部文件,直接在 config.xml 的<remote_servers>中指定

<yandex>

<remote_servers>

<gmall_cluster> <!-- 集群名称-->

<shard> <!--集群的第一个分片-->

<internal_replication>true</internal_replication>

<!--该分片的第一个副本-->

<replica>

<host>hadoop101</host>

<port>9000</port>

</replica>

<!--该分片的第二个副本-->

<replica>

<host>hadoop102</host>

<port>9000</port>

</replica>

</shard>

<shard> <!--集群的第二个分片-->

<internal_replication>true</internal_replication>

<replica> <!--该分片的第一个副本-->

<host>hadoop103</host>

<port>9000</port>

</replica>

<replica> <!--该分片的第二个副本-->

<host>hadoop104</host>

<port>9000</port>

</replica>

</shard>

<shard> <!--集群的第三个分片-->

<internal_replication>true</internal_replication>

<replica> <!--该分片的第一个副本-->

<host>hadoop105</host>

<port>9000</port>

</replica>

<replica> <!--该分片的第二个副本-->

<host>hadoop106</host>

<port>9000</port>

</replica>

</shard>

</gmall_cluster>

</remote_servers>

</yandex>

3.4 配置三节点版本集群及副本

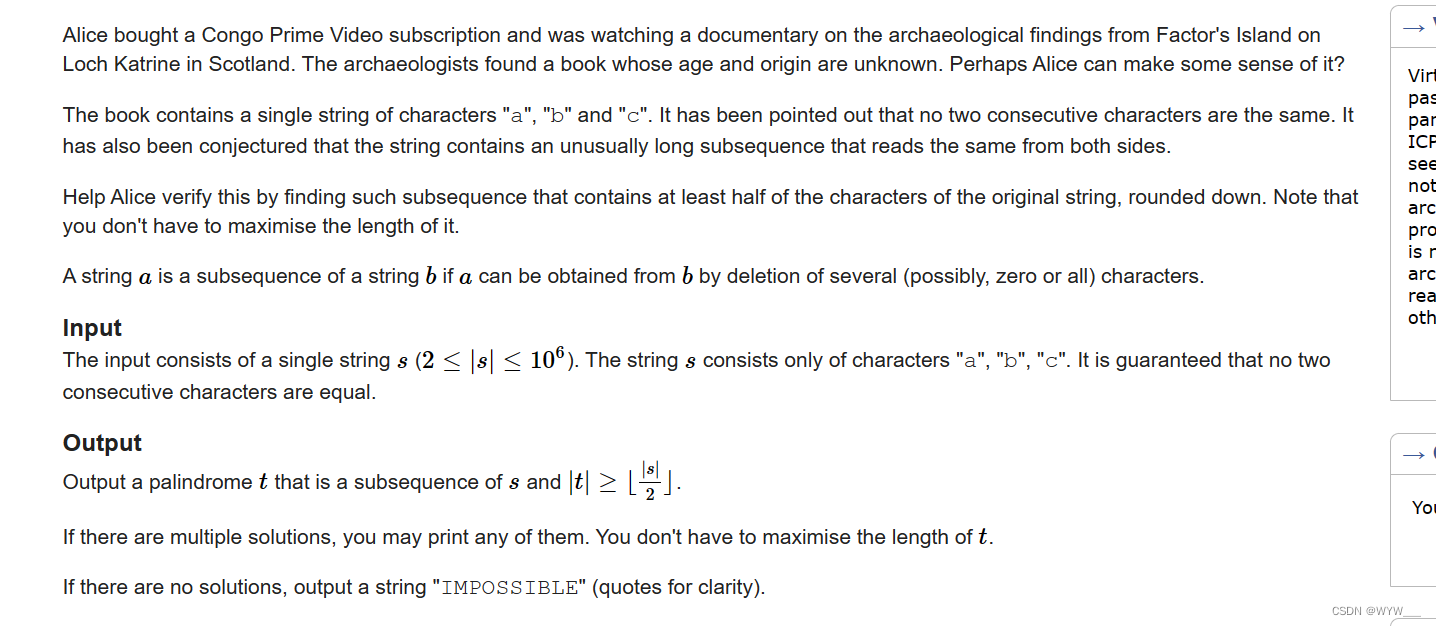

3.4.1 集群及副本规划(2 个分片,只有第一个分片有副本)

3.4.2 配置步骤

1)在 hadoop102 的/etc/clickhouse-server/config.d 目录下创建 metrika-shard.xml 文件

注:也可以不创建外部文件,直接在 config.xml 的<remote_servers>中指定

<?xml version="1.0"?>

<yandex>

<remote_servers>

<gmall_cluster> <!-- 集群名称-->

<shard> <!--集群的第一个分片--> <internal_replication>true</internal_replication>

<replica> <!--该分片的第一个副本-->

<host>hadoop102</host>

<port>9000</port>

</replica>

<replica> <!--该分片的第二个副本-->

<host>hadoop103</host>

<port>9000</port>

</replica>

</shard>

<shard> <!--集群的第二个分片-->

<internal_replication>true</internal_replication>

<replica> <!--该分片的第一个副本-->

<host>hadoop104</host>

<port>9000</port>

</replica>

</shard>

</gmall_cluster>

</remote_servers>

<zookeeper-servers>

<node index="1">

<host>hadoop102</host>

<port>2181</port>

</node>

<node index="2">

<host>hadoop103</host>

<port>2181</port>

</node>

<node index="3">

<host>hadoop104</host>

<port>2181</port>

</node>

</zookeeper-servers>

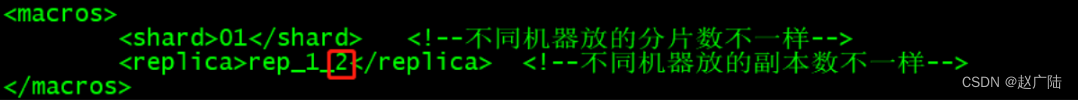

<macros>

<shard>01</shard> <!--不同机器放的分片数不一样-->

<replica>rep_1_1</replica> <!--不同机器放的副本数不一样-->

</macros>

</yandex>

2)将 hadoop102 的 metrika-shard.xml 同步到 103 和 104

sudo /home/careate/bin/xsync /etc/clickhouse-server/config.d/metrika-shard.xml

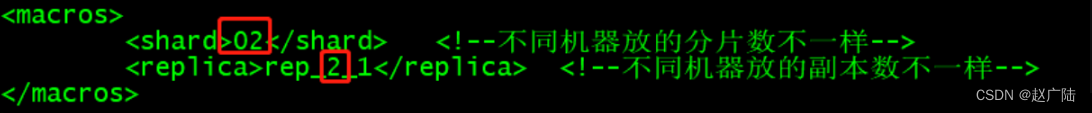

3)修改 103 和 104 中 metrika-shard.xml 宏的配置

(1)103

[careate@hadoop103 ~]$ sudo vim

/etc/clickhouse-server/config.d/metrika-shard.xml

(2)104

[careate@hadoop104 ~]$ sudo vim

/etc/clickhouse-server/config.d/metrika-shard.xml

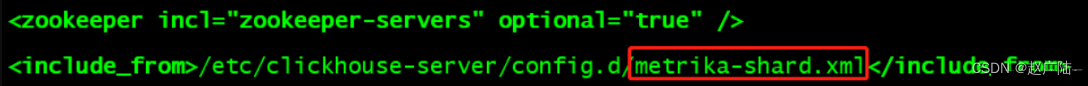

4)在 hadoop102 上修改/etc/clickhouse-server/config.xml

5)同步/etc/clickhouse-server/config.xml 到 103 和 104

[careate@hadoop102 ~]$ sudo /home/careate/bin/xsync

/etc/clickhouse-server/config.xml

6)重启三台服务器上的 ClickHouse 服务

[careate@hadoop102 clickhouse-server]$ sudo clickhouse restart

[careate@hadoop102 clickhouse-server]$ ps -ef |grep click

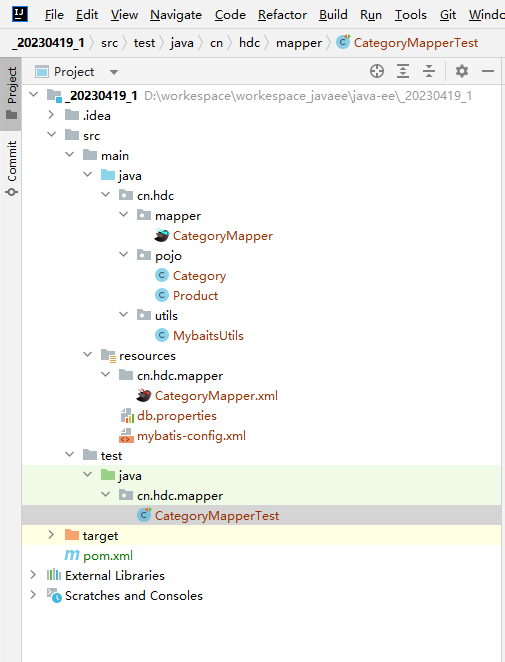

7)在 hadoop102 上执行建表语句

➢ 会自动同步到 hadoop103 和 hadoop104 上

➢ 集群名字要和配置文件中的一致

➢ 分片和副本名称从配置文件的宏定义中获取

create table st_order_mt on cluster gmall_cluster (

id UInt32,

sku_id String,

total_amount Decimal(16,2),

create_time Datetime

) engine

=ReplicatedMergeTree('/clickhouse/tables/{shard}/st_order_mt','{replica}')

partition by toYYYYMMDD(create_time)

primary key (id)

order by (id,sku_id);

可以到 hadoop103 和 hadoop104 上查看表是否创建成功

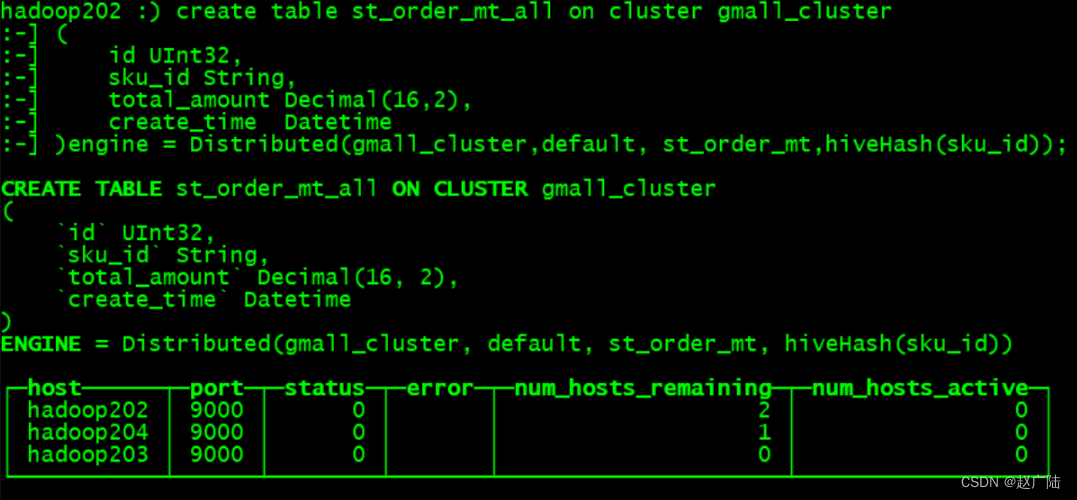

8)在 hadoop102 上创建 Distribute 分布式表

create table st_order_mt_all2 on cluster gmall_cluster

(

id UInt32,

sku_id String,

total_amount Decimal(16,2),

create_time Datetime

)engine = Distributed(gmall_cluster,default, st_order_mt,hiveHash(sku_id));

参数含义:

Distributed(集群名称,库名,本地表名,分片键)

分片键必须是整型数字,所以用 hiveHash 函数转换,也可以 rand()

9)在 hadoop102 上插入测试数据

insert into st_order_mt_all2 values

(201,'sku_001',1000.00,'2020-06-01 12:00:00') ,

(202,'sku_002',2000.00,'2020-06-01 12:00:00'),

(203,'sku_004',2500.00,'2020-06-01 12:00:00'),

(204,'sku_002',2000.00,'2020-06-01 12:00:00'),

(205,'sku_003',600.00,'2020-06-02 12:00:00');

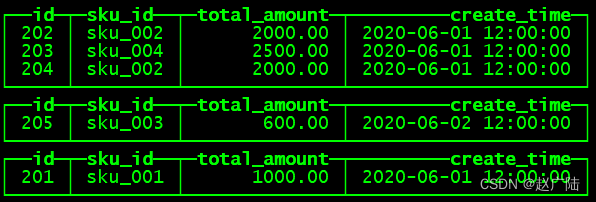

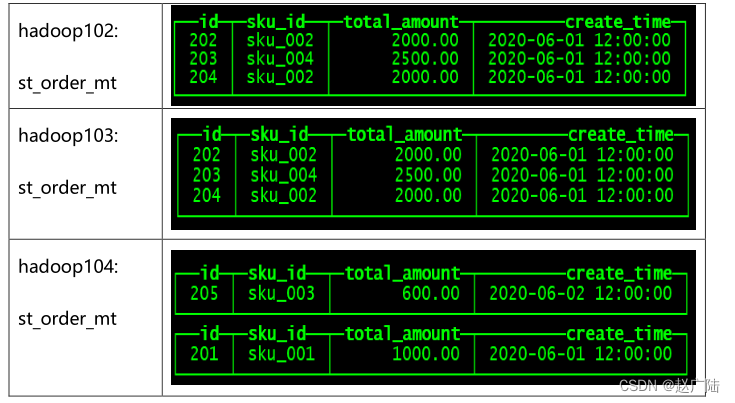

10)通过查询分布式表和本地表观察输出结果

(1)分布式表

SELECT * FROM st_order_mt_all;

(2)本地表

select * from st_order_mt;

(3)观察数据的分布