文章目录

- 市场的价值将增长点

- 技术栈:基础架构、模型和应用程序

- 生成式 AI 应用程序留存率和差异化方面举步维艰

- 生成式 AI 应用程序公司面临的一些问题

- 模型提供商尚未达到大规模商业规模

- 基础设施供应商是目前的最大赢家

- 系统性的护城河

- 技术栈早期阶段出现在生成人工智能 (AI) 中。新创业公司正涌入市场,开发基础模型、构建 AI 原生应用程序并建立基础设施/工具。

- 许多热门技术趋势在市场赶上之前就被过度炒作了。生成式人工智能的繁荣伴随着真实市场的实际收益,以及来自真实公司的真正吸引力。

- Stable Diffusion、ChatGPT 等模型正在创造用户增长的历史记录,多个应用程序在推出后不到一年的时间就达到了 1 亿美元的年化收入。

- 人工智能模型在某些任务中的表现优于人类多个数量级。

市场的价值将增长点

- 基础架构供应商可能是该市场迄今为止的最大赢家,占据了流经堆栈的大部分资金。

- 应用程序公司的收入增长非常快,但往往在留存率、产品差异化和毛利率方面苦苦挣扎。

- 模型提供商(大多数),虽然负责这个市场的存在,但尚未实现大规模的商业规模。

换句话说,创造最大价值的公司——即训练生成式 AI 模型并将其应用于新应用程序——并没有获得大部分价值。

非常看好生成式人工智能,相信它将对软件行业及其他行业产生巨大影响。

这篇文章的目的是描绘出市场动态,并开始回答有关生成式 AI 商业模式的更广泛问题。

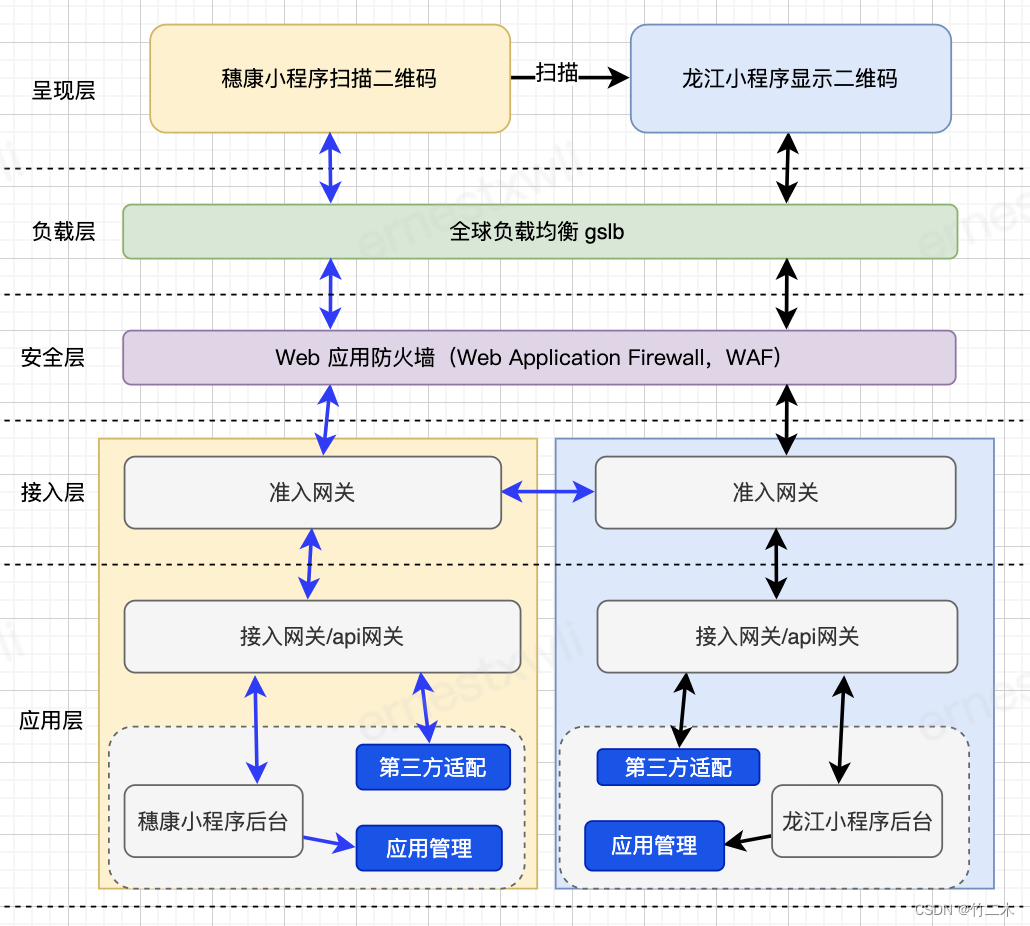

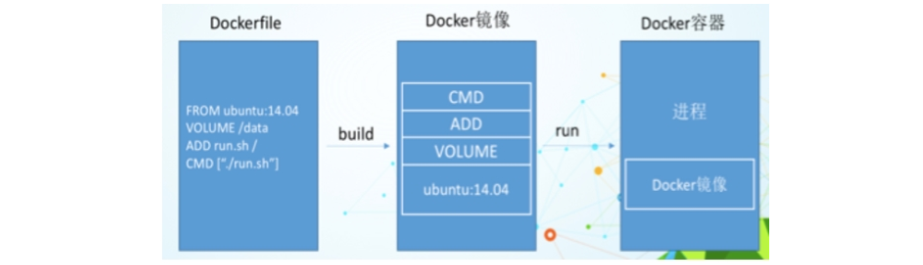

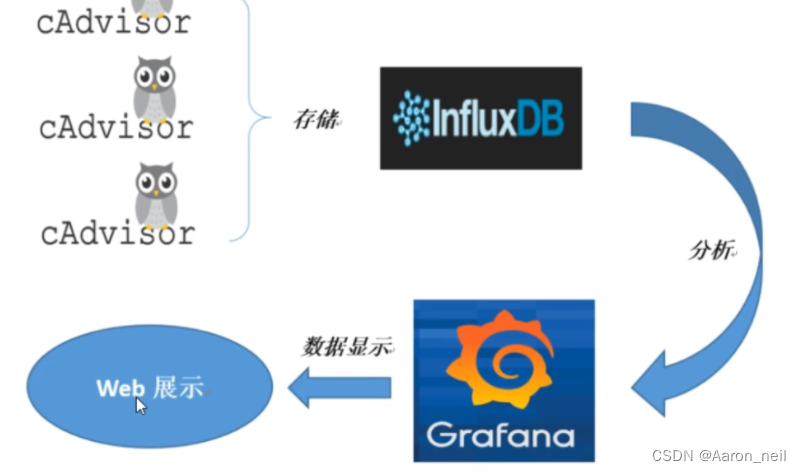

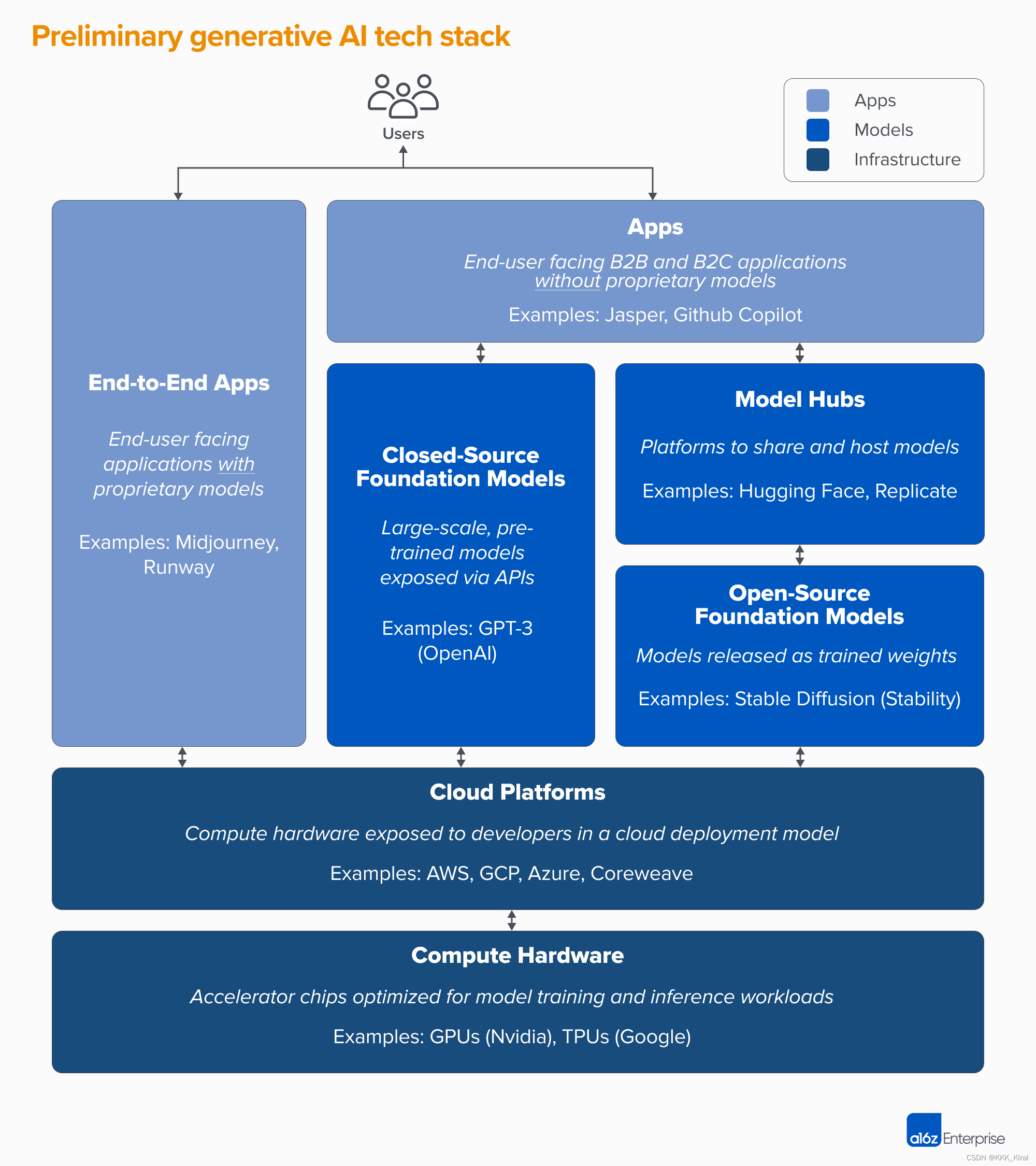

技术栈:基础架构、模型和应用程序

生成式人工智能市场的形成,分析市场的框架。

技术栈可以分为三层:

- Applications:将生成的 AI 模型集成到面向用户的产品中的应用程序,运行自己的模型管道(“端到端应用程序”)或依赖第三方 API

- Models:为 AI 产品提供动力的模型 ,可以作为专有 API 或开源检查点(反过来,这需要托管解决方案)提供

- Infrastructure venors:为生成人工智能模型运行训练和推理工作负载的 基础设施供应商(即云平台和硬件制造商)

生成式 AI 应用程序留存率和差异化方面举步维艰

- 在纯粹的新颖性和大量用例的推动下,生成式 AI 应用程序的增长一直是惊人的。 至少三个产品类别的年收入已经超过 1 亿美元:图像生成、文案撰写和代码编写。

- 增长必须是有利可图的——从某种意义上说,用户和客户一旦注册,就会产生利润(高毛利率)并长期坚持(高保留率)。

- 已经看到付费获取的有效性和保留率开始下降。 因为它们依赖于类似的底层人工智能模型,并且没有发现竞争对手难以复制的明显网络效应或数据/工作流。

- 销售终端用户应用程序是建立可持续的生成式 AI 业务的唯一甚至最佳途径尚不明显。

- 随着语言模型的竞争和效率的提高,利润率应该会提高。

- 垂直整合的应用程序在推动差异化方面具有优势。

生成式 AI 应用程序公司面临的一些问题

- 垂直整合(模型+应用程序)。

- 将 AI 模型作为服务使用,可以让应用程序开发人员与小团队快速迭代,并随着技术进步交换模型提供商。

- 认为产品就是模型,通过专有产品数据不断地重新训练。 但这以更高的资本要求和更不灵活的产品团队为代价。

- 构建功能与应用程序。

- 生成式 AI 产品有多种不同的形式

- 桌面应用程序、移动应用程序、Figma/Photoshop 插件、Chrome 扩展程序,甚至是 Discord 机器人。

- 通过炒作周期进行管理。

- 目前尚不清楚流失是当前批次的生成式 AI 产品固有的,还是早期市场的产物。

- 随着炒作的消退,对生成式人工智能的兴趣是否会下降。

模型提供商尚未达到大规模商业规模

- 谷歌、OpenAI 和 Stability 通过新颖的模型架构和扩展训练管道所做的出色研究和工程工作,使得生成式 AI 高速发展。大型语言模型 (LLM) 和图像生成模型的功能令人惊叹。

- 与使用量和口碑相比,与这些公司相关的收入仍然相对较小。

- 在图像生成方面,Stable Diffusion 在用户界面、托管产品和微调方法的生态系统的支持下出现了爆炸性的社区增长。核心原则免费提供。

- 在自然语言模型中,OpenAI 以 GPT-3/3.5 和 ChatGPT 占据主导地位。但到目前为止,基于 OpenAI 构建的杀手级应用相对较少。未来顺利集成到 Microsoft 的产品组合中,将带来大规模收入。

闭源模型也有其优势

- 由 Anthropic、Cohere 和 Character.ai 等公司构建的 LLM 更接近 OpenAI 的性能水平,在类似的数据集上训练并使用类似的模型架构。

- Stable Diffusion 的例子表明,如果开源模型达到足够的性能水平和社区支持,那么专有替代品可能会发现难以竞争。

- 对于模型提供商来说,最明显的收获可能是商业化可能与托管有关。

- 对专有 API的需求正在迅速增长。

- 开源模型的托管服务正在成为方便共享和集成模型的有用中心。(例如 Hugging Face 和 Replicate)

- 可以通过与企业客户的微调和托管协议来获利。

基础设施供应商是目前的最大赢家

- 生成式 AI 中的几乎所有内容都在某个时刻通过云托管 GPU(或 TPU)。无论是运行训练工作负载的模型提供商/研究实验室、运行推理/微调的托管公司

- 最具颠覆性的计算技术的进步第一次受到大规模计算的限制。

- 生成人工智能市场的大量资金最终流向了基础设施公司。大约 10-20% 流向了云提供商。

- 三大云:亚马逊网络服务 (AWS)、谷歌云平台 (GCP) 和 Microsoft Azure。特别是在生成式 AI 中,他们还受益于供应限制,因为他们可以优先使用稀缺硬件(例如 Nvidia A100 和 H100 GPU)。

- 在幕后,运行绝大多数 AI 工作负载的可能是迄今为止生成 AI 领域的最大赢家:Nvidia。通过数十年来对 GPU 架构的投资、强大的软件生态系统以及在学术界的深入使用,他们围绕这项业务建立了强大的护城河。

系统性的护城河

- 今天生成式人工智能似乎没有任何系统性的护城河。

- 应用程序缺乏很强的产品差异化,因为它们使用相似的模型

- 模型面临不明确的长期差异,因为它们是在具有相似架构的相似数据集上训练的

- 云提供商缺乏深度的技术差异化,因为他们运行相同的 GPU

- 甚至硬件公司也在同一家工厂生产芯片

标准的护城河:

- 规模护城河(“我拥有或可以筹集到比你更多的钱!”)

- 供应链护城河(“我有 GPU,你没有!”)

- 生态系统护城河(“每个人都已经在使用我的软件了!”)

- 算法护城河(“我们比你聪明!”)

- 分销护城河(“我已经有一个销售团队和比你更多的客户!”)

- 数据管道护城河(“我在互联网上的爬行比你还多!”)

无论如何,我们可以肯定的是,生成式 AI 会改变游戏规则。我们都在实时学习规则,将会释放出巨大的价值,因此技术领域将变得非常非常不同。我们为此而来!

🔗 原文链接:who-owns-the-generative-ai-platform

![[个人笔记] Zabbix实现自定义脚本监控Agent端](https://img-blog.csdnimg.cn/ba9a32e68079454889251c63a0169816.png)