NePTuNe:Neural Powered Tucker Network for Knowledge Graph Completion

- - Introduction

- - Background

- - Algorithm

- - Experiment

- - Conclusion

- - Code

Shashank Sonkar, Arzoo Katiyar, Richard G.Baraniuk

- Introduction

目前的链接预测方法:

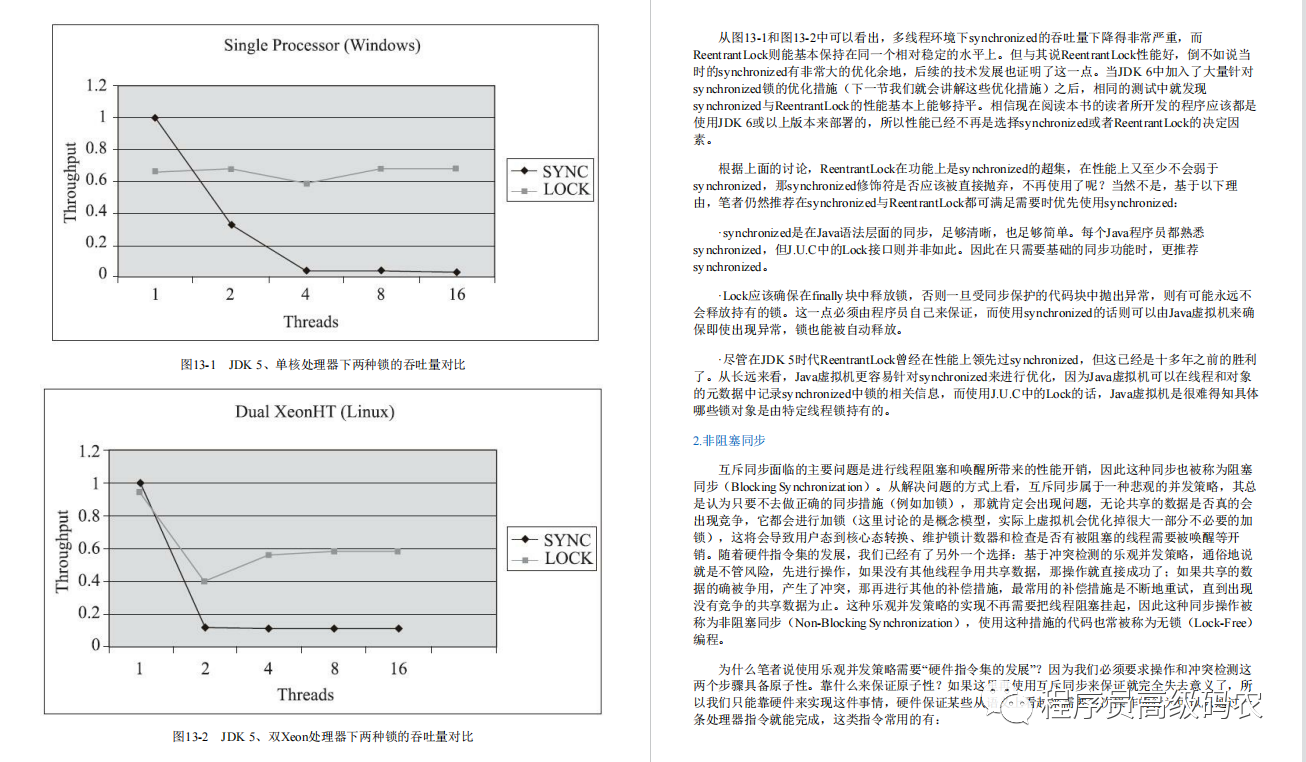

- 张量因式分解;由于因子分解方法的参数数量较少,因此训练和部署速度很快,但由于其基本的线性方法,表达能力有限。

- 和/或深度学习;深度学习方法表达能力更强,但计算成本也更高,而且由于它们有大量可训练的参数,容易过拟合。

本文提出了神经驱动tucker网络(NePTuNe),一种新的混合链接预测模型,它将深度模型的表达能力与线性模型的速度和大小相结合。

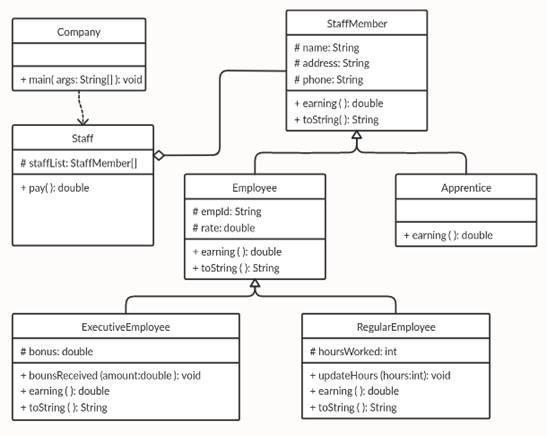

- Background

NePTuNe是一种混合链路预测模型,利用了塔克和NTN的理想特征,其非线性使得NePTuNe比TuckER更具表现力。

利用Tucker分解中固有的共享核心张量原理,可以实现参数共享,同时显著减少参数数量,纠正过拟合,并使NePTuNe训练快速有效。

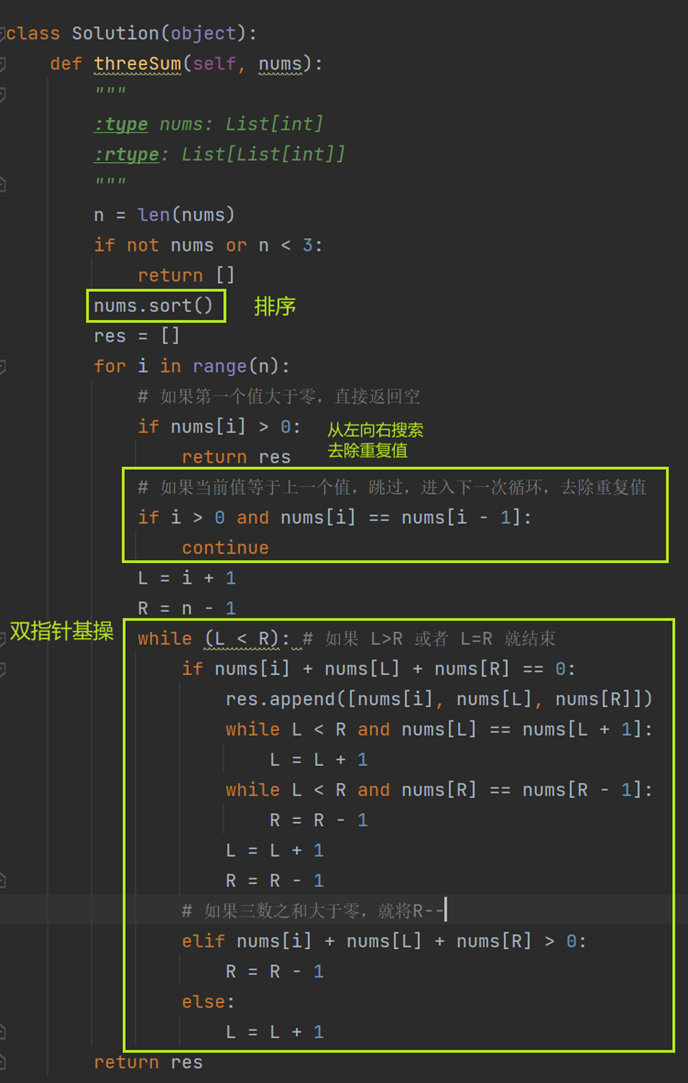

- Algorithm

TuckER打分函数:

NTN打分函数:

在不添加非线性操作时,TuckER可以通过NTN进行推导:

·而NePTuNe打分函数:

损失函数:

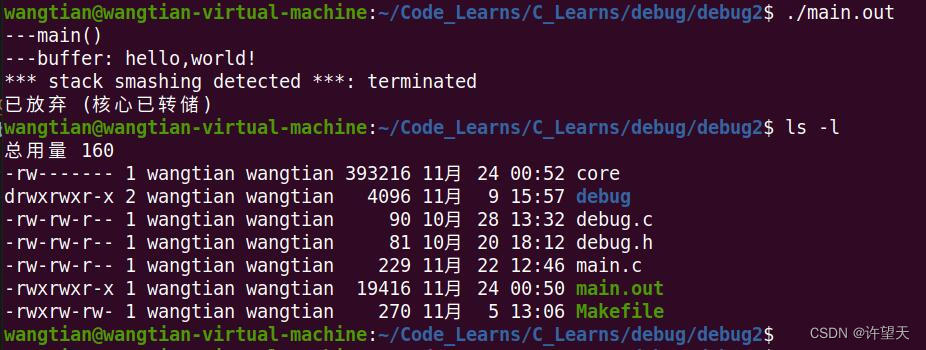

- Experiment

链接预测:

- Conclusion

NePTuNe,这是一种紧凑且计算效率高的知识图完成模型,它将线性方法的速度和鲁棒性与非线性方法的表达性相结合,用于链接预测。

总之,这是一篇创新型很低的模型,发表的会议都查不到级别。但是还是能从中学一些小trick的。

比如和原方法的数学证明关系,已经用证明模型的时间或空间复杂度来填充论文,但整体借鉴意义不大。

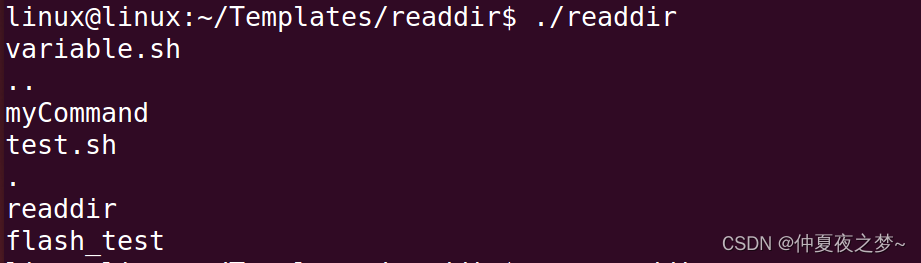

- Code

https://github.com/luffycodes/neptune