随着数据安全和隐私保护相关法律法规的出台,需要直接在中央服务器上收集和处理数据的集中式解决方案,对于个性化物联网而言,训练各种特定领域场景的人工智能模型已变得不切实际。基于此,中山大学,南洋理工大学,北京大学,奥斯陆大学以及普林斯顿大学联合提出了一个安全、经济高效且领域自适应的框架——Cedar,以隐私保护的方式训练个性化模型。本质上,Cedar 集成了联邦学习和元学习,从而在个性化物联网中实现安全的知识转移,从而构建具有高泛化能力且可被客户端快速调整的模型。通过使用来自不同领域的标准数据集进行评估,Cedar 在效率和安全性等方面均取得了显著的提升。这些结果揭示了联邦元学习的可行性和稳健性,从而释放了人工智能在改革个性化物联网方面的潜力。

论文:You, L., Guo, Z., Yuen, C. et al. A framework reforming personalized Internet of Things by federated meta-learning. Nat Commun 16, 3739 (2025). https://doi.org/10.1038/s41467-025-59217-z

论文链接:https://www.nature.com/articles/s41467-025-59217-z

项目地址:https://github.com/IntelligentSystemsLab/generic_and_open_learning_federator

目录

- 联邦元学习与PIoT

- Cedar框架

联邦元学习与PIoT

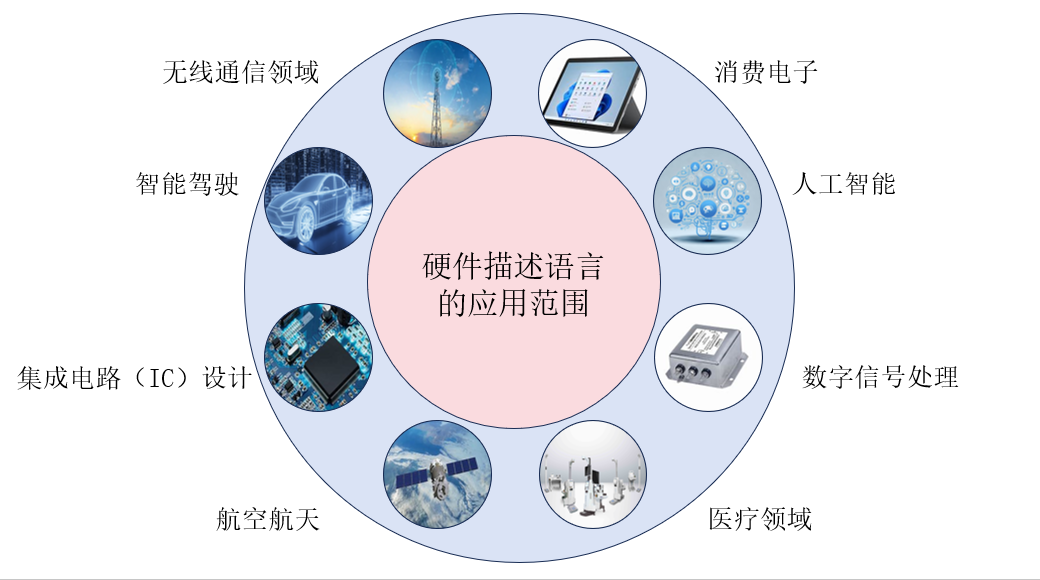

PIoT即个性化IoT,兼顾整体系统效率和IoT端的个性化服务。AI模型在服务端收集高质量样本训练,然后根据个人偏好微调。为了发挥PIoT在边缘计算的优势,目前面临以下问题:

- 服务器上的集中训练不足:原因是客户端隐私保护导致服务端的数据难以进一步扩展和质量提高。

- PIoT客户端的个性化需求越来越明显:集中模型不能给个体带来最合适的response,在客户端定制和微调模型非常必要。

因此,需要一个以协作为导向的隐私保护FL框架。通过聚合学习参与者上传的本地模型来训练全局模型,而不是直接在服务器上收集和处理私人数据。目前FL为了获得一个与全局模型能力相当的客户端模型依然面临下面挑战:

- 不同客户端的数据是Non-IID的,直接汇总客户端模型,会导致全局模型在主要样本上过拟合,阻碍个性化

- 需要降低协作的成本:服务器和客户端频繁上传和发送模型会造成通信成本增加

- 在开放的网络中,会面临攻击,恶意客户端会上传有毒的模型

针对三个挑战,分别有下面解决方案:

- 对于数据异质性:1.过滤局部数据训练,2.知识蒸馏,元学习,原型学习提取代表性知识训练全局模型

- 对于成本:1.减少模型大小和学习轮数,2.优化云-边缘的协作拓扑

- 对于攻击:同态加密,安全多方计算防御恶意客户端

目前这些方案的缺陷是,不能直接组合到PIoT中,比如提高了安全性,学习成本会增大,或者降低成本,模型性能下降。Cedar集成了联邦学习和元学习,可以保护隐私并用元模型快速适应个性化领域,非对称的模型上传机制提高协作效率,并防御攻击。Cedar封装在GOLF中(generic and open learning federator)。

Cedar框架

Cedar的三个阶段,1.学习准备,2.元模型训练,3.模型部署(图a)

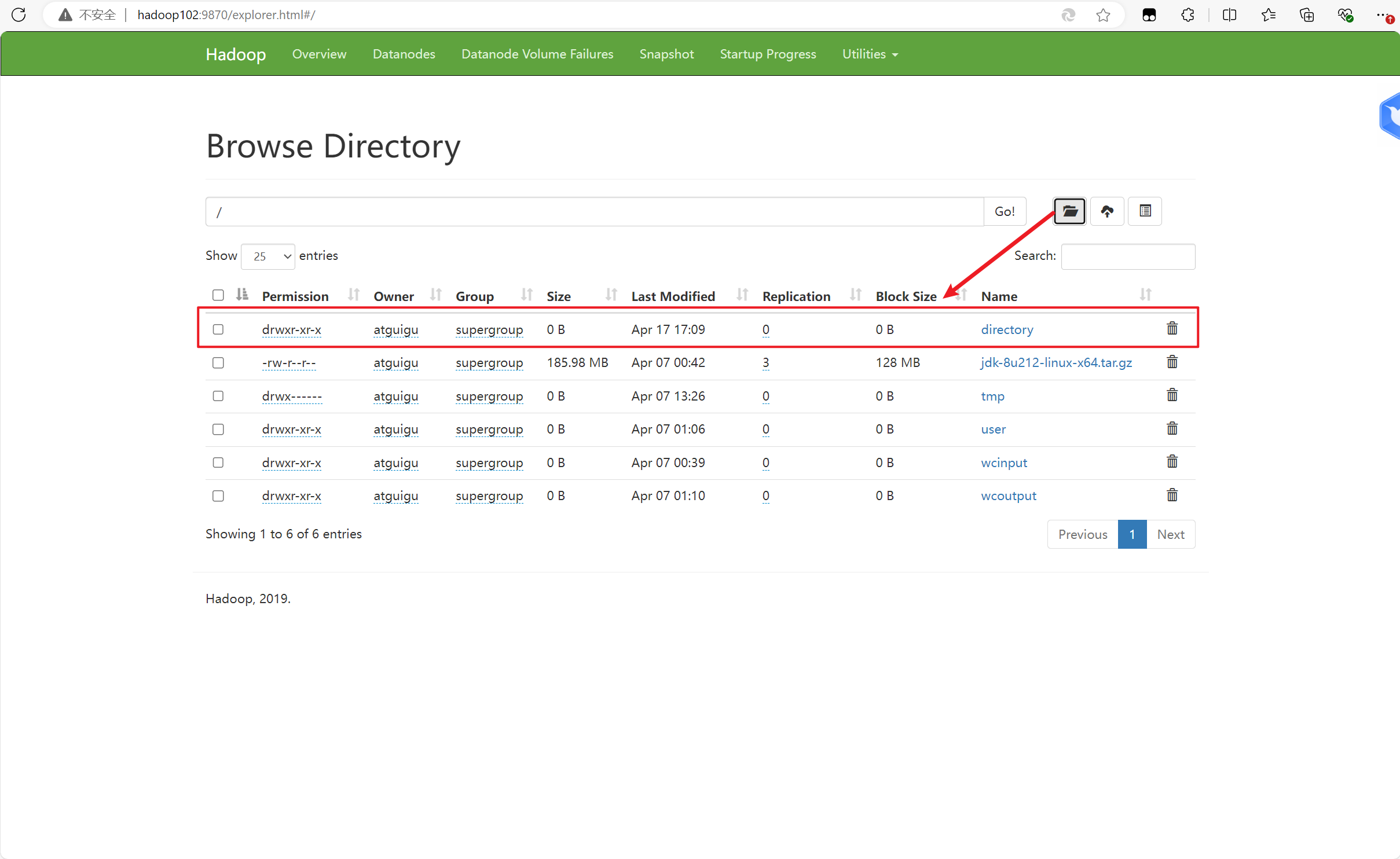

- 阶段1:服务端(协调器-coordinator)收到客户端的更新请求,首先会激活有训练数据集的客户端

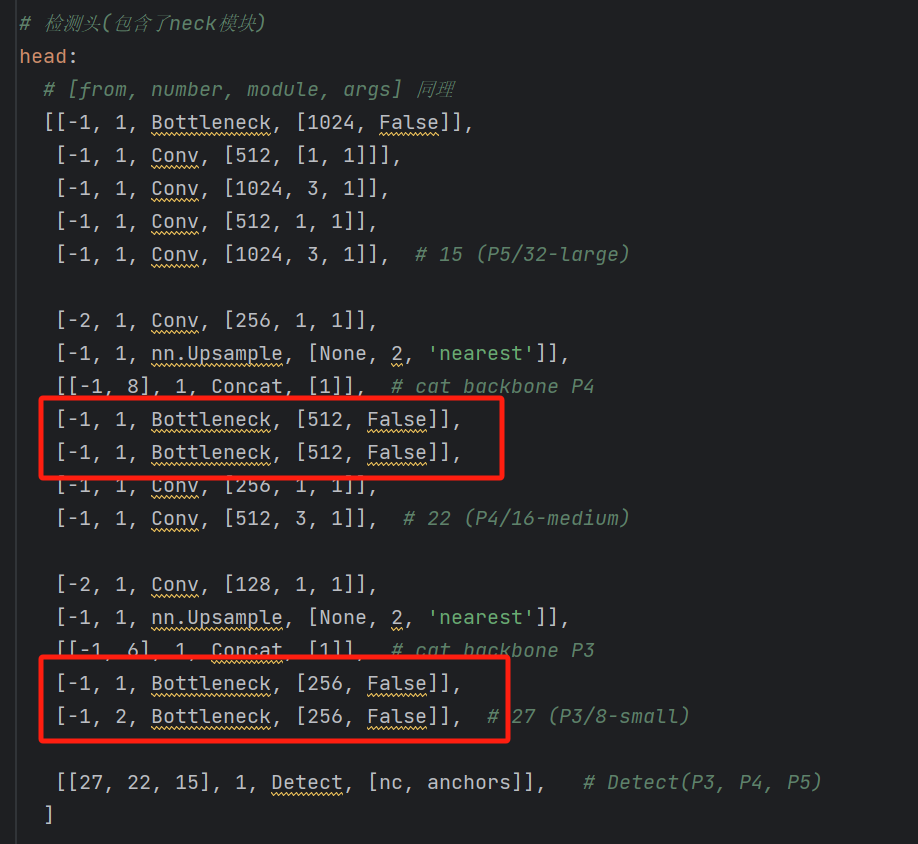

- 阶段2:元模型通过协调器与客户端交互进行训练,首先,协调器把任务规范发给激活的客户端,每个客户端在本地训练,上传重要层(节省成本)到服务器聚合更新为全局元模型。

对于阶段2,考虑到Non-IID的数据异质性,Cedar不从客户端提取局部知识再聚合,而是用元学习获得可泛化的全局元模型----图b

Cedar自动过滤重要模型层,并只上传重要层,节省成本----图c

Cedar利用非对称模型进行防御,协调器可以检测异常的更新----图d - 阶段3:训练完全局元模型后,PIoT中的客户端下载元模型,根据本地数据微调,获得个性化模型—图e

![[Godot] C#2D平台游戏基础移动和进阶跳跃代码](https://i-blog.csdnimg.cn/direct/5951af83e0ea4472a16bee492c67dda1.png)