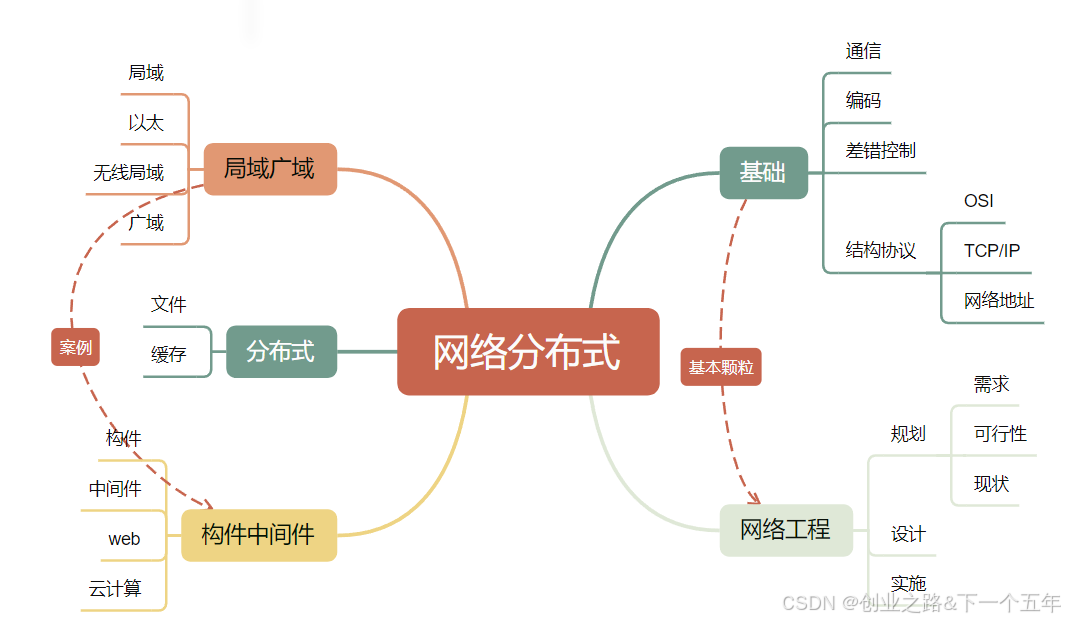

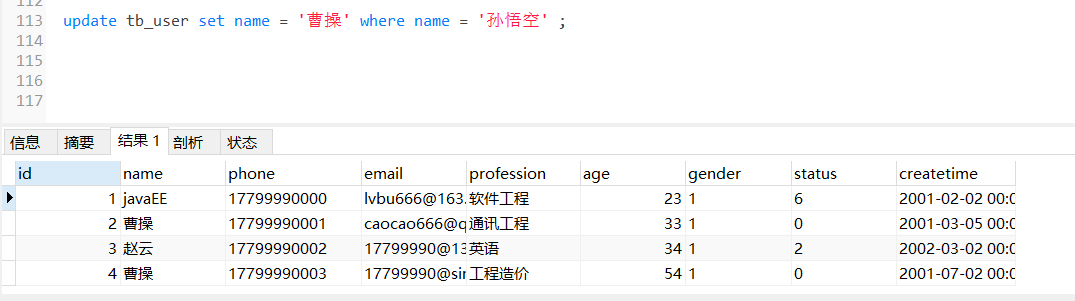

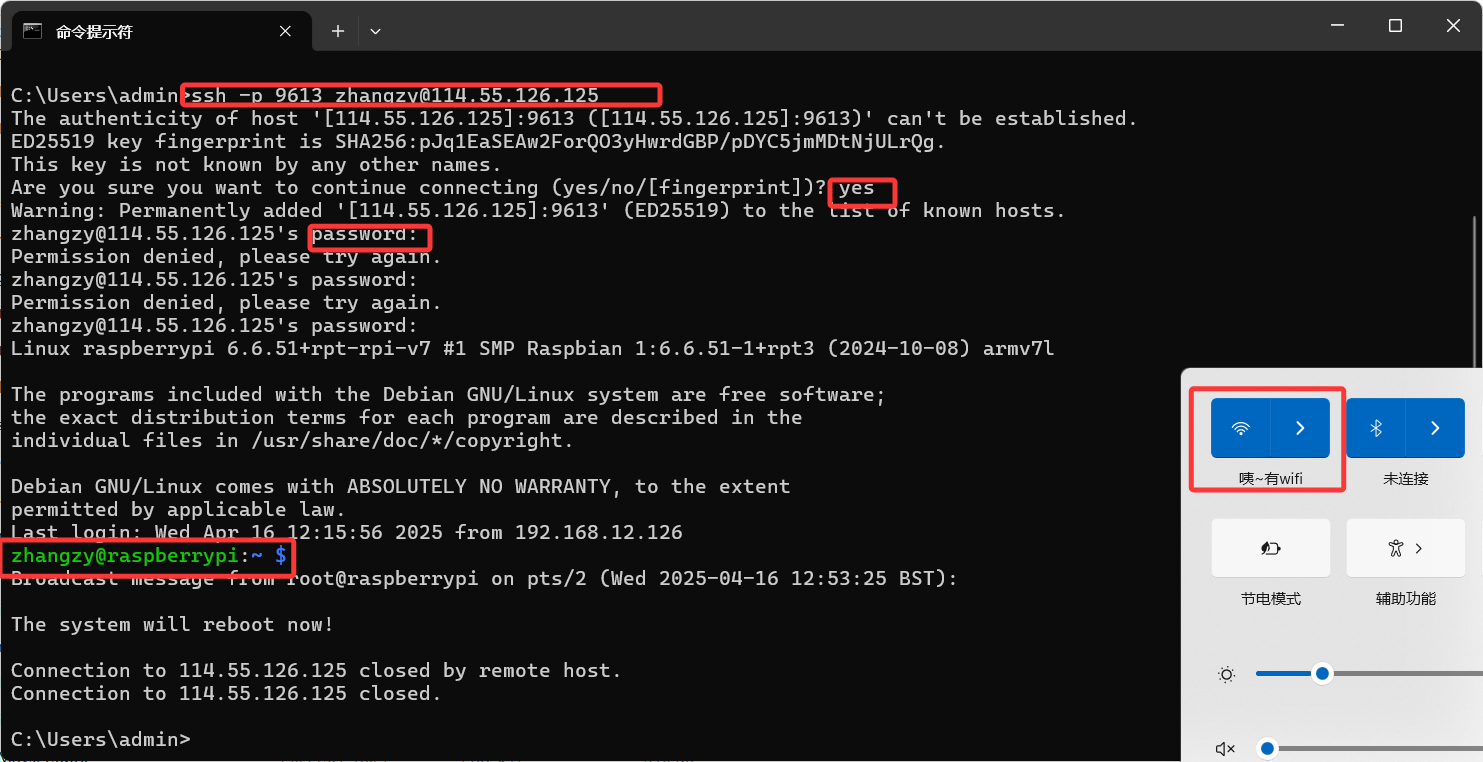

1.Transformer 编码器整体结构

Transformer 编码器的结构相对直观:它由 N 个完全相同的编码器层 (Encoder Layer) 堆叠而成。

图1: Transformer 编码器整体结构示意图 (简化)

输入序列(例如,通过 embedding 层转换后的词向量)首先会加上位置编码,然后传入第一个编码器层。第一个编码器层的输出作为第二个编码器层的输入,以此类推,直到最后一个编码器层输出最终的编码表示。

这种堆叠结构允许模型在每一层逐步提取和精炼输入的特征,捕获不同抽象层次的依赖关系。

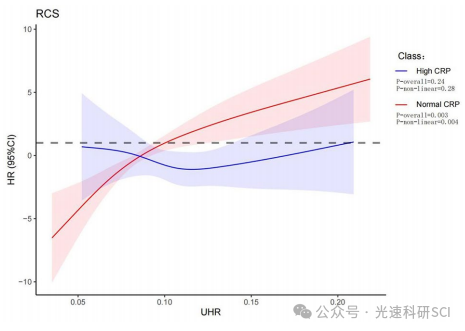

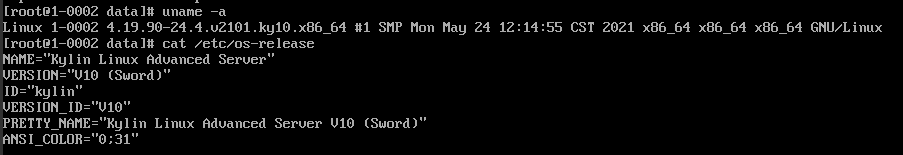

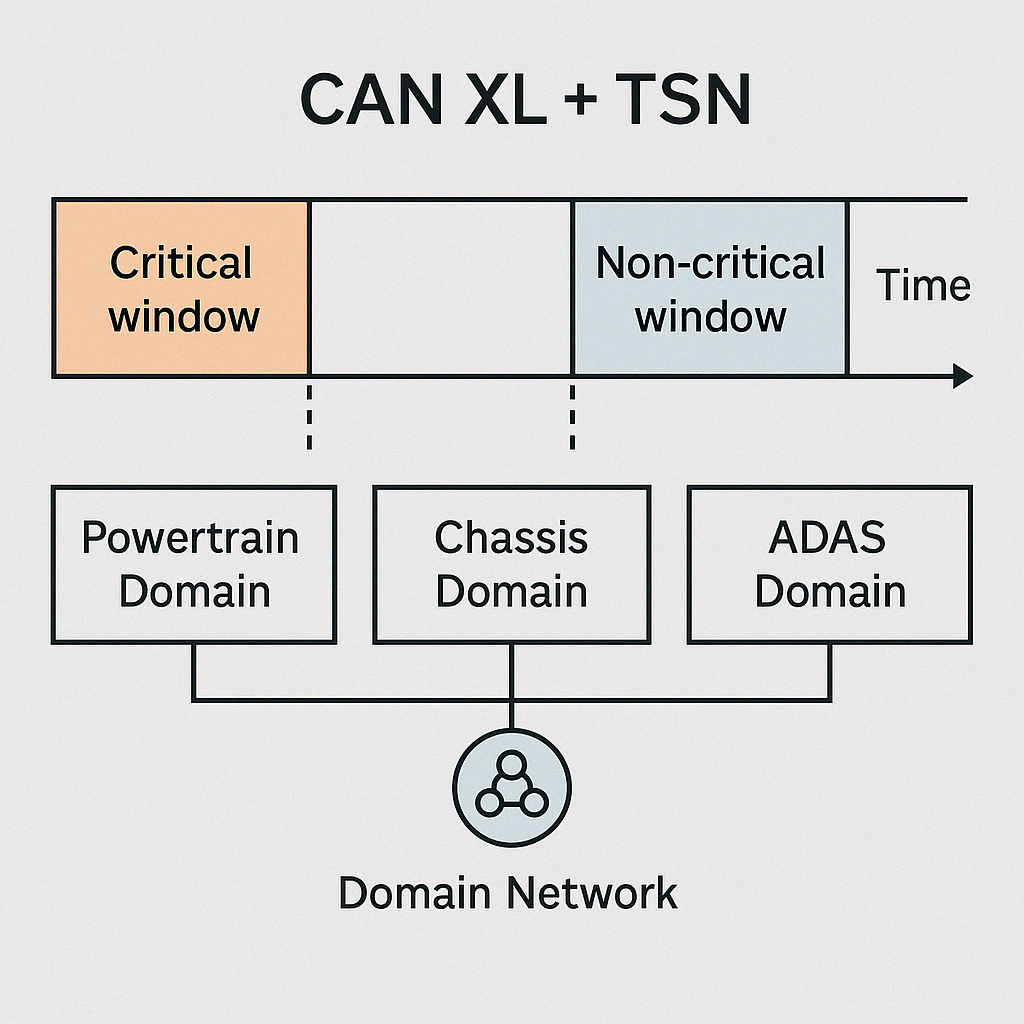

2. 深入编码器层内部

每个编码器层内部结构是相同的,它主要包含两个核心的子层:

- 多头自注意力机制 (Multi-Head Self-Attention)

- 位置前馈神经网络 (Position-wise Feed-Forward Network)

每个子层后面都跟着一个 残差连接 和一个 层归一化 步骤。

图2: Transformer 编码器层内部结构示意图

下面我们分别详细介绍这两个核心组件。

![STM32单片机入门学习——第40节: [11-5] 硬件SPI读写W25Q64](https://i-blog.csdnimg.cn/direct/a8d908602f5a417ba564991076396886.png)