这里写自定义目录标题

- 前言

- 一、自注意力:Transformer 的核心

-

- 1.1 多头注意力机制的实现

- 1.2 缩放点积注意力

- 1.3 掩码和序列处理

- 1.4 自注意力示例

- 二、位置编码:为序列添加位置信息

-

- 2.1 位置编码的实现

- 2.2 可视化位置编码

- 总结

前言

深度学习近年来在自然语言处理、计算机视觉等领域取得了巨大成功,而 Transformer 模型无疑是其中的明星架构。自注意力和位置编码作为 Transformer 的两大核心组件,不仅赋予了模型强大的序列建模能力,还推动了 BERT、GPT 等模型的广泛应用。然而,理解这些概念的理论公式往往令人望而生畏,直接从代码入手则能让学习过程更加直观和有趣。

在这篇博客中,我们将基于 PyTorch,通过分析提供的代码文件(utils_for_huitu.py、MultiHeadAttention.py 以及一个 Jupyter 笔记本),深入探讨自注意力机制和位置编码的实现细节。从多头注意力的矩阵运算到位置编码的正弦余弦设计,我们将一步步拆解代码,揭示 Transformer 的工作原理。同时,通过可视化工具,我们将直观展示这些机制的内部表示,帮助读者建立对深度学习模型的感性认知。

无论你是深度学习初学者,还是希望通过代码加深对 Transformer 理解的开发者,这篇文章都将为你提供一个清晰的学习路径。让我们一起从代码中发现深度学习的魅力吧!

完整代码:下载链接

一、自注意力:Transformer 的核心

自注意力机制(Self-Attention)是 Transformer 模型的基础,它允许模型在处理序列数据时动态地关注输入序列的不同部分。这种机制在自然语言处理任务(如 BERT、GPT)中表现尤为出色。让我们从代码入手,探索自注意力机制的具体实现。

1.1 多头注意力机制的实现

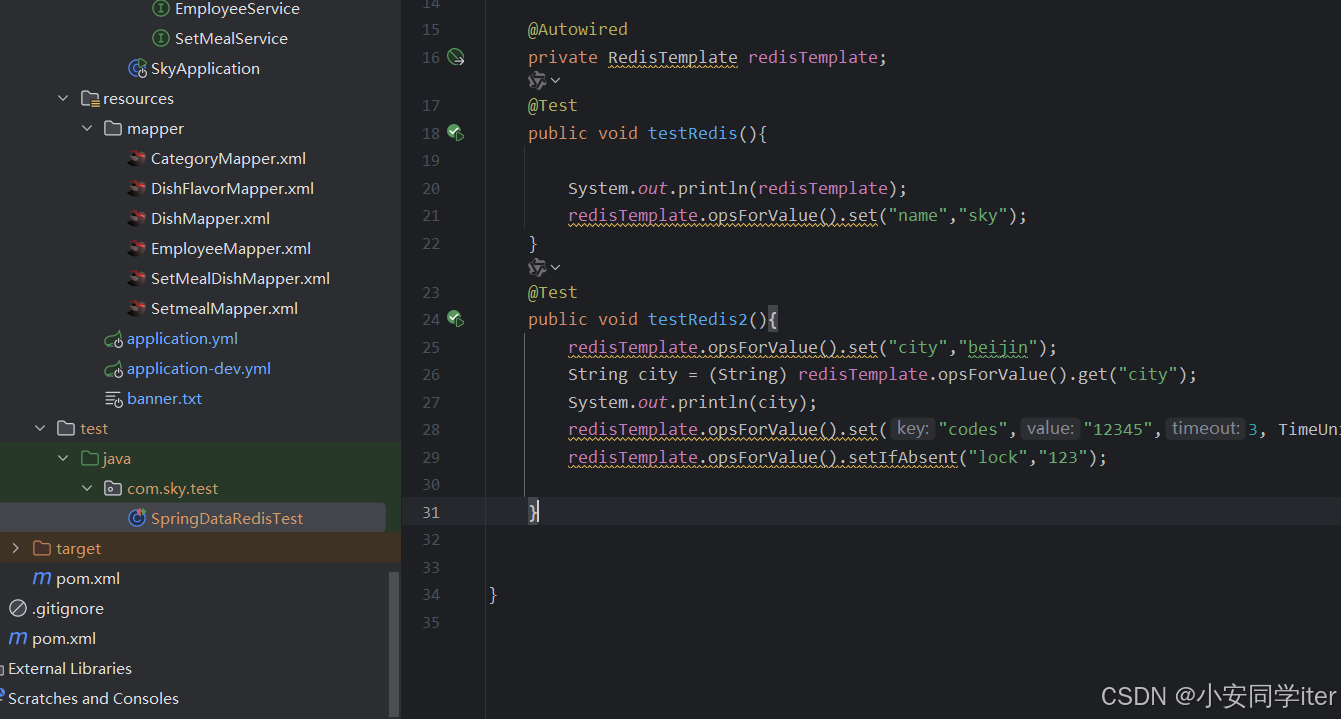

MultiHeadAttention.py 文件中的 MultiHeadAttention 类实现了多头注意力机制,通过并行计算多个注意力头来增强模型的表达能力。以下是代码的核心部分:

import math

import torch

from torch import nn

import torch.nn.functional as F

class MultiHeadAttention(nn.Module):

"""多头注意力机制"""

def __init__(self, key_size, query_size, value_size, num_hiddens,

num_heads, dropout, bias=False, **kwargs):

super(MultiHeadAttention, self).__init__(**kwargs)

self.num_heads = num_heads

self.attention = DotProductAttention(dropout)

self.W_q = nn.Linear(query_size, num_hiddens, bias=bias)

self.W_k = nn.Linear(key_size, num_hiddens, bias=bias)

self.W_v = nn.Linear(value_size, num_hiddens, bias=bias)

self.W_o = nn.Linear(num_hiddens, num_hiddens, bias=bias)

def forward(self, queries, keys, values, valid_lens):

queries = transpose_qkv(self.W_q(queries), self.num_heads)

keys = transpose_qkv(self.W_k(keys), self.num_heads)

values = transpose_qkv(self.W_v(values), self.num_heads)

if valid_lens is not None:

valid_lens = torch.repeat_interleave(

valid_lens, repeats=self.num_heads, dim=0)

output = self.attention(queries, keys, values, valid_lens)

output_concat = transpose_output(output, self.num_heads)

return self.W_o(output_concat)

代码解析:

- 初始化

![[OS] mmap | fd是什么 | inode机制 | vfs封装](https://i-blog.csdnimg.cn/img_convert/8cf61529d3a6d4a5fd4cf662d891dd48.png)