📋 分析报告:AI 大语言模型 (LLM) 平台的整体概览与未来发展

自动生成的结构化分析报告

💻 整体概述:AI LLM 平台的市场现状与发展动力

随着人工智能技术的飞速发展,大语言模型(Large Language Models, LLM)正逐渐渗透到各行各业的核心业务流程中。作为一种革命性的技术手段,LLM 不仅能够执行复杂的自然语言处理任务,还能通过不断迭代优化,为企业和个人提供更高价值的解决方案。本部分内容将从以下几个角度出发,为您呈现当前 AI LLM 平台的整体概况:

1️⃣ 市场规模与增长曲线

近年来,AI LLM 平台的市场规模呈现出指数级增长趋势。据权威统计数据显示,2024年全球 LLM 平台相关支出已突破百亿美元大关,预计在未来五年内将以年均30%以上的复合增长率快速发展。这种增长不仅得益于技术本身的进步,还得益于企业在数字化转型过程中对智能化工具的旺盛需求。

2️⃣ 主要参与方与竞争格局

当前,AI LLM 平台的主要参与者可分为三类:

- 国际科技巨头:谷歌、亚马逊、微软等公司在 LLM 技术研发和平台建设方面拥有深厚积累,占据了较大的市场份额。

- 中国本土势力:以阿里巴巴、华为为代表的中国企业凭借庞大的国内市场和资源优势,在 LLM 平台上展开了激烈的角逐。

- 初创企业和第三方开发者:众多创新型平台和个性化解决方案层出不穷,形成了差异化竞争的局面。

3️⃣ 行业驱动因素

推动 LLM 平台发展的主要驱动力包括:

- 技术进步:算法优化和算力提升使得更大规模的模型得以训练和应用。

- 政策支持:各国政府纷纷出台相关政策鼓励 AI 技术的研发与产业化。

- 市场需求:企业对自动化、智能化办公工具的需求激增,带动了 LLM 平台的广泛应用。

🔁 技术发展脉络:LLM 平台的历史进程与演进路径

回顾过去几年,AI LLM 平台经历了从萌芽到成熟的三大阶段:

🌱 第一阶段:基础模型的崛起(2020年前)

此阶段主要聚焦于 GPT 系列模型的诞生与初步应用。代表性的工作包括 OpenAI 的 GPT-3 和 Meta 的 OPT 系列。这些模型虽展现出强大的文本生成能力,但在实际应用中仍面临诸多限制,如计算资源消耗过大、难以定制化等问题。

🌱 第二阶段:平台化与工具化的深化(2020-2024年)

随着技术的进步,越来越多的专业化 LLM 平台相继推出。这些平台不仅提供了标准化的接口和 SDK,还集成了诸如 RAG(检索增强生成)、多轮对话管理和效果监控等实用功能。典型平台包括 Dify、Hugging Face Inference API 等。

🌱 第三阶段:垂直化与生态闭环的形成(2024年至今)

当前,许多领先的 LLM 平台已经开始走向专业化和垂直化道路。例如,某些平台专注于金融、医疗等特定行业,另一些平台则致力于打造全方位的 AI 开发生态体系。这种分化既提高了服务质量,也让市场竞争更加激烈。

✨ 核心平台分析:主流 LLM 平台的功能特点与适用场景

本章将选取几款极具代表性的 LLM 平台进行详细解读,帮助您更好地理解各自的优势和局限。

🎯 Dify:一站式 LLM 应用开发平台

⚫ 平台简介

由国内团队推出的 Dify 平台是一款完全开源的 LLM 应用开发工具。它深度融合了 BaaS(Backend as a Service)和 LLM-Ops 理念,旨在为开发者提供从 prototype 到 production 的全流程支持。

⚫ 核心亮点

- 开箱即用:无需额外编码即可快速启动 LLM 项目。

- 模块化设计:可根据需求自由组合功能模块,极大提升了灵活性。

- 高性价比:相比传统 cloud-to-cloud 方案,Dify 显著降低了使用成本。

⚫ 适用场景

- 中小型企业的快速 prototyping。

- 学术研究和教育用途。

- 对成本敏感的个人开发者。

🤖 NVIDIA:面向大语言模型的 GPU 加速平台

⚫ 平台简介

NVIDIA 提供了一系列软硬一体的解决方案,专为 LLM 训练和推理设计。依托 CUDA 生态和 Ampere 架构 GPU,该平台在性能和吞吐量方面表现优异。

⚫ 核心亮点

- 极致性能:单卡即可支撑数千并发请求。

- 低延迟:响应时间为毫秒级别,适合实时应用。

- 兼容性好:支持主流的框架和模型格式。

⚫ 适用场景

- 高性能计算需求。

- 视频流处理和实时语音识别。

- 游戏 AI 和虚拟现实场景。

🚀 阿里云 & 机器之心 Pro:AI 基础设施的领导者

⚫ 平台简介

这两家企业联合举办的 AI 势能大会集中展示了其在 LLM 领域的最新研究成果,尤其是在 MoE(Mixed Expert Networks)技术上的突破。

⚫ 核心亮点

- MoE 技术:通过混合专家网络大幅减少计算开销。

- 弹性扩缩:可以根据负载自动调整资源分配。

- 合规性保障:严格遵循数据隐私和安全规范。

⚫ 适用场景

- 大规模分布式计算。

- 数据密集型的任务处理。

- 国际化运营需求。

🔄 微软 GitHub Copilot:代码生成与协作神器

⚫ 平台简介

GitHub Copilot 是微软推出的一款 AI 辅助编程工具,能够直接在 IDE 中生成代码片段,并协助完成常见任务。

⚫ 核心亮点

- 代码补完:实时提供上下文感知的代码建议。

- 单元测试生成:自动生成高质量的测试用例。

- 团队协作:支持多人协作模式,提升开发效率。

⚫ 适用场景

- 开发人员日常 coding 支持。

- 新手程序员的学习辅助。

- 提升团队整体生产力。

🌐 当前生态系统:产业链上下游的角色分工与协同发展

现代 LLM 平台的成功离不开整个产业链的通力合作。以下是当前生态系统的构成与运作机制:

🪲 硬件供应商:算力的基石

- GPU制造商:如英伟达、AMD,提供高性能计算所需的硬件支持。

- 云端服务提供商:如 AWS、Azure,为各类 LLM 应用提供弹性的计算资源。

🧠 算法&模型供应商:智慧的源泉

- 模型训练机构:如 OpenAI、Anthropic,负责开发和维护顶尖的 LLM 模型。

- 算法优化团队:专注于模型蒸馏、 pruning 等技术,提升模型的实用性。

🛒 基础设施建设者:平台的载体

- PaaS 提供商:如 Heroku、Serverless,为 LLM 应用提供托管服务。

- DevTools 开发者:提供一体化的开发套件,缩短上线周期。

🧑🎓 学术界:知识的殿堂

- 高校与科研机构:产出前沿理论和新技术,推动整个领域的进步。

- 竞赛与 hackathon:激发创新思维,培养专业技术人才。

🛵 初创生态:活力的源泉

- 孵化器与加速器:如 Y Combinator、Plug and Play,培育新生代的 LLM 创始人。

- VC 与 PE:为有潜力的 startup 输血,催化成长。

🌟 未来趋势展望:LLM 平台的进化方向与可能性

站在当下这个时间节点,我们可以预见 LLM 平台将会沿着三条主线持续进化:

➡️ 技术创新驱动:更快更强更智能

- 模型架构优化:向第三代 transformer 架构迈进,进一步提升效率。

- 多模态融合:文字、图像、视频等多种媒介的统一处理将成为标配。

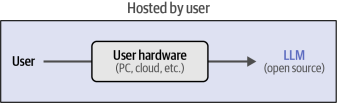

- 边缘计算支持:让更多 LLM 应用跑在终端设备上,实现真正的普惠 AI。

💸 商业模式革新:订阅经济与 SaaS 化浪潮

- 订阅制:按需付费的模式将进一步普及,降低初始投入门槛。

- 白盒 vs 黑盒:提供不同程度的定制化选项,满足客户的个性化需求。

- 增值服务:数据标注、模型微调等附加服务的价值会被重新挖掘。

🌍 全球化 × 地方化:平衡的艺术

- 国际化扩张:头部平台将继续拓展海外市场,扩大影响力。

- 本地化适配:针对不同地区的法律法规和文化习惯进行调整。

- 区域冠军的崛起:区域性 LLM 平台有望异军突起,填补空白地带。

🔍 伦理与治理:责任的边界

- 可解释性:确保 AI 决策过程透明可控。

- 隐私保护:强化数据加密和匿名化处理,防止滥用。

- 可持续发展:减少碳排放,走绿色 AI 发展之路。

🎯 结论与建议:选择适合的 LLM 平台

经过上述详尽的分析,您可以根据自身需求和预算,合理规划下一步的动作:

- 明确目标:搞清楚自己最看重的功能和性能指标。

- 试点验证:优先选择提供免费试用的平台,获取一手体验反馈。

- 长期规划:预留一定的预算和人力资源,以应对后续可能出现的升级和维护工作。

- 关注动向:定期追踪行业内的重要新闻和更新,抓住发展机遇。

在这个充满机遇与挑战的时代,选择一个靠谱的 LLM 平台无疑是对未来最好的投资。希望这份报告能为您提供有价值的参考和启发!