MoE Align & Sort技术通过优化混合专家模型(MoE)的路由与计算流程,在医疗数据处理、模型推理效率及多模态任务协同中展现出显著优势,其技术价值与应用意义从以下三方面展开分析:

一、方向分析

1、提升医疗数据处理效率

在医疗场景中,多模态数据(如医学影像、文本报告、传感器信号等)的高效处理是关键挑战。Med-MoE模型通过多模态医学对齐与域特定MoE调整,将医学图像与文本数据对齐,结合专家模型的领域特异性,显著提升了医学信息的融合与分析能力。MoE Align & Sort技术在此过程中通过按专家ID排序tokens,优化了多模态数据的路由分配,减少了冗余计算。例如,在医学影像诊断任务中,该技术可快速将CT/MRI图像特征与病历文本路由至对应的视觉或语言专家模块,实现精准分析,避免计算资源浪费。

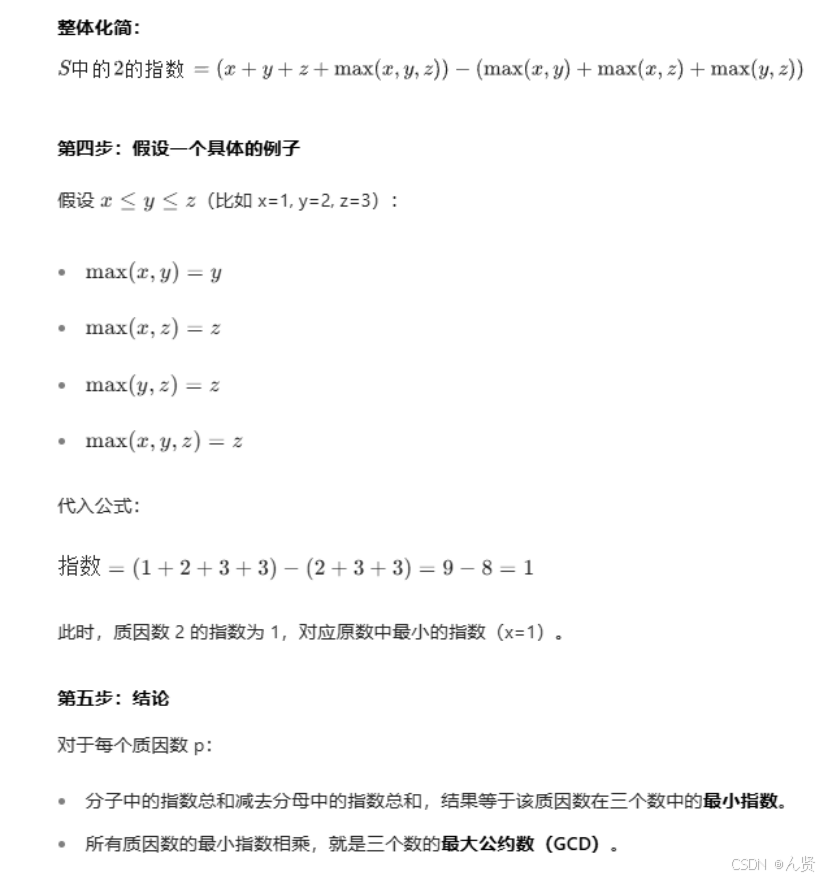

2、加速模型推理速度

MoE模型的稀疏计算特性依赖高效的专家分配与并行计算。MoE Align & Sort通过基数排序(radix sort)逻辑,将输入数据按专家ID排序,使计算任务能更高效地分配到GPU的并行处理单元中。AMD的实验证明,该技术可使MoE模型推理速度提升7倍,显著降低延迟。在医疗场景中,这一特性对实时性要求高的任务(如急诊影像分析、手术导航)至关重要。

3、增强多模态任务协同能力

传统多模态模型因参数规模庞大,难以在医疗场景中灵活处理多样化任务(如图像分类、文本生成、动作控制)。MoE架构通过共享注意力层跨任务知识迁移与独立MLP层保留任务特异性,结合Align & Sort技术的高效路由机制,实现了多模态任务间的协同优化。例如,ChatVLA模型通过MoE架构,同时处理视觉、语言和机器人动作指令,在手术机器人控制任务中表现出色。

以下是一个针对医疗信息化场景的 MoE Align & Sort 技术编程实施概要方案,从架构设计、核心代码实现到部署优化的完整技术路线:

二、系统架构设计

2.1 医疗多模态MoE模型架构(Med-MoE)

import torch

import torch.nn as nn

from transformers import AutoModel

class MedicalMoE(nn.Module):

def __init__(self, num_experts=4):

super().__init__()

# 定义不同模态的专家模块

self.experts = nn.ModuleDict({

"ct_radiology": AutoModel.from_pretrained("microsoft/resnet-50-radiology"), # 影像专家

"emr_nlp": AutoModel.from_pretrained("emilyalsentzer/Bio_ClinicalBERT"), # 文本专家

"surgical_video": nn.Conv3d(3, 64, kernel_size=(3,7,7)), # 手术视频专家

"genomics": nn.LSTM(input_size=128, hidden_size=256) # 基因组专家

})

# MoE门控网络(Gating Network)

self.gate = nn.Sequential(

nn.Linear(512, 256), # 输入特征维度需统一

nn.ReLU(),

nn.Linear(256, num_experts),

nn.Softmax(dim=-1)

def forward(self, inputs):

# Step 1: 动态路由 - 获取各专家权重

gate_weights = self.gate(inputs["shared_features"]) # [batch_size, num_experts]

# Step 2: MoE Align & Sort 核心逻辑

expert_outputs = []

for expert_name, expert in self.experts.items():

# 仅处理权重>阈值的输入(Top-k路由)

mask = (gate_weights[:, self.experts.keys().index(expert_name)] > 0.1)

if mask.any():

aligned_inputs = align_inputs(inputs[expert_name], mask) # 对齐函数

expert_outputs.append(expert(aligned_inputs))

# Step 3: 加权输出聚合

return torch.stack(expert_outputs) * gate_weights.unsqueeze(-1)

2.2 Align & Sort 关键优化层(CUDA实现)

// 基于AMD ROCm的基数排序内核(关键性能优化)

__global__ void radix_sort_kernel(int* expert_ids, float* gate_weights, int n) {

__shared__ int shared_bucket[256];

// 1. 按专家ID分桶(基数排序)

for (int bit = 0; bit < 8; bit++) {

int mask = 1 << bit;

// ... 基数排序具体实现(省略)

}

// 2. 对齐内存访问模式

for (int i = blockIdx.x; i < n; i += gridDim.x) {

if (gate_weights[i] > 0.1f) {

expert_ids[i] = __shfl_sync(0xFFFFFFFF, expert_ids[i], i % 32);

}

}

}

三、典型场景实现方案

3.1:基层医院影像-文本联合分析(Med-MoE)

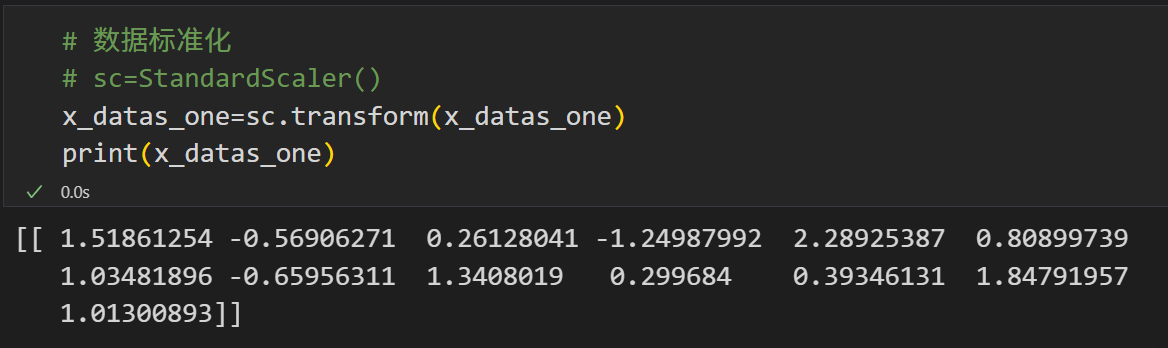

# 输入预处理示例

def preprocess_medical_data(ct_image, clinical_note):

# 影像特征提取(路由至ResNet专家)

ct_features = vision_processor(ct_image)

# 文本特征提取(路由至ClinicalBERT专家)

text_features = text_tokenizer(clinical_note, return_tensors="pt")

# MoE动态路由执行

with torch

![[ deepseek 指令篇章 ]300个领域和赛道喂饭级deepseek指令](https://i-blog.csdnimg.cn/direct/c1b3d76f12a4452a9d68a3807a9e027b.png)