ComfyUi教程之阿里的万象2.1视频模型

- 官网

- Wan 2.1 特点

- 一、本地安装

- 1.1克隆仓库

- 1.2 安装依赖

- (1.3)下载模型

- (1.4)CUDA和CUDNN

- 二、 使用体验

- (2.1)官方例子

- (2.2)执行过程

- (2.3)执行结果

- 三、ComfyUi使用wan2.1

- 文生视频示例

- 图生视频示例

引用:2月25日晚间,阿里云旗下视觉生成基座模型万相2.1(Wan)正式开源,此次开源采用最宽松的Apache2.0协议,14B和1.3B两个参数规格的全部推理代码和权重全部开源,同时支持文生视频和图生视频任务。

官网

https://tongyi.aliyun.com

本地部署之前可以在线体验。 在线可以图生视频呢。

Wan 2.1 特点

- 支持消费级 GPU:T2V-1.3B 型号仅需 8.19 GB VRAM,几乎兼容所有消费级 GPU。它可以在大约 5 分钟内在 RTX 4090 上生成一个 4 秒的 480P 视频(无量化)。

- 多任务:Wan 2.1 擅长文本到视频(T2V)、图像到视频(I2V)、视频编辑、文本到图像和视频到音频,推动了视频生成领域的发展。

- 视觉文本生成:Wan 2.1 是第一个能够同时生成中文和英文文本的视频模型。

- 强大的视频 VAE:Wan-VAE 提供卓越的效率和性能,对任意长度的 1080P 视频进行编码和解码,同时保留时间信息,使其成为视频和图像生成的理想基础。

一、本地安装

博主先介绍本地部署wan2.1, 若只关注comfyui如何使用wan,可以直接忽略,跳到第四章

1.1克隆仓库

和其它开源项目类似,先克隆代码仓库。

git clone https://github.com/Wan-Video/Wan2.1.git

cd Wan2.1

1.2 安装依赖

国内环境先把Python换成国内源。 最好还是先建个虚拟环境。

python -m venv wan

#激活

wan\Scripts\activate

按照下面官方的方式直接装是不会成功的。

# Ensure torch >= 2.4.0

pip install -r requirements.txt

(1.2.1)安装 flash-attention

依赖中有flash_attn这项,没指定版本,安装依赖时编译轮子总是失败。

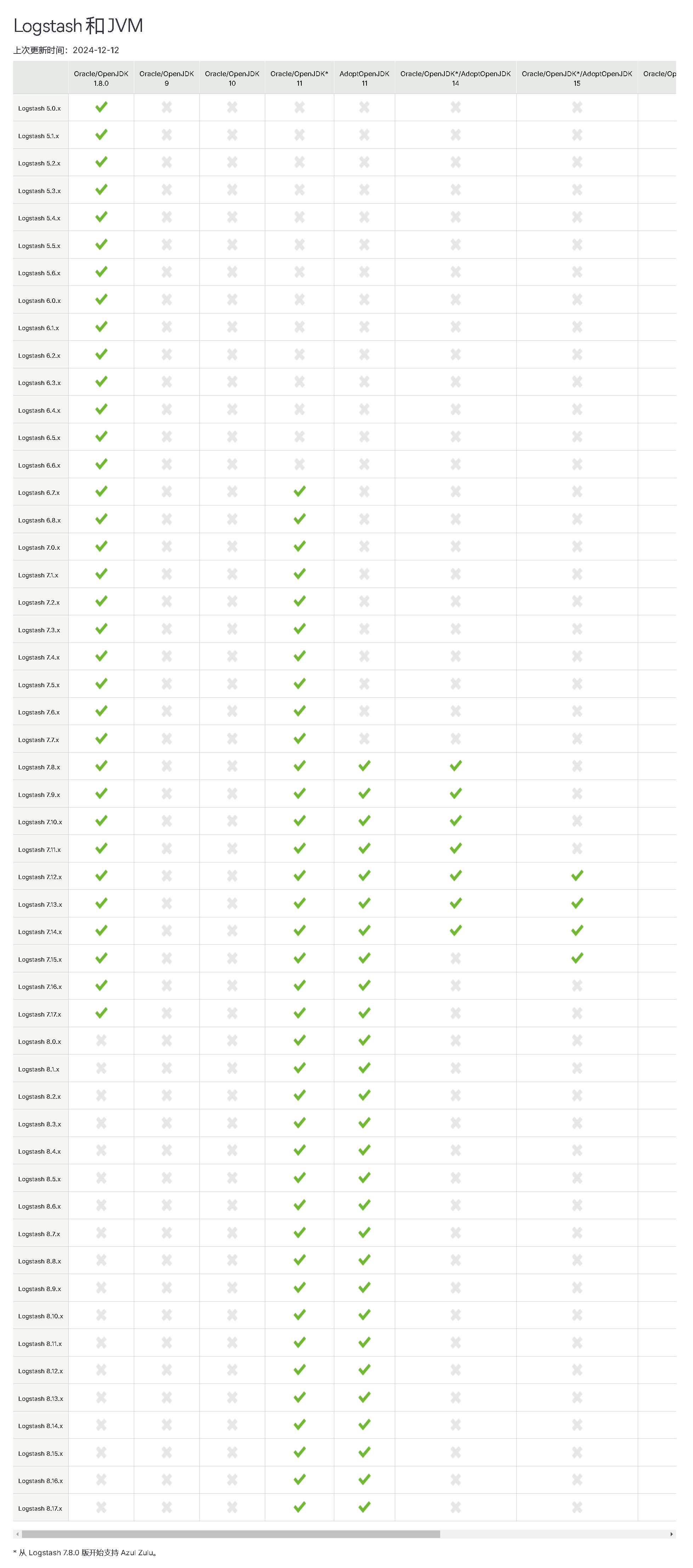

查询其官方的二进制发布后发现最新版是v2.7.4.post1,且只有Linux版本。 发现第三方有flash_attn-2.7.4.post1+cu124torch2.6.0cxx11abiFALSE-cp310-cp310-win_amd64.whl,下载后手动安装。

pip install "flash_attn-2.7.4.post1+cu124torch2.6.0cxx11abiFALSE-cp310-cp310-win_amd64.whl"

记下来这两个cu124,以及torch2.6.0。

(1.2.2)重新安装依赖

这时候我们有flash-attention了,直接安装requirements.txt吧。

(wan) > pip install -r requirements.txt

(1.2.3)替换pytorch成CUDA版本

国内环境先把Pytorch换成国内源,或手动下载安装。

先查看gpu驱动版本, 博主使用的是cuda_12.8。 第一次跑, 因为未安装正确的版本报错。

(wan) G:\ai\Wan2.1>nvcc --version

nvcc: NVIDIA (R) Cuda compiler driver

Copyright (c) 2005-2025 NVIDIA Corporation

Built on Wed_Jan_15_19:38:46_Pacific_Standard_Time_2025

Cuda compilation tools, release 12.8, V12.8.61

Build cuda_12.8.r12.8/compiler.35404655_0

那么到pytorch官网检查适合版本 https://pytorch.org/get-started/locally/

复制它自动生成的下载连接 ,执行。

(wan) > pip uninstall torch torchvision

......

(wan) > pip install --pre torch torchvision torchaudio --index-url https://download.pytorch.org/whl/nightly/cu128

(1.3)下载模型

按照新闻上的说法,本地能部署Wan2.1-T2V-1.3B模型。 国内环境请换huggingface源,或手动去hf-mirror下载。

使用huggingface-cli:

(wan) > pip install "huggingface_hub[cli]"

(wan) > huggingface-cli download Wan-AI/Wan2.1-T2V-1.3B --local-dir ./Wan2.1-T2V-1.3B

(wan) > huggingface-cli download Wan-AI/Wan2.1-T2V-14B --local-dir ./Wan2.1-T2V-14B

使用魔搭modelscope-cli:

pip install modelscope

modelscope download Wan-AI/Wan2.1-T2V-14B --local_dir ./Wan2.1-T2V-14B

(1.4)CUDA和CUDNN

因为之前接触的项目都是CUDA11,所以我这部分也都得重装一次。 如果已经是CUDA12则无视。

- CUDA Toolkit 12 官网地址。

- CUDNN 下载地址。

请注意版本号对应。 正常都会向下兼容,所以我用了最新的CUDA12.8。

(1.4.1)CUDA Toolkit 12.8 和 Visual Studio 2022 v17.13.0 冲突

安装程序进度条会在nsight visual studio edition卡住。 且不报错,请参考。

看到不是我一个人的问题,就放心了。 神仙打架,我等绕过吧。

二、 使用体验

(2.1)官方例子

两只拟人的猫咪穿着舒适的拳击装备,戴着鲜艳的拳击手套,在聚光灯照亮的舞台上激烈搏斗。

官网说 单GPU

(wan) > python generate.py --task t2v-1.3B --size 832*480 --ckpt_dir ./Wan2.1-T2V-1.3B --prompt "Two anthropomorphic cats in comfy boxing gear and bright gloves fight intensely on a spotlighted stage."

(wan) > python generate.py --task t2v-14B --size 1280*720 --ckpt_dir ./Wan2.1-T2V-14B --prompt "Two anthropomorphic cats in comfy boxing gear and bright gloves fight intensely on a spotlighted stage."

喝完一杯茶, 发现报错啦

(wan) G:\ai\Wan2.1>python generate.py --task t2v-1.3B --size 832*480 --ckpt_dir ./Wan2.1-T2V-1.3B --prompt "Two anthropomorphic cats in comfy boxing gear and bright gloves fight intensely on a spotlighted stage."

Traceback (most recent call last):

File "G:\ai\Wan2.1\generate.py", line 15, in <module>

import wan

File "G:\ai\Wan2.1\wan\__init__.py", line 1, in <module>

from . import configs, distributed, modules

File "G:\ai\Wan2.1\wan\modules\__init__.py", line 1, in <module>

from .attention import flash_attention

File "G:\ai\Wan2.1\wan\modules\attention.py", line 11, in <module>

import flash_attn

File "G:\ai\Wan2.1\wan\lib\site-packages\flash_attn\__init__.py", line 3, in <module>

from flash_attn.flash_attn_interface import (

File "G:\ai\Wan2.1\wan\lib\site-packages\flash_attn\flash_attn_interface.py", line 15, in <module>

import flash_attn_2_cuda as flash_attn_gpu

ImportError: DLL load failed while importing flash_attn_2_cuda: 找不到指定的模块。

分析是flash与gpu、pytorch不兼容

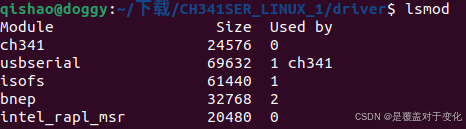

先查看gpu驱动版本

(wan) G:\ai\Wan2.1>nvcc --version

nvcc: NVIDIA (R) Cuda compiler driver

Copyright (c) 2005-2025 NVIDIA Corporation

Built on Wed_Jan_15_19:38:46_Pacific_Standard_Time_2025

Cuda compilation tools, release 12.8, V12.8.61

Build cuda_12.8.r12.8/compiler.35404655_0

检查pytorch版本

编写文件pytorcha.py,内容如下

import torch

print(torch.__version__)

(wan) G:\ai\Wan2.1>python pytorcha.py

2.6.0+cpu

发现博主安装的pytorcha是cpu版本, 重新安装

检查pytorch与博主电脑gpu的版本, https://pytorch.org/get-started/locally/

(wan) > pip uninstall torch torchvision

......

(wan) > pip install torch torchvision --index-url https://download.pytorch.org/whl/nightly/cu128

pip3 install --pre torch torchvision torchaudio --index-url https://download.pytorch.org/whl/nightly/cu128

官网还说

当运行深度学习模型(尤其是大规模模型)时,可能会遇到内存不足(OOM,Out-of-Memory)问题,即 GPU 在加载和处理模型时耗尽内存。

–offload_model True

该选项用于将模型的部分内容从 GPU 内存转移到 CPU 内存或磁盘。启用后,系统会动态将部分模型参数和中间计算结果转移到内存压力较小的位置,从而降低 GPU 的内存占用。

–t5_cpu

此选项可能针对模型中的 T5 组件(如模型包含 T5 架构部分),强制将 T5 相关计算迁移到 CPU 执行。这进一步减少了 GPU 的负担。

(wan) > python generate.py --task t2v-1.3B --size 832*480 --ckpt_dir ./Wan2.1-T2V-1.3B --offload_model True --t5_cpu --sample_shift 8 6 --prompt "Two anthropomorphic cats in comfy boxing gear and bright gloves fight intensely on a spotlighted stage."

(2.2)执行过程

[2025-02-26 19:54:53,860] INFO: offload_model is not specified, set to True.

[2025-02-26 19:54:53,860] INFO: Generation job args: Namespace(task='t2v-1.3B', size='832*480', frame_num=81, ckpt_dir='./Wan2.1-T2V-1.3B', offload_model=True, ulysses_size=1, ring_size=1, t5_fsdp=False, t5_cpu=False, dit_fsdp=False, save_file=None, prompt='Two anthropomorphic cats in comfy boxing gear and bright gloves fight intensely on a spotlighted stage.', use_prompt_extend=False, prompt_extend_method='local_qwen', prompt_extend_model=None, prompt_extend_target_lang='ch', base_seed=2819604094901642957, image=None, sample_solver='unipc', sample_steps=50, sample_shift=5.0, sample_guide_scale=5.0)

[2025-02-26 19:54:53,860] INFO: Generation model config: {'__name__': 'Config: Wan T2V 1.3B', 't5_model': 'umt5_xxl', 't5_dtype': torch.bfloat16, 'text_len': 512, 'param_dtype': torch.bfloat16, 'num_train_timesteps': 1000, 'sample_fps': 16, 'sample_neg_prompt': '色调艳丽,过曝,静态,细节模糊不清,字幕,风格,作品,画作,画面,静止,整体发灰,最差质量,低质量,JPEG压缩残留,丑陋的,残缺的,多余的手指,画得不好的手部,画得不好的脸部,畸形的,毁容的,形态畸形的肢体,手 指融合,静止不动的画面,杂乱的背景,三条腿,背景人很多,倒着走', 't5_checkpoint': 'models_t5_umt5-xxl-enc-bf16.pth', 't5_tokenizer': 'google/umt5-xxl', 'vae_checkpoint': 'Wan2.1_VAE.pth', 'vae_stride': (4, 8, 8), 'patch_size': (1, 2, 2), 'dim': 1536, 'ffn_dim': 8960, 'freq_dim': 256, 'num_heads': 12, 'num_layers': 30, 'window_size': (-1, -1), 'qk_norm': True, 'cross_attn_norm': True, 'eps': 1e-06}

[2025-02-26 19:54:53,860] INFO: Input prompt: Two anthropomorphic cats in comfy boxing gear and bright gloves fight intensely on a spotlighted stage.

[2025-02-26 19:54:53,860] INFO: Creating WanT2V pipeline.

[2025-02-26 19:55:26,106] INFO: loading ./Wan2.1-T2V-1.3B\models_t5_umt5-xxl-enc-bf16.pth

[2025-02-26 19:55:34,677] INFO: loading ./Wan2.1-T2V-1.3B\Wan2.1_VAE.pth

[2025-02-26 19:55:35,471] INFO: Creating WanModel from ./Wan2.1-T2V-1.3B

[2025-02-26 19:55:42,221] INFO: Generating video ...

40%|██████████████████████████████████████████████████████████████████████████████ | 20/50 [52:05<1:18:05, 156.18s/it]

我的电脑是

CPU:i9-12900FRAM:64GB显卡:4060Ti16GB

预计生成时间超过2个小时。😓 所以我才有时间把踩过的坑记录下来。

(2.3)执行结果

(2.3.1)默认文件名无法保存

等了2个多小时,最后一步保存文件失败了??? 仅仅是文件名的格式问题,蛤? 这小bug太折磨人了。

[2025-02-26 19:55:42,221] INFO: Generating video ...

100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████| 50/50 [2:02:40<00:00, 147.20s/it]

[2025-02-26 22:12:12,834] INFO: Saving generated video to t2v-1.3B_832*480_1_1_Two_anthropomorphic_cats_in_comfy_boxing_gear_and__20250226_221212.mp4

[out#0/mp4 @ 000002818aa85c40] Error opening output \t2v-1.3B_832*480_1_1_Two_anthropomorphic_cats_in_comfy_boxing_gear_and__20250226_221212.mp4: Invalid argument

Error opening output file \t2v-1.3B_832*480_1_1_Two_anthropomorphic_cats_in_comfy_boxing_gear_and__20250226_221212.mp4.

Error opening output files: Invalid argument

cache_video failed, error: result type Float can't be cast to the desired output type Byte

[2025-02-26 22:12:16,213] INFO: Finished.

(wan) >

(2.3.2)成功

两个小时又悄悄的过去了。 增加--save_file参数后OK。

[2025-02-26 22:26:56,407] INFO: Generating video ...

100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████| 50/50 [2:15:32<00:00, 162.64s/it]

[2025-02-27 00:43:17,461] INFO: Saving generated video to D:\TestIt.mp4

[2025-02-27 00:43:17,918] INFO: Finished.

(wan) >

本地部署阿里万象2.1文生视频(Wan2.1-T2V-1.3B)模型生成的示例

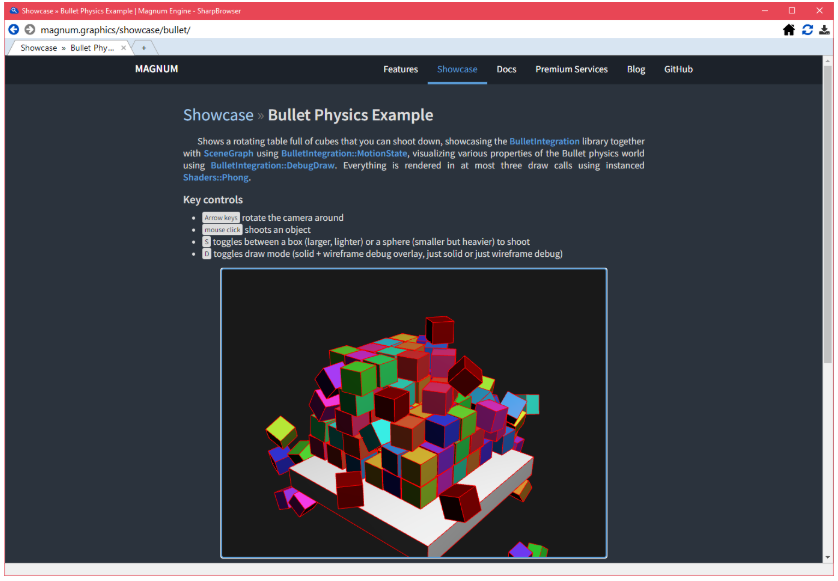

三、ComfyUi使用wan2.1

- 下载最小 ComfyUI

首先要把 ComfyUI 更新到最新版本:

- 秋叶启动器中将内核切换到最新版本。

- 官方便携包可以在管理器内更新 ComfyUI。

博主使用秋叶启动器,下载2小时,解压后先配置与旧版本共享模型文件夹

复制extra_model_paths.yaml.example-》extra_model_paths.yaml,

修改

a111:

base_path: G:\ai\sd-webui-aki\sd-webui-aki-v4.6# 以本机实际目录为准, 可以不改

启动“绘世启动器.exe”, 点击左侧“版本管理”,先“刷新列表”,立刻选择最新版本“切换”

更新完成后,启动。

- 下载模型

博主下载的版本很多, 所以建立公共文件夹, 以便不同版本的comfyui使用. 可选

旧文件夹暂时改名

mklink /d G:\ai\ComfyUI-aki\ComfyUI-aki-v1.6\ComfyUI\models\clip_vision G:\ai\ComfyUI-aki\models\clip_vision

mklink /d G:\ai\ComfyUI-aki\ComfyUI-aki-v1.6\ComfyUI\models\text_encoders G:\ai\ComfyUI-aki\models\text_encoders

mklink /d G:\ai\ComfyUI-aki\ComfyUI-aki-v1.6\ComfyUI\models\vae G:\ai\ComfyUI-aki\models\vae

mklink /d G:\ai\ComfyUI-aki\ComfyUI-aki-v1.6\ComfyUI\models\clip G:\ai\ComfyUI-aki\models\clip

mklink /d G:\ai\ComfyUI-aki\ComfyUI-aki-v1.6\ComfyUI\models\upscale_models G:\ai\ComfyUI-aki\models\upscale_models

mklink /d G:\ai\ComfyUI-aki\ComfyUI-aki-v1.6\ComfyUI\models\ipadapter G:\ai\ComfyUI-aki\models\ipadapter

mklink /d G:\ai\ComfyUI-aki\ComfyUI-aki-v1.6\ComfyUI\models\insightface G:\ai\ComfyUI-aki\models\insightface

mklink /d G:\ai\ComfyUI-aki\ComfyUI-aki-v1.6\ComfyUI\output G:\ai\ComfyUI-aki\output

大模型下载

地址:https://huggingface.co/Comfy-Org/Wan_2.1_ComfyUI_repackaged/tree/main/split_files/diffusion_models

放置路径:ComfyUI/models/diffusion_models ComfyUI/models/unet

说明:这个模型实在太大了,我这里就下载一个 1.3B 的文生视频模型作为测试。

CLIP 下载

地址:https://huggingface.co/Comfy-Org/Wan_2.1_ComfyUI_repackaged/resolve/main/split_files/clip_vision/clip_vision_h.safetensors?download=true

放置路径:ComfyUI/models/clip_vision

VAE 下载

地址:https://huggingface.co/Comfy-Org/Wan_2.1_ComfyUI_repackaged/resolve/main/split_files/vae/wan_2.1_vae.safetensors?download=true

放置路径:ComfyUI/models/vae

Text Encoders 下载

地址:https://huggingface.co/Comfy-Org/Wan_2.1_ComfyUI_repackaged/resolve/main/split_files/text_encoders/umt5_xxl_fp8_e4m3fn_scaled.safetensors?download=true

放置路径:ComfyUI/models/text_encoders

下载官网工作流 https://huggingface.co/Comfy-Org/Wan_2.1_ComfyUI_repackaged/

操作:将下载好的工作流拖入到 ComfyUI。

文生视频示例

用 1.3B 的模型速度还是非常快的,在 RTX 4090 上大概一分钟。在这么小的模型上有这种效果还是很不错的。

图生视频示例

来源于官网

实测

A beautiful young woman with flowing long hair, delicate facial features, and bright eyes dances gracefully. She wears a shimmering sequined dance dress that flows with her movements, paired with high heels. The scene is set in a dreamy stage with colorful spotlights—warm yellow beams highlighting her figure, and blue neon lights creating a vibrant atmosphere. Her body bends elegantly, one hand raised gracefully, the other trailing beside her, hips swaying rhythmically, legs stretching smoothly, showcasing professional dance postures like spins and lifts, exuding confidence and charm.

上传图片

得到结果, 虽然很慢, 不过电脑配置就这样,安啦