TransFormer--整合编码器和解码器

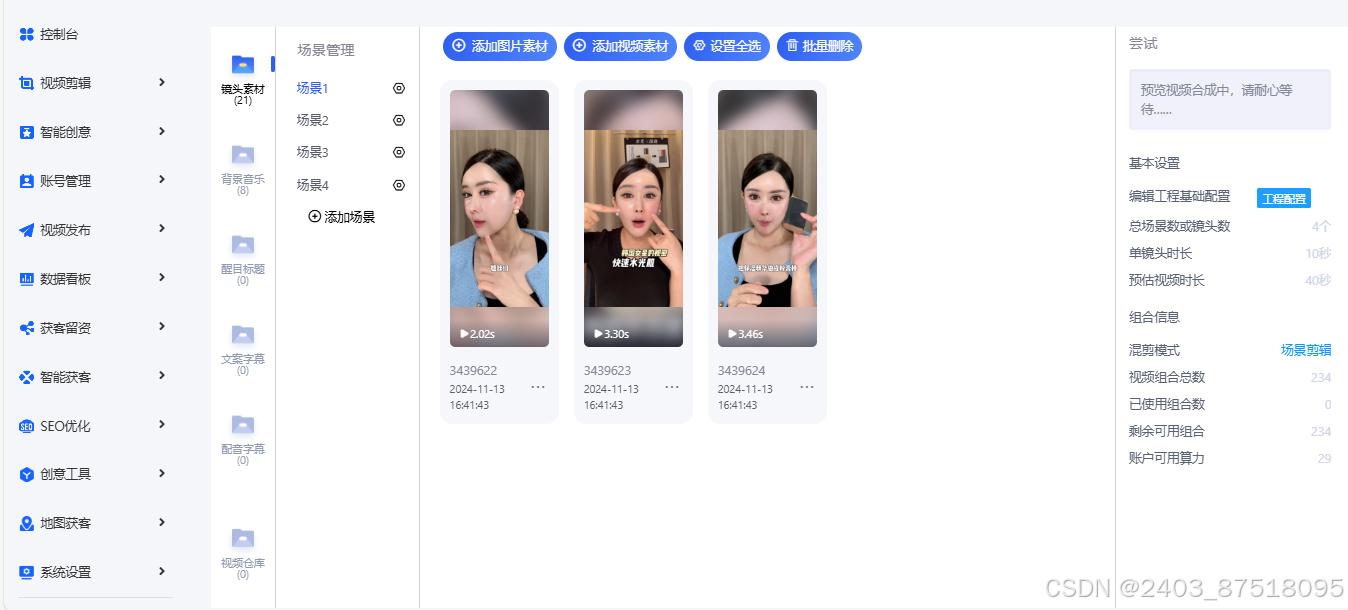

下图完整地展示了带有编码器和解码器的Transformer架构。

在图中,N×表示可以堆叠N个编码器和解码器。我们可以看到,一旦输入句子(原句),编码器就会学习其特征并将特征发送给解码器,而解码器又会生成输出句(目标句)。

我们首先了解了什么是Transformer模型,以及它是如何使用编码器−解码器架构的。我们研究了Transformer的编码器部分,了解了编码器使用的不同子层,比如多头注意力层和前馈网络层。

我们了解到,自注意力机制将一个词与句子中的所有词联系起来,以便更好地理解这个词。为了计算自注意力值,我们使用了3个矩阵,即查询矩阵、键矩阵和值矩阵。我们还学习了如何计算位置编码,以及如何用它来捕捉句子中的词序。接下来,我们了解了前馈网络以及叠加和归一组件。

在学习了编码器之后,我们还学习了解码器的工作原理。我们详细探讨了解码器中的3个子层,它们是带掩码的多头注意力层、多头注意力层(编码器−解码器注意力层)和前馈网络层。之后,我们了解了编码器和解码器是如何组成Transformer的。