🍎个人主页:小嗷犬的个人主页

🍊个人网站:小嗷犬的技术小站

🥭个人信条:为天地立心,为生民立命,为往圣继绝学,为万世开太平。

基本信息

标题: Wings: Learning Multimodal LLMs without Text-only Forgetting

作者: Yi-Kai Zhang, Shiyin Lu, Yang Li, Yanqing Ma, Qing-Guo Chen, Zhao Xu, Weihua Luo, Kaifu Zhang, De-Chuan Zhan, Han-Jia Ye

arXiv: https://arxiv.org/abs/2406.03496

摘要

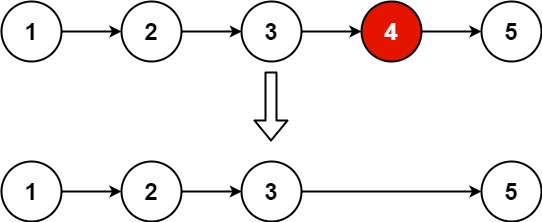

多模态大型语言模型(MLLMs)以训练好的LLM为基础,首先将图像与文本对齐,然后对多模态混合输入进行微调。

然而,MLLM在灾难性地忘记了仅包含文本的指令,这些指令不包括图像,可以在初始LLM中解决。

在本文中,我们提出了WINGS,这是一种新型的MLLM,在纯文本对话和多模态理解方面都表现出色。

分析MLLM在多模态指令中的注意力发现,纯文本遗忘与从预图像文本到后图像文本的注意力转移有关。

据此,我们构建了额外的模块,作为增强学习器来补偿注意力转移。

互补的Visual Learner和Textual Learner,如两侧的“翅膀”,在每个层的注意力块中并行连接。

最初,图像和文本输入与Visual Learner一起操作,与主要注意力平衡,关注视觉元素。

Textual Learner随后与基于注意力的路由协作集成,以融合Visual Learner和Textual Learner的输出。

我们设计了Low-Rank Residual Attention(LoRRA)以保证学习器的高效率。

我们的实验结果表明,WINGS在纯文本和视觉问答任务中均优于同等规模的MLLMs。

在一个新构建的交错图像-文本(IIT)基准上,WINGS在从纯文本丰富的到多模态丰富的问答任务中表现出优异的性能。

主要贡献

- 我们提出并验证了MLLM的纯文本遗忘现象与图像前后跨层MLLM-LAWS的注意力转移相关。

- WINGS构建了Visual Learner和Textual Learner,并引入了一种基于注意力权重转移的Router,以补偿注意力转移,实现协作学习。

- 纯文本、视觉问答和新建的交错图像-文本(IIT)基准上的实验表明,WINGS具有全面和灵活的性能。

工作

Capturing the Attention Shift with MLLM-LAWS

对于具有 L L L 层的MLLM,我们定义Layer-level Attention Weights(MLLM-LAWS)为:

LAWS V ∗ = [ a V ∗ 1 , a V ∗ 2 , ⋯ , a V ∗ L ] , a V ∗ l = ∑ i = 0 s ∑ j ∈ V ∗ a i j l ( h l − 1 ) \text{LAWS}_{\mathcal{V}_{*}} = \left[ a_{\mathcal{V}_{*}}^{1}, a_{\mathcal{V}_{*}}^{2}, \cdots, a_{\mathcal{V}_{*}}^{L} \right], \quad a_{\mathcal{V}_{*}}^{l} = \sum_{i=0}^{s} \sum_{j \in \mathcal{V}_{*}} a_{ij}^{l} \left( h^{l-1} \right) LAWSV∗=[aV∗1,aV∗2,⋯,aV∗L],aV∗l=i=0∑sj∈V∗∑aijl(hl−1)

a i j l a_{ij}^{l} aijl 表示MLLM的第 l l l 层中第 i i i 个token对第 j j j 个token的注意力权重, h l h^{l} hl 表示第 l l l 层的隐藏状态, ∀ i , ∑ j = 0 s a i j l ( h l − 1 ) = 1 \forall i, \sum_{j=0}^{s} a_{ij}^{l} \left( \mathbf{h}^{l-1} \right) = 1 ∀i,∑j=0saijl(hl−1)=1, V ∗ \mathcal{V}_{*} V∗ 表示一个token序列,可以是 V itself \mathcal{V}_\text{itself} Vitself、 V before \mathcal{V}_\text{before} Vbefore 或 V after \mathcal{V}_\text{after} Vafter,分别表示视觉序列、视觉序列前的文本序列和视觉序列后的文本序列。

LAWS V ∗ \text{LAWS}_{\mathcal{V}_{*}} LAWSV∗ 可以表示MLLM对当前序列 V ∗ \mathcal{V}_{*} V∗ 在所有MLLM层上的注意力动态曲线。

- (a): 视觉编码器和投影器的视觉特征token被插入到文本特征序列中。

- (b): 文本层中在文本token的前图像、图像本身和后图像上的注意力权重比例。红色曲线来自在纯文本任务表现更好的MLLM,而蓝色曲线来自在纯文本任务表现更差的MLLM。

- ©: 实验表明,在100多个MLLM中,视觉token前后的皮尔逊相关系数与MLLM在纯文本上的表现存在正相关关系。

因此,注意力转移可通过视觉序列前后 LAWS \text{LAWS} LAWS 之间的皮尔逊相关系数量化为:

Attention Shift = E x [ − ρ ( LAWS V before , LAWS V after ) ] + 1 \text{Attention Shift} = \mathbb{E}_{\mathbf{x}} \left[ -\rho \left( \text{LAWS}_{\mathcal{V}_{\text{before}}}, \, \text{LAWS}_{\mathcal{V}_{\text{after}}} \right) \right] + 1 Attention Shift=Ex[−ρ(LAWSVbefore,LAWSVafter)]+1

WINGS

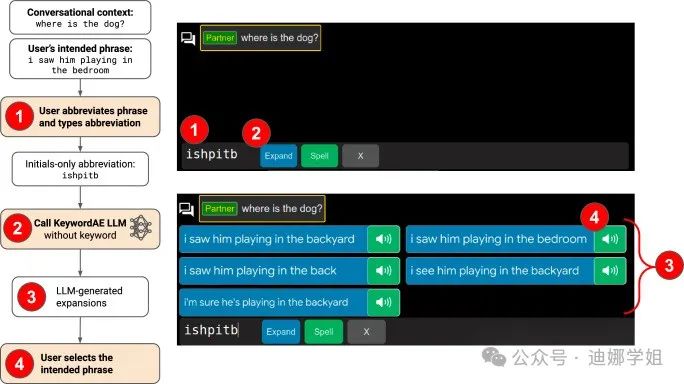

我们引入了与主要注意力平行的额外模块,作为增强Learner来补偿注意力转移。我们在一侧训练Visual Learner,减轻一些转移的注意力。然后,我们基于路由转移的注意力权重协同训练Visual Learner和Textual Learner。

WINGS由Low-Rank Residual Attention(LoRRA)模块构建,其中前一个隐藏状态作为Query,而视觉/文本特征作为Key和Value。训练从Visual Learner和Projector开始,接着是动态注意力Router。

Learner:

Learner ∗ ( Q = h l , K , V = x ∗ ) ∗ ∈ { V , T } = Softmax ( h l ( 1 + W Q ) ⋅ ( x ∗ ( 1 + W K ) ) ⊤ d head ) x ∗ ( 1 + W V ) W O \text{Learner}^* \left( \rm{Q} = \mathbf{h}^l, \rm{K}, \rm{V} = \mathbf{x}_* \right)_{* \in \{\mathbf{V}, \mathbf{T}\}} = \text{Softmax} \left( \frac{\mathbf{h}^l (1 + \mathbf{W}^{\rm{Q}}) \cdot (\mathbf{x}_* (1 + \mathbf{W}^{\rm{K}}))^\top}{\sqrt{d_{\text{head}}}} \right) \mathbf{x}_* (1 + \mathbf{W}^{\rm{V}}) \mathbf{W}^{\rm{O}} Learner∗(Q=hl,K,V=x∗)∗∈{V,T}=Softmax(dheadhl(1+WQ)⋅(x∗(1+WK))⊤)x∗(1+WV)WO

Router接受一个注意力权重作为输入,通过单层MLP和Softmax处理,然后将Learner的输出叠加到主注意力上。

Att WINGS = Att main + ∑ ∗ ∈ { V , T } Router ( a ) ⋅ Learner ∗ ( h l , x ∗ ) \text{Att}^{\text{WINGS}} = \text{Att}^{\text{main}} + \sum_{* \in \{V, T\}} \text{Router}(\mathbf{a}) \cdot \text{Learner}^* \left( \mathbf{h}^l, \mathbf{x}_* \right) AttWINGS=Attmain+∗∈{V,T}∑Router(a)⋅Learner∗(hl,x∗)

训练

WINGS的架构包含四个元素:Vision Encoder、Projector、LLM以及带有Router的Learner。

- Stage 1

- ❄️ Vision Encoder、LLM

- 🔥 Projector、Visual Learner

- Visual Learner的输出直接加到主分支上

- Stage 2

- ❄️ Vision Encoder

- 🔥 LLM、Projector、Router、Visual Learner、Textual Learner

实验

主实验

WINGS与基线MLLMs在相同训练数据下的性能比较。

同等规模的多模态大模型和高效多模态大模型在纯文本和多模态数据集上的性能比较。

Interleaved Image-Text (IIT) Benchmark

为了精细评估MLLMs,我们构建了一系列纯文本和多模态混合多轮对话。

我们通过chroma从MMLU、CMMLU、OpenbookQA、HellaSwag、MMMU、MMBench、SEED-Bench和AI2D数据集中提取具有相似语义的指令。

然后,我们使用GPT-3.5 Turbo润色一些指令,使它们更接近现实世界的对话。

我们设置了6种视觉内容配置,按多轮内容分类为:(T)、(T, T)、(T, T, T)、(T, T, V)、(T, V)和(V)。

例如,(T, T, V)表示两个连续的纯文本查询后跟一个需要回答的视觉问题。

消融实验

在Interleaved Image and Text (IIT) Benchmark上与LLaVA系列模型、不同学习率、不同微调部分的性能比较。

总结

我们提出了WINGS,它包括Visual Learner和Textual Learner,以减轻纯文本的遗忘。Learner由高效的Low-Rank Residual Attention(LoRRA)构成。

我们首先考虑MLLM中的转移注意力权重,并在第一阶段专注于学习Visual Learner。然后,我们基于转移注意力权重进行联合训练Visual Learner和Textual Learner。

WINGS在纯文本、视觉问答和新建的Interleaved Image and Text (IIT) Benchmark测试中表现出显著性能。

WINGS允许在资源有限的情况下保持纯文本的性能,并在资源丰富的环境中进一步提升性能。