温馨提示:文末有 CSDN 平台官方提供的学长联系方式的名片!

温馨提示:文末有 CSDN 平台官方提供的学长联系方式的名片!

温馨提示:文末有 CSDN 平台官方提供的学长联系方式的名片!

作者简介:Java领域优质创作者、CSDN博客专家 、CSDN内容合伙人、掘金特邀作者、阿里云博客专家、51CTO特邀作者、多年架构师设计经验、多年校企合作经验,被多个学校常年聘为校外企业导师,指导学生毕业设计并参与学生毕业答辩指导,有较为丰富的相关经验。期待与各位高校教师、企业讲师以及同行交流合作

主要内容:Java项目、Python项目、前端项目、PHP、ASP.NET、人工智能与大数据、单片机开发、物联网设计与开发设计、简历模板、学习资料、面试题库、技术互助、就业指导等

业务范围:免费功能设计、开题报告、任务书、中期检查PPT、系统功能实现、代码编写、论文编写和辅导、论文降重、长期答辩答疑辅导、腾讯会议一对一专业讲解辅导答辩、模拟答辩演练、和理解代码逻辑思路等。

收藏点赞不迷路 关注作者有好处

文末获取源码

手机推荐系统是一种利用知识图谱和图神经网络以及图注意力推荐算法的智能推荐系统。该系统通过构建知识图谱来表示手机相关的信息,包括手机型号、品牌、功能特点、用户评价等。同时,利用图神经网络对知识图谱进行学习和表示,以便更好地理解和分析手机之间的关系和特征。

在手机推荐过程中,系统利用图注意力推荐算法对用户行为数据进行分析,从而了解用户的喜好和需求。通过将用户行为数据与知识图谱进行关联,系统可以准确地推断出用户可能感兴趣的手机型号和品牌。同时,利用图神经网络的表示学习能力,系统能够更好地捕捉手机之间的相关性和语义关联,从而提高推荐的准确性和个性化程度。

该手机推荐系统具有以下优点:首先,通过借助知识图谱,系统可以有效地将手机信息进行结构化表示,从而提高信息的可读性和可理解性。其次,通过使用图神经网络,系统可以学习到更丰富的手机特征表示,从而更好地捕捉手机之间的关系和特点。最后,利用图注意力推荐算法,系统可以根据用户行为数据进行个性化推荐,提高推荐效果和用户满意度。

总之,基于知识图谱的图神经网络和图注意力推荐算法加持的手机推荐系统能够提供更准确、个性化的手机推荐服务,帮助用户快速找到符合自己需求的手机型号和品牌。

开题报告

题目:基于知识图谱的图神经网络&图注意力推荐算法加持实现的手机推荐系统

一、研究背景与意义

随着互联网技术的迅速发展,尤其是移动互联网的兴起,新产生的信息呈现爆炸式的增长。为了更好地解决信息获取中的信息过载(Information Overload)和长尾问题(Long Tail),推荐系统应运而生,目前基本上已经成为了各种产品的标配功能。手机作为日常生活中不可或缺的一部分,其市场竞争尤为激烈,用户对于手机的需求也日趋多样化。因此,构建一个高效、精准的手机推荐系统显得尤为重要。

知识图谱作为一种信息量丰富的异构信息网络,被引入到推荐系统中,能够帮助生成更好的推荐。知识图谱不仅包含了手机本身的属性信息(如品牌、型号、配置等),还包含了用户与手机之间的交互信息(如购买记录、浏览记录等)。通过结合图神经网络和图注意力机制,可以进一步挖掘和利用知识图谱中的信息,提高推荐的精准度和可解释性。

二、研究现状

目前,推荐系统已经经历了三代主要的发展阶段。第一代推荐系统(1995-2005)主要包括基于内容过滤的方法、基于协同过滤的方法和混合方法。然而,这些方法存在数据稀疏、冷启动等问题,并且没有充分利用推荐场景中的语义信息、关键字关系和层次结构。

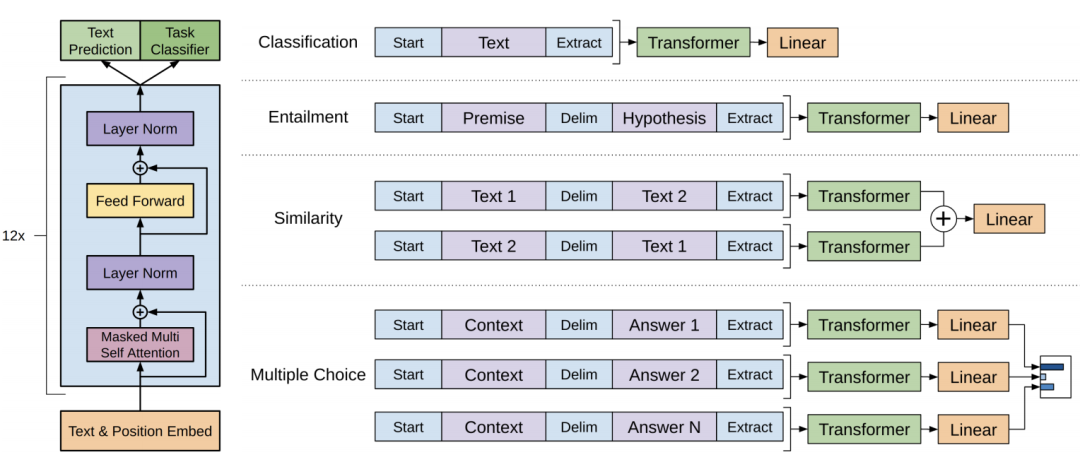

近年来,基于深度神经网络的方法,如DNN、Wide & Deep、DeepFM等,在排序学习(Learn to Rank, LTR)方面取得了显著成果。特别是图神经网络(Graph Neural Network, GNN)和图注意力网络(Graph Attention Network, GAT)的引入,为推荐系统提供了新的思路。这些方法通过嵌入(Embedding)和多层感知机(Multilayer Perceptron, MLP)范式,学习特征之间的非线性关系,从而提高了推荐的精准度。

三、研究内容

本研究旨在构建一个基于知识图谱的图神经网络&图注意力推荐算法加持的手机推荐系统。具体研究内容包括:

-

知识图谱的构建:从手机相关的各种数据源中提取实体、关系和属性,构建领域知识图谱。这包括手机本身的属性信息、用户与手机之间的交互信息等。

-

图神经网络的应用:利用图神经网络对知识图谱进行深层次的信息挖掘。通过嵌入层、注意力嵌入传播层和预测层的设计,实现手机推荐系统的核心算法。

-

图注意力机制的引入:在图神经网络的基础上,引入图注意力机制,为不同的邻居节点指定不同的重要性值,进一步提高推荐的精准度和可解释性。

-

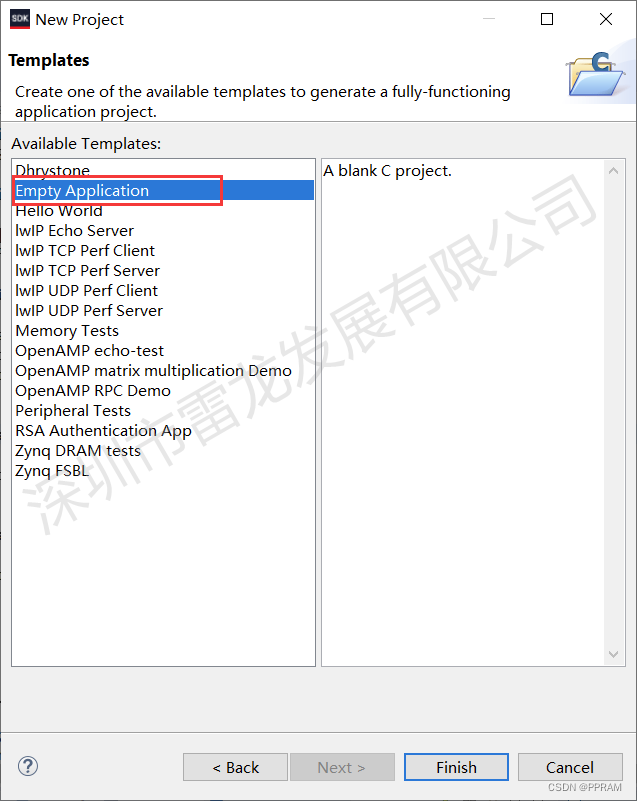

系统的实现与验证:采用软件开发技术设计和实现手机推荐系统,并通过实际数据集进行验证,评估系统的推荐效果。

四、研究方法

本研究将采用以下方法进行:

-

文献调研:通过查阅相关文献,了解推荐系统、知识图谱、图神经网络和图注意力机制的研究现状和发展趋势。

-

数据收集与处理:从手机相关的各种数据源中收集数据,并进行预处理,构建领域知识图谱。

-

算法设计与实现:基于图神经网络和图注意力机制,设计并实现手机推荐系统的核心算法。

-

系统开发与验证:采用软件开发技术设计和实现手机推荐系统,并通过实际数据集进行验证,评估系统的推荐效果。

五、预期成果

通过本研究,预期能够取得以下成果:

-

构建一个基于知识图谱的手机领域知识图谱。

-

设计并实现一个基于图神经网络和图注意力机制的手机推荐系统。

-

通过实际数据集验证系统的推荐效果,提高推荐的精准度和可解释性。

六、研究计划与时间表

-

第一阶段(1-2个月):进行文献调研和数据收集与处理,构建领域知识图谱。

-

第二阶段(3-4个月):设计并实现基于图神经网络和图注意力机制的手机推荐系统。

-

第三阶段(5-6个月):进行系统开发与验证,评估系统的推荐效果,并进行优化。

-

第四阶段(7-8个月):撰写论文,准备答辩。

七、参考文献

[列出相关参考文献]

以上是《基于知识图谱的图神经网络&图注意力推荐算法加持实现的手机推荐系统》的开题报告。本研究旨在通过结合知识图谱、图神经网络和图注意力机制,构建一个高效、精准的手机推荐系统,为手机市场的用户提供更好的购物体验。

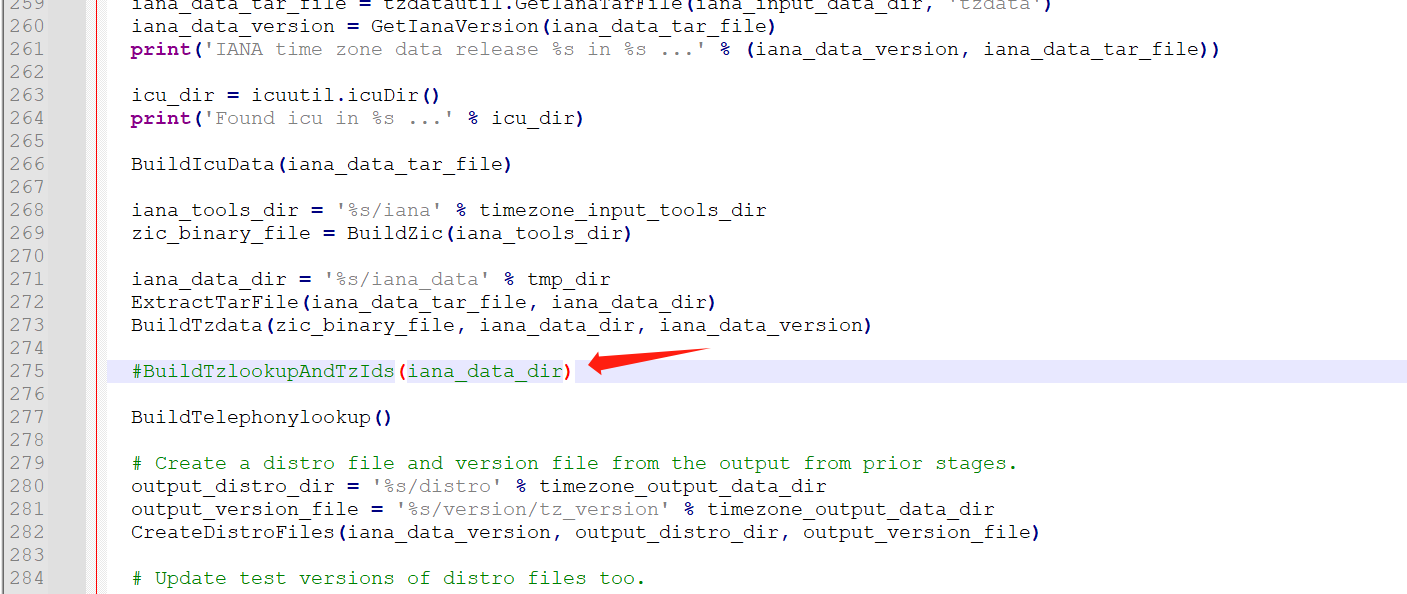

实现基于知识图谱的图神经网络(GNN)和图注意力网络(GAT)的推荐算法是一个复杂的任务,涉及多个步骤和组件。由于篇幅限制,我将提供一个简化的示例代码框架,用于说明如何结合知识图谱和图神经网络进行推荐。请注意,这只是一个起点,实际应用中需要更多的细节和优化。

首先,我们需要一些库来处理图数据和图神经网络。在这个例子中,我们将使用PyTorch和PyTorch Geometric(一个用于图神经网络的扩展库)。

import torch

import torch.nn.functional as F

from torch_geometric.nn import GATConv, GCNConv

from torch_geometric.data import Data

from torch_geometric.utils import train_test_split_edge

# 假设我们有一个简单的知识图谱,包含手机节点和用户交互边

# 这里我们手动创建一些示例数据

# 节点特征矩阵(假设每个节点有一个一维特征)

num_nodes = 10 # 假设有10个节点,其中前5个是手机,后5个是用户

x = torch.randn((num_nodes, 1)) # 随机初始化节点特征

# 边列表(COO格式),表示手机与用户之间的交互

edge_index = torch.tensor([[0, 1, 2, 3, 4, 0, 1, 2, 3, 4], # 源节点索引

[5, 6, 7, 8, 9, 6, 7, 8, 9, 5]], # 目标节点索引

dtype=torch.long) # 边列表

# 创建Data对象

data = Data(x=x, edge_index=edge_index)

# 划分训练集和测试集(这里我们简单地划分一些边用于测试)

data = train_test_split_edge(data, test_size=0.2)[0]

# 定义图注意力网络模型

class GATModel(torch.nn.Module):

def __init__(self, in_channels, out_channels, heads=1, concat=True, dropout=0.6):

super(GATModel, self).__init__()

self.conv1 = GATConv(in_channels, 8, heads=heads, concat=concat, dropout=dropout)

self.conv2 = GATConv(8 * heads if concat else 8, out_channels, heads=heads, concat=concat, dropout=dropout)

def forward(self, x, edge_index):

x = self.conv1(x, edge_index)

x = F.relu(x)

x = F.dropout(x, training=self.training)

x = self.conv2(x, edge_index)

return x

# 模型参数

in_channels = x.size(1) # 输入特征维度

out_channels = 2 # 输出特征维度(例如,用于二分类任务)

heads = 2 # 注意力头数

# 初始化模型、优化器和损失函数

model = GATModel(in_channels, out_channels, heads=heads)

optimizer = torch.optim.Adam(model.parameters(), lr=0.005, weight_decay=5e-4)

criterion = torch.nn.CrossEntropyLoss()

# 训练函数

def train():

model.train()

optimizer.zero_grad()

out = model(data.x, data.train_pos_edge_index)

# 假设我们有一个简单的标签y,用于训练(这里省略了标签的生成过程)

# y = ...

# loss = criterion(out[data.train_pos_edge_index[0]], y)

# 由于示例中未提供标签,我们仅模拟一个损失计算过程

loss = torch.tensor(0.0, requires_grad=True) # 占位符损失

loss.backward()

optimizer.step()

return loss.item()

# 测试函数(这里仅作为示例,实际测试需要根据具体任务定义)

def test():

model.eval()

with torch.no_grad():

out = model(data.x, data.test_pos_edge_index)

# 假设我们有一个简单的测试标签y_test,用于评估(这里省略了标签的生成过程)

# loss_test = criterion(out[data.test_pos_edge_index[0]], y_test)

# 由于示例中未提供测试标签,我们仅返回输出作为占位符

return out

# 训练模型

for epoch in range(1, 201): # 训练200个epoch

loss = train()

if epoch % 10 == 0:

print(f'Epoch {epoch}, Loss: {loss:.4f}')

# 测试模型(这里仅打印输出作为示例)

test_output = test()

print(test_output)注意:

-

数据准备:示例中的节点特征和边列表是随机生成的,实际应用中需要根据具体的知识图谱数据来准备。

-

标签:示例中未提供训练标签和测试标签,因为具体任务(如链接预测、节点分类等)的标签生成方式会有所不同。

-

模型架构:示例中使用了两层GATConv,实际应用中可能需要根据任务复杂度和数据规模调整模型架构。

-

训练与测试:示例中的训练和测试函数是简化的,实际应用中需要更详细的实现,包括数据加载、模型评估等。

-

优化与调参:实际应用中需要调整学习率、权重衰减、注意力头数等超参数,以获得最佳性能。

-

可扩展性:对于大规模知识图谱和复杂推荐任务,可能需要使用分布式训练、更高效的图处理算法等。

这个示例代码框架提供了一个起点,用于理解如何将知识图谱和图神经网络结合用于推荐任务。实际应用中需要根据具体需求进行扩展和优化。