遥感图像文本检索是一种通过自然语言描述,从大量遥感图像中搜索与之相关的图像的技术。它用于遥感解释任务中,帮助用户根据文字描述快速找到符合条件的遥感图像,这在城市规划、环境监测、灾害管理等领域具有重要应用意义。

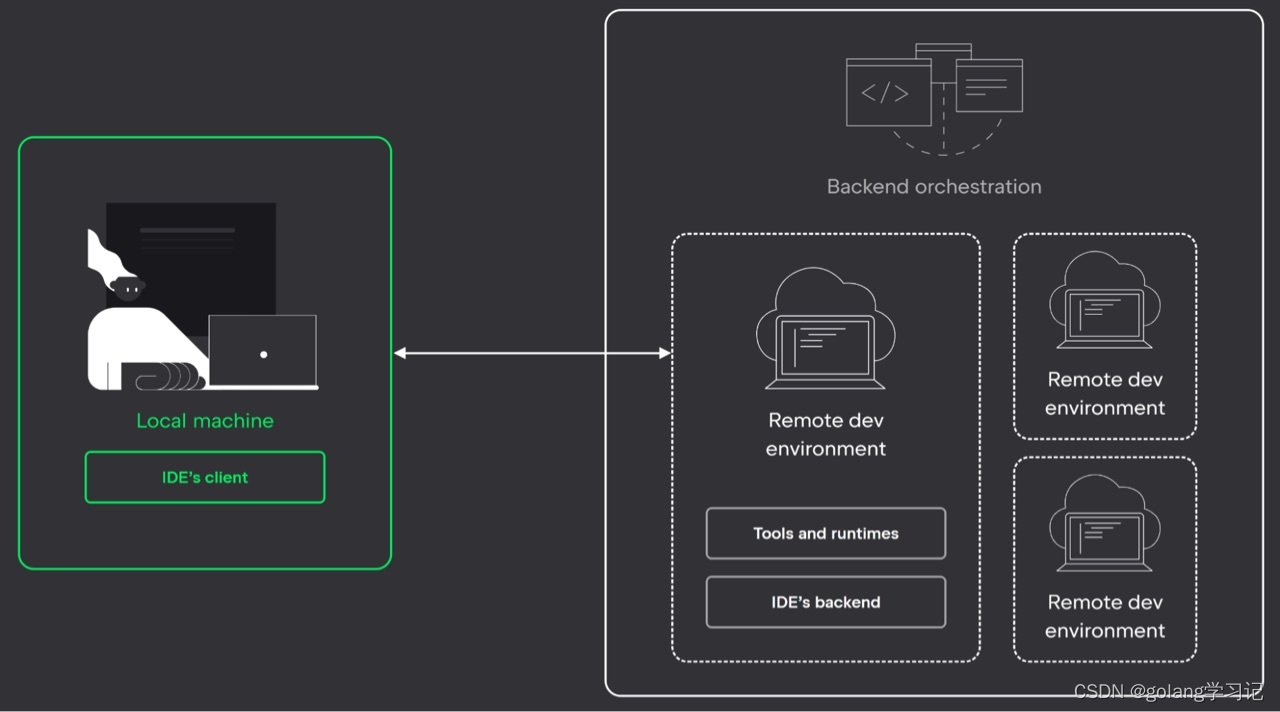

实现这一技术的核心是视觉-语言模型,通过预训练的方式,让模型能够理解并匹配遥感图像与文本描述。本文提出了一种先验指导表示(PIR)学习范式,通过先验知识引导遥感图像和文本的自适应表示学习。这种方法能够有效处理语义噪音问题,即图像和文本之间不完全匹配的情况,从而提升检索性能。

具体技术包括PIR-ITR框架,它通过领域自适应的方式来增强视觉-语言的理解。此外,基于CLIP的PIR-CLIP框架专门处理远程感知图像文本检索中的开放领域问题,进一步提高了检索的准确性。实验结果表明,该方法在RSICD和RSITMD两个基准数据集上的表现优于现有的最先进方法,证明了其在封闭和开放领域中的优势。

论文作者:Jiancheng Pan,Muyuan Ma,Qing Ma,Cong Bai,Shengyong Chen

作者单位:Zhejiang University of Technology;Tsinghua University;

论文链接:http://arxiv.org/abs/2405.10160v1

内容简介:

1)方向:遥感图像文本检索

2)应用:遥感解释任务中的图像文本检索

3)背景:随着大量额外数据用于预训练视觉-语言基础模型,远程感知图像-文本检索进一步发展为一个开放领域的检索任务。

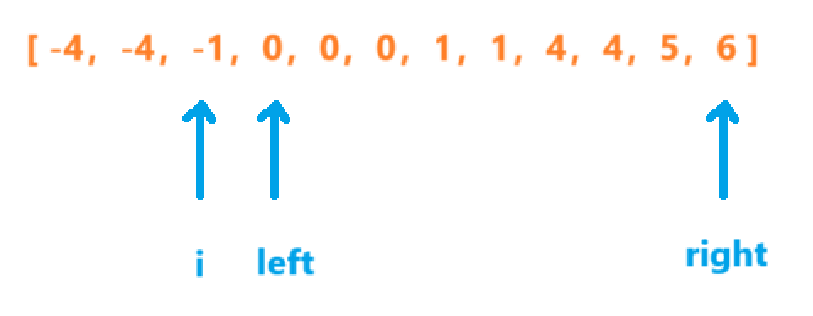

4)方法:本文介绍了一种先验指导表示(PIR)学习范式,利用先验知识指导远程感知图像和文本表示的自适应学习。基于PIR,设计了一个领域自适应的远程感知图像-文本检索框架PIR-ITR,以解决视觉-语言理解任务中的语义噪音问题。此外,提出了PIR-CLIP,一种基于CLIP的领域特定框架,用于解决远程感知图像-文本检索中的语义噪音,并进一步提高开放领域检索性能。

5)结果:实验结果表明,PIR能够增强视觉和文本表示,在两个基准数据集RSICD和RSITMD上优于封闭领域和开放领域检索的最先进方法。

![[Uninstall] 软件彻底卸载工具的下载及详细安装使用过程(附有下载文件)](https://i-blog.csdnimg.cn/direct/f6cfe95bd4cf4412b8bb780a72c0a4f8.png)