随着人工智能技术的发展,大语言模型(Large Language Models, LLMs)因其在自然语言处理、机器翻译、文本生成等领域的广泛应用而受到越来越多的关注。对于希望掌握这一前沿技术的朋友来说,制定一个系统的学习计划至关重要。本计划旨在帮助你从零开始,在两个月内逐步构建起对LLM的理解与实践能力。

第一阶段:基础理论学习 (第1-2周)

目标:建立关于LLM的基本概念框架,并熟悉相关数学和编程知识。

第1周

了解背景信息:阅读几篇介绍性文章或观看视频讲座,如《什么是大语言模型?》、《深度学习简介》等,快速获得行业概览。

掌握必备数学:复习线性代数(向量空间、矩阵运算)、概率论(贝叶斯定理、随机变量)及微积分(梯度下降法)。推荐资源包括可汗学院的相关课程。

Python编程入门/复习:确保能够熟练使用Python进行数据处理。如果已经是Python高手,则可以跳过此步骤;否则建议完成一些在线教程,例如Codecademy上的“Learn Python”。

第2周

深入理解神经网络:通过阅读书籍章节(如Ian Goodfellow等人所著《Deep Learning》的第一部分)或参加免费MOOC课程来加深对前馈神经网络、卷积神经网络以及循环神经网络的认识。

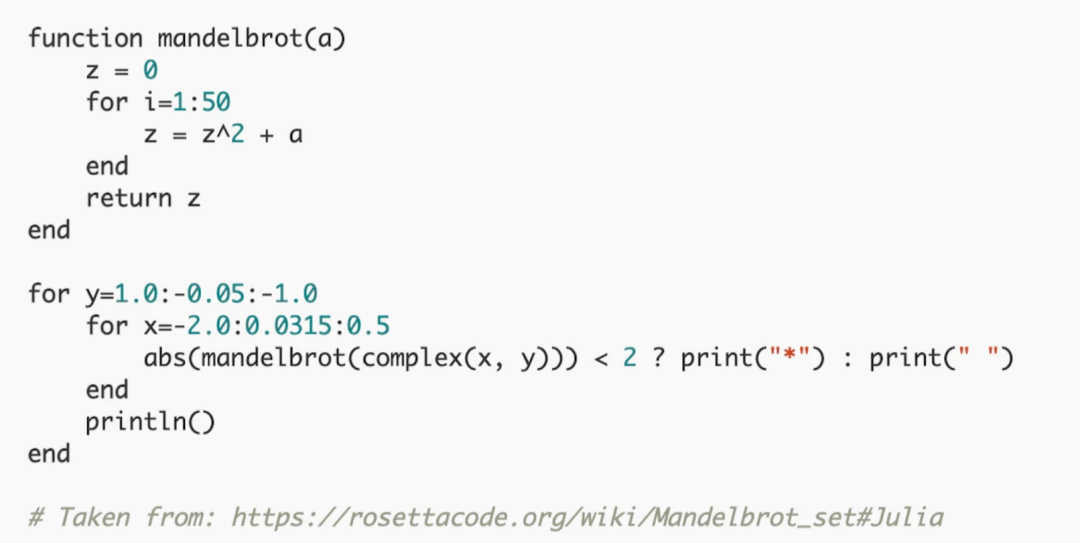

动手实现简单模型:利用TensorFlow/Keras或PyTorch搭建并训练几个经典的小型项目,比如MNIST手写数字识别器或者IMDb电影评论情感分析器。

初步接触NLP任务:尝试解决词嵌入(word embeddings)问题,如使用GloVe预训练向量进行文本相似度计算。

第二阶段:深化专业知识 (第3-4周)

目标:深入了解LLM的工作原理及其背后的关键技术。

第3周

研究Transformer架构:重点学习Attention机制如何工作,以及它为何能显著提高序列到序列建模的表现力。官方论文《Attention is All You Need》是必读材料之一。

探索主流LLMs:调查当前最流行的几种大型语言模型(例如BERT, GPT系列),比较它们之间的异同点。

跟随开源项目:加入GitHub上活跃的LLM相关仓库(如Hugging Face Transformers库),观察社区讨论,参与小规模贡献以增进实战经验。

第4周

细读关键文献:挑选几篇高质量的研究论文深入研读,重点关注作者是如何设计实验、评估性能指标等方面的做法。

练习代码解读:选取一些公开可用的大模型实现代码作为样本,逐行分析其逻辑结构和技术细节。

准备硬件环境:考虑租用云GPU服务(AWS EC2实例、Google Colab Pro+等),为后续实际训练做好准备。

第三阶段:实战演练 (第5-7周)

目标:通过真实案例将理论转化为技能,积累宝贵的工程实践经验。

第5周

复现现有成果:选择一项感兴趣的LLM应用领域(如对话系统、自动摘要等),找到相关的开源项目或论文,尽量完整地重现其实验结果。

调整超参数优化:基于上述过程中的观察,尝试修改某些配置项(学习率、批次大小等),观察这些变化如何影响最终模型表现。

记录成长历程:开设个人博客或技术论坛账号,定期分享自己在学习过程中的心得体会,这不仅有助于巩固记忆,也能与其他开发者交流互动。

第6周

定制化开发:根据个人兴趣或市场需求,构思一个新的LLM应用场景,并着手编写相应的数据收集脚本、特征提取函数等。

多轮迭代改进:持续测试新功能的有效性,及时修复发现的问题,不断优化用户体验直至满意为止。

关注最新动态:订阅几个权威的技术新闻站点(TechCrunch, VentureBeat等),保持对AI领域最新进展的关注。

第7周

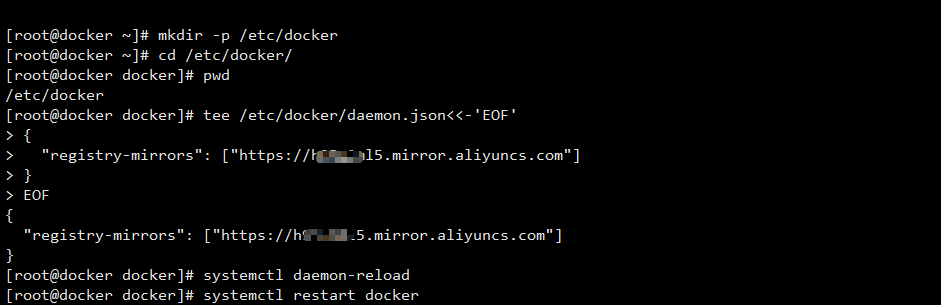

部署上线准备:一旦完成了所有核心功能的开发,就需要开始考虑将其发布至生产环境的事宜了。这时可能需要学习Docker容器化技术、Kubernetes集群管理等内容。

安全性考量:鉴于LLMs潜在的安全风险(如偏见放大、隐私泄露等问题),务必采取适当措施加以防范。

用户反馈循环:正式推出产品后,积极听取用户的反馈意见,据此做出相应调整,从而形成良性循环。

第四阶段:总结反思与未来规划 (第8周)

目标:回顾整个学习旅程,提炼出有价值的经验教训,并对未来职业道路作出合理规划。

撰写总结报告:整理过去八周里学到的知识点、遇到过的挑战以及解决问题的方法,形成一份详尽的学习笔记。

参加线上研讨会:报名参加由知名机构组织的人工智能大会,聆听行业领袖的主题演讲,拓宽视野。

设定长期目标:基于当前掌握的技能水平和个人兴趣爱好,明确下一步想要达成的具体目标,比如成为某家初创公司的首席科学家,或是创办自己的科技公司。

持续自我提升:认识到技术进步永无止境的道理,养成终身学习的好习惯,时刻准备好迎接新的挑战。

通过这样一个紧凑而全面的学习路径,相信你会很快成长为一名合格乃至优秀的大语言模型工程师!当然,每个人的基础条件不同,具体实施时还需灵活调整。祝你好运!

这个计划涵盖了从基础知识到高级应用的全过程,适合有一定编程基础但对LLM不太熟悉的程序员参考。希望这份指南能够帮助你在接下来的两个月里高效地达到预期目标!如果有任何疑问或需要进一步的帮助,请随时提问。

大模型&AI产品经理如何学习

求大家的点赞和收藏,我花2万买的大模型学习资料免费共享给你们,来看看有哪些东西。

1.学习路线图

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

2.视频教程

网上虽然也有很多的学习资源,但基本上都残缺不全的,这是我自己整理的大模型视频教程,上面路线图的每一个知识点,我都有配套的视频讲解。

(都打包成一块的了,不能一一展开,总共300多集)

因篇幅有限,仅展示部分资料,需要点击下方图片前往获取

3.技术文档和电子书

这里主要整理了大模型相关PDF书籍、行业报告、文档,有几百本,都是目前行业最新的。

4.LLM面试题和面经合集

这里主要整理了行业目前最新的大模型面试题和各种大厂offer面经合集。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓