《博主简介》

小伙伴们好,我是阿旭。专注于人工智能、AIGC、python、计算机视觉相关分享研究。

👍感谢小伙伴们点赞、关注!

《------往期经典推荐------》

一、AI应用软件开发实战专栏【链接】

| 项目名称 | 项目名称 |

|---|---|

| 1.【人脸识别与管理系统开发】 | 2.【车牌识别与自动收费管理系统开发】 |

| 3.【手势识别系统开发】 | 4.【人脸面部活体检测系统开发】 |

| 5.【图片风格快速迁移软件开发】 | 6.【人脸表表情识别系统】 |

| 7.【YOLOv8多目标识别与自动标注软件开发】 | 8.【基于YOLOv8深度学习的行人跌倒检测系统】 |

| 9.【基于YOLOv8深度学习的PCB板缺陷检测系统】 | 10.【基于YOLOv8深度学习的生活垃圾分类目标检测系统】 |

| 11.【基于YOLOv8深度学习的安全帽目标检测系统】 | 12.【基于YOLOv8深度学习的120种犬类检测与识别系统】 |

| 13.【基于YOLOv8深度学习的路面坑洞检测系统】 | 14.【基于YOLOv8深度学习的火焰烟雾检测系统】 |

| 15.【基于YOLOv8深度学习的钢材表面缺陷检测系统】 | 16.【基于YOLOv8深度学习的舰船目标分类检测系统】 |

| 17.【基于YOLOv8深度学习的西红柿成熟度检测系统】 | 18.【基于YOLOv8深度学习的血细胞检测与计数系统】 |

| 19.【基于YOLOv8深度学习的吸烟/抽烟行为检测系统】 | 20.【基于YOLOv8深度学习的水稻害虫检测与识别系统】 |

| 21.【基于YOLOv8深度学习的高精度车辆行人检测与计数系统】 | 22.【基于YOLOv8深度学习的路面标志线检测与识别系统】 |

| 23.【基于YOLOv8深度学习的智能小麦害虫检测识别系统】 | 24.【基于YOLOv8深度学习的智能玉米害虫检测识别系统】 |

| 25.【基于YOLOv8深度学习的200种鸟类智能检测与识别系统】 | 26.【基于YOLOv8深度学习的45种交通标志智能检测与识别系统】 |

| 27.【基于YOLOv8深度学习的人脸面部表情识别系统】 | 28.【基于YOLOv8深度学习的苹果叶片病害智能诊断系统】 |

| 29.【基于YOLOv8深度学习的智能肺炎诊断系统】 | 30.【基于YOLOv8深度学习的葡萄簇目标检测系统】 |

| 31.【基于YOLOv8深度学习的100种中草药智能识别系统】 | 32.【基于YOLOv8深度学习的102种花卉智能识别系统】 |

| 33.【基于YOLOv8深度学习的100种蝴蝶智能识别系统】 | 34.【基于YOLOv8深度学习的水稻叶片病害智能诊断系统】 |

| 35.【基于YOLOv8与ByteTrack的车辆行人多目标检测与追踪系统】 | 36.【基于YOLOv8深度学习的智能草莓病害检测与分割系统】 |

| 37.【基于YOLOv8深度学习的复杂场景下船舶目标检测系统】 | 38.【基于YOLOv8深度学习的农作物幼苗与杂草检测系统】 |

| 39.【基于YOLOv8深度学习的智能道路裂缝检测与分析系统】 | 40.【基于YOLOv8深度学习的葡萄病害智能诊断与防治系统】 |

| 41.【基于YOLOv8深度学习的遥感地理空间物体检测系统】 | 42.【基于YOLOv8深度学习的无人机视角地面物体检测系统】 |

| 43.【基于YOLOv8深度学习的木薯病害智能诊断与防治系统】 | 44.【基于YOLOv8深度学习的野外火焰烟雾检测系统】 |

| 45.【基于YOLOv8深度学习的脑肿瘤智能检测系统】 | 46.【基于YOLOv8深度学习的玉米叶片病害智能诊断与防治系统】 |

| 47.【基于YOLOv8深度学习的橙子病害智能诊断与防治系统】 | 48.【车辆检测追踪与流量计数系统】 |

| 49.【行人检测追踪与双向流量计数系统】 | 50.【基于YOLOv8深度学习的反光衣检测与预警系统】 |

| 51.【危险区域人员闯入检测与报警系统】 | 52.【高密度人脸智能检测与统计系统】 |

| 53.【CT扫描图像肾结石智能检测系统】 | 54.【水果智能检测系统】 |

| 55.【水果质量好坏智能检测系统】 | 56.【蔬菜目标检测与识别系统】 |

| 57.【非机动车驾驶员头盔检测系统】 | 58.【太阳能电池板检测与分析系统】 |

| 59.【工业螺栓螺母检测】 | 60.【金属焊缝缺陷检测系统】 |

| 61.【链条缺陷检测与识别系统】 | 62.【交通信号灯检测识别】 |

二、机器学习实战专栏【链接】,已更新31期,欢迎关注,持续更新中~~

三、深度学习【Pytorch】专栏【链接】

四、【Stable Diffusion绘画系列】专栏【链接】

五、YOLOv8改进专栏【链接】,持续更新中~~

六、YOLO性能对比专栏【链接】,持续更新中~

《------正文------》

目录

- 引言

- 29.解释SVM的工作原理。

- 30.k-means和k-means++算法有什么区别?

- 31. 解释机器学习中常用的一些相似度测量方法。

- 32. 当数据分布右偏和左偏时,平均值、中位数和众数会发生什么变化?

- 33. 决策树和随机森林哪一个对异常值更稳健。

- 34. L1和L2正则化有什么区别?它们有什么意义?

- 35. 什么是径向基函数?解释其用途。

- 36.解释用于处理数据不平衡的 SMOTE 方法。

- 37.准确度分数是否总是衡量分类模型性能的良好指标?

- 38.什么是 KNN Imputer?

- 39.解释XGB模型的工作流程。

- 40.将给定的数据集分成训练数据和验证数据的目的是什么?

- 41. 解释一些处理数据中缺失值的方法。

- 42.k-means和KNN算法有什么区别?

- 43.什么是线性判别分析?

- 44. 如何在二维中可视化高维数据?

- 45. 维数灾难背后的原因是什么?

- 46. 度量 MAE 或 MSE 或 RMSE 是否对异常值更具鲁棒性。

- 47.为什么删除高度相关的特征被认为是一种好的做法?

- 48. 推荐系统的基于内容的算法和协同过滤算法有什么区别?

引言

上一篇文章《【基础篇】应届毕业生必备:机器学习面试题指南【1】》介绍了关于机器学习在面试过程中的一些基础问题,这篇文章将会进一步深入介绍关于机器学习的一些进阶面试题,希望能够帮助到各位小伙伴。

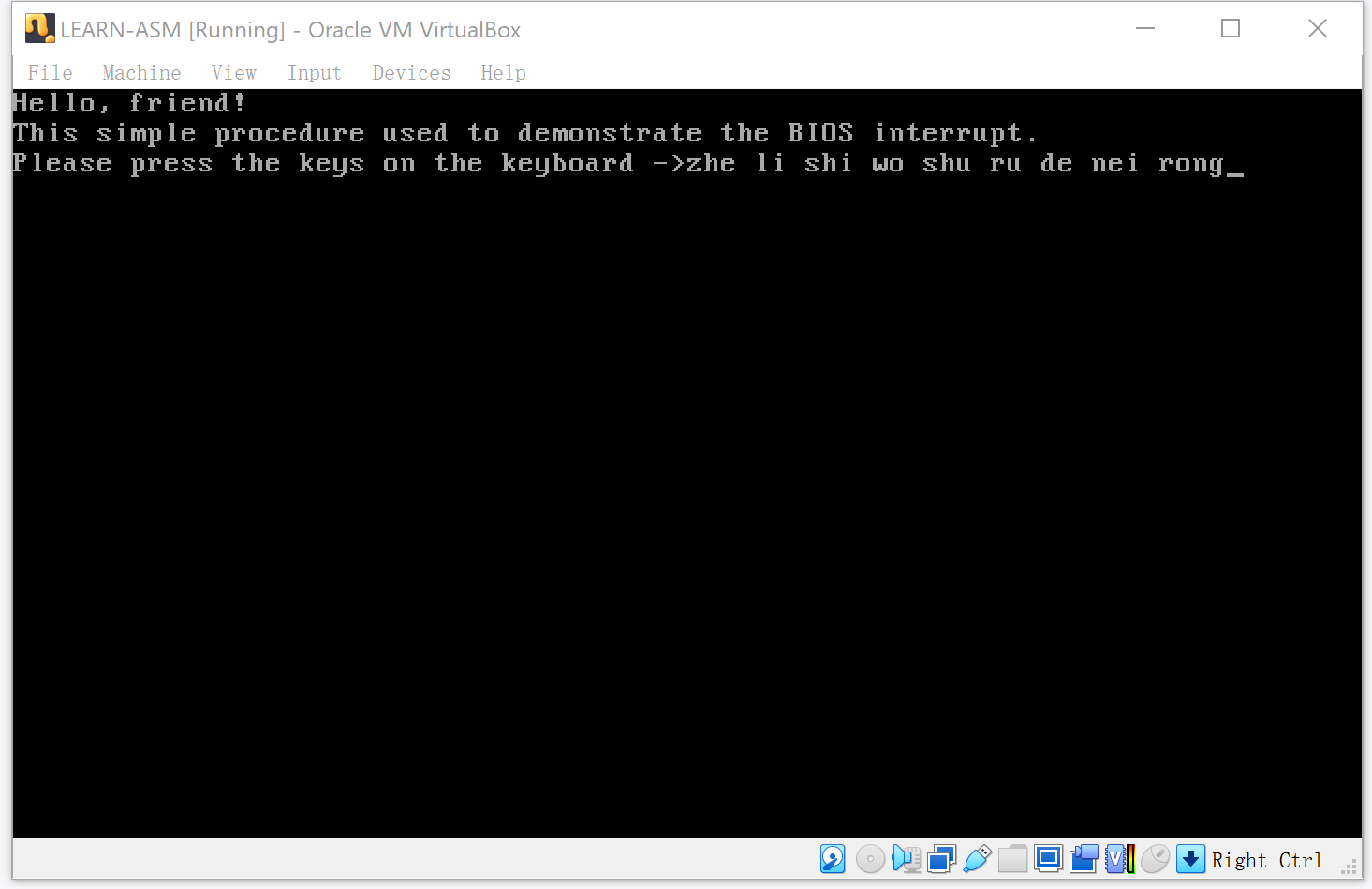

29.解释SVM的工作原理。

在一个平面上无法区分不同类别的数据集可能在另一个平面上可区分。这正是 SVM 背后的理念,将低维数据映射到高维数据,使其可区分为不同的类别。将数据映射到更高维度后,确定超平面,从而将数据分为不同类别。SVM 模型甚至可以学习非线性边界,目的是使数据分类的类别之间尽可能留有余地。为了执行此映射,使用了不同类型的核,如径向基核、高斯核、多项式核等。

30.k-means和k-means++算法有什么区别?

两者之间的唯一区别在于质心的初始化方式。在 K-means 算法中,质心是从给定点随机初始化的。这种方法有一个缺点,有时这种随机初始化会导致非优化集群,因为可能初始化两个彼此靠近的集群。

为了解决这个问题,k-means++ 算法应运而生。在 k-means++ 中,第一个质心是从数据点中随机选择的。后续质心的选择基于它们与初始质心的分离。一个点被选为下一个质心的概率与该点与已经选择的最近质心之间的平方距离成正比。这保证了质心均匀分布,并降低了收敛到不太理想的聚类的可能性。这有助于算法达到全局最小值,而不是卡在某个局部最小值。

31. 解释机器学习中常用的一些相似度测量方法。

一些最常用的相似度测量如下:

- *余弦相似度*——通过考虑 n 维中的两个向量,我们评估两者之间角度的余弦。此相似度度量的范围从 [-1, 1] 变化,其中值 1 表示两个向量高度相似,-1 表示两个向量彼此完全不同。

- *欧几里得距离或曼哈顿距离*– 这两个值表示 n 维平面中两点之间的距离。两者之间的唯一区别在于计算方式。

- *杰卡德相似度*——也称为 IoU 或并集,广泛用于物体检测领域,以评估预测边界框和地面真实边界框之间的重叠。

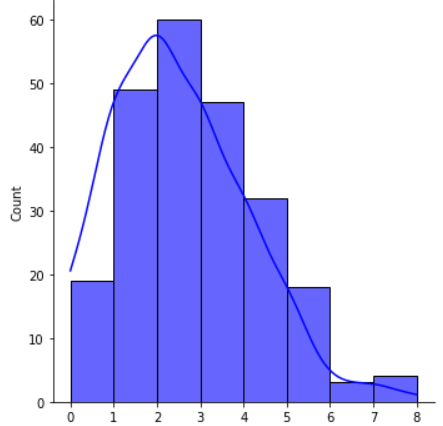

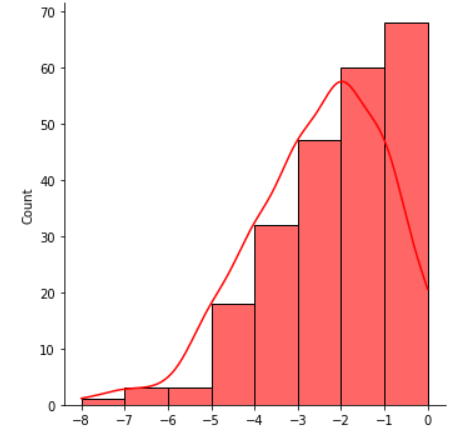

32. 当数据分布右偏和左偏时,平均值、中位数和众数会发生什么变化?

在右偏分布(也称为正偏分布)的情况下,平均值大于中位数,中位数大于众数。但在左偏分布的情况下,情况则完全相反。

*右偏分布*

*众数 < 中位数 < 平均值*

*左偏分布,*

*平均值 < 中位数 < 众数*

33. 决策树和随机森林哪一个对异常值更稳健。

决策树和随机森林对异常值都具有相对的鲁棒性。随机森林模型是多棵决策树的集合,因此随机森林模型的输出是多棵决策树的集合。

因此,当我们对结果取平均值时,过度拟合的可能性就会降低。因此,我们可以说随机森林模型对异常值更具有鲁棒性。

34. L1和L2正则化有什么区别?它们有什么意义?

*L1 正则化*:L1正则化也称为 Lasso 正则化,其中我们在损失函数中添加模型权重的绝对值之和。在 L1 正则化中,那些根本不重要的特征的权重被惩罚为零,因此,我们反过来使用 L1 正则化技术进行特征选择。

*L2 正则化*:L2 正则化也称为 Ridge 正则化,其中我们将权重的平方添加到损失函数中。在这两种正则化方法中,权重都会受到惩罚,但它们帮助实现的目标之间存在细微的差异。

在 L2 正则化中,权重不会被惩罚为 0,但对于不相关的特征,权重会接近于 0。它通常用于通过将权重缩小至 0 来防止过度拟合,尤其是在特征很多且数据嘈杂的情况下。

35. 什么是径向基函数?解释其用途。

RBF(径向基函数)是机器学习中使用的实值函数,其值仅取决于输入和称为中心的固定点。径向基函数的公式如下:

机器学习系统经常使用 RBF 函数实现各种功能,包括:

- RBF 网络可用于逼近复杂函数。通过训练网络权重以适应一组输入输出对,

- RBF 网络可用于无监督学习来定位数据组。通过将 RBF 中心视为聚类中心,

- RBF 网络可用于分类任务,通过训练网络权重,根据输入与 RBF 节点的距离将输入分成几组。

它是一个非常著名的核之一,通常用于 SVM 算法中,将低维数据映射到高维平面,因此,我们可以确定一个边界,以尽可能多的边界将这些平面不同区域中的类别分开。

36.解释用于处理数据不平衡的 SMOTE 方法。

合成少数类过采样技术是用于处理数据集中数据不平衡问题的方法之一。

在该方法中,我们使用线性插值,利用少数类中的现有数据点合成新数据点。使用此方法的优点是模型不会在相同的数据上进行训练。但使用此方法的缺点是它会给数据集添加不必要的噪声,并可能对模型的性能产生负面影响。

37.准确度分数是否总是衡量分类模型性能的良好指标?

不,有时我们在不平衡的数据集上训练模型时,准确率得分并不是衡量模型性能的良好指标。在这种情况下,我们使用精确度和召回率来衡量分类模型的性能。此外,f1 分数是另一个可用于衡量性能的指标,但最终,f1 分数也是使用精确度和召回率计算的,因为 f1 分数只不过是精确度和召回率的调和平均值。

38.什么是 KNN Imputer?

我们通常通过数据的描述性统计指标(如平均值、众数或中位数)来填补空值,但 KNN Imputer 是一种更复杂的填补空值的方法。此方法还使用距离参数,也称为 k 参数。该工作在某种程度上类似于聚类算法。缺失值是根据缺失值的邻域点来填补的。

39.解释XGB模型的工作流程。

XGB 模型是机器学习集成技术的一个例子,该方法通过将权重传递给决策树来按顺序优化权重。每次传递后,随着每棵树尝试优化权重,权重会变得越来越好,最后,我们获得了当前问题的最佳权重。正则化梯度和小批量梯度下降等技术已用于实现该算法,因此它以非常快速和优化的方式工作。

40.将给定的数据集分成训练数据和验证数据的目的是什么?

主要目的是保留一些模型尚未训练的剩余数据,以便我们可以在训练后评估机器学习模型的性能。此外,有时我们使用验证数据集在多个最先进的机器学习模型中进行选择。例如,我们首先训练一些模型,比如 LogisticRegression、XGBoost 或任何其他模型,然后使用验证数据测试它们的性能,并选择验证和训练准确率之间差异较小的模型。

41. 解释一些处理数据中缺失值的方法。

处理缺失值的一些方法如下:

- 删除具有空值的行可能会导致一些重要信息的丢失。

- 如果列中包含的信息价值很低,则删除具有空值的列。这可能会导致一些重要信息的丢失。

- 使用平均值、众数和中位数等描述性统计指标来填补空值。

- 使用 KNN Imputer 等方法以更复杂的方式填补空值。

42.k-means和KNN算法有什么区别?

k-means 算法是一种流行的无监督机器学习算法,用于聚类目的。但 KNN 是一种通常用于分类任务的模型,是一种监督机器学习算法。k-means 算法帮助我们通过在数据集内形成聚类来标记数据。

43.什么是线性判别分析?

LDA是一种监督机器学习降维技术,因为它也使用目标变量进行降维。它通常用于分类问题。LDA主要作用于两个目标:

- 最大化两个类别均值之间的距离。

- 最小化每个类别内的变异。

44. 如何在二维中可视化高维数据?

最常见和最有效的方法之一是使用 t-SNE 算法,它是 t 分布随机邻域嵌入的简称。该算法使用一些非线性复杂方法来降低给定数据的维数。我们还可以使用 PCA 或 LDA 将 n 维数据转换为 2 维,以便我们可以绘制它以获得更好的分析视觉效果。但 PCA 和 t-SNE 之间的区别在于,前者试图保留数据集的方差,而 t-SNE 试图保留数据集中的局部相似性。

45. 维数灾难背后的原因是什么?

随着输入数据的维数增加,概括或学习数据中存在的模式所需的数据量也会增加。对于模型来说,从有限数量的数据集中识别每个特征的模式变得困难,或者我们可以说,由于数据的高维数和用于训练模型的示例数量有限,权重没有得到适当的优化。因此,在输入数据的维数达到某个阈值之后,我们不得不面对维数灾难。

46. 度量 MAE 或 MSE 或 RMSE 是否对异常值更具鲁棒性。

在上述三个指标中,与 MSE 或 RMSE 相比,MAE 对异常值具有更强的鲁棒性。其背后的主要原因是对误差值的平方。对于异常值,误差值已经很高,然后我们对其进行平方,这会导致误差值比预期的要大,从而产生误导性的梯度结果。

47.为什么删除高度相关的特征被认为是一种好的做法?

当两个特征高度相关时,它们可能会向模型提供相似的信息,从而导致过度拟合。如果数据集中存在高度相关的特征,则它们会不必要地增加特征空间的维数,有时还会造成维数灾难的问题。如果特征空间的维数很高,则模型训练可能需要比预期更多的时间,这将增加模型的复杂性和出错的可能性。这在某种程度上也有助于我们实现数据压缩,因为这些特征已被删除,但数据损失不大。

48. 推荐系统的基于内容的算法和协同过滤算法有什么区别?

在基于内容的推荐系统中,我们会评估内容和服务的相似性,然后利用这些来自过去数据的相似性度量向用户推荐产品。

但在协同过滤中,我们根据类似用户的偏好推荐内容和服务。例如,如果一个用户过去曾使用过 A 和 B 服务,而一个新用户曾使用过服务 A,那么我们会根据另一个用户的偏好向他推荐服务 A。

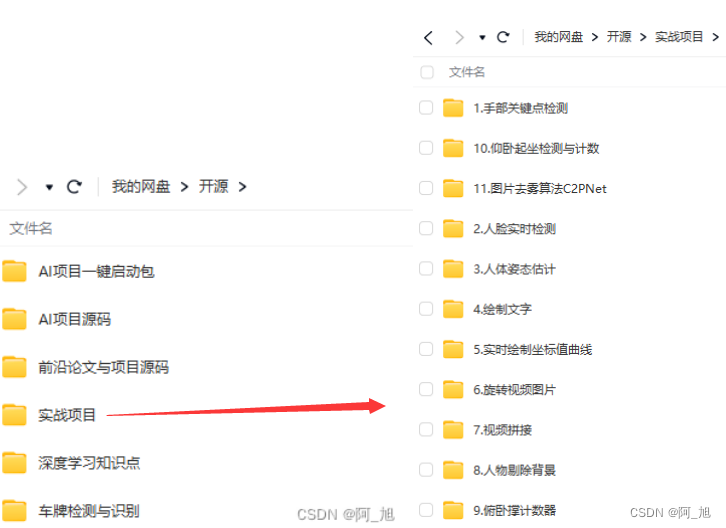

关注文末名片G-Z-H:【阿旭算法与机器学习】,发送【开源】可获取更多学习资源

好了,这篇文章就介绍到这里,喜欢的小伙伴感谢给点个赞和关注,更多精彩内容持续更新~~

关于本篇文章大家有任何建议或意见,欢迎在评论区留言交流!