ai目录:sheng的学习笔记-AI目录-CSDN博客

贝叶斯分类: https://blog.csdn.net/coldstarry/article/details/138861587

基础知识

概率图模型

概率图模型(probabilistic graphical model)是一类用图来表达变量相关关系的概率模型。

它以图为表示工具,最常见的是用一个结点表示一个或一组随机变量,结点之间的边表示变量间的概率相关关系,即“变量关系图”。

根据边的性质不同,概率图模型可大致分为两类:

- 第一类是使用有向无环图表示变量间的依赖关系,称为有向图模型或贝叶斯网(Bayesian network);

- 第二类是使用无向图表示变量间的相关关系,称为无向图模型或马尔可夫网(Markov network)。

有向图和无向图模型

-

无向图模型的因子是势函数,需要全局归一化。

优点是:势函数设计不受概率分布的约束,设计灵活。(势函数下面有介绍)

-

有向图模型的因子是概率分布,不需要全局归一化。

优点是:训练相对高效。

生成式模型和判别式模型

生成式模型

生成式模型是直接对联合分布进行建模,涉及到多个随机变量的概率分布,即当考虑两个或更多个随机变量时,它们的联合概率分布。这种建模方法扩展了单个随机变量的概率分布概念,允许同时处理多个变量的情况,关注于如何处理和利用多个变量之间的关系,以便更好地理解和预测数据。例如在处理多维数据时,通过分析多个变量的联合分布,可以更好地理解数据的内在结构和关系。这种建模方法不仅适用于传统的数据驱动的AI应用,也适用于处理多模态数据和多任务学习等复杂场景。

图建模数据的联合概率分布p(x, y)。判别模型基于概率理论,已知输入变量x,通过构建条件概率分布P(y|x)来预测y

个人理解:多个变量,人不知道这些变量之间的映射关系,通过概率建模,知道一些节点就知道他们临近节点的数据

判别式模型

判别式模型则是对条件分布进行建模, 注于如何在给定输入的情况下预测输出,即直接对条件概率分布p(y|x;θ)进行建模。试图对多个变量在给定观测值后的条件概率进行建模。这种建模方法被称为判别建模。

若令x={x1,x2,...,xn}为观测序列,y={y1,y2,...,yn}为与之相应的标记序列,则条件随机场的目标是构建条件概率模型P(y|x)

个人理解:根据已知数据:x,y,构建 x=>y 的函数,在计算的过程中会计算因为x导致对y的影响

隐马尔可夫模型(HMM)

基本概念

隐马尔可夫模型(Hidden Markov Model,简称HMM)是结构最简单的动态贝叶斯网(dynamic Bayesian network),这是一种著名的有向图模型,主要用于时序数据建模,在语音识别、自然语言处理等领域有广泛应用

如图14.1所示,隐马尔可夫模型中的变量可分为两组。

- 第一组是状态变量{y1,y2,...,yn},其中yi∈Y表示第i时刻的系统状态。通常假定状态变量是隐藏的、不可被观测的,因此状态变量亦称隐变量(hidden variable)。

- 第二组是观测变量{x1,x2,...,xn},其中xi∈X表示第i时刻的观测值。

在隐马尔可夫模型中,系统通常在多个状态{s1,s2,...,sN}之间转换,因此状态变量yi的取值范围Y(称为状态空间)通常是有N个可能取值的离散空间。观测变量xi可以是离散型也可以是连续型,为便于讨论,我们仅考虑离散型观测变量,并假定其取值范围x为{o1,o2,...,oM}。

流程

HMM模型的发力点主要体现在下述三个问题上

例如许多任务需根据以往的观测序列{x1,x2,...,xn-1}来推测当前时刻最有可能的观测值xn,这显然可转化为求取概率P(x|λ),即上述第一个问题;在语音识别等任务中,观测值为语音信号,隐藏状态为文字,目标就是根据观测信号来推断最有可能的状态序列(即对应的文字),即上述第二个问题;在大多数现实应用中,人工指定模型参数已变得越来越不可行,如何根据训练样本学得最优的模型参数,恰是上述第三个问题。

值得庆幸的是,基于式(14.1)的条件独立性,隐马尔可夫模型的这三个问题均能被高效求解。

算法

HMM学习问题指的是:给定观测值序列,如何调整模型的参数使得该序列出现的概率最大。这便转化成了机器学习问题,即从给定的观测值序列中学习出一个HMM模型,该问题正是EM算法的经典案例之一。其思想也十分简单:对于给定的观测值序列,如果我们能够按照该序列潜在的规律来调整模型的三个参数,则可以使得该序列出现的可能性最大。假设状态值序列也已知,则很容易计算出与该序列最契合的模型参数:

但一般状态值序列都是不可观测的,且即使给定观测值序列与模型参数,状态序列仍然遭遇组合爆炸。因此上面这种简单的统计方法就行不通了,若将状态值序列看作为隐变量,这时便可以考虑使用EM算法来对该问题进行求解:

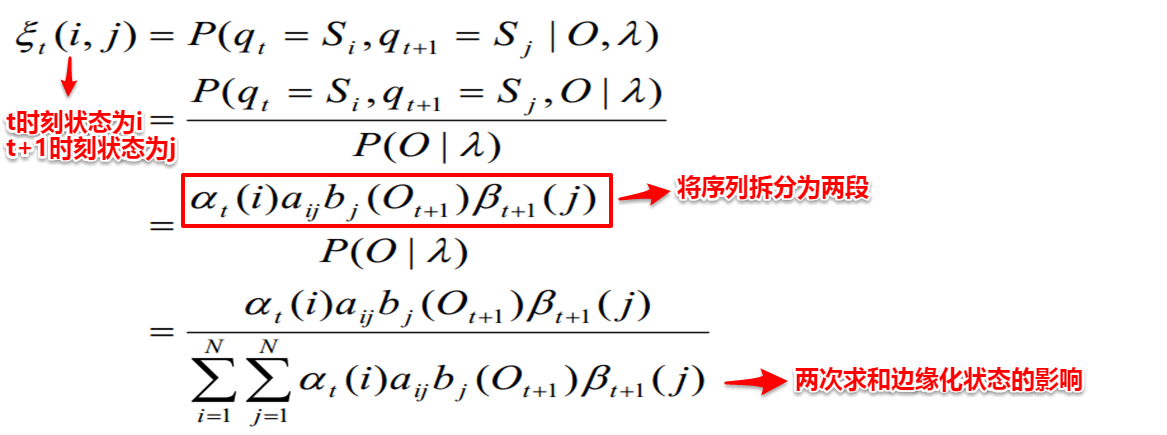

【1】首先对HMM模型的三个参数进行随机初始化;【2】根据模型的参数与观测值序列,计算t时刻状态为i且t+1时刻状态为j的概率以及t时刻状态为i的概率。

【3】接着便可以对模型的三个参数进行重新估计:

【4】重复步骤2-3,直至三个参数值收敛,便得到了最终的HMM模型。

马尔可夫随机场(MRF)

基础概念

马尔可夫随机场(Markov Random Field:MRF)是一种典型的马尔可夫网,即使用无向边来表达变量间的依赖关系,是一种著名的无向图模型

马尔可夫随机场的一个应用是图像降噪,图像分割等场景

马尔可夫随机场或马尔可夫网络可以认为是马尔可夫链在多维度上的推广。在马尔可夫链中,状态只依赖于时间上的前一个状态,而在马尔可夫随机场中,每个状态都依赖于它在多个方向上的邻态。马尔可夫随机场可以被可视化为随机变量的场或图,其中每个随机变量的分布取决于与其相连的相邻变量。更具体地说,图中任意随机变量的联合分布可以计算为图中所有包含该随机变量的团(Clique)的“团势(clique potentials)势”的乘积。将问题建模为马尔可夫随机场是有用的,因为这意味着可以用这种方式计算图中每个顶点的联合分布。

团

在马尔可夫随机场中,对于关系图中的一个子集,若任意两结点间都有边连接,则称该子集为一个团;若再加一个结点便不能形成团,则称该子集为极大团。MRF使用势函数来定义多个变量的概率分布函数,其中每个(极大)团对应一个势函数,一般团中的变量关系也体现在它所对应的极大团中,因此常常基于极大团来定义变量的联合概率分布函数。

在图14.2中,{x1,x2},{x1,x3},{x2,x4},{x2,x5},{x2,x6},{x3,x5},{x5,x6}和{x2,x5,x6}都是团,并且除了{x2,x5},{x2,x6}和{x6,x6}之外都是极大团;但是,因为x2和x3之间缺乏连接,{x1,x2,x3}并不构成团。显然,每个结点至少出现在一个极大团中。

具体而言,若所有变量构成的极大团的集合为C,则MRF的联合概率函数可以定义为:

例如图14.2中x={x1,x2,...,x6},联合概率分布Px定义为

MRF与贝叶斯

现实任务中,可能只知道两个变量之间存在相关关系,但是并不知道具体怎样相关,也就无法得到变量之间的依赖关系。

-

贝叶斯网络需要知道变量之间的依赖关系,从而对依赖关系(即条件概率)建模。

-

马尔科夫随机场并不需要知道变量之间的依赖关系。它通过变量之间的联合概率分布来直接描述变量之间的关系。

马尔可夫随机场可以应用于图像问题中。

- 每个像素都表示成一个节点,相邻像素之间相互影响。

- 像素之间并不存在因果关系,它们之间的作用是对称的。因此使用无向图概率模型,而不是有向图概率模型。

马尔科夫性

MRF的三个性质

- 全局马尔可夫性:给定两个变量子集的分离集,则这两个变量子集条件独立。

- 局部马尔可夫性:给定某变量的邻接变量,则该变量与其它变量条件独立。

- 成对马尔可夫性:给定所有其他变量,两个非邻接变量条件独立。

全局马尔可夫性的一个证明:

将上图简化为如下所示:

势函数

图像降噪应用

马尔可夫随机场的一个应用是图像降噪。

如下图所示,左侧图片为原始图像,右侧图片为添加了一定噪音(假设噪音比例不超过 10%) 的噪音图像。现在给定噪音图像,需要得到原始图像。

这两类团就是模型中的最大团。

条件随机场(CRF)

什么是条件随机场

条件随机场(Conditional Random Field,简称CRF)是一种判别式无向图模型,可看作给定观测值的马尔可夫随机场,

举例

自然语言处理的词性标注任务中,观测数据为语句(即单词序列),标记为相应的词性序列,具有线性序列结构,如图14.5(a)所示;在语法分析任务中,输出标记则是语法树,具有树形结构,如图14.5(b)所示。

理论上来说,图G可具有任意结构,只要能表示标记变量之间的条件独立性关系即可。但在现实应用中,尤其是对标记序列建模时,最常用的仍是图14.6所示的链式结构,即“链式条件随机场”(chain-structured CRF)。下面我们主要讨论这种条件随机场。

公式

与马尔可夫随机场定义联合概率的方式类似,条件随机场使用势函数和图结构上的团来定义条件概率P(y|x)。

采用指数势函数,并引入特征函数feature function,定义条件概率:

其中tj(yi+1,yi,x,i)是定义在观测序列的两个相邻标记位置上的转移特征函数(transition feature function),用于刻画相邻标记变量之间的相关关系以及观测序列对它们的影响,

sk(yi,x,i)是定义在观测序列的标记位置i上的状态特征函数(status feature function),用于刻画观测序列对标记变量的影响,

λj和μk为参数,Z为规范化因子,用于确保式(14.11)是正确定义的概率。

特征函数

要使用条件随机场,还需定义合适的特征函数。

特征函数通常是实值函数,以刻画数据的一些很可能成立或期望成立的经验特性。以图14.5(a)的词性标注任务为例,若采用转移特征函数

则表示观测值xi为单词“knock”时,它所对应的标记很可能为[V]。

HMM,MRF,CRF对比

隐马尔可夫模型和马尔可夫随机场都是生成式模型(联合概率),而条件随机场则是判别式模型(条件概率)

条件随机场和马尔可夫随机场均使用团上的势函数定义概率,两者在形式上没有显著区别;

个人理解:

隐马尔可夫是有向无环图,此时节点之间是有方向的A->B,就是A会影响B,但B不会影响A,联合分布P(Y,R,O),其中Y代表隐藏状态,R代表其他可能相关的变量,而O代表观测值,其中O作为可能的临近节点来计算结果,虽然考虑了可观测值,但可观测值作为节点参与计算

条件随机场是无向图,节点互相之间会影响,没有方向的概念,A会影响B,B也会影响A。分布P(Y,R∣O),即给定观测值的情况下,隐藏状态和其他变量的条件分布,在O已经发生的前提下,计算结果值

所以隐马尔可夫和条件随机场,虽然都涉及到了可观测值,但原理不一样

参考文章:

15 概率图模型 - 15.1 隐马尔可夫模型(HMM) - 《周志华《机器学习》学习笔记》 - 书栈网 · BookStack

15 概率图模型 - 15.2 马尔可夫随机场(MRF) - 《周志华《机器学习》学习笔记》 - 书栈网 · BookStack

16.概率图与条件随机场 - 三、马尔可夫随机场 - 《AI算法工程师手册》 - 书栈网 · BookStack

15.隐马尔可夫模型 - 一、隐马尔可夫模型HMM - 《AI算法工程师手册》 - 书栈网 · BookStack

16.概率图与条件随机场 - 四、条件随机场 CRF - 《AI算法工程师手册》 - 书栈网 · BookStack

![[论文笔记]QLoRA: Efficient Finetuning of Quantized LLMs](https://img-blog.csdnimg.cn/img_convert/e75c9a4137c39630cd34c5ebe3fe8196.png)

![[论文笔记] t-SNE数据可视化](https://i-blog.csdnimg.cn/direct/1471fb8b0b674486a237e13867971c94.png)