multi-model rag现在的技术已经比较成熟了,我们也落地了很多公司的rag和agent项目。今天先不说项目落地,今天给大家分享一个有意思的需求。

广州的一家公司,当我们rag搭建完成后,他们的一个产品经理提了一个需求。他们说,虽然你们的应用,可以通过打字,语音和上传图片实现rag,但是还不是很方便。他说,我们很多时候浏览的都是pdf或者一些加密的信息,这些加密的信息,我是不能复制粘贴的,也就没有办法把文字内容直接复制到我的聊天框,截图再上传,也太麻烦了。

我说,这很简单啊,现在qq、微信的截图,都自带ocr识别功能,能把图片的内容,直接给你识别出来,然后你再复制到聊天框不就行了?

他说,这还是比较麻烦。我是希望,我直接截图,你这里直接调用rag或者agent,也就是,屏幕截图接入大模型。比如:我截图一个复杂的公式,你直接帮我翻译出来。我截图一个数学问题,你直接给我计算出答案。我截图一个内容,你直接调用rag给我找到知识库的内容并总结,等等把。

不知道大家有没有听懂他的意思。

不可否认,这人真的是个人才。。。一般人还真想不出来。现在截图功能,已经越来越普及, 一个截图,不需要保存截图,然后找到这个截图,再发送给大模型,而是我一个截图,直接调用大模型,这个产品经理,确实让我刮目相看。

ok,开干。

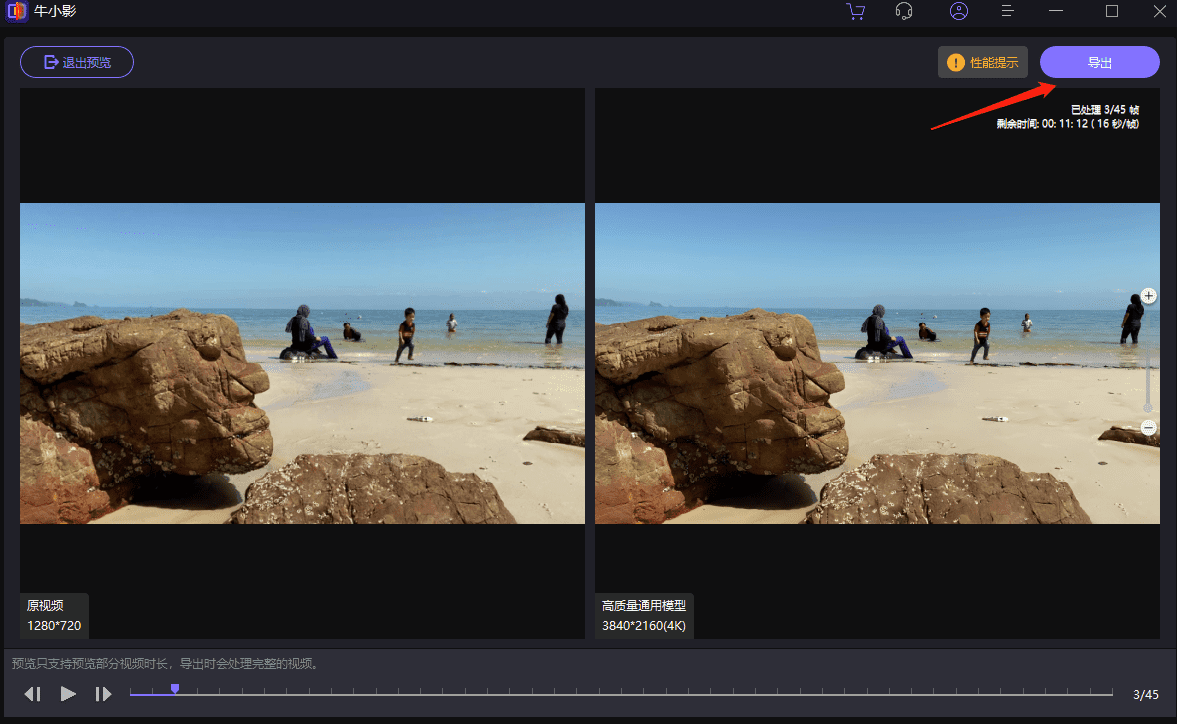

系统接入,比较简单,加入一个屏幕截图快捷键,第一版,我们直接mss+image+imageTK+bytesIO,搞定,通过鼠标监听、获取选定区域、将图像保存到内存中。

接下来,我们会在截屏旁边,提供rag和agent入口,它可以选择要执行的操作,如果是rag,我们就会调用chatprompttemplete+ocr这个image的内容,发送到agent,同时带上图片的原始值,做multi-model的rag。如果用户选择的是agent,会默认预定义几个agent给他用,比如:计算、解释等(记得前一节我们说的,限定agent范围)。

ok,搞定。我们觉得还行,接下来,用户继续提需求,你这个屏幕截图快捷键,很多员工不想重新设置,就想用微信电脑版的截图,比如alt+A,也要达到截图不保存,直接发大模型。。。

ok,我们继续做,具体怎么做的,怎么跟客户沟通的,等我们做好了,再跟大家分享。

所以,跟传统软件开发一样,用户的需求,真的是千奇百怪,但是还是一句话,如果真的是可以解决业务痛点的问题,就大家一起努力干吧。

关注我,每天带你开发一个AI应用。

每周二四六直播,欢迎多多交流。