目录

1 、微调前置基础

2、准备工作

2.1环境配置

结果

2.2模型准备

目录结构:在目录结构中可以看出,internlm2-chat-1_8b 是一个符号链接

3、快速开始

3.1 微调前的模型对话

获取开发机端口和密码:

3.2 指令跟随微调

3.2.1 准备数据文件

目录结构

3.2.2 准备配置文件

3.2.2.1 列出支持的配置文件

3.2.2.2 复制一个预设的配置文件

目录结构图片

3.2.2.3 对配置文件进行修改

配置文件图片

3.2.3 启动微调

在训练完后,我们的目录结构 图片:

3.2.4 模型格式转换

模型格式转换完成,目录结构图:

3.2.5 模型合并

模型合并完成后,我们的目录结构:

3.3 微调后的模型对话

图片

1 、微调前置基础

本节主要重点是带领大家实现个人小助手微调,如果想了解微调相关的基本概念,可以访问XTuner微调前置基础。

2、准备工作

2.1环境配置

按照前面步骤创建开发机,名称:XTuner微调,选择开发机镜像:Cuda12.2-conda,可选择10%有更高可选择更高。

克隆仓库:

mkdir -p /root/InternLM/Tutorial

git clone -b camp3 https://github.com/InternLM/Tutorial /root/InternLM/Tutorial# 创建虚拟环境

conda create -n xtuner0121 python=3.10 -y

# 激活虚拟环境(注意:后续的所有操作都需要在这个虚拟环境中进行)

conda activate xtuner0121

# 安装一些必要的库

conda install pytorch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 pytorch-cuda=12.1 -c pytorch -c nvidia -y

# 安装其他依赖

pip install transformers==4.39.3

pip install streamlit==1.36.0安装XTuner

虚拟环境创建完成后,就可以安装 XTuner 了。首先,从 Github 上下载源码。

# 创建一个目录,用来存放源代码

mkdir -p /root/InternLM/code

cd /root/InternLM/code

git clone -b v0.1.21 https://github.com/InternLM/XTuner /root/InternLM/code/XTuner其次,进入源码目录,执行安装。

# 进入到源码目录

cd /root/InternLM/code/XTuner

conda activate xtuner0121

# 执行安装

pip install -e '.[deepspeed]'如果速度太慢可以换成

pip install -e '.[deepspeed]' -i https://mirrors.aliyun.com/pypi/simple/

最后,我们可以验证一下安装结果。

xtuner version通过以下命令来查看相关的帮助:xtuner help

接下来准备好我们需要的模型、数据集和配置文件,并进行微调训练。

结果

2.2模型准备

可以通过以下代码一键通过符号链接的方式链接到模型文件,这样既节省了空间,也便于管理。

# 创建一个目录,用来存放微调的所有资料,后续的所有操作都在该路径中进行

mkdir -p /root/InternLM/XTuner

cd /root/InternLM/XTuner

mkdir -p Shanghai_AI_Laboratory

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b Shanghai_AI_Laboratory/internlm2-chat-1_8b执行上述操作后,Shanghai_AI_Laboratory/internlm2-chat-1_8b 将直接成为一个符号链接,这个链接指向 /root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b 的位置。

这意味着,当我们访问 Shanghai_AI_Laboratory/internlm2-chat-1_8b 时,实际上就是在访问 /root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b 目录下的内容。通过这种方式,我们无需复制任何数据,就可以直接利用现有的模型文件进行后续的微调操作,从而节省存储空间并简化文件管理。

模型文件准备好后,我们可以使用tree命令来观察目录结构

apt-get install -y tree

tree -l目录结构:在目录结构中可以看出,internlm2-chat-1_8b 是一个符号链接

3、快速开始

简述:用 internlm2-chat-1_8b 模型,通过 QLoRA 的方式来微调一个自己的小助手认知作为案例来进行演示。

3.1 微调前的模型对话

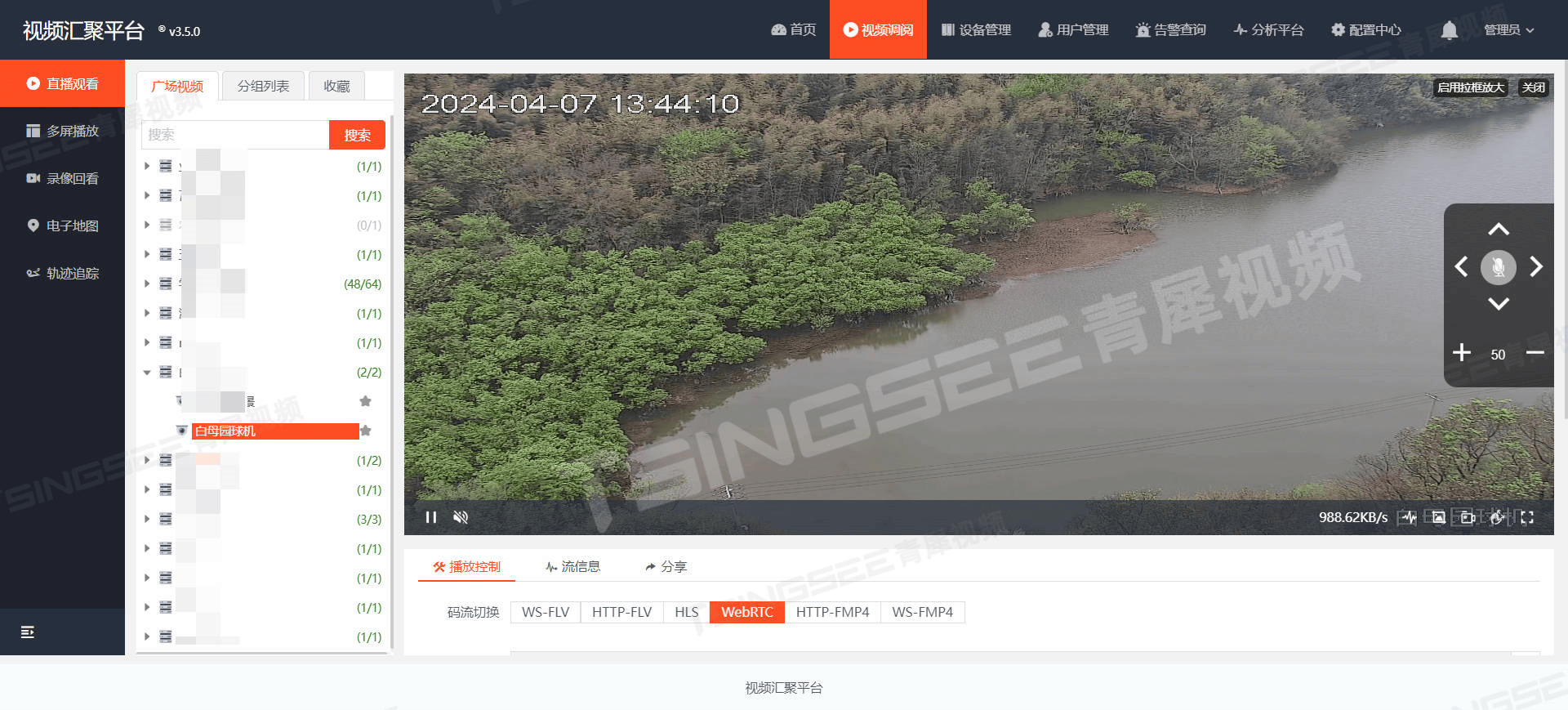

通过网页端的 Demo 来看看微调前 internlm2-chat-1_8b 的对话效果。

首先,我们需要准备一个Streamlit程序的脚本。

Streamlit程序的完整代码是:tools/xtuner_streamlit_demo.py。

启动应用:

conda activate xtuner0121

streamlit run /root/InternLM/Tutorial/tools/xtuner_streamlit_demo.py运行后需要端口映射

获取开发机端口和密码:

其中,8501是Streamlit程序的服务端口,43551需要替换为自己的开发机的端口。

ssh -CNg -L 8501:127.0.0.1:8501 root@ssh.intern-ai.org.cn -p 43551

在本地通过浏览器访问:http://127.0.0.1:8501 来进行对话

3.2 指令跟随微调

接下来,对模型进行微调,让模型了解自己是一个助手

3.2.1 准备数据文件

为了将模型变成我们想要的样子,回复符合我们的预期,需要向微调数据集中加入这样的数据。

准备数据文件datas/assisttant.json,文件内容为对话数据。

cd /root/InternLM/XTuner

mkdir -p datas

touch datas/assistant.json为了简化数据文件准备,我们也可以通过脚本生成的方式来准备数据。创建一个脚本文件 xtuner_generate_assistant.py :

cd /root/InternLM/XTuner

touch xtuner_generate_assistant.py输入脚本内容并保存:

xtuner_generate_assistant.py:

import json

# 设置用户的名字

name = '伍鲜同志'

# 设置需要重复添加的数据次数

n = 8000

# 初始化数据

data = [

{"conversation": [{"input": "请介绍一下你自己", "output": "我是{}的小助手,内在是上海AI实验室书生·浦语的1.8B大模型哦".format(name)}]},

{"conversation": [{"input": "你在实战营做什么", "output": "我在这里帮助{}完成XTuner微调个人小助手的任务".format(name)}]}

]

# 通过循环,将初始化的对话数据重复添加到data列表中

for i in range(n):

data.append(data[0])

data.append(data[1])

# 将data列表中的数据写入到'datas/assistant.json'文件中

with open('datas/assistant.json', 'w', encoding='utf-8') as f:

# 使用json.dump方法将数据以JSON格式写入文件

# ensure_ascii=False 确保中文字符正常显示

# indent=4 使得文件内容格式化,便于阅读

json.dump(data, f, ensure_ascii=False, indent=4)

cd /root/InternLM/XTuner

cp /root/InternLM/Tutorial/tools/xtuner_generate_assistant.py ./为了训练出自己的小助手,需要将脚本中name后面的内容修改为你自己的名称。

# 将对应的name进行修改(在第4行的位置)

- name = '伍鲜同志'

+ name = "你自己的名称"假如想要让微调后的模型能够完完全全认识到你的身份,我们还可以把第6行的n的值调大一点。不过n值太大的话容易导致过拟合,无法有效回答其他问题。

然后执行该脚本来生成数据文件。

cd /root/InternLM/XTuner

conda activate xtuner0121

python xtuner_generate_assistant.py准备好数据文件后,我们的目录结构应该是这样子的。

目录结构

3.2.2 准备配置

文件

文件

在准备好了模型和数据集后,我们就要根据我们选择的微调方法结合微调方案来找到与我们最匹配的配置文件了,从而减少我们对配置文件的修改量。

配置文件其实是一种用于定义和控制模型训练和测试过程中各个方面的参数和设置的工具。

3.2.2.1 列出支持的配置文件

XTuner 提供多个开箱即用的配置文件,可以通过以下命令查看。

xtuner list-cfg命令用于列出内置的所有配置文件。参数-p或--pattern表示模式匹配,后面跟着的内容将会在所有的配置文件里进行模糊匹配搜索,然后返回最有可能得内容。比如我们这里微调的是书生·浦语的模型,我们就可以匹配搜索internlm2。

conda activate xtuner0121

xtuner list-cfg -p internlm23.2.2.2 复制一个预设的配置文件

由于我们是对internlm2-chat-1_8b模型进行指令微调,所以与我们的需求最匹配的配置文件是 internlm2_chat_1_8b_qlora_alpaca_e3,这里就复制该配置文件。

xtuner copy-cfg命令用于复制一个内置的配置文件。该命令需要两个参数:CONFIG代表需要复制的配置文件名称,SAVE_PATH代表复制的目标路径。在我们的输入的这个命令中,我们的CONFIG对应的是上面搜索到的internlm2_chat_1_8b_qlora_alpaca_e3,而SAVE_PATH则是当前目录.。

cd /root/InternLM/XTuner

conda activate xtuner0121

xtuner copy-cfg internlm2_chat_1_8b_qlora_alpaca_e3 .3.2.2.3 对配置文件进行修改

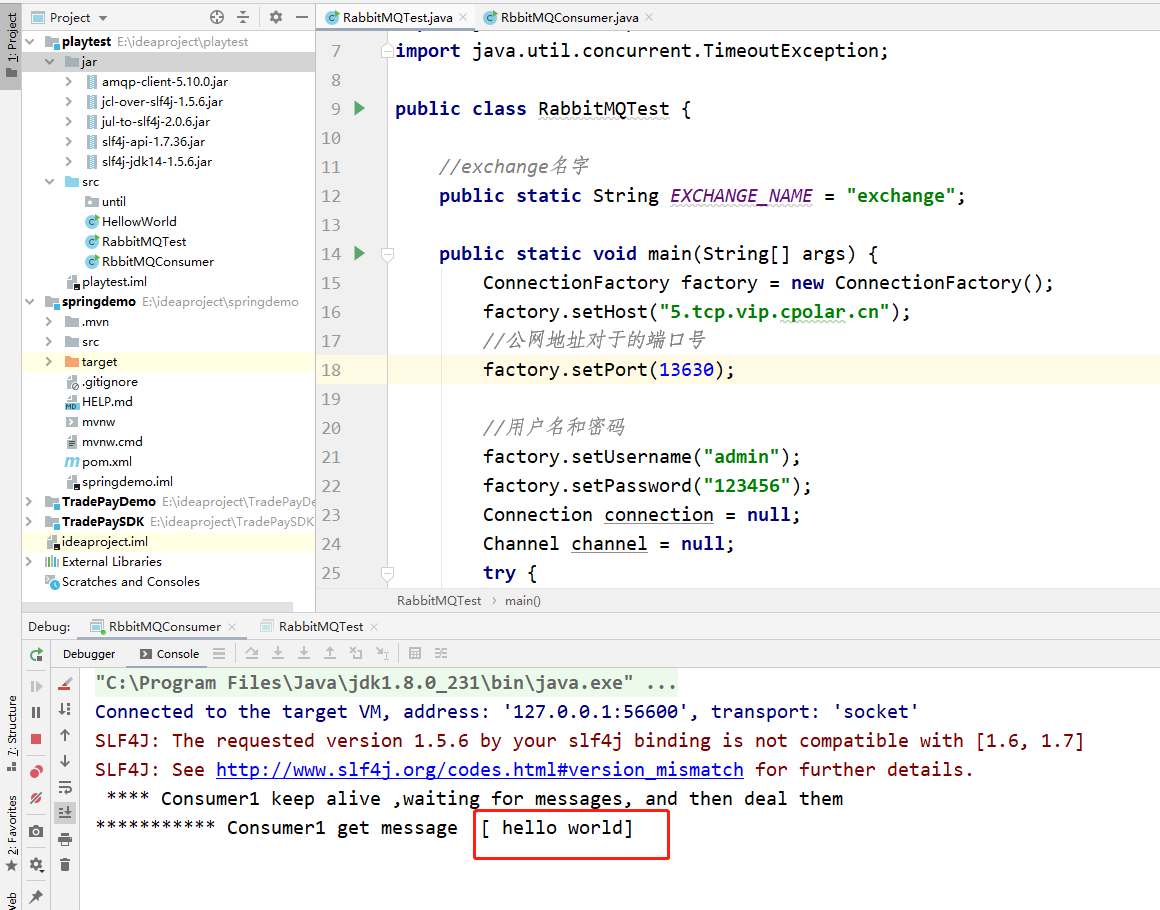

在选择了一个最匹配的配置文件并准备好其他内容后,下面我们要做的事情就是根据我们自己的内容对该配置文件进行调整,使其能够满足我们实际训练的要求。

下面我们将根据项目的需求一步步的进行修改和调整

在 PART 1 的部分,由于我们不再需要在 HuggingFace 上自动下载模型,因此我们先要更换模型的路径以及数据集的路径为我们本地的路径。

为了训练过程中能够实时观察到模型的变化情况,XTuner 贴心的推出了一个 evaluation_inputs 的参数来让我们能够设置多个问题来确保模型在训练过程中的变化是朝着我们想要的方向前进的。我们可以添加自己的输入。

在 PART 3 的部分,由于我们准备的数据集是 JSON 格式的数据,并且对话内容已经是 input 和 output 的数据对,所以不需要进行格式转换。

#######################################################################

# PART 1 Settings #

#######################################################################

- pretrained_model_name_or_path = 'internlm/internlm2-chat-1_8b'

+ pretrained_model_name_or_path = '/root/InternLM/XTuner/Shanghai_AI_Laboratory/internlm2-chat-1_8b'

- alpaca_en_path = 'tatsu-lab/alpaca'

+ alpaca_en_path = 'datas/assistant.json'

evaluation_inputs = [

- '请给我介绍五个上海的景点', 'Please tell me five scenic spots in Shanghai'

+ '请介绍一下你自己', 'Please introduce yourself'

]

#######################################################################

# PART 3 Dataset & Dataloader #

#######################################################################

alpaca_en = dict(

type=process_hf_dataset,

- dataset=dict(type=load_dataset, path=alpaca_en_path),

+ dataset=dict(type=load_dataset, path='json', data_files=dict(train=alpaca_en_path)),

tokenizer=tokenizer,

max_length=max_length,

- dataset_map_fn=alpaca_map_fn,

+ dataset_map_fn=None,

template_map_fn=dict(

type=template_map_fn_factory, template=prompt_template),

remove_unused_columns=True,

shuffle_before_pack=True,

pack_to_max_length=pack_to_max_length,

use_varlen_attn=use_varlen_attn)

除此之外,我们还可以对一些重要的参数进行调整,包括学习率(lr)、训练的轮数(max_epochs)等等。

修改完后的完整的配置文件是:configs/internlm2_chat_1_8b_qlora_alpaca_e3_copy.py。

可以直接复制到当前目录。

cd /root/InternLM/XTuner cp /root/InternLM/Tutorial/configs/internlm2_chat_1_8b_qlora_alpaca_e3_copy.py ./

3.2.3 启动微调

完成了所有的准备工作后,我们就可以正式的开始我们下一阶段的旅程:XTuner 启动~!

接下来,只需要将使用 xtuner train 命令令即可开始训练。

xtuner train命令用于启动模型微调进程。该命令需要一个参数:CONFIG用于指定微调配置文件。这里我们使用修改好的配置文件internlm2_chat_1_8b_qlora_alpaca_e3_copy.py。

训练过程中产生的所有文件,包括日志、配置文件、检查点文件、微调后的模型等,默认保存在work_dirs目录下,我们也可以通过添加--work-dir指定特定的文件保存位置。

cd /root/InternLM/XTuner

conda activate xtuner0121

xtuner train ./internlm2_chat_1_8b_qlora_alpaca_e3_copy.py训练结束:

3.2.4 模型格式转换

模型转换的本质其实就是将原本使用 Pytorch 训练出来的模型权重文件转换为目前通用的 HuggingFace 格式文件,那么我们可以通过以下命令来实现一键转换。使用 xtuner convert pth_to_hf 命令来进行模型格式转换。

cd /root/InternLM/XTuner

conda activate xtuner0121

# 先获取最后保存的一个pth文件

pth_file=`ls -t ./work_dirs/internlm2_chat_1_8b_qlora_alpaca_e3_copy/*.pth | head -n 1`

export MKL_SERVICE_FORCE_INTEL=1

export MKL_THREADING_LAYER=GNU

xtuner convert pth_to_hf ./internlm2_chat_1_8b_qlora_alpaca_e3_copy.py ${pth_file} ./hf模型格式转换完成,目录结构图:

转换完成后,可以看到模型被转换为 HuggingFace 中常用的 .bin 格式文件,这就代表着文件成功被转化为 HuggingFace 格式了。

此时,hf 文件夹即为我们平时所理解的所谓 “LoRA 模型文件”

可以简单理解:LoRA 模型文件 = Adapter

3.2.5 模型合并

对于 LoRA 或者 QLoRA 微调出来的模型其实并不是一个完整的模型,而是一个额外的层(Adapter),训练完的这个层最终还是要与原模型进行合并才能被正常的使用。

对于全量微调的模型(full)其实是不需要进行整合这一步的,因为全量微调修改的是原模型的权重而非微调一个新的 Adapter ,因此是不需要进行模型整合的。

在 XTuner 中提供了一键合并的命令 xtuner convert merge,在使用前我们需要准备好三个路径,包括原模型的路径、训练好的 Adapter 层的(模型格式转换后的)路径以及最终保存的路径。

xtuner convert merge命令用于合并模型。该命令需要三个参数:LLM表示原模型路径,ADAPTER表示 Adapter 层的路径,SAVE_PATH表示合并后的模型最终的保存路径。

在模型合并这一步还有其他很多的可选参数,包括:

cd /root/InternLM/XTuner

conda activate xtuner0121

export MKL_SERVICE_FORCE_INTEL=1

export MKL_THREADING_LAYER=GNU

xtuner convert merge /root/InternLM/XTuner/Shanghai_AI_Laboratory/internlm2-chat-1_8b ./hf ./merged --max-shard-size 2GB模型合并完成后,我们的目录结构:

3.3 微调后的模型对话

微调完成后,我们可以再次运行xtuner_streamlit_demo.py脚本来观察微调后的对话效果,不过在运行之前,我们需要将脚本中的模型路径修改为微调后的模型的路径。

# 直接修改脚本文件第18行 - model_name_or_path = "/root/InternLM/XTuner/Shanghai_AI_Laboratory/internlm2-chat-1_8b" + model_name_or_path = "/root/InternLM/XTuner/merged"

然后,我们可以直接启动应用。

conda activate xtuner0121 streamlit run /root/InternLM/Tutorial/tools/xtuner_streamlit_demo.py

运行后,确保端口映射正常,如果映射已断开则需要重新做一次端口映射。

ssh -CNg -L 8501:127.0.0.1:8501 root@ssh.intern-ai.org.cn -p 43551

最后,通过浏览器访问:http://127.0.0.1:8501 来进行对话了。