第二章.神经网络

2.3 三层神经网络的实现

1.各层间信号传递的实现

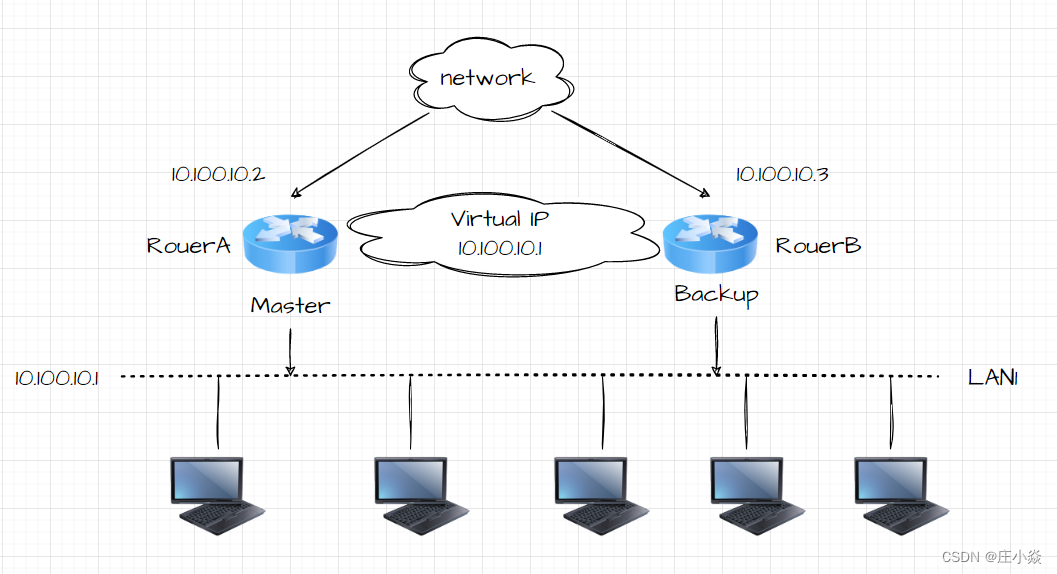

1).示意图:

2).公式:

①.用数学式表示a1(1):

②.用矩阵表示第一层的加权和:

3).实现:

import numpy as np

# 3层神经网络的实现

# 参数初始化

def init_network():

network = {}

network['w1'] = np.array([[0.1, 0.3, 0.5], [0.2, 0.4, 0.6]])

network['b1'] = np.array([0.1, 0.2, 0.3])

network['w2'] = np.array([[0.1, 0.4], [0.2, 0.5], [0.3, 0.6]])

network['b2'] = np.array([0.1, 0.2])

network['w3'] = np.array([[0.1, 0.3], [0.2, 0.4]])

network['b3'] = np.array([0.1, 0.2])

return network

# 激活函数:sigmoid函数

def sigmoid(x):

return 1 / (1 + np.exp(-x))

# 输出函数:恒等函数

def identity_function(x):

return x

# 正向传播

def forward(network, X):

W1, W2, W3 = network['w1'], network['w2'], network['w3']

b1, b2, b3 = network['b1'], network['b2'], network['b3']

# 第一层

a1 = np.dot(X, W1) + b1

z1 = sigmoid(a1)

# 第二层

a2 = np.dot(z1, W2) + b2

z2 = sigmoid(a2)

# 第三层

a3 = np.dot(z2, W3) + b3

y = identity_function(a3)

return y

network = init_network()

X = np.array([1.0, 0.5])

y = forward(network, X)

print(y)

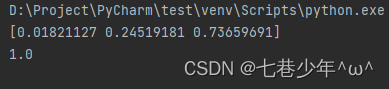

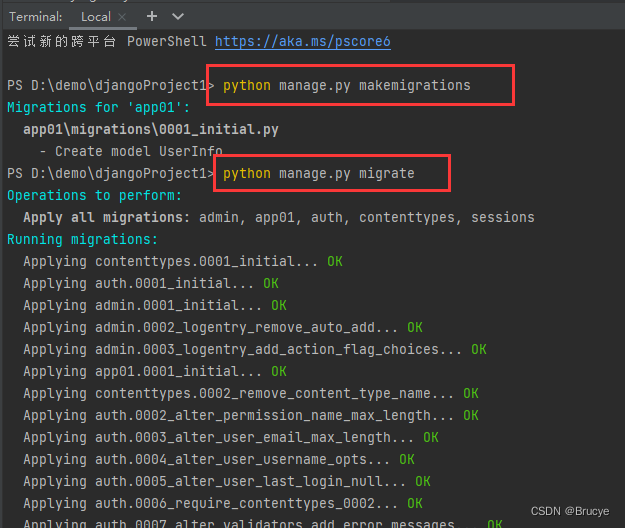

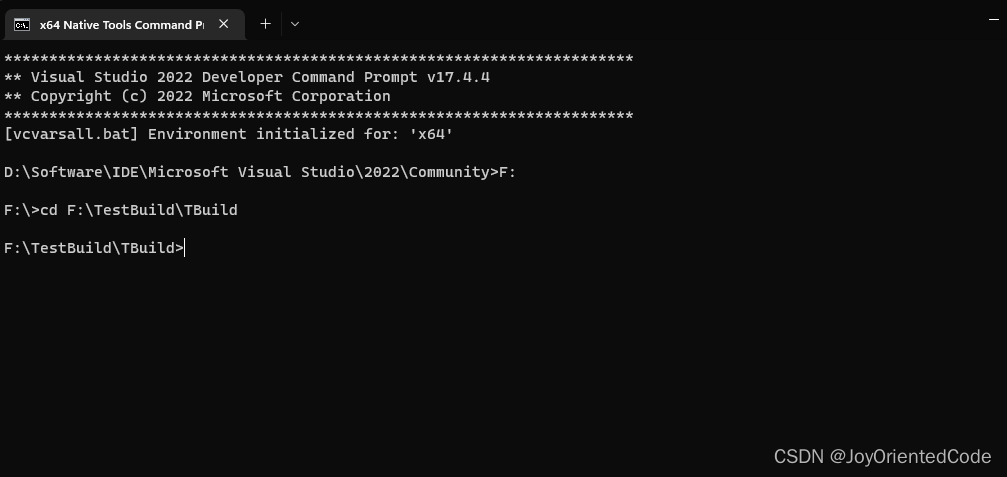

4).结果展示:

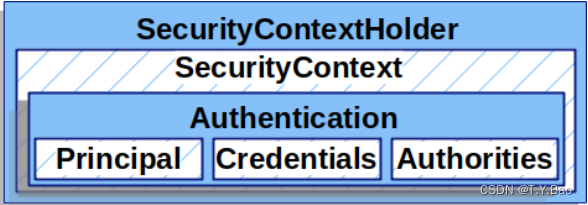

2.4 输出层设计

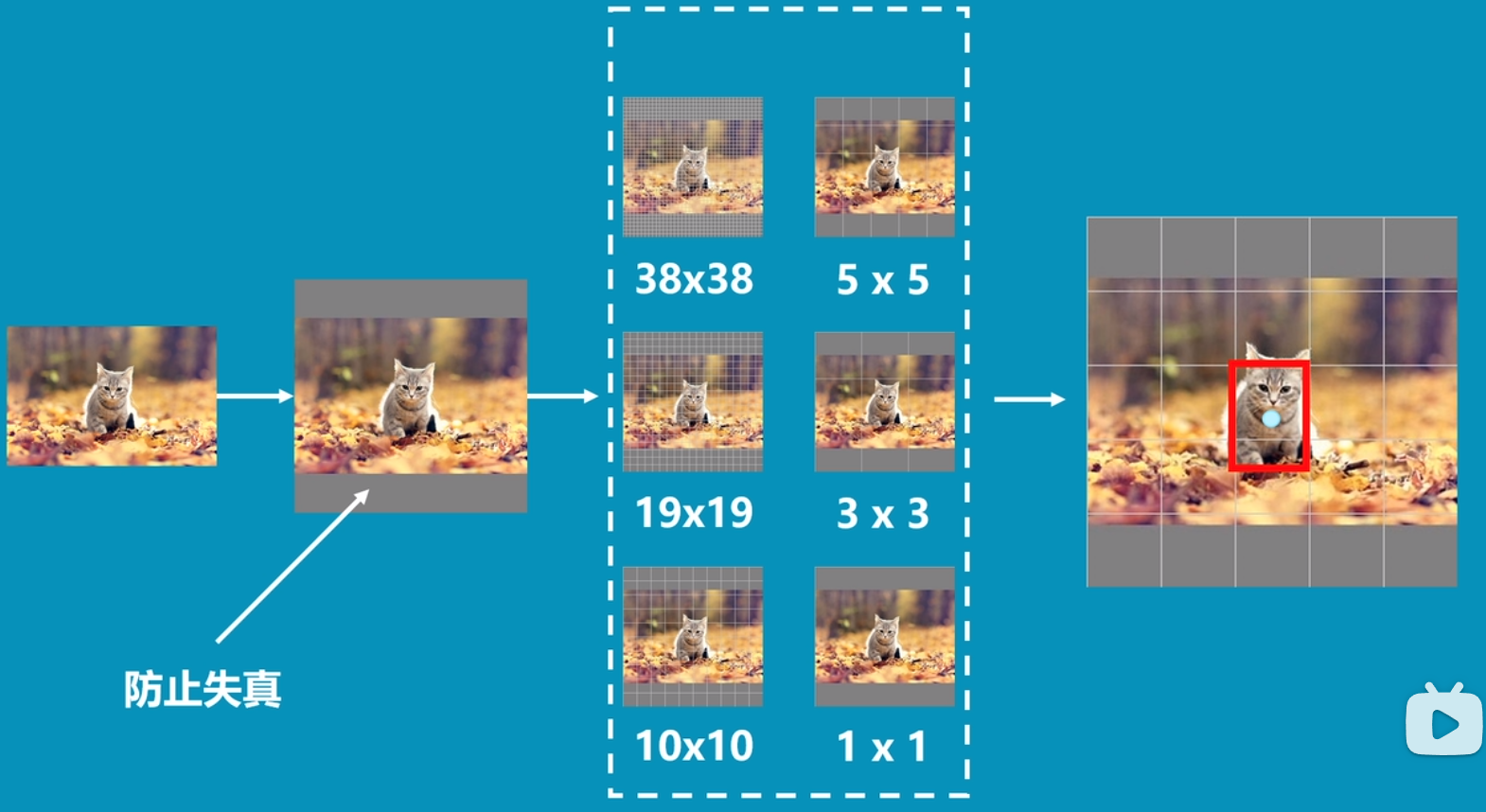

神经网络可以用在分类问题和回归问题上,根据不同的情况使用不同的输出函数。一般而言,回归问题使用恒等函数,分类问题使用softmax函数。

- 回归问题:根据某个输入预测一个(连续的)数值的问题(例如:根据一个人的图像预测这个人的体重)

- 分类问题:数据属于哪一个类别的问题(例如:区分图像中的人是男性还是女性)

1.恒等函数

1).示意图:

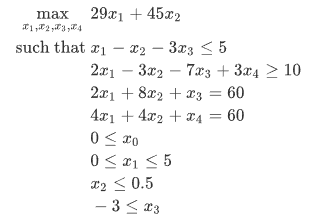

2).公式:

- 恒等函数会将输入信号原样输出。

2.softmax函数

1).示意图:

2).公式:

-

原式:

注意:

①.softmax函数的实现要进行指数函数运算,但是指数函数的值很容易变得非常大(无穷大inf),如果这些超大值之间进行除法运算,结果会出现“不确定”的情况.

计算机处理“数”时,数值必须在4字节或8字节的有限数据宽度内,这意味着数存在有限位数。会出现超大值无法表示的问题,就是溢出。 -

改进后的公式:

注意:

①.分子分母都乘以C这个任意常数,结果是不变的,目的是为了解决数据溢出的问题

②.C这个任意常数:通常会使用输入信号中的最大值

③.在进行Softmax的指数函数运算时,加上或减去某个常数并不会改变运算的结果

3).特征:

-

softmax函数的输出是0.0到1.0之间的实数,并且softmax函数输出值的总和为1,这是softmax函数的一个重要特性,我们可以把softmax函数的输出解释为“概率”.

-

使用了softmax函数,各元素之间的大小关系不会发生改变是因为指数函数(y=ex)是单调递增函数

-

神经网络在进行分类时,输出层的softmax函数可以省略。(因为神经网络只把输出值最大的神经元所对应的类别作为识别结果,即使使用了softmax函数,输出最大神经元的位置也不会发生改变)

-

输出层的神经元数量需要根据待解决的问题来决定。对于分类问题而言,神经元的数量一般设置为类别的数量。

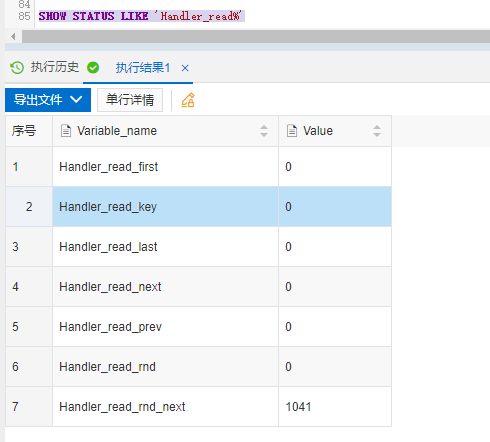

4).实现:

import numpy as np

# 输出层:softmax函数的实现

# 减去输入信号中的最大值是为了解决数据溢出的问题

def softmax(a):

arraymax = np.max(a)

return np.exp(a - arraymax) / np.sum(np.exp(a - arraymax))

a = np.array([0.3, 2.9, 4.0])

y = softmax(a)

print(y)

y_total = np.sum(y)

print(y_total)

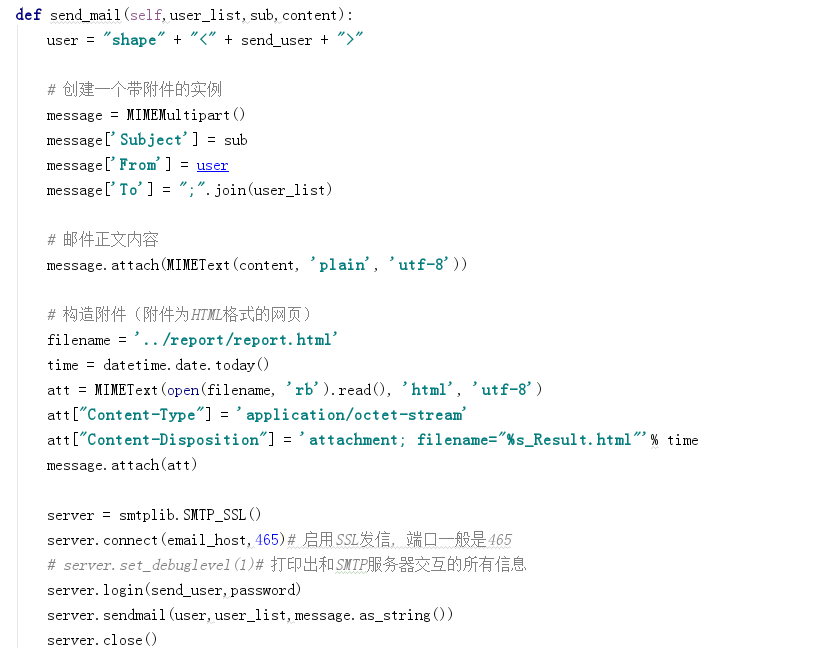

5).结果展示: