解决AI训练中的“Convergence Warning”报错:提高模型稳定性 🏋️♂️

- 解决AI训练中的“Convergence Warning”报错:提高模型稳定性 🏋️♂️

- 摘要

- 引言

- “Convergence Warning”报错的成因分析 🤔

- 1. 学习率设置不当

- 2. 数据预处理问题

- 3. 模型复杂度与数据量不匹配

- 提高模型稳定性的技巧 💡

- 1. 动态调整学习率

- 2. 数据增强

- 3. 使用早停(Early Stopping)

- 4. 正则化技术

- 🤔 QA环节

- 小结 📌

- 总结

- 未来展望

- 参考资料

博主 默语带您 Go to New World.

✍ 个人主页—— 默语 的博客👦🏻

《java 面试题大全》

《java 专栏》

🍩惟余辈才疏学浅,临摹之作或有不妥之处,还请读者海涵指正。☕🍭

《MYSQL从入门到精通》数据库是开发者必会基础之一~

🪁 吾期望此文有资助于尔,即使粗浅难及深广,亦备添少许微薄之助。苟未尽善尽美,敬请批评指正,以资改进。!💻⌨

解决AI训练中的“Convergence Warning”报错:提高模型稳定性 🏋️♂️

👋 大家好,我是默语,擅长全栈开发、运维和人工智能技术。在我的博客中,我主要分享技术教程、Bug解决方案、开发工具指南、前沿科技资讯、产品评测、使用体验、优点推广和横向对比评测等内容。希望通过这些分享,帮助大家更好地了解和使用各种技术产品。今天,我们将深入探讨AI训练中的一个常见问题——“Convergence Warning”报错,并提供提高模型稳定性的解决方案。

摘要

在训练AI模型时,“Convergence Warning”报错常常困扰着开发者。这类警告通常提示模型在训练过程中未能收敛,导致结果不稳定或不准确。本文将详细分析“Convergence Warning”报错的成因,并提供一系列提高模型稳定性的技巧和方法,以帮助大家优化模型训练过程。🌟

引言

深度学习模型在训练过程中,收敛性是衡量模型性能的一个关键指标。若模型在训练过程中出现“Convergence Warning”报错,往往意味着模型在某些迭代中无法达到预期的误差阈值,从而影响最终的预测结果。理解并解决这一问题对于提升模型的稳定性和准确性至关重要。

“Convergence Warning”报错的成因分析 🤔

1. 学习率设置不当

学习率是影响模型训练速度和稳定性的重要参数。过高的学习率可能导致模型在训练过程中震荡,无法收敛;而过低的学习率则可能导致训练过程过慢,甚至陷入局部最优。

import torch.optim as optim

# 示例:设置适当的学习率

optimizer = optim.SGD(model.parameters(), lr=0.01)

2. 数据预处理问题

不合理的数据预处理可能导致训练数据分布不均,进而影响模型的收敛性。例如,数据标准化和归一化处理不当可能导致特征值范围差异过大,影响梯度下降过程。

from sklearn.preprocessing import StandardScaler

# 示例:数据标准化

scaler = StandardScaler()

train_data = scaler.fit_transform(train_data)

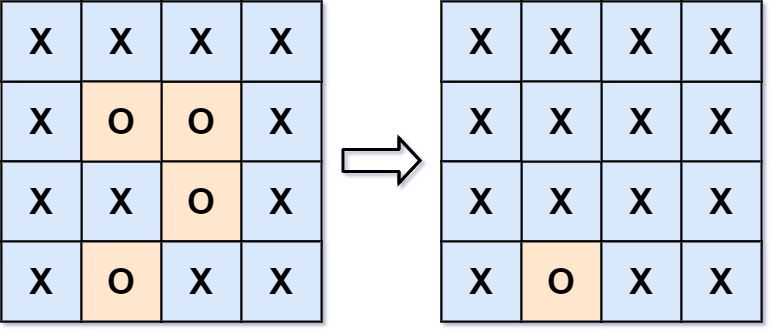

3. 模型复杂度与数据量不匹配

若模型过于复杂但训练数据量不足,可能导致模型难以有效学习,从而出现收敛性问题。反之,模型过于简单而数据量过大,也会影响模型的收敛效果。

# 示例:简化模型结构

import torch.nn as nn

class SimpleModel(nn.Module):

def __init__(self):

super(SimpleModel, self).__init__()

self.fc1 = nn.Linear(100, 50)

self.fc2 = nn.Linear(50, 10)

def forward(self, x):

x = torch.relu(self.fc1(x))

x = self.fc2(x)

return x

model = SimpleModel()

提高模型稳定性的技巧 💡

1. 动态调整学习率

通过动态调整学习率,可以在训练过程中自动优化学习率,避免因学习率设置不当导致的收敛性问题。

# 示例:使用学习率调度器

scheduler = optim.lr_scheduler.StepLR(optimizer, step_size=30, gamma=0.1)

for epoch in range(100):

train(model, train_loader, optimizer)

scheduler.step()

2. 数据增强

数据增强技术可以有效增加训练数据量,提高模型的泛化能力,进而提升收敛性。

from torchvision import transforms

# 示例:数据增强

transform = transforms.Compose([

transforms.RandomHorizontalFlip(),

transforms.RandomRotation(10),

transforms.ToTensor()

])

train_dataset = torchvision.datasets.CIFAR10(root='./data', train=True, download=True, transform=transform)

3. 使用早停(Early Stopping)

早停技术可以在验证集误差不再下降时停止训练,避免过拟合,提高模型的收敛效果。

# 示例:早停

from torch.utils.tensorboard import SummaryWriter

writer = SummaryWriter()

early_stopping = EarlyStopping(patience=10, verbose=True)

for epoch in range(100):

train(model, train_loader, optimizer)

val_loss = validate(model, val_loader)

early_stopping(val_loss, model)

if early_stopping.early_stop:

print("Early stopping")

break

4. 正则化技术

通过L1、L2正则化或Dropout技术,可以有效防止模型过拟合,提高模型的收敛性。

# 示例:Dropout

class RegularizedModel(nn.Module):

def __init__(self):

super(RegularizedModel, self).__init__()

self.fc1 = nn.Linear(100, 50)

self.dropout = nn.Dropout(0.5)

self.fc2 = nn.Linear(50, 10)

def forward(self, x):

x = torch.relu(self.fc1(x))

x = self.dropout(x)

x = self.fc2(x)

return x

model = RegularizedModel()

🤔 QA环节

Q1: 学习率动态调整有什么好处?

A: 动态调整学习率可以在模型训练过程中自动优化学习率,避免因学习率设置不当导致的模型震荡或训练过程过慢问题,从而提高模型的收敛性。

Q2: 为什么数据增强可以提高模型的收敛性?

A: 数据增强技术通过增加训练数据的多样性,提升模型的泛化能力,防止过拟合,从而提高模型的收敛性和稳定性。

小结 📌

通过动态调整学习率、数据增强、使用早停和正则化技术等方法,可以有效解决AI模型训练中的“Convergence Warning”报错,提高模型的收敛性和稳定性。这些优化技巧不仅能够提升模型的性能,还能加速模型的收敛。

总结

在本文中,我们详细分析了“Convergence Warning”报错的成因,并提供了一系列提高模型稳定性的技巧。希望这些方法能够帮助大家更好地进行AI模型的训练。如果你有任何问题或更好的建议,欢迎在评论区分享!👇

未来展望

随着AI技术的不断发展,训练过程中的问题也会日益复杂。我们需要不断学习和探索新的方法,解决训练过程中遇到的各种挑战。期待在未来的文章中,与大家一起探讨更多AI领域的前沿问题和解决方案。

参考资料

- PyTorch官方文档

- 深度学习入门:基于Python的理论与实现

- Batch Normalization的研究与应用

🪁🍁 希望本文能够给您带来一定的帮助🌸文章粗浅,敬请批评指正!🍁🐥

🪁🍁 如对本文内容有任何疑问、建议或意见,请联系作者,作者将尽力回复并改进📓;(联系微信:Solitudemind )🍁🐥

🪁点击下方名片,加入IT技术核心学习团队。一起探索科技的未来,共同成长。🐥

![AGI 之 【Hugging Face】 的【零样本和少样本学习】之一 [构建标记任务] / [ 基线模型 ] 的简单整理](https://i-blog.csdnimg.cn/direct/e7edf60e2c134c789d7b6631313e8a28.png)