昇思25天学习打卡营第14天 | ShuffleNet图像分类

文章目录

- 昇思25天学习打卡营第14天 | ShuffleNet图像分类

- ShuffleNet

- Pointwise Group Convolution

- Channel Shuffle

- ShuffleNet模块

- 网络构建

- 模型训练与评估

- 数据集

- 训练

- 模型评估

- 模型预测

- 总结

- 打卡

ShuffleNet

ShuffleNetV1是旷世科技提出的一种计算高效的CNN模型,这种模型利用有限的计算资源来达到最好的模型精度,主要应用在移动端。

ShuffleNetV1的核心是引入了两种操作:

- Pointwise Group Convolution

- Channel Shuffle

这两种操作在保持精度的同时大大降低了模型的计算量。

Pointwise Group Convolution

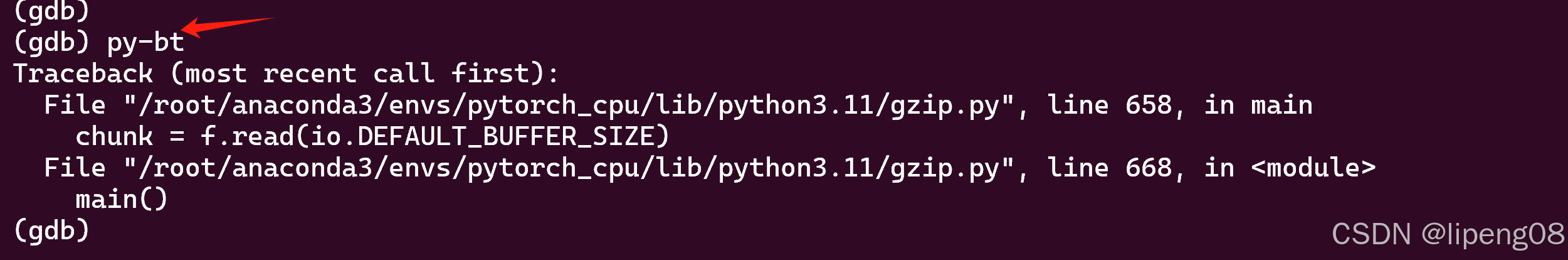

Group Convolution(分组卷积)相对于普通卷积,每一组的卷积核大小为

in_channels

/

g

∗

k

∗

k

\text{in\_channels} / g * k *k

in_channels/g∗k∗k,一共有

g

g

g组,所有组共有

(

in_channels

/

g

∗

k

∗

k

)

∗

out_channels

(\text{in\_channels}/g*k*k)*\text{out\_channels}

(in_channels/g∗k∗k)∗out_channels个参数,是正常卷积参数的

1

/

g

1/g

1/g。

分组卷积的每个卷积核只处理特征图的一部分通道,但输出通道数仍等于卷积核的数量。

图片来源:Huang G, Liu S, Van der Maaten L, et al. Condensenet: An efficient densenet using learned group convolutions[C]//Proceedings of the IEEE conference on computer vision and pattern recognition. 2018: 2752-2761.

Depthwise Convolution(深度可分离卷积)将输入特征图的每个通道分开,分别使用一个卷积核进行卷积,假设卷积核大小为 1 × k × k 1\times k\times k 1×k×k,其中 1 1 1表示只对一个通道进行卷积。由于有in_channels个卷积核,故有 in_channels × k × k \text{in\_channels}\times k \times k in_channels×k×k个参数,得到的特征图通道数与输入相同。

Pointwise Group Convolution(逐点分组卷积)在分组卷积的基础上,令每一组卷积核大小为 1 × 1 1\times 1 1×1,故共有 ( in_channels / g × 1 × 1 ) × out_channels (\text{in\_channels}/g\times1\times1)\times \text{out\_channels} (in_channels/g×1×1)×out_channels个参数。

from mindspore import nn

import mindspore.ops as ops

from mindspore import Tensor

class GroupConv(nn.Cell):

def __init__(self, in_channels, out_channels, kernel_size,

stride, pad_mode="pad", pad=0, groups=1, has_bias=False):

super(GroupConv, self).__init__()

self.groups = groups

self.convs = nn.CellList()

for _ in range(groups):

self.convs.append(nn.Conv2d(in_channels // groups, out_channels // groups,

kernel_size=kernel_size, stride=stride, has_bias=has_bias,

padding=pad, pad_mode=pad_mode, group=1, weight_init='xavier_uniform'))

def construct(self, x):

features = ops.split(x, split_size_or_sections=int(len(x[0]) // self.groups), axis=1)

outputs = ()

for i in range(self.groups):

outputs = outputs + (self.convs[i](features[i].astype("float32")),)

out = ops.cat(outputs, axis=1)

return out

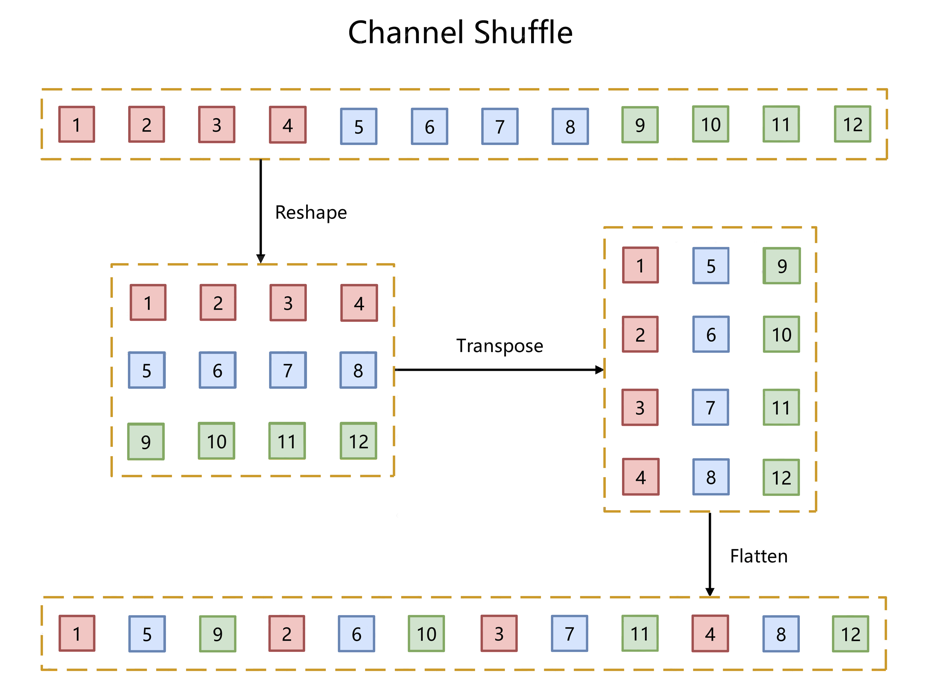

Channel Shuffle

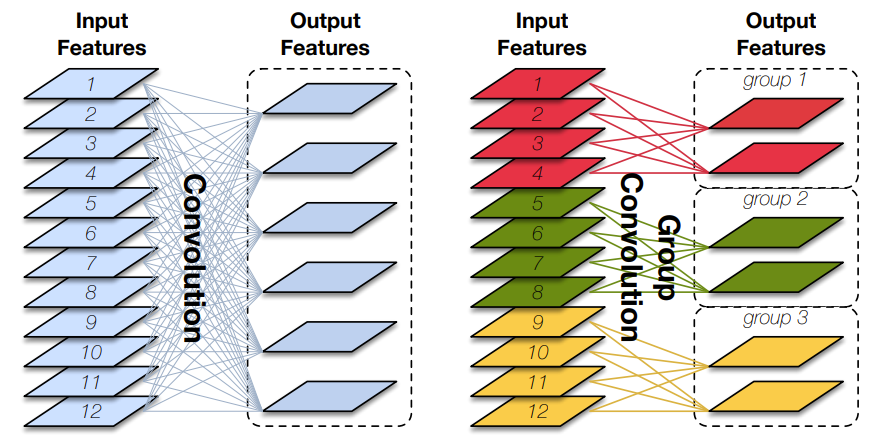

Group Convolution只能保证组内的特征提取,而不同组之间的特征是不通信的,这就降低了网络的特征提取能力。

为了解决这个问题,ShuffleNet引入了Channel Shuffle机制,将不同分组通道均匀分散重组,使得网络在下一层能处理不同组别通道的信息。

对于

g

g

g组,每组有

n

n

n个通道的特征图:

reshape为 g × n g\times n g×n的矩阵;- 转置为 n × g n\times g n×g的矩阵;

- 通过

flatten操作得到新的排列。

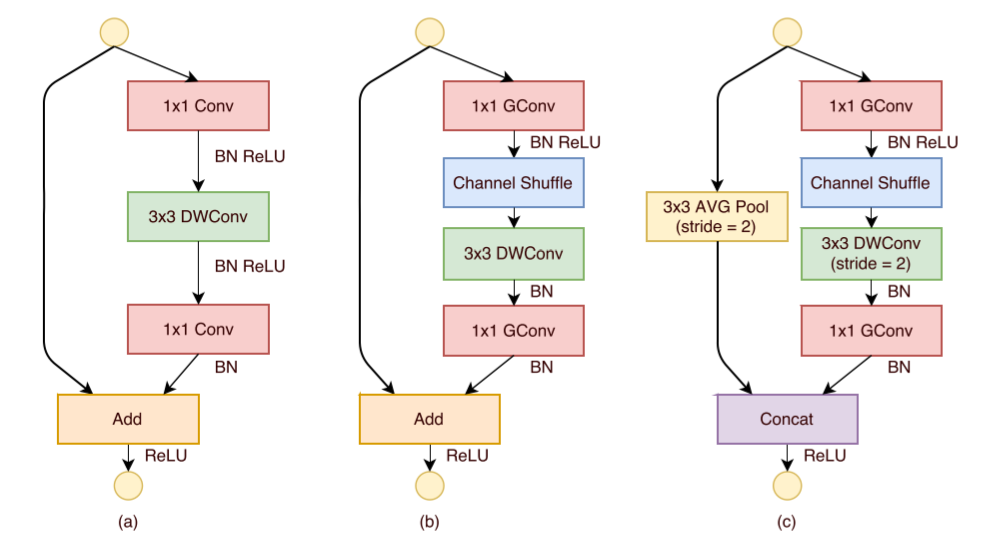

ShuffleNet模块

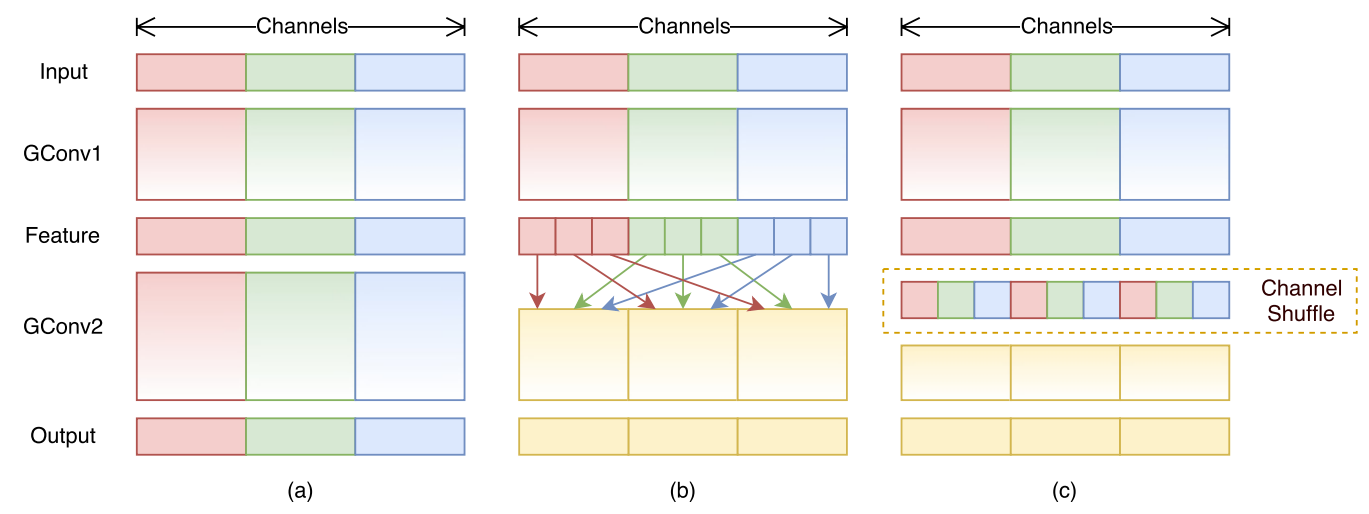

ShuffleNet对ResNet中Bottleneck结构进行由(a)到(b), (c)的更改:

- 将开始和最后的 1 × 1 1\times 1 1×1卷积模块改成Pointwise Group Convolution;

- 在降维后进行Channel Shuffle;

- 降采样模块中, 3 × 3 3\times 3 3×3Depthwise Convolution 的步长设置为2,特征图大小减半,因此shortcuts中采用步长为2的 3 × 3 3\times 3 3×3平均池化,并把相加改成拼接。

class ShuffleV1Block(nn.Cell):

def __init__(self, inp, oup, group, first_group, mid_channels, ksize, stride):

super(ShuffleV1Block, self).__init__()

self.stride = stride

pad = ksize // 2

self.group = group

if stride == 2:

outputs = oup - inp

else:

outputs = oup

self.relu = nn.ReLU()

branch_main_1 = [

GroupConv(in_channels=inp, out_channels=mid_channels,

kernel_size=1, stride=1, pad_mode="pad", pad=0,

groups=1 if first_group else group),

nn.BatchNorm2d(mid_channels),

nn.ReLU(),

]

branch_main_2 = [

nn.Conv2d(mid_channels, mid_channels, kernel_size=ksize, stride=stride,

pad_mode='pad', padding=pad, group=mid_channels,

weight_init='xavier_uniform', has_bias=False),

nn.BatchNorm2d(mid_channels),

GroupConv(in_channels=mid_channels, out_channels=outputs,

kernel_size=1, stride=1, pad_mode="pad", pad=0,

groups=group),

nn.BatchNorm2d(outputs),

]

self.branch_main_1 = nn.SequentialCell(branch_main_1)

self.branch_main_2 = nn.SequentialCell(branch_main_2)

if stride == 2:

self.branch_proj = nn.AvgPool2d(kernel_size=3, stride=2, pad_mode='same')

def construct(self, old_x):

left = old_x

right = old_x

out = old_x

right = self.branch_main_1(right)

if self.group > 1:

right = self.channel_shuffle(right)

right = self.branch_main_2(right)

if self.stride == 1:

out = self.relu(left + right)

elif self.stride == 2:

left = self.branch_proj(left)

out = ops.cat((left, right), 1)

out = self.relu(out)

return out

def channel_shuffle(self, x):

batchsize, num_channels, height, width = ops.shape(x)

group_channels = num_channels // self.group

x = ops.reshape(x, (batchsize, group_channels, self.group, height, width))

x = ops.transpose(x, (0, 2, 1, 3, 4))

x = ops.reshape(x, (batchsize, num_channels, height, width))

return x

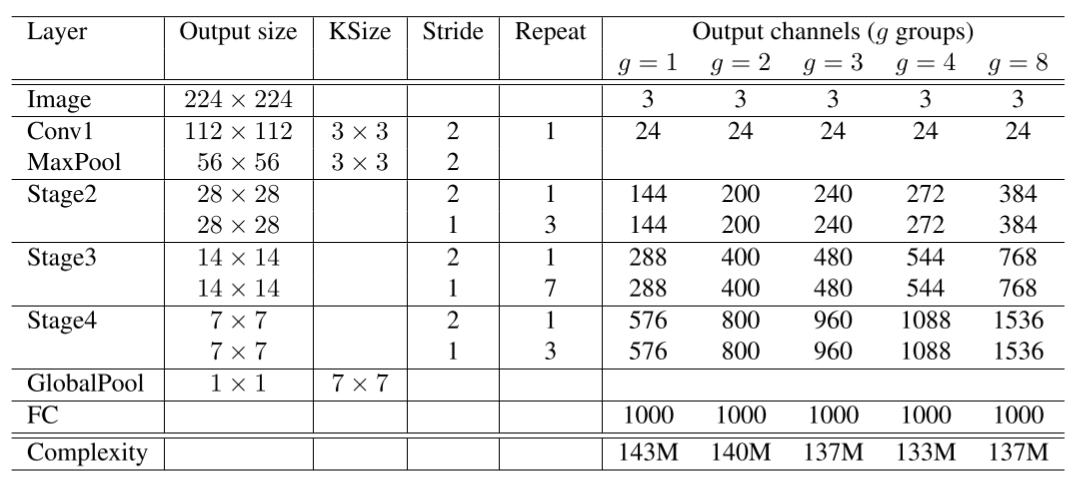

网络构建

class ShuffleNetV1(nn.Cell):

def __init__(self, n_class=1000, model_size='2.0x', group=3):

super(ShuffleNetV1, self).__init__()

print('model size is ', model_size)

self.stage_repeats = [4, 8, 4]

self.model_size = model_size

if group == 3:

if model_size == '0.5x':

self.stage_out_channels = [-1, 12, 120, 240, 480]

elif model_size == '1.0x':

self.stage_out_channels = [-1, 24, 240, 480, 960]

elif model_size == '1.5x':

self.stage_out_channels = [-1, 24, 360, 720, 1440]

elif model_size == '2.0x':

self.stage_out_channels = [-1, 48, 480, 960, 1920]

else:

raise NotImplementedError

elif group == 8:

if model_size == '0.5x':

self.stage_out_channels = [-1, 16, 192, 384, 768]

elif model_size == '1.0x':

self.stage_out_channels = [-1, 24, 384, 768, 1536]

elif model_size == '1.5x':

self.stage_out_channels = [-1, 24, 576, 1152, 2304]

elif model_size == '2.0x':

self.stage_out_channels = [-1, 48, 768, 1536, 3072]

else:

raise NotImplementedError

input_channel = self.stage_out_channels[1]

self.first_conv = nn.SequentialCell(

nn.Conv2d(3, input_channel, 3, 2, 'pad', 1, weight_init='xavier_uniform', has_bias=False),

nn.BatchNorm2d(input_channel),

nn.ReLU(),

)

self.maxpool = nn.MaxPool2d(kernel_size=3, stride=2, pad_mode='same')

features = []

for idxstage in range(len(self.stage_repeats)):

numrepeat = self.stage_repeats[idxstage]

output_channel = self.stage_out_channels[idxstage + 2]

for i in range(numrepeat):

stride = 2 if i == 0 else 1

first_group = idxstage == 0 and i == 0

features.append(ShuffleV1Block(input_channel, output_channel,

group=group, first_group=first_group,

mid_channels=output_channel // 4, ksize=3, stride=stride))

input_channel = output_channel

self.features = nn.SequentialCell(features)

self.globalpool = nn.AvgPool2d(7)

self.classifier = nn.Dense(self.stage_out_channels[-1], n_class)

def construct(self, x):

x = self.first_conv(x)

x = self.maxpool(x)

x = self.features(x)

x = self.globalpool(x)

x = ops.reshape(x, (-1, self.stage_out_channels[-1]))

x = self.classifier(x)

return x

模型训练与评估

数据集

采用CIFAR-10数据集进行预训练。

import mindspore as ms

from mindspore.dataset import Cifar10Dataset

from mindspore.dataset import vision, transforms

def get_dataset(train_dataset_path, batch_size, usage):

image_trans = []

if usage == "train":

image_trans = [

vision.RandomCrop((32, 32), (4, 4, 4, 4)),

vision.RandomHorizontalFlip(prob=0.5),

vision.Resize((224, 224)),

vision.Rescale(1.0 / 255.0, 0.0),

vision.Normalize([0.4914, 0.4822, 0.4465], [0.2023, 0.1994, 0.2010]),

vision.HWC2CHW()

]

elif usage == "test":

image_trans = [

vision.Resize((224, 224)),

vision.Rescale(1.0 / 255.0, 0.0),

vision.Normalize([0.4914, 0.4822, 0.4465], [0.2023, 0.1994, 0.2010]),

vision.HWC2CHW()

]

label_trans = transforms.TypeCast(ms.int32)

dataset = Cifar10Dataset(train_dataset_path, usage=usage, shuffle=True)

dataset = dataset.map(image_trans, 'image')

dataset = dataset.map(label_trans, 'label')

dataset = dataset.batch(batch_size, drop_remainder=True)

return dataset

dataset = get_dataset("./dataset/cifar-10-batches-bin", 128, "train")

batches_per_epoch = dataset.get_dataset_size()

训练

import time

import mindspore

import numpy as np

from mindspore import Tensor, nn

from mindspore.train import ModelCheckpoint, CheckpointConfig, TimeMonitor, LossMonitor, Model, Top1CategoricalAccuracy, Top5CategoricalAccuracy

def train():

mindspore.set_context(mode=mindspore.PYNATIVE_MODE, device_target="Ascend")

net = ShuffleNetV1(model_size="2.0x", n_class=10)

loss = nn.CrossEntropyLoss(weight=None, reduction='mean', label_smoothing=0.1)

min_lr = 0.0005

base_lr = 0.05

lr_scheduler = mindspore.nn.cosine_decay_lr(min_lr,

base_lr,

batches_per_epoch*250,

batches_per_epoch,

decay_epoch=250)

lr = Tensor(lr_scheduler[-1])

optimizer = nn.Momentum(params=net.trainable_params(), learning_rate=lr, momentum=0.9, weight_decay=0.00004, loss_scale=1024)

loss_scale_manager = ms.amp.FixedLossScaleManager(1024, drop_overflow_update=False)

model = Model(net, loss_fn=loss, optimizer=optimizer, amp_level="O3", loss_scale_manager=loss_scale_manager)

callback = [TimeMonitor(), LossMonitor()]

save_ckpt_path = "./"

config_ckpt = CheckpointConfig(save_checkpoint_steps=batches_per_epoch, keep_checkpoint_max=5)

ckpt_callback = ModelCheckpoint("shufflenetv1", directory=save_ckpt_path, config=config_ckpt)

callback += [ckpt_callback]

print("============== Starting Training ==============")

start_time = time.time()

# 由于时间原因,epoch = 5,可根据需求进行调整

model.train(5, dataset, callbacks=callback)

use_time = time.time() - start_time

hour = str(int(use_time // 60 // 60))

minute = str(int(use_time // 60 % 60))

second = str(int(use_time % 60))

print("total time:" + hour + "h " + minute + "m " + second + "s")

print("============== Train Success ==============")

if __name__ == '__main__':

train()

模型评估

调用model.eval()接口对模型进行评估。

from mindspore import load_checkpoint, load_param_into_net

def test():

mindspore.set_context(mode=mindspore.GRAPH_MODE, device_target="Ascend")

dataset = get_dataset("./dataset/cifar-10-batches-bin", 128, "test")

net = ShuffleNetV1(model_size="2.0x", n_class=10)

param_dict = load_checkpoint("shufflenetv1-5_390.ckpt")

load_param_into_net(net, param_dict)

net.set_train(False)

loss = nn.CrossEntropyLoss(weight=None, reduction='mean', label_smoothing=0.1)

eval_metrics = {'Loss': nn.Loss(), 'Top_1_Acc': Top1CategoricalAccuracy(),

'Top_5_Acc': Top5CategoricalAccuracy()}

model = Model(net, loss_fn=loss, metrics=eval_metrics)

start_time = time.time()

res = model.eval(dataset, dataset_sink_mode=False)

use_time = time.time() - start_time

hour = str(int(use_time // 60 // 60))

minute = str(int(use_time // 60 % 60))

second = str(int(use_time % 60))

log = "result:" + str(res) + ", ckpt:'" + "./shufflenetv1-5_390.ckpt" \

+ "', time: " + hour + "h " + minute + "m " + second + "s"

print(log)

filename = './eval_log.txt'

with open(filename, 'a') as file_object:

file_object.write(log + '\n')

if __name__ == '__main__':

test()

模型预测

import mindspore

import matplotlib.pyplot as plt

import mindspore.dataset as ds

net = ShuffleNetV1(model_size="2.0x", n_class=10)

show_lst = []

param_dict = load_checkpoint("shufflenetv1-5_390.ckpt")

load_param_into_net(net, param_dict)

model = Model(net)

dataset_predict = ds.Cifar10Dataset(dataset_dir="./dataset/cifar-10-batches-bin", shuffle=False, usage="train")

dataset_show = ds.Cifar10Dataset(dataset_dir="./dataset/cifar-10-batches-bin", shuffle=False, usage="train")

dataset_show = dataset_show.batch(16)

show_images_lst = next(dataset_show.create_dict_iterator())["image"].asnumpy()

image_trans = [

vision.RandomCrop((32, 32), (4, 4, 4, 4)),

vision.RandomHorizontalFlip(prob=0.5),

vision.Resize((224, 224)),

vision.Rescale(1.0 / 255.0, 0.0),

vision.Normalize([0.4914, 0.4822, 0.4465], [0.2023, 0.1994, 0.2010]),

vision.HWC2CHW()

]

dataset_predict = dataset_predict.map(image_trans, 'image')

dataset_predict = dataset_predict.batch(16)

class_dict = {0:"airplane", 1:"automobile", 2:"bird", 3:"cat", 4:"deer", 5:"dog", 6:"frog", 7:"horse", 8:"ship", 9:"truck"}

# 推理效果展示(上方为预测的结果,下方为推理效果图片)

plt.figure(figsize=(16, 5))

predict_data = next(dataset_predict.create_dict_iterator())

output = model.predict(ms.Tensor(predict_data['image']))

pred = np.argmax(output.asnumpy(), axis=1)

index = 0

for image in show_images_lst:

plt.subplot(2, 8, index+1)

plt.title('{}'.format(class_dict[pred[index]]))

index += 1

plt.imshow(image)

plt.axis("off")

plt.show()

总结

这一节介绍了ShuffleNet的基本结构,为了在移动设备这样的有限资源上进行训练,ShuffleNet提出了Pointwise Group Convolution操作以大幅减少参数量,使用Channel Shuffle来确保网络的特征提取能力。通过在ResNet的Bottleneck结构中应用上面的两种操作,得到ShuffleNet的基本网络模块。

打卡