如果你还记得今年的 Google I/O大会,你肯定注意到了他们今年发布的 Astra,一个人工智能体(AI Agent)。事实上,目前最新的 GPT-4o 也是个 AI Agent。

现在各大科技公司正在投入巨额资金来创建人工智能体(AI Agent),他们的研究工作可能会带给我们几十年以来一直追寻的那种实用且可以自由互动的人工智能。包括Sam Altman在内的许多专家都表示,AI Agent 已成为下一个大热门方向。

接下来,我们聊聊什么是 AI Agent,以及如何创建一个基本的人工智能体。我们将会用到LangGraph和Ollama这两个可以简化本地人工智能体构建的强大工具。听我们讲完,你将全面了解如何利用这些技术创建适合你特定需求的高效人工智能体。

什么是人工智能体(AI Agent)?

事实上,AI Agent 的研究还处于早期阶段,该领域还没有明确的定义。但是 Astra 和 GPT-4o 已经可以成为一个很好的早期示例了。NVIDIA 高级研究员、AI Agent 项目负责人 Jim Fan 表示,我们距离出现一个有实体的 AI Agent 或者说以 ChatGPT 作为内核的机器人,还有大约 3 年的时间。如果用他话来解释什么是 AI Agent,简单来说,AI Agent 就是能够在动态世界中自主决策的 AI 模型和算法。

严格意义上讲,人工智能体是感知环境并采取行动以实现特定目标或目的的软件或系统。这些AI Agent可以是简单的算法,也可以是能够进行复杂操作的复杂系统。以下是人工智能体的一些特点:

- 感知:人工智能体使用传感器或输入机制来感知环境。这可能涉及从摄像头、麦克风或其他传感器等各种来源收集数据。

- 推理:人工智能体接收信息并使用算法和模型来处理和解释数据。这一步包括理解模式、做出预测或产生反应。

- 决策:人工智能体会根据自己的感知和推理来决定行动或产出。这些决策旨在实现其程序或学习过程中确定的特定目标或目的。此外,人工智能体将更多地充当助手,而不是取代人类。

- 行动:人工智能体根据自己的决定执行行动。这可能涉及现实世界中的物理行动(如移动机械臂)或数字环境中的虚拟行动(如在应用程序中进行推荐)。

医疗保健系统是人工智能体落地应用的一个很合适的领域,它可以分析来自不同病人的不同数据,如医疗记录、测试结果和实时监控设备。然后,这些人工智能体利用这些数据可以帮助做出判断和决策,例如预测病人患上某种特定疾病的可能性,或根据病人的病史和当前健康状况推荐个性化的治疗方案。例如,医疗保健领域的人工智能体可以通过分析医学影像数据中的细微信息帮助医生提早诊断疾病,或根据实时生理数据,建议调整药物剂量。

人工智能体不仅提高了医疗诊断的准确性,还能提供个性化的治疗方案,提高整体医疗质量。除了医疗系统以外,还有很多人工智能体适合的场景和行业,比如游戏。

Fan 所在的团队在热门游戏 Minecraft 中开发了一个名为MineDojo的 AI Agent。利用从互联网收集的大量数据,Fan 的 AI Agent 能够学习新技能和新任务,从而自由探索游戏世界,并完成一些复杂的任务,例如用栅栏围住动物或将熔岩倒入桶里。开放世界游戏可能是 AI Agent 步入现实世界的前一站,因为它给了 AI Agent 了解物理、推理和常识的训练场。

一篇普林斯顿大学的论文表示,人工智能代理往往具有三种不同的特征。如果人工智能系统能够在复杂环境中无需指令就能实现比较复杂的目标,那么它们就可以被视为具有“Agent”潜质的。第二个特征是,如果它们能够用自然语言接受指令,并在无人监督的情况下自主行动。最后,“Agent”一词还适用于能够使用工具(比如搜索或编程)或具有规划能力的系统。

人工智能体 AI Agent 还存在哪些局限?

事实上,我们距离拥有一个可以完全自主完成琐事的AI Agent 还差得很远,因为目前的系统总会出现一些偏差,不会总严格地遵循指令行事。例如,负责编码的 AI Agent 可以生成代码,但有时会出错,而且它不知道如何测试它正在创建的代码。所以,如果你去使用这样的 Agent,你仍然需要积极参与编码的过程,而且这还要求你必须具备编码的能力和知识,即你对 AI Agent 的要求一定要在你的“认知”范围内。

另一个问题就是,AI Agent 在处理一个事项一段时间后,会忘记自己正在处理什么。这是因为它的系统受到其上下文窗口的限制,即它们在给定时间可以处理的数据量。 例如,你可以让 ChatGPT 进行编写代码,但它却不能很好地处理长篇的信息,它不能像一个普通工程师一样轻松地浏览一个代码库里数百行的代码。所以在年初的时候,Google 提高了 Gemini 模型处理数据的能力,让用户可以与模型进行更长时间的互动,并记住更多已经发生的对话内容。Google 也表示,未来努力使其上下文窗口接近无限。

人工智能体与 RAG 的区别

RAG(检索-增强生成)和人工智能体有时候会被人搞混,但他们是两个不同的概念。

RAG 通过结合信息检索方法来提高 LLM 模型的性能或输出。检索系统根据输入查询从大型语料库中搜索相关文档或信息。然后,生成模型(例如基于转换器的语言模型)利用这些检索到的信息生成更准确和与上下文相关的回复。由于整合了检索信息,这有助于提高生成内容的准确性。此外,这种技术还免去了在新数据上微调或训练 LLM 的需要。

另一方面,人工智能体是软件或系统,它能执行特定或一系列任务。它们根据预定义的规则、机器学习模型或两者进行操作。最大区别是,它们能与用户或其他系统进行互动,以收集输入、提供响应或执行操作。一些人工智能体的性能会随着时间的推移而提高,因为它们可以根据新的数据和经验进行学习和适应。人工智能体可以同时处理多项任务,为企业提供可扩展性。

总之,RAG 应用程序专门设计用于通过纳入检索机制来增强生成模型的能力;而人工智能体则是更广泛的实体,可以自主执行各种任务。

好了,说了那么多,我们接下来说说看,怎么用一些现有的技术,来构建一个 AI Agent。步骤很简单,不过在那之前,我们先要介绍两个工具,一个是 LangGraph,另一个是 Ollama。如果你知道它们,那么你可以跳过后面两段介绍的内容。

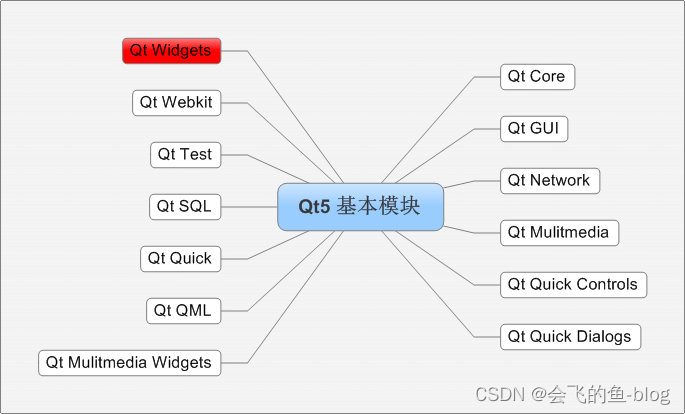

LangGraph 是什么?

LangGraph 是一个功能强大的库,用于使用大型语言模型(LLM)构建AI Agent应用程序。它可帮助创建涉及单个或多个AI Agent的复杂工作流,并提供循环、可控性和持久性等关键能力。

主要优势

- 循环和分支:与其他使用简单有向无环图(DAG)的框架不同,LangGraph 支持循环和条件,这对创建复杂的AI Agent行为至关重要。

- 细粒度控制:作为底层框架,LangGraph 可对应用程序的流程和状态进行详细控制,非常适合开发可靠的AI Agent。

- 持久性:它包括内置的持久性,允许在每一步后保存状态、暂停和恢复执行,并支持错误恢复和人在环工作流等高级功能。

特点

- 循环和分支:在应用程序中实施循环和条件。

- 持久性:每一步后自动保存状态,支持错误恢复。

- 人在回路中:中断执行以获得人工批准或编辑。

- 支持流式输出:在每个节点产生输出时进行流式输出。

- 与 LangChain 集成:与 LangChain 和 LangSmith 无缝集成,但也可独立使用。

LangGraph 受到 Pregel 和 Apache Beam 等技术的启发,拥有类似 NetworkX 的用户友好界面。它由 LangChain 公司开发,为构建可靠、先进的人工智能驱动应用程序提供了强大的工具。

Ollama 是什么?

Ollama 是一个开源项目,使在本地机器上运行 LLM 变得简单易用。它提供了一个用户友好型平台,简化了 LLM 技术的复杂性,使那些希望利用人工智能强大功能的用户可以轻松访问和定制 LLM,而不需要大量专业技术知识。

Ollama 易于安装,并提供多种型号和一整套旨在提升用户体验的特性和功能。

主要功能

- 本地部署:直接在本地计算机上运行复杂的 LLM,确保数据隐私并减少对外部服务器的依赖。

- 用户友好界面:设计直观、易于使用,使不同技术知识水平的用户都能使用。

- 可定制性:对人工智能模型进行微调,以满足您的特定需求,无论是用于研究、开发还是个人项目。

- 开源:作为开放源代码,Ollama 鼓励社区贡献和持续改进,促进创新与合作。

- 轻松安装:Ollama 以其用户友好的安装过程脱颖而出,为 Windows、macOS 和 Linux 用户提供了直观、省心的安装方法。我们以前内容中讲过关于下载和使用 Ollama 的内容。

- Ollama 社区:Ollama 有一个活跃的、以项目为驱动、促进合作与创新的社区。

使用 LangGraph 和 Ollama 创建人工智能体

我们将使用 Mistral 模型创建一个简单的AI Agent示例。该AI Agent可以使用 Tavily Search API 搜索网络并生成响应。我们将从安装 LangGraph 开始,这是一个专为使用 LLM 构建有状态多角色应用程序而设计的库,是创建AI Agent和多AI Agent工作流的理想选择。该库受 Pregel、Apache Beam 和 NetworkX 的启发,由 LangChain 公司开发,可独立于 LangChain 使用。

我们将使用 Mistral 作为我们的 LLM 模型,该模型将与 Ollama 和 Tavily 的搜索 API 集成。Tavily 的 API 针对 LLM 进行了优化,可提供真实、高效、持久的搜索体验。

在之前一篇文章中,我们学习了如何使用 Ollama 来使用 Qwen2。请跟随文章安装 Ollama 以及如何使用 Ollama 运行 LLM。

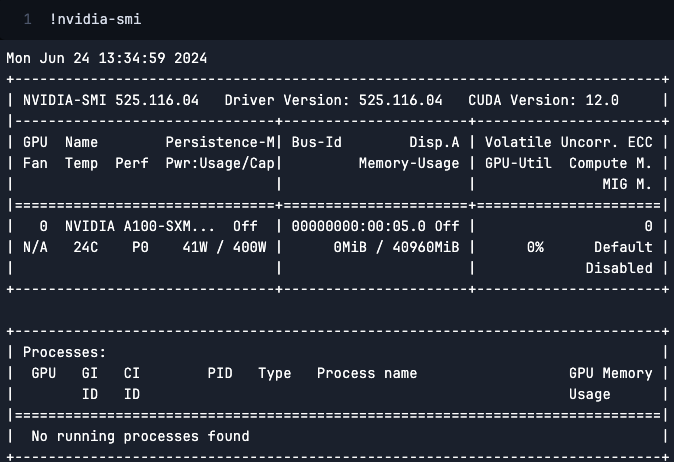

在开始安装之前,让我们先检查一下 GPU。在本教程中,我们将使用 Paperspace 提供的 A100 GPU。NVIDIA A100 GPU 是专为人工智能、数据分析和高性能计算而设计的处理器。它基于NVIDIA Ampere 架构,主要功能包括多实例 GPU (MIG) 技术,以实现最佳资源利用、用于人工智能和机器学习工作负载的 Tensor 核心以及对大规模部署的支持。 Paperspace是 DigitalOcean 旗下的 GPU 云服务,提供包括 H100、A100、A5000 等一系列 GPU 云资源,同时它也是 NVIDIA 的高级合作伙伴,在中国地区Paperspace 通过 DigitalOcean 中国区独家战略合作伙伴卓普云提供技术支持与售前咨询服务。

具体如何启动一台 A100 的主机,可以看我们之前发的教程,虽然教程讲的是H100,但是步骤一样。在启动实例之后,可以跟着下述步骤继续进行。

检查 GPU 配置

打开终端,输入以下代码:

nvidia-smi

安装 LangGraph 和相关库

pip install -U langgraph

pip install -U langchain-nomic langchain_community tiktoken langchainhub chromadb langchain langgraph tavily-python

pip install langchain-openai完成安装后,我们将进入下一个关键步骤:提供 Tavily API 密钥

注册 Travily 并生成 API 密钥:

export TAVILY_API_KEY="apikeygoeshere"现在,我们将运行下面的代码来获取模型。请尝试使用 Llama 或任何其他版本的 Mistral。

使用 Llama 或任何其他版本的 Mistral:

ollama pull mistral导入构建AI Agent所需的库

from langchain import hub

from langchain_community.tools.tavily_search import TavilySearchResults

from langchain.prompts import PromptTemplate

from langgraph.prebuilt import create_react_agent

from langchain_openai import ChatOpenAI

from langchain_core.output_parsers import JsonOutputParser

from langchain_community.chat_models import ChatOllama我们将首先定义要使用的工具,并将这些工具与 LLM 绑定。在这个简单的示例中,我们将通过 Tavily 使用内置的搜索工具。

tools = [TavilySearchResults(max_results=3)]

llm_with_tools = llm.bind_tools(tools)下面的代码片段检索提示模板并以可读格式打印出来。然后可以根据应用程序的需要使用或修改该模板。

prompt = hub.pull("wfh/react-agent-executor")

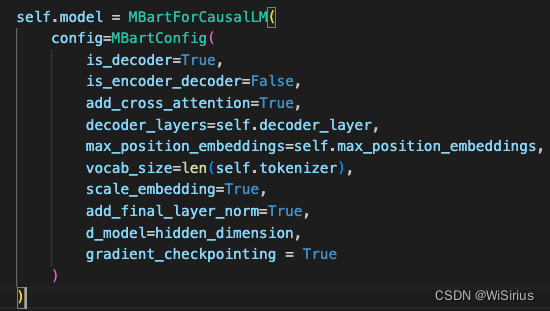

prompt.pretty_print()使用 Ollama 平台配置 Mistral

llm = ChatOpenAI(model="mistral", api_key="ollama", base_url="http://localhost:11434/v1")最后,我们将使用 LLM、一组工具 和提示模板 (prompt) 创建一个AI Agent执行器。该AI Agent被配置为对输入做出反应,利用这些工具,并根据指定的提示生成响应,从而能够以可控和高效的方式执行任务。

agent_executor = create_react_agent(llm, tools, messages_modifier=prompt)

================================ System Message ================================

You are a helpful assistant.

============================= Messages Placeholder =============================

{{messages}}给定的代码片段调用AI Agent执行器来处理输入消息。此步骤旨在向AI Agent执行器发送查询并接收响应。AI Agent将使用其配置的语言模型(在本示例中为 Mistral)、工具和提示来处理消息并生成适当的回复。

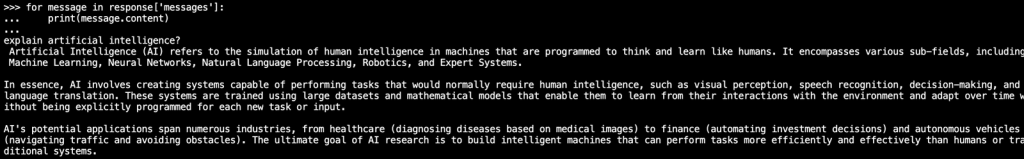

response = agent_executor.invoke({"messages": [("user", "explain artificial intelligence")]})

for message in response['messages']:

print(message.content)AI Agent将生成以下响应。

小结

LangGraph 以及 AI Agents 和 Ollama 等工具代表着在开发和部署本地化人工智能解决方案方面向前迈出的重要一步。通过利用 LangGraph 简化各种人工智能组件的能力及其模块化架构,开发人员可以创建多用途、可扩展的人工智能解决方案,既高效又能高度适应不断变化的需求。

人工智能体为任务自动化和提高生产力提供了一种灵活的方法。这些AI Agent可以定制来处理各种功能,从简单的任务自动化到复杂的决策过程,使其成为现代企业不可或缺的工具。

作为该生态系统的一部分,Ollama 通过提供专门的工具和服务来补充 LangGraph 的能力,从而提供额外的支持。总之,LangGraph 和 Ollama 的集成为构建高效的人工智能体提供了一个强大的框架。对于希望利用这些技术的潜力推动创新并在不断发展的人工智能领域实现目标的任何人来说,希望本篇教程能给大家一些参考。

最后,如果大家希望以较低的价格使用 GPU 云服务,可以联系 DigitalOcean 中国区独家战略合作伙伴卓普云,咨询与Paperspace 相关的 GPU 云服务资源、产品方案与价格折扣。