在人工智能的浪潮中,AI大模型正以其强大的数据处理能力和学习潜力,成为技术创新和产业升级的核心驱动力。本文将深入探讨国内AI大模型的技术特点、应用实践以及未来发展趋势。

技术架构与创新

国内AI大模型技术主要基于以下几个核心架构:

- Transformer架构:作为当前主流的深度学习模型,Transformer通过自注意力机制处理序列数据,广泛应用于NLP领域。

- BERT优化:预训练-微调范式,通过在大规模数据上预训练语言表示,然后在特定任务上进行微调,极大提升了模型的泛化能力。

- 多模态学习:结合视觉、语言等不同模态的数据,通过跨模态的交互与融合,实现更加丰富的信息理解和表达。

- 知识图谱集成:将知识图谱与深度学习模型结合,增强模型的知识推理和解释能力。

技术应用与实践

国内AI大模型在以下领域的应用尤为突出:

- 自然语言理解:通过深度理解语言的语义,实现精准的语义搜索、情感分析和机器翻译。

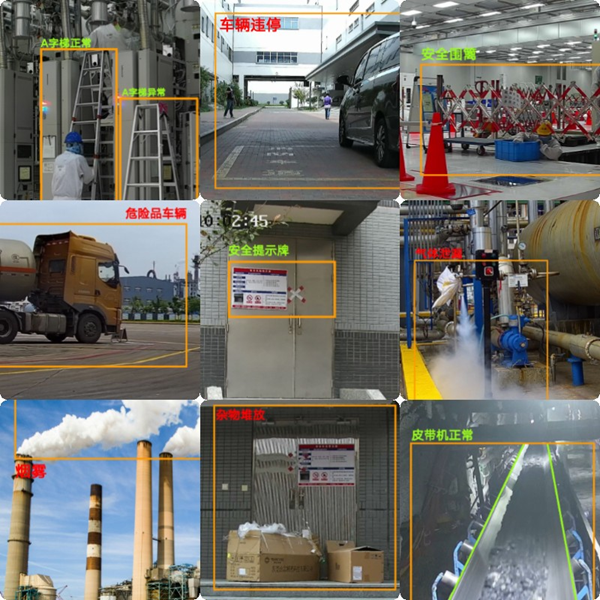

- 图像与视频分析:利用卷积神经网络(CNN)处理视觉数据,实现目标检测、图像分类和视频内容理解。

- 语音技术:结合声学模型和语言模型,实现高精度的语音识别和语音合成。

- 推荐系统:通过用户行为和偏好学习,构建个性化推荐模型,广泛应用于电商和内容平台。

前沿技术探索

- 自监督学习:减少对大量标注数据的依赖,通过预测数据本身的结构和属性进行学习。

- 强化学习:通过与环境的交互学习最优策略,应用于游戏、机器人控制等领域。

- 联邦学习:在保护数据隐私的前提下,实现跨设备的数据协同训练,提升模型的泛化能力。

产业发展趋势

- 端侧智能化:随着端侧设备算力的提升,AI大模型正逐步向端侧迁移,实现更快速的响应和更低的延迟。

- 行业定制化:根据不同行业的特点和需求,定制化开发AI大模型,提供更加精准的行业解决方案。

- 开源生态建设:通过开源社区的力量,构建共享、协作的技术生态,加速AI技术的创新和应用。

面临的挑战

- 算力瓶颈:随着模型规模的增长,对计算资源的需求也在不断提升,算力成为制约发展的关键因素。

- 数据安全与隐私保护:在数据收集和使用过程中,如何确保用户数据的安全和隐私,是AI大模型发展中必须面对的问题。

- 模型可解释性:提高模型的可解释性,让用户和开发者更好地理解模型的决策过程。

结语

国内AI大模型技术正以其独特的创新能力和广泛的应用前景,引领着智能科技的新浪潮。随着技术的不断成熟和生态的日益完善,我们期待AI大模型能够在更多领域发挥其潜力,推动社会进入一个更加智能和高效的新时代。