【图书推荐】《从零开始大模型开发与微调:基于PyTorch与ChatGLM》_《从零开始大模型开发与微调:基于pytorch与chatglm》-CSDN博客

ChatGLM基于GLM架构,针对中文问答和对话进行了优化。经过约1TB标识符的中英双语训练,辅以监督微调、反馈自助、人类反馈强化学习等技术的加持,62亿个参数的ChatGLM-6B虽然规模不及千亿模型的ChatGLM-130B,但大大降低了推理成本,提升了效率,并且已经能生成相当符合人类偏好的回答。

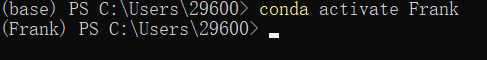

正如我们在本书开始的时候演示的,ChatGLM可以很轻松地部署在本地的硬件上,当时采用的是THUDM/chatglm-6b-int4。(使用的时候,需要安装一些特定的Python包,按提示安装即可。)

为了后续的学习和再训练,我们直接使用完整的ChatGLM存档结构,代码如下:

from transformers import AutoTokenizer, AutoModel

names = ["THUDM/chatglm-6b-int4","THUDM/chatglm-6b"]

tokenizer = AutoTokenizer.from_pretrained("THUDM/chatglm-6b", trust_remote_code=True)

model = AutoModel.from_pretrained("THUDM/chatglm-6b", trust_remote_code=True).half().cuda()

response, history = model.chat(tokenizer, "你好", history=[])

print(response)

print("-----------------------")

response, history = model.chat(tokenizer, "晚上睡不着应该怎么办", history=history)

print(response)

从打印结果来看,此时的展示结果与chatglm-6b-int4没有太大差别。

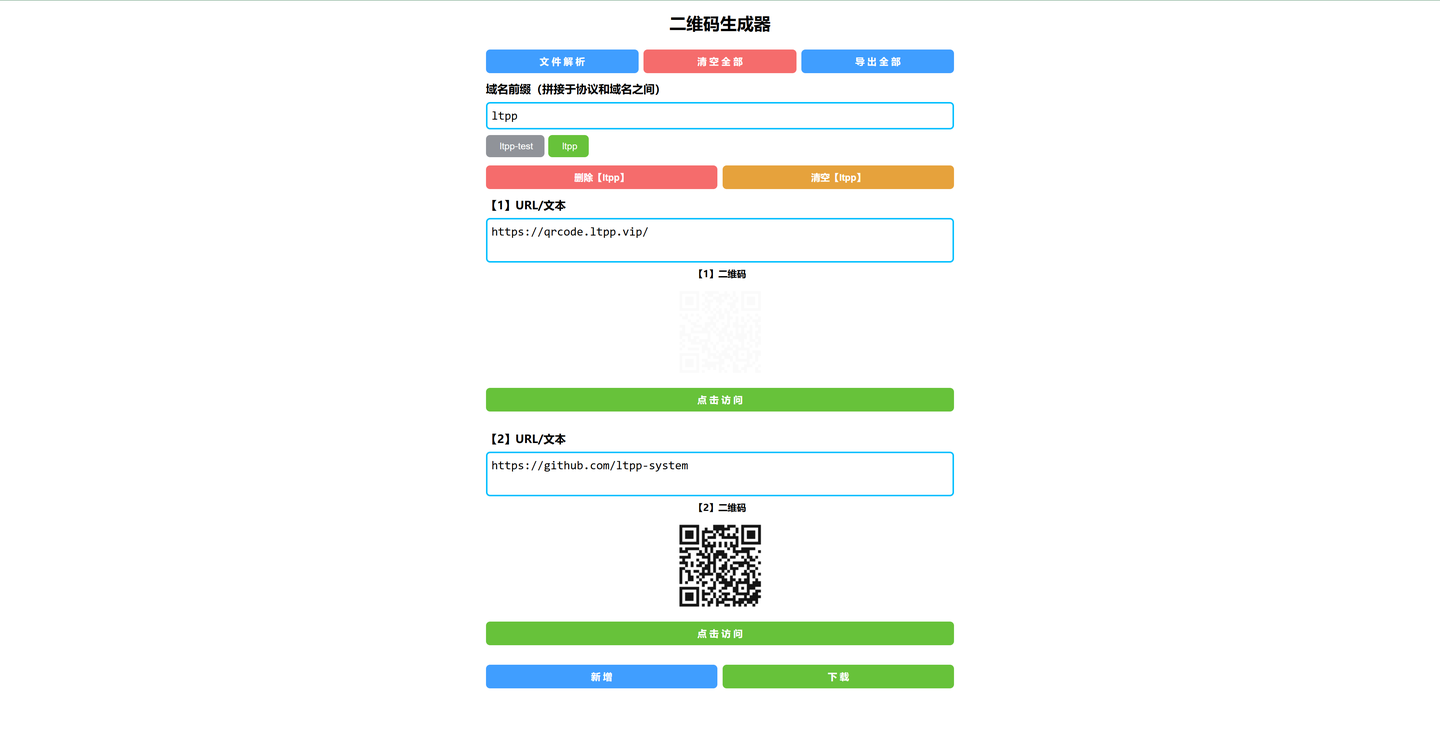

可以直观地看到,此时的下载较烦琐,下载文件被分成了8部分,依次下载,然后将其系统地合并,如图16-4所示。

需要注意的是,对于下载的存档文件还需要进行合并处理,展示如图16-5所示。

需要注意的是,对于下载的存档文件还需要进行合并处理,展示如图16-5所示。

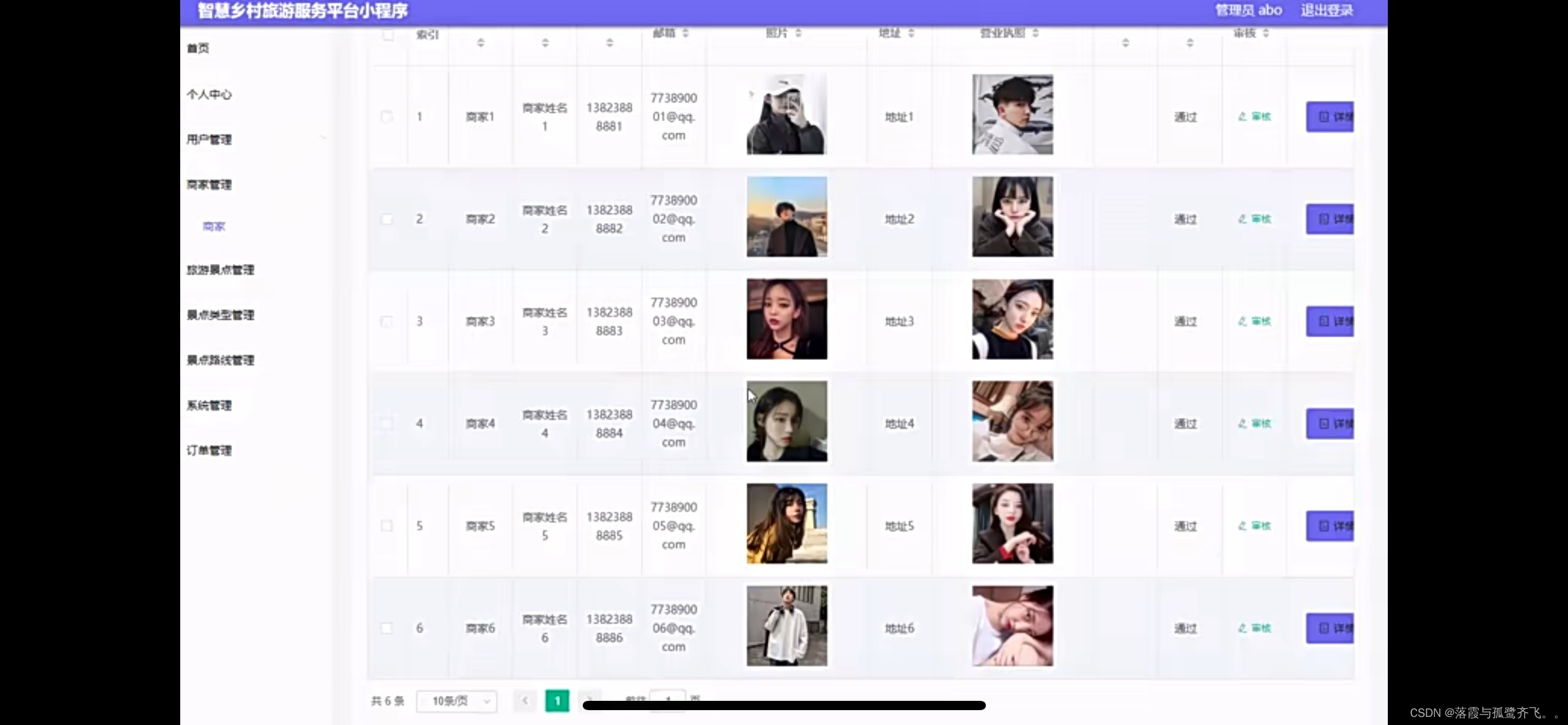

最终展示的结果如图16-6所示。

请读者自行打印验证这部分内容。需要注意的是,即使问题是一样的,但是回答也有可能不同,因为我们所使用的ChatGLM是生成式模型,前面的生成直接影响了后面的生成,而这一点也是生成模型不好的地方,前面的结果有了波动,后面就会发生很大的变化,会产生滚雪球效应。

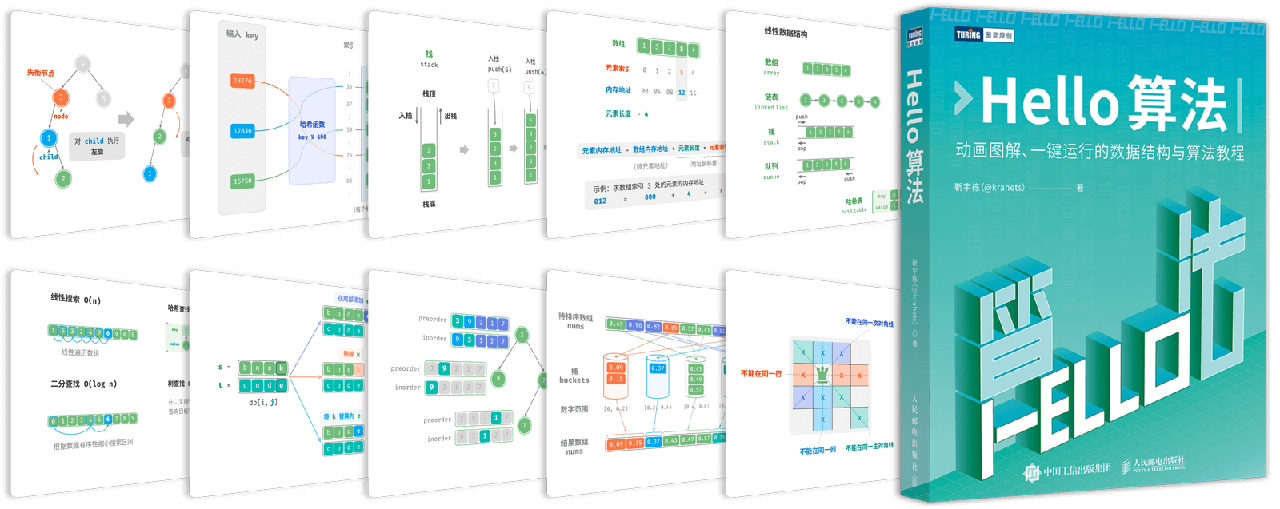

本文节选自《从零开始大模型开发与微调:基于PyTorch与ChatGLM》,获出版社和作者授权发布。

《从零开始大模型开发与微调:基于PyTorch与ChatGLM(人工智能技术丛书)》(王晓华)【摘要 书评 试读】- 京东图书 (jd.com)

![[经验] 如何做虾炒白菜 #学习方法#知识分享](https://img-home.csdnimg.cn/images/20230724024159.png?origin_url=https%3A%2F%2Fwww.hao123rr.com%2Fzb_users%2Fupload%2F2023%2F05%2F20230524223526168493892634469.jpg&pos_id=YRwBfJ9y)