张量 Tensor

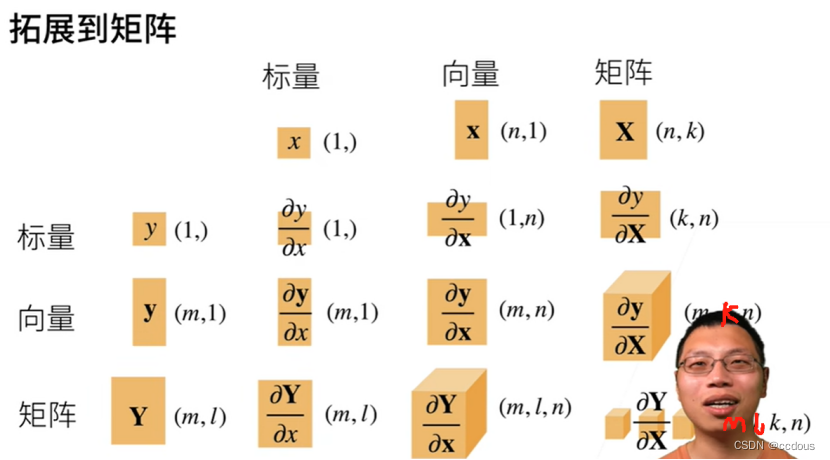

张量(Tensor)是一个可用来表示在一些矢量、标量和其他张量之间的线性关系的多线性函数,这些线性关系的基本例子有内积、外积、线性映射以及笛卡儿积。其坐标在 𝑛𝑛 维空间内,有 𝑛𝑟𝑛𝑟 个分量的一种量,其中每个分量都是坐标的函数,而在坐标变换时,这些分量也依照某些规则作线性变换。𝑟𝑟 称为该张量的秩或阶(与矩阵的秩和阶均无关系)。

张量是一种特殊的数据结构,与数组和矩阵非常相似。张量(Tensor)是MindSpore网络运算中的基本数据结构。

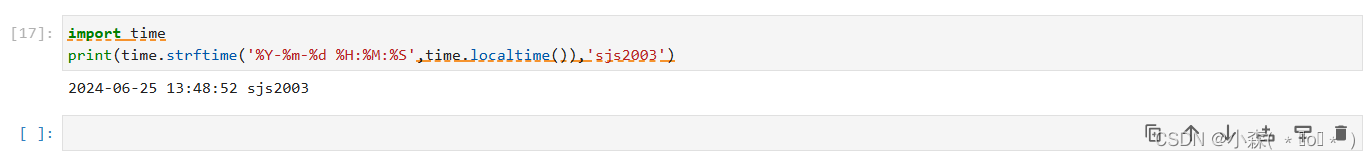

import numpy as np

import mindspore

from mindspore import ops

from mindspore import Tensor, CSRTensor, COOTensor创建张量

张量的创建方式有多种,构造张量时,支持传入Tensor、float、int、bool、tuple、list和numpy.ndarray类型。

-

根据数据直接生成

可以根据数据创建张量,数据类型可以设置或者通过框架自动推断。

data = [1, 0, 1, 0]

x_data = Tensor(data)

print(x_data, x_data.shape, x_data.dtype)-

从NumPy数组生成

可以从NumPy数组创建张量。

np_array = np.array(data)

x_np = Tensor(np_array)

print(x_np, x_np.shape, x_np.dtype)-

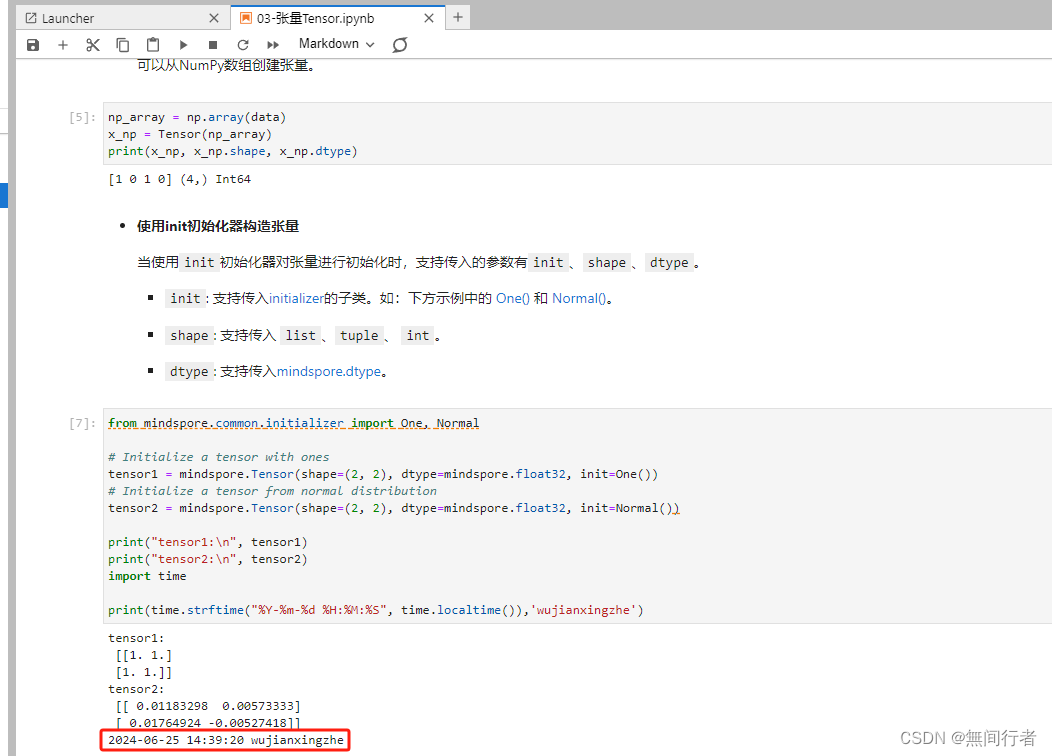

使用init初始化器构造张量

当使用

init初始化器对张量进行初始化时,支持传入的参数有init、shape、dtype。-

init: 支持传入initializer的子类。如:下方示例中的 One() 和 Normal()。 -

shape: 支持传入list、tuple、int。 -

dtype: 支持传入mindspore.dtype。

-

from mindspore.common.initializer import One, Normal

# Initialize a tensor with ones

tensor1 = mindspore.Tensor(shape=(2, 2), dtype=mindspore.float32, init=One())

# Initialize a tensor from normal distribution

tensor2 = mindspore.Tensor(shape=(2, 2), dtype=mindspore.float32, init=Normal())

print("tensor1:\n", tensor1)

print("tensor2:\n", tensor2)

#

tensor1:

[[1. 1.]

[1. 1.]]

tensor2:

[[ 0.00333083 0.01302023]

[-0.0137493 0.02081333]] init主要用于并行模式下的延后初始化,在正常情况下不建议使用init对参数进行初始化。

from mindspore import ops

x_ones = ops.ones_like(x_data)

print(f"Ones Tensor: \n {x_ones} \n")

x_zeros = ops.zeros_like(x_data)

print(f"Zeros Tensor: \n {x_zeros} \n")

#

Ones Tensor:

[1 1 1 1]

Zeros Tensor:

[0 0 0 0] 张量的属性

张量的属性包括形状、数据类型、转置张量、单个元素大小、占用字节数量、维数、元素个数和每一维步长。

-

形状(shape):

Tensor的shape,是一个tuple。 -

数据类型(dtype):

Tensor的dtype,是MindSpore的一个数据类型。 -

单个元素大小(itemsize):

Tensor中每一个元素占用字节数,是一个整数。 -

占用字节数量(nbytes):

Tensor占用的总字节数,是一个整数。 -

维数(ndim):

Tensor的秩,也就是len(tensor.shape),是一个整数。 -

元素个数(size):

Tensor中所有元素的个数,是一个整数。 -

每一维步长(strides):

Tensor每一维所需要的字节数,是一个tuple。

x = Tensor(np.array([[1, 2], [3, 4]]), mindspore.int32)

print("x_shape:", x.shape)

print("x_dtype:", x.dtype)

print("x_itemsize:", x.itemsize)

print("x_nbytes:", x.nbytes)

print("x_ndim:", x.ndim)

print("x_size:", x.size)

print("x_strides:", x.strides)张量索引

Tensor索引与Numpy索引类似,索引从0开始编制,负索引表示按倒序编制,冒号:和 ...用于对数据进行切片。

tensor = Tensor(np.array([[0, 1], [2, 3]]).astype(np.float32))

print("First row: {}".format(tensor[0]))

print("value of bottom right corner: {}".format(tensor[1, 1]))

print("Last column: {}".format(tensor[:, -1]))

print("First column: {}".format(tensor[..., 0]))张量运算

张量之间有很多运算,包括算术、线性代数、矩阵处理(转置、标引、切片)、采样等,张量运算和NumPy的使用方式类似,下面介绍其中几种操作。

普通算术运算有:加(+)、减(-)、乘(*)、除(/)、取模(%)、整除(//)。

x = Tensor(np.array([1, 2, 3]), mindspore.float32)

y = Tensor(np.array([4, 5, 6]), mindspore.float32)

output_add = x + y

output_sub = x - y

output_mul = x * y

output_div = y / x

output_mod = y % x

output_floordiv = y // x

print("add:", output_add)

print("sub:", output_sub)

print("mul:", output_mul)

print("div:", output_div)

print("mod:", output_mod)

print("floordiv:", output_floordiv)concat将给定维度上的一系列张量连接起来。

data1 = Tensor(np.array([[0, 1], [2, 3]]).astype(np.float32))

data2 = Tensor(np.array([[4, 5], [6, 7]]).astype(np.float32))

output = ops.concat((data1, data2), axis=0)

print(output)

print("shape:\n", output.shape)

#

[[0. 1.]

[2. 3.]

[4. 5.]

[6. 7.]]

shape:

(4, 2)stack则是从另一个维度上将两个张量合并起来。

data1 = Tensor(np.array([[0, 1], [2, 3]]).astype(np.float32))

data2 = Tensor(np.array([[4, 5], [6, 7]]).astype(np.float32))

output = ops.stack([data1, data2])

print(output)

print("shape:\n", output.shape)

#

[[[0. 1.]

[2. 3.]]

[[4. 5.]

[6. 7.]]]

shape:

(2, 2, 2)Tensor与NumPy转换

Tensor可以和NumPy进行互相转换。

Tensor转换为NumPy

与张量创建相同,使用 Tensor.asnumpy() 将Tensor变量转换为NumPy变量。

NumPy转换为Tensor

使用Tensor()将NumPy变量转换为Tensor变量。

CSRTensor

CSR(Compressed Sparse Row)稀疏张量格式有着高效的存储与计算的优势。其中,非零元素的值存储在values中,非零元素的位置存储在indptr(行)和indices(列)中。各参数含义如下:

-

indptr: 一维整数张量, 表示稀疏数据每一行的非零元素在values中的起始位置和终止位置, 索引数据类型支持int16、int32、int64。 -

indices: 一维整数张量,表示稀疏张量非零元素在列中的位置, 与values长度相等,索引数据类型支持int16、int32、int64。 -

values: 一维张量,表示CSRTensor相对应的非零元素的值,与indices长度相等。 -

shape: 表示被压缩的稀疏张量的形状,数据类型为Tuple,目前仅支持二维CSRTensor。

CSRTensor的详细文档,请参考mindspore.CSRTensor。

MindSpore与PyTorch的张量操作在设计和使用体验上有一些显著的区别:

- MindSpore提供了丰富的数据类型,包括标准的Tensor,以及针对稀疏数据优化的CSRTensor和COOTensor。这些数据类型使得MindSpore在处理稀疏数据时更加高效。

- PyTorch主要使用标准的Tensor数据结构,对于稀疏数据的处理可能需要借助额外的库或手动实现。

- 在数据类型转换方面,MindSpore和PyTorch都提供了方便的方法。例如,在MindSpore中,可以通过

astype方法轻松转换Tensor的数据类型。 - 张量操作:

- MindSpore的张量操作设计得更为简洁和直观。例如,MindSpore的

ops模块提供了大量的张量操作函数,这些函数通常具有明确的语义和简洁的接口。 - PyTorch的张量操作也非常强大,但有时可能需要更复杂的调用方式或额外的步骤来实现相同的功能。

- MindSpore的张量操作设计得更为简洁和直观。例如,MindSpore的

MindSpore和PyTorch都与NumPy具有良好的兼容性。两者都可以轻松地将NumPy数组转换为各自的张量格式,并提供了与NumPy相似的操作接口。

然而,MindSpore在处理大规模数据时可能会显示出更高的效率,特别是当利用其稀疏张量结构时。

- MindSpore通过引入CSRTensor和COOTensor等专门的数据结构来优化稀疏数据的处理。这些结构能够更有效地存储和操作稀疏数据,从而降低内存消耗并提高计算效率。

- 在PyTorch中,处理稀疏数据可能需要更多的手动工作,例如使用稀疏矩阵库或自定义操作。

体验总结:

MindSpore在处理稀疏数据和大规模计算时表现出色,其简洁直观的API设计和高效的数据结构使得开发工作变得相对容易。

PyTorch则以其灵活的动态计算图和广泛的社区支持而闻名,但在处理稀疏数据方面可能需要额外的努力。