人工智能和机器学习是紧密相关的概念,可以说机器学习是人工智能的一个重要分支。机器学习是一门多学科交叉专业,涵盖概率论知识,统计学知识,近似理论知识和复杂算法知识,使用计算机作为工具并致力于真实实时的模拟人类学习方式,并将现有内容进行知识结构划分来有效提高学习效率。

机器学习有下面几种定义:

- 机器学习是一门人工智能的科学,该领域的主要研究对象是人工智能,特别是如何在经验学习中改善具体算法的性能。

- 机器学习是对能通过经验自动改进的计算机算法的研究。

- 机器学习是用数据或以往的经验,以此优化计算机程序的性能标准。

机器学习概述

机器学习是一种使计算机系统能够从数据中学习并改进性能的科学。它主要关注如何构建有效的学习算法,以便从经验中学习并做出准确的预测或决策。

机器学习类型

机器学习可以分为四种类型:监督学习、无监督学习、半监督学习和强化学习。

- 监督学习:在监督学习中,我们使用带有标签的训练数据来训练模型。模型的目标是学习一个映射函数,将输入数据映射到相应的输出标签。常见的监督学习算法包括线性回归、逻辑回归、支持向量机、决策树和神经网络等。

- 无监督学习:在无监督学习中,我们使用没有标签的训练数据来训练模型。模型的目标是发现数据中的隐藏模式或结构。常见的无监督学习算法包括聚类算法(如K-means)、降维算法(如主成分分析)和关联规则挖掘等。

- 半监督学习:半监督学习介于监督学习和无监督学习之间。它利用少量的标签数据和大量的未标签数据来训练模型。常见的半监督学习算法包括自编码器和生成对抗网络等。

- 强化学习:强化学习是一种通过与环境的交互来学习最优行为的策略学习方法。它包括智能体(agent)、环境(environment)、状态(state)、动作(action)和奖励(reward)等概念。常见的强化学习算法包括Q-learning、DeepQ-Networks和策略梯度等。

机器学习常用术语及解释

特征(Feature):特征是描述数据的属性或特性。在机器学习中,特征是模型的输入,用于预测或分类。

标签(Label):标签是数据的输出,表示数据所属的类别或值。在监督学习中,标签用于训练模型。

训练集(Training Set):训练集是用于训练机器学习模型的数据集。它包含了输入特征和对应的标签。

测试集(Test Set):测试集是用于评估机器学习模型性能的数据集。它包含了输入特征和对应的标签,但与训练集不重叠。

交叉验证(Cross-Validation):交叉验证是一种评估机器学习模型性能的技术,它将数据集分成多个子集,轮流使用其中一个子集作为测试集,其余子集作为训练集。

损失函数(Loss Function):损失函数用于衡量机器学习模型的预测误差。常见的损失函数包括均方误差、交叉熵损失和铰链损失等。

优化算法(Optimization Algorithm):优化算法用于最小化或最大化损失函数,以找到最佳的模型参数。常见的优化算法包括梯度下降、随机梯度下降和Adam等。

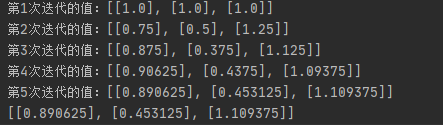

梯度下降(Gradient Descent):梯度下降是一种常用的优化算法,用于最小化或最大化某个函数。在机器学习中,我们通常使用它来最小化损失函数。

批量梯度下降(Batch Gradient Descent):使用整个训练集来计算每个参数的梯度。

随机梯度下降(Stochastic Gradient Descent,SGD):每次使用一个样本来更新参数。

小批量梯度下降(Mini-batch Gradient Descent):是批量梯度下降和随机梯度下降的折衷,使用一个小批次的样本来计算梯度。

求导(Derivative):求导是微积分中的一个核心概念,指的是函数输出值的增量与输入值增量的比率的极限。在机器学习中,我们通常需要计算损失函数对模型参数的导数,以便于使用梯度下降等优化算法。

链式法则(Chain Rule):用于复合函数的求导,是机器学习中反向传播算法的基础。

反向传播(Backpropagation):反向传播是神经网络训练中的一个关键算法,用于高效地计算损失函数对网络中每个权重的偏导数。

激活函数(Activation Function):激活函数为神经网络引入非线性,使得网络可以学习并逼近复杂的函数。

正则化(Regularization):正则化是防止模型过拟合的技术,通过添加额外的约束或惩罚项来实现。

- L1正则化:向损失函数添加参数绝对值的和。

- L2正则化:向损失函数添加参数平方的和。

超参数(Hyperparameters):超参数是学习算法中的参数,不是由算法本身学习得到的,而是由开发者设置的。

学习率(Learning Rate):控制梯度下降步骤大小的超参数。

迭代次数(Epochs):训练算法在完整数据集上运行的次数。

数据集(Dataset):训练集(Training Set):用于训练模型的数据集合,包含特征和对应的标签。

验证集(Validation Set):用于模型调优和参数选择的数据集合,帮助调整超参数。

测试集(Test Set):用于评估模型性能的数据集合,模拟真实世界数据,不参与模型训练。

特征工程(Feature Engineering):特征选择(Feature Selection):从现有特征中选择最重要的特征,以改善模型性能。

特征提取(Feature Extraction):通过降维或变换创建新的特征。

模型评估(Model Evaluation):

- 准确率(Accuracy):正确预测的样本数除以总样本数。

- 精确率(Precision):真正例/(真正例 + 假正例),表示预测为正的样本中实际为正的比例。

- 召回率(Recall):真正例/(真正例 + 假负例),表示实际为正的样本中预测为正的比例。

- F1分数(F1 Score):精确率和召回率的调和平均,用于平衡精确率和召回率。

过拟合与欠拟合(Overfitting & Underfitting):

-

过拟合:模型在训练数据上表现良好,但在新数据上表现差,因为捕捉了训练数据中的噪声。

-

欠拟合:模型在训练数据上表现不佳,因为模型太简单,无法捕捉数据的复杂性。

模型集成(Model Ensemble):

-

Bagging:并行生成多个模型,然后聚合它们的预测。

-

Boosting:顺序生成多个模型,每个模型都试图纠正前一个模型的错误。 深度学习(Deep Learning)

神经网络(Neural Networks):由多层神经元组成的模型,能够学习复杂的模式。

卷积神经网络(Convolutional Neural Networks, CNNs):特别适用于图像数据,通过卷积层来提取空间特征。

循环神经网络(Recurrent Neural Networks, RNNs):适用于序列数据,如时间序列或文本数据。

优化算法(Optimization Algorithms):

-

Adam:一种自适应学习率的优化算法,结合了梯度下降和动量的优点。

-

RMSprop:修改版的梯度下降,使用均方根进行权重更新。

正则化技术(Regularization Techniques):

-

Dropout:在训练过程中随机关闭网络中的一些神经元,用于减少过拟合。

-

早停(Early Stopping):在验证误差开始增加时停止训练,以防止过拟合。

损失函数(Loss Functions):

-

Hinge Loss:用于支持向量机(SVM),最大化决策边界的边距。

-

对比损失(Contrastive Loss):用于训练具有相似性度量的模型,如孪生网络。

数据预处理(Data Preprocessing):

-

归一化(Normalization):将数据按比例缩放,使之落入一个小的特定区间,如0到1之间。

-

标准化(Standardization):数据规范化,使其符合标准正态分布,即均值为0,标准差为1。

特征选择和降维(Feature Selection and Dimensionality Reduction):

-

主成分分析(PCA):一种无监督技术,用于降低数据集的维度,同时保持数据集中的大部分方差。

-

自动编码器(Autoencoders):在深度学习中,用于学习数据的压缩表示,也是一种降维技术。

模型选择与超参数调优(Model Selection and Hyperparameter Tuning):

-

网格搜索(Grid Search):通过遍历多种组合的模型超参数来找到最佳模型。

-

随机搜索(Random Search):在超参数空间中随机选择参数组合进行搜索。

模型评估指标(Model Evaluation Metrics):AUC-ROC曲线(Area Under the Curve - Receiver Operating Characteristics):用于衡量分类模型性能,不受类别不平衡影响。

算法类型(Algorithm Types):

- 决策树(Decision Trees):一种模型,通过树结构进行决策,常用于分类和回归任务。

- 集成方法(Ensemble Methods):结合多个模型的预测来改善性能,如随机森林(Random Forest)。

深度学习优化(Deep Learning Optimization):

-

批量归一化(Batch Normalization):在深度学习中用于加速训练过程,并有助于稳定网络。

-

残差网络(Residual Networks):通过引入跳跃连接(skip connections)来解决深层网络训练问题。

生成模型(Generative Models):

-

生成对抗网络(GANs):由两部分组成——生成器和判别器,能在多个领域生成逼真的数据。

-

变分自编码器(VAEs):一种生成模型,可以学习数据的潜在空间表示。

强化学习(Reinforcement Learning):

-

Q学习(Q-Learning):一种无模型的强化学习算法,用于找到给定状态和动作的最佳动作策略。

-

策略梯度(Policy Gradients):一种基于策略的方法,直接学习从状态到动作的映射。

机器学习算法分类及应用场景

机器学习提供了多种机器学习算法,包括分类算法、回归算法、聚类算法等。以下将列举常用算法应用场景:

分类算法应用场景:

- O2O优惠券使用预测:通过分析用户行为和历史数据,预测用户是否会在规定时间内使用优惠券,从而提高营销效果并减少资源浪费。

- 市民出行选乘公交预测:利用公交系统的历史数据,预测市民在未来一段时间内的出行模式,帮助优化公交服务和路线规划。

- 待测微生物种类判别:通过DNA序列分析,快速准确地识别未知微生物的种类,对疾病诊断和生物研究具有重要意义。

- 基于文本内容的垃圾短信识别:自动识别和过滤垃圾短信,减少用户的困扰和潜在的安全风险。

- 中文句子类别精准分析:精确分析句子的语义类别,对于情感分析、文本挖掘等领域尤为重要。

回归算法应用场景:

- 机场客流量分布预测:预测机场的客流量,有助于机场管理部门合理安排运营资源,提高运营效率。

- 音乐流行趋势预测:分析音乐平台上的数据,预测特定音乐或歌手的流行趋势,为音乐制作和推广提供依据。

- 需求预测与仓储规划方案:通过历史销售数据分析,预测未来的产品需求,帮助企业优化库存管理和物流配送。

- 电影票房预测:分析历史票房数据和观众评价,预测新电影的票房表现,对电影制作和发行策略制定至关重要。

聚类算法应用场景:

- 基于用户位置信息的商业选址:分析用户的位置数据,为零售业者提供科学的店铺选址建议,以最大化客户覆盖率和商业利益。

- 中文地址标准化处理:通过聚类分析,将不同表述的中文地址统一为标准格式,提高地址数据处理的准确性和效率。

- 国家电网用户画像:通过分析用户的用电行为和属性,构建用户画像,为个性化服务和精准营销提供支持。

- 非人恶意流量识别:识别网络中的恶意流量,保障网络安全,提升用户体验。

关联规则算法应用场景:

- 穿衣搭配推荐:根据顾客的购买历史和偏好,推荐合适的服装搭配,提升顾客满意度和销售额。

- 互联网情绪指标和生猪价格的关联关系挖掘和预测:分析互联网上的情绪指标与生猪价格之间的关系,为农业生产者提供市场趋势预测。

- 银行金融客户交叉销售分析:挖掘客户数据,发现交叉销售的机会,提升银行的销售业绩和客户粘性。

打个小结,个人认为人工智能有三大要素,分别是数据、算力、算法,三者缺一不可,本篇讲的“机器学习”就是算法。