欢迎来到 Papicatch的博客

文章目录

🐋引言

🐋强化学习的核心内容

🦈强化学习基本概念

🐋强化学习算法

🦈Q学习(Q-Learning)

🦈深度Q网络(Deep Q-Network, DQN)

🐋现实示例

🦈游戏AI

🐡AlphaGo及其技术实现

🐡AlphaGo的技术实现示例

🦈机器人控制

🐡强化学习在机器人控制中的应用

🐡机器人控制的技术实现示例

🐋强化学习的社会影响

🦈利

🦈弊

🐋强化学习对未来生活的便利

🐋结论

🐋引言

强化学习(Reinforcement Learning, RL)是机器学习中的一个重要分支,其目标是通过试错和环境反馈来训练智能体(agent),使其能够在复杂环境中做出最佳决策。强化学习广泛应用于机器人控制、游戏AI、自动驾驶等领域,对社会和未来生活产生了深远影响。本文将详细分析强化学习的核心内容、利弊,并结合现实示例和代码,探讨其对未来生活的便利。

🐋强化学习的核心内容

🦈强化学习基本概念

- 智能体(Agent):在环境中执行动作的主体。

- 环境(Environment):智能体与之交互的外部世界。

- 状态(State, S):描述环境的具体情况。

- 动作(Action, A):智能体在某一状态下可以执行的行为。

- 奖励(Reward, R):智能体执行某一动作后从环境中获得的反馈。

- 策略(Policy, π):智能体根据当前状态选择动作的规则。

- 值函数(Value Function, V):评估某一状态或状态-动作对的长期收益。

- Q函数(Q-Function, Q):评估在某一状态下执行某一动作的长期收益。

🐋强化学习算法

🦈Q学习(Q-Learning)

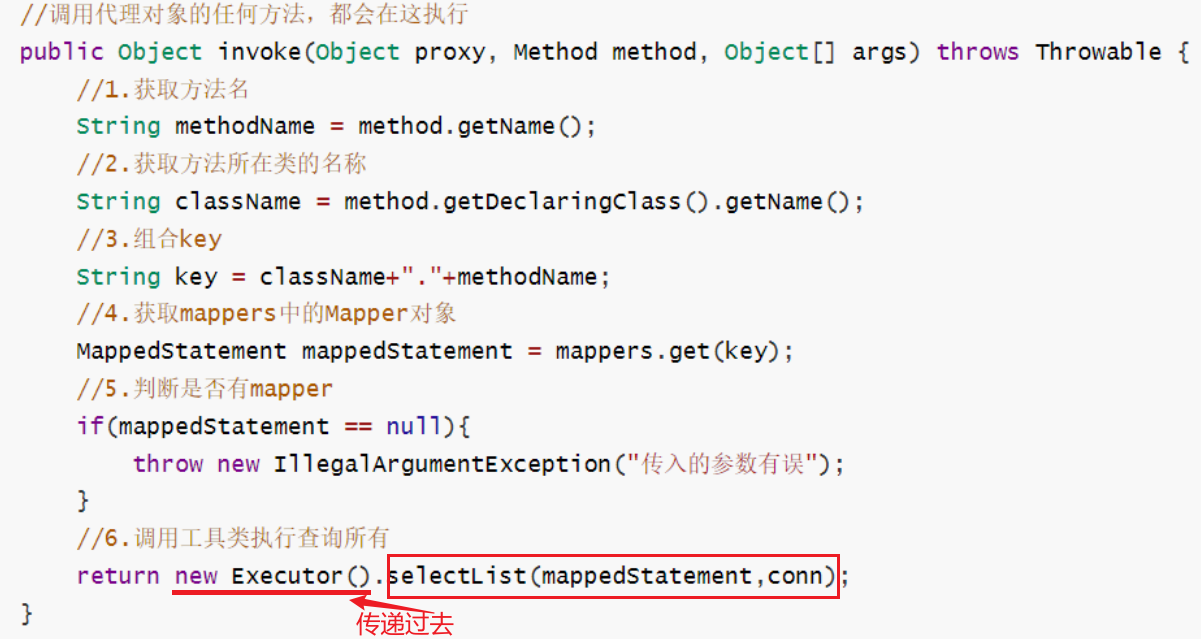

Q学习是一种基于值函数的强化学习算法,通过更新Q值来优化策略。Q学习的核心公式为:

其中,α 是学习率,γ 是折扣因子,r 是即时奖励,′s′ 是执行动作后的新状态。

🦈深度Q网络(Deep Q-Network, DQN)

DQN结合深度学习和Q学习,使用神经网络近似Q值函数,能够处理高维度的状态空间。DQN的关键技术包括经验回放(Experience Replay)和目标网络(Target Network)。

import gym

import torch

import torch.nn as nn

import torch.optim as optim

import numpy as np

from collections import deque

import random

# 定义Q网络

class QNetwork(nn.Module):

def __init__(self, state_size, action_size):

super(QNetwork, self).__init__()

self.fc1 = nn.Linear(state_size, 64)

self.fc2 = nn.Linear(64, 64)

self.fc3 = nn.Linear(64, action_size)

def forward(self, state):

x = torch.relu(self.fc1(state))

x = torch.relu(self.fc2(x))

return self.fc3(x)

# 环境初始化

env = gym.make('CartPole-v1')

state_size = env.observation_space.shape[0]

action_size = env.action_space.n

q_network = QNetwork(state_size, action_size)

target_network = QNetwork(state_size, action_size)

target_network.load_state_dict(q_network.state_dict())

optimizer = optim.Adam(q_network.parameters())

memory = deque(maxlen=10000)

# 超参数

episodes = 1000

gamma = 0.99

epsilon = 1.0

epsilon_min = 0.01

epsilon_decay = 0.995

batch_size = 64

# 训练过程

for episode in range(episodes):

state = env.reset()

state = torch.FloatTensor(state).unsqueeze(0)

total_reward = 0

done = False

while not done:

if np.random.rand() < epsilon:

action = np.random.randint(action_size)

else:

with torch.no_grad():

q_values = q_network(state)

action = torch.argmax(q_values).item()

next_state, reward, done, _ = env.step(action)

next_state = torch.FloatTensor(next_state).unsqueeze(0)

total_reward += reward

memory.append((state, action, reward, next_state, done))

state = next_state

if len(memory) >= batch_size:

batch = random.sample(memory, batch_size)

states, actions, rewards, next_states, dones = zip(*batch)

states = torch.cat(states)

actions = torch.tensor(actions).unsqueeze(1)

rewards = torch.tensor(rewards).unsqueeze(1)

next_states = torch.cat(next_states)

dones = torch.tensor(dones).unsqueeze(1)

q_values = q_network(states).gather(1, actions)

next_q_values = target_network(next_states).max(1)[0].unsqueeze(1)

target_q_values = rewards + (gamma * next_q_values * (1 - dones))

loss = nn.MSELoss()(q_values, target_q_values)

optimizer.zero_grad()

loss.backward()

optimizer.step()

target_network.load_state_dict(q_network.state_dict())

if done:

epsilon = max(epsilon_min, epsilon_decay * epsilon)

print(f"Episode {episode+1}/{episodes}, Total Reward: {total_reward}")

env.close()

🐋现实示例

🦈游戏AI

🐡AlphaGo及其技术实现

AlphaGo是由DeepMind开发的围棋AI系统,它通过结合深度神经网络和蒙特卡洛树搜索(Monte Carlo Tree Search, MCTS)取得了巨大成功,成功击败了人类顶级围棋选手。AlphaGo的核心技术包括:

- 策略网络(Policy Network):预测最佳动作。

- 价值网络(Value Network):评估当前局面的价值。

- 蒙特卡洛树搜索(MCTS):通过模拟对弈探索最优策略。

🐡AlphaGo的技术实现示例

以下是一个简单版本的蒙特卡洛树搜索算法的Python代码示例,用于示范其基本思想

import numpy as np

class Node:

def __init__(self, state, parent=None):

self.state = state

self.parent = parent

self.children = []

self.visits = 0

self.value = 0.0

def add_child(self, child_state):

child = Node(child_state, self)

self.children.append(child)

return child

def update(self, value):

self.visits += 1

self.value += value

def fully_expanded(self):

return len(self.children) == len(self.state.get_legal_actions())

def uct_search(root, itermax):

for _ in range(itermax):

node = tree_policy(root)

reward = default_policy(node.state)

backup(node, reward)

return best_child(root, 0)

def tree_policy(node):

while not node.state.is_terminal():

if not node.fully_expanded():

return expand(node)

else:

node = best_child(node, 1)

return node

def expand(node):

tried_children = [child.state for child in node.children]

new_state = node.state.get_random_untried_action(tried_children)

return node.add_child(new_state)

def best_child(node, c):

choices_weights = [

(child.value / child.visits) + c * np.sqrt((2 * np.log(node.visits) / child.visits))

for child in node.children

]

return node.children[np.argmax(choices_weights)]

def default_policy(state):

while not state.is_terminal():

state = state.take_random_action()

return state.reward()

def backup(node, reward):

while node is not None:

node.update(reward)

node = node.parent

🦈机器人控制

🐡强化学习在机器人控制中的应用

强化学习在机器人控制领域的应用显著提高了机器人的自主性和灵活性。例如,波士顿动力的机器人能够完成复杂的运动任务,如跑步、跳跃和搬运。这些机器人通过强化学习算法学习如何在不同环境中进行操作。

🐡机器人控制的技术实现示例

以下是一个使用深度强化学习算法训练机器人在模拟环境中行走的代码示例

import gym

import torch

import torch.nn as nn

import torch.optim as optim

import numpy as np

from collections import deque

import random

# 定义策略网络

class PolicyNetwork(nn.Module):

def __init__(self, state_size, action_size):

super(PolicyNetwork, self).__init__()

self.fc1 = nn.Linear(state_size, 64)

self.fc2 = nn.Linear(64, 64)

self.fc3 = nn.Linear(64, action_size)

def forward(self, state):

x = torch.relu(self.fc1(state))

x = torch.relu(self.fc2(x))

return torch.tanh(self.fc3(x))

# 环境初始化

env = gym.make('BipedalWalker-v3')

state_size = env.observation_space.shape[0]

action_size = env.action_space.shape[0]

policy_network = PolicyNetwork(state_size, action_size)

optimizer = optim.Adam(policy_network.parameters(), lr=0.001)

memory = deque(maxlen=10000)

# 超参数

episodes = 1000

gamma = 0.99

epsilon = 0.1

batch_size = 64

# 训练过程

for episode in range(episodes):

state = env.reset()

state = torch.FloatTensor(state).unsqueeze(0)

total_reward = 0

done = False

while not done:

if np.random.rand() < epsilon:

action = env.action_space.sample()

else:

with torch.no_grad():

action = policy_network(state).cpu().numpy().flatten()

next_state, reward, done, _ = env.step(action)

next_state = torch.FloatTensor(next_state).unsqueeze(0)

total_reward += reward

memory.append((state, action, reward, next_state, done))

state = next_state

if len(memory) >= batch_size:

batch = random.sample(memory, batch_size)

states, actions, rewards, next_states, dones = zip(*batch)

states = torch.cat(states)

actions = torch.tensor(actions).float()

rewards = torch.tensor(rewards).float()

next_states = torch.cat(next_states)

dones = torch.tensor(dones).float()

predicted_values = policy_network(states)

next_values = policy_network(next_states)

target_values = rewards + (gamma * next_values.max(1)[0] * (1 - dones))

loss = nn.MSELoss()(predicted_values, target_values.detach())

optimizer.zero_grad()

loss.backward()

optimizer.step()

print(f"Episode {episode+1}/{episodes}, Total Reward: {total_reward}")

env.close()

🐋强化学习的社会影响

🦈利

- 自动化与效率提升:强化学习可以优化自动化系统的性能,提高生产效率,降低人力成本。

- 决策支持:强化学习能够帮助企业在复杂环境中做出更优决策,提升竞争力。

- 新技术推动:强化学习在自动驾驶、智能家居等领域的应用,推动了新技术的发展,改善了人们的生活质量。

🦈弊

- 数据和计算资源需求高:强化学习需要大量的训练数据和计算资源,对于资源有限的组织和个人来说,门槛较高。

- 不确定性和安全性:强化学习系统可能会在未见过的环境中表现不佳,甚至做出危险的决策,存在安全隐患。

- 伦理和社会问题:随着AI系统的广泛应用,可能会引发隐私、就业等社会问题,需谨慎对待。

🐋强化学习对未来生活的便利

- 智能交通:强化学习可以优化交通信号控制,减少拥堵,提升交通效率。自动驾驶技术的进步将使出行更加安全和便捷。

- 智能家居:通过强化学习,家居设备可以自动学习用户习惯,提供个性化服务,提高生活舒适度。

- 医疗保健:强化学习可以优化医疗诊断和治疗方案,提升医疗服务质量,降低医疗成本。

- 金融服务:强化学习在金融市场预测和投资组合优化方面表现出色,能够帮助投资者做出更明智的决策。

🐋结论

强化学习作为人工智能的重要分支,凭借其在复杂环境中自主学习和优化决策的能力,正在改变各个领域的技术应用和社会结构。尽管面临数据和资源需求高、不确定性和安全性等挑战,但其在自动化、智能化方面的潜力巨大。随着技术的不断进步和应用的广泛普及,强化学习将为未来生活带来更多便利和创新。