TCN

- 时间卷积网络(TCN):概述及与CNN和RNN的比较

- 1. 时间卷积网络(TCN)

- 定义与特点

- 应用场景

- 2. 卷积神经网络(CNN)

- 定义与特点

- 应用场景

- 3. 循环神经网络(RNN)

- 定义与特点

- 应用场景

- TCN与CNN和RNN的比较

- 与CNN的关系

- 与RNN的比较

- 优缺点总结

- 结论

时间卷积网络(TCN):概述及与CNN和RNN的比较

在深度学习领域,不同的网络架构适用于不同类型的数据和任务。时间卷积网络(Temporal Convolutional Networks, TCN)是处理时间序列数据的一种有效方法,它结合了传统卷积神经网络(CNN)的特点和适应序列数据的能力。本篇博客将深入探讨TCN及其与CNN和循环神经网络(RNN)的区别、联系以及各自的优缺点。

1. 时间卷积网络(TCN)

定义与特点

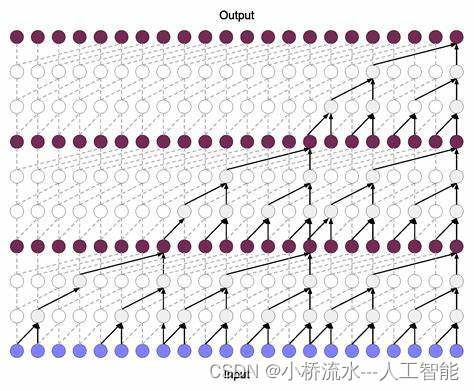

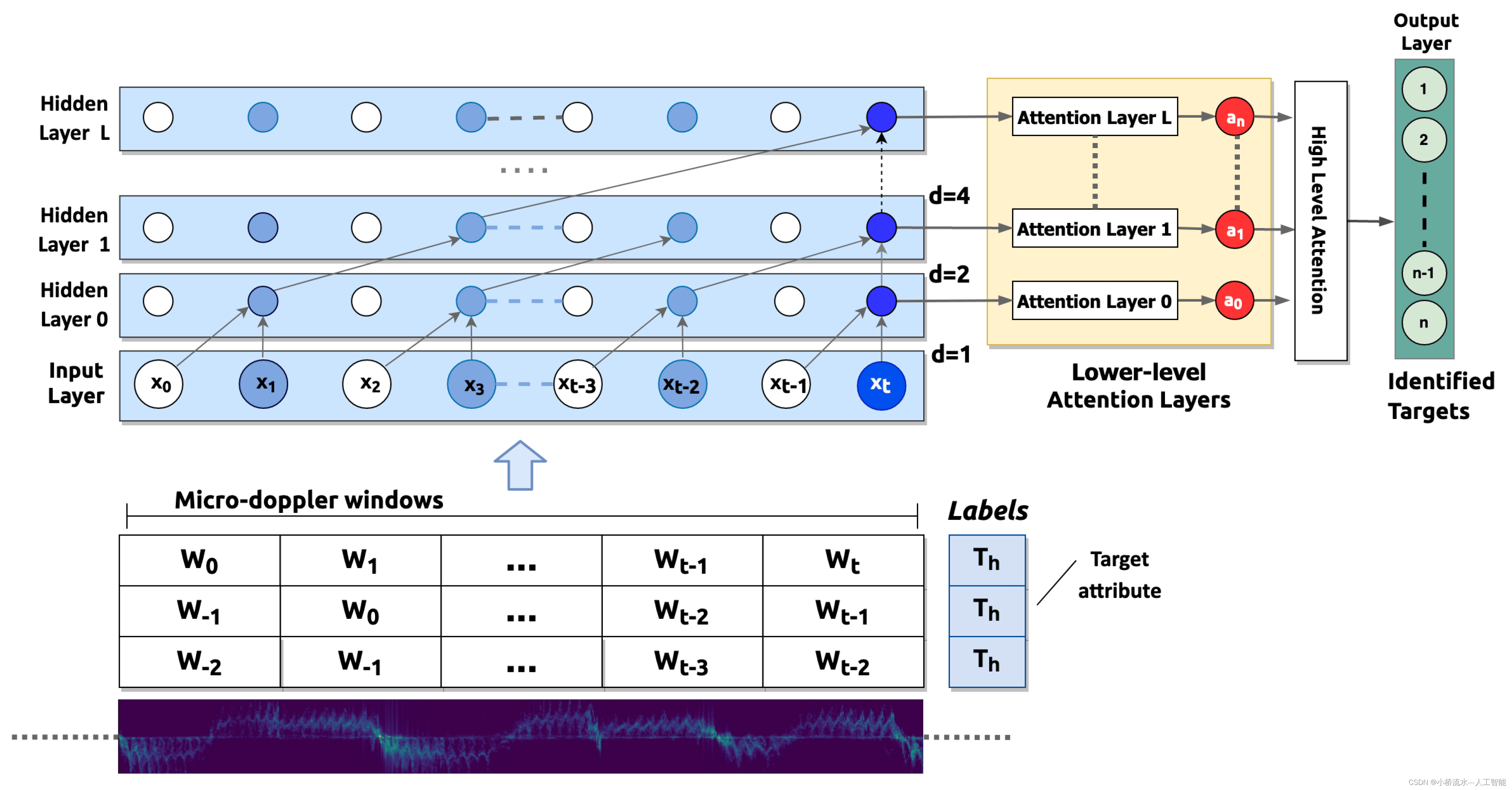

TCN是一种特别为处理时间序列数据设计的网络结构,它通过使用卷积层而非循环层来处理序列依赖关系。TCN的关键特性包括:

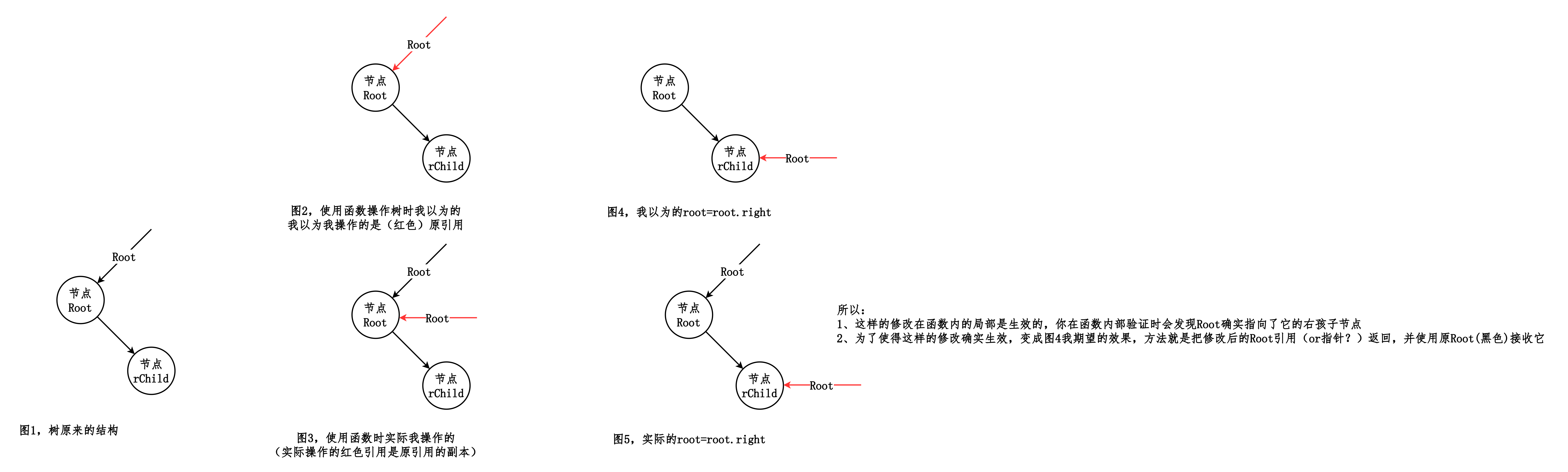

- 因果卷积:确保在预测当前时刻的值时只使用当前时刻及之前的数据,保证了模型的因果性。

- 膨胀卷积:扩大卷积层的感受野,使网络能够捕捉长范围的序列依赖关系,而不增加参数数量或计算复杂性。

应用场景

TCN适用于各种时间序列预测任务,如股票价格预测、天气预测、语音识别等。

2. 卷积神经网络(CNN)

定义与特点

CNN主要用于处理网格化数据(如图像),通过卷积层来捕捉空间上的局部关联性。其核心特点是:

- 局部感知:每个卷积操作只处理输入数据的一部分。

- 参数共享:在整个网络中重复使用相同的权重,减少模型的复杂性和过拟合的风险。

应用场景

CNN广泛应用于图像处理领域,如图像分类、目标检测和图像生成等。

3. 循环神经网络(RNN)

定义与特点

RNN设计用来处理序列数据,通过循环连接捕捉时间上的信息。其特点包括:

- 记忆能力:能够通过隐藏状态保存过去信息的影响。

- 参数共享:在不同时间步之间共享相同的权重,使网络可以处理任意长度的序列。

应用场景

RNN特别适合处理自然语言处理(NLP)任务,如机器翻译、文本生成和语音识别。

TCN与CNN和RNN的比较

与CNN的关系

TCN借鉴了CNN的卷积操作,但通过引入因果卷积和膨胀卷积使其适应序列数据。与CNN相比,TCN的优势在于其能够有效地捕捉长期依赖关系而不受限于固定的窗口尺寸。

与RNN的比较

与RNN相比,TCN的一个显著优势是训练的稳定性和效率。RNN由于梯度消失和爆炸问题,训练起来可能较困难,而TCN的训练过程更为稳定。此外,TCN可以并行处理所有时间步的数据,而RNN必须按序处理,这使得TCN在处理长序列时更加高效。

优缺点总结

TCN的优点包括:

-

能够捕捉长距离的时间依赖关系

-

训练更加稳定和高效

-

更好的并行化能力

TCN的缺点可能包括:

- 模型设计和参数调整相对复杂

- 对于某些类型的序列数据,如具有复杂时间模式的数据,可能需要更精细的调整

结论

虽然TCN是在CNN的基础上发展起来的,它通过独特的结构调整使得卷积网络可以有效处理序列数据,同时解决了RNN在长序列处理中遇到的一些问题。理解TCN及其与其他网络结构的区别对于选择正确的工具解决特定的序列处理任务至关重要。希望本篇博客能帮助您深入理解TCN的结构和应用,为您的研究或实际应用提供有价值的参考。