在深入学习大模型的过程中,我们常常需要查阅Medium上的技术文章。Medium作为一个流行的内容发布平台,汇集了大量高质量的技术和科学文章,对于希望紧跟技术前沿的学习者来说,是一个宝贵的知识库。然而,这些文章大多为英文,对于非英语母语的读者来说,阅读和理解可能存在障碍。英文文章的阅读不仅需要较高的语言能力,而且在理解专业术语和复杂概念时可能会遇到困难,这无疑增加了学习的难度和时间成本。即便使用一般的翻译软件,文章中的类似图片和链接也会丢失掉一些重要信息,这对于我来说,也是不能接受的。

因此,开发一个高效的翻译工具,将这些文章翻译成中文,对于提升学习效率和理解深度具有重要意义。这样的工具不仅可以帮助读者快速获取信息,还能促进知识的传播和共享,使得更多的人能够受益于这些优质内容。通过利用人工智能技术,特别是LLM大模型开发,我们可以实现文本的自动翻译,从而打破语言障碍,让知识无国界,更可贵的是,我要保留文章中的图片和链接的有效。

概念解释

在深入探讨如何实现这一高效的翻译工具之前,我们先来了解几个关键的技术概念:

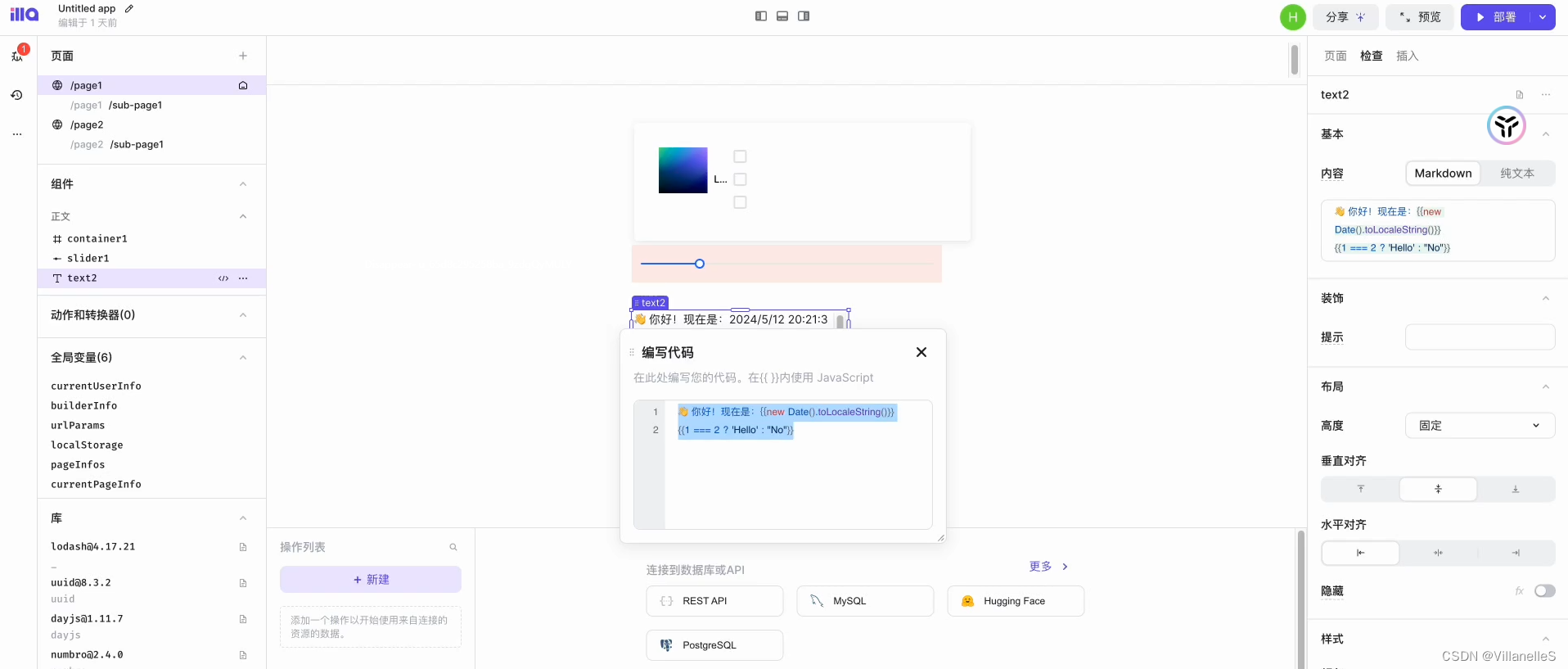

Streamlit

Streamlit是一个强大的Python库,专门用于快速构建和共享数据应用程序。它提供了一个简单直观的界面,使得开发者可以轻松地创建交互式的Web应用,这对于展示和操作数据非常有用。详细介绍可参阅我的另一篇文章:全面对比dify、coze、streamlit、chainlit

LangChain

LangChain是一个框架,用于构建和集成多种语言模型。它支持多种预训练的语言模型,使得开发者可以根据需要选择合适的模型来处理不同的语言任务,如文本翻译、摘要生成等。详细可以了解我的这个合集:LangChain入门

通过结合这些技术,我们可以构建一个既高效又用户友好的翻译工具,帮助用户轻松地翻译Medium上的技术文章。

实现思路

获取文章内容

首先,我们需要通过Medium API获取指定ID的文章Markdown内容。这一步骤是整个翻译流程的起点,确保我们能够获取到原始的文章内容。

文本分割

由于文章可能较长,直接翻译整个文档可能会影响翻译质量和效率。因此,我们使用文本分割器将长篇文章分割成适合处理的小块,这样可以更高效地进行翻译。

翻译处理

接下来,我们利用预训练的语言模型对每个文本块进行翻译。这一步骤是核心,它涉及到将英文文本转换为中文,同时保持原文的语义和结构。

输出翻译结果

最后,我们将翻译后的文本块整合,保持原有的Markdown格式输出。这样,用户可以方便地阅读翻译后的文章,同时保持原文的格式和结构。

通过这一系列的步骤,我们能够实现一个既准确又高效的翻译工具,帮助用户跨越语言障碍,更好地学习和理解技术文章。

代码实现解析

环境配置与API密钥设置

在构建高效的AI翻译工具之前,首先需要确保环境配置正确,特别是API密钥的设置。API密钥是访问外部服务,如Medium API和翻译服务的关键。在代码中,我们通过环境变量DEEPSEEK_API_KEY来管理API密钥,这样可以确保密钥的安全性,避免直接暴露在代码中。

with st.sidebar:

if os.environ.get("DEEPSEEK_API_KEY") is None:

openai_api_key = st.text_input("Deepseek API Key", type="password")

"[Get an Deepseek API key](https://platform.deepseek.com/)"

else:

openai_api_key = os.environ.get("DEEPSEEK_API_KEY")

界面构建

使用Streamlit创建用户界面是实现交互性的关键步骤。我们的界面包括一个输入框和一个提交按钮,用户可以在这里输入Medium文章的ID,并触发翻译过程。

with st.form("my_form"):

text = st.text_input("id:", placeholder="请输入medium文章的id")

submitted = st.form_submit_button("Submit")

核心翻译函数

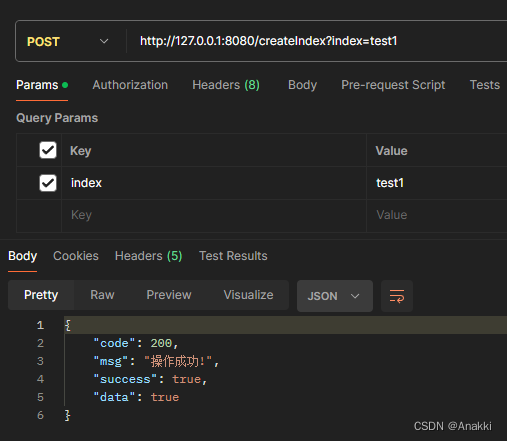

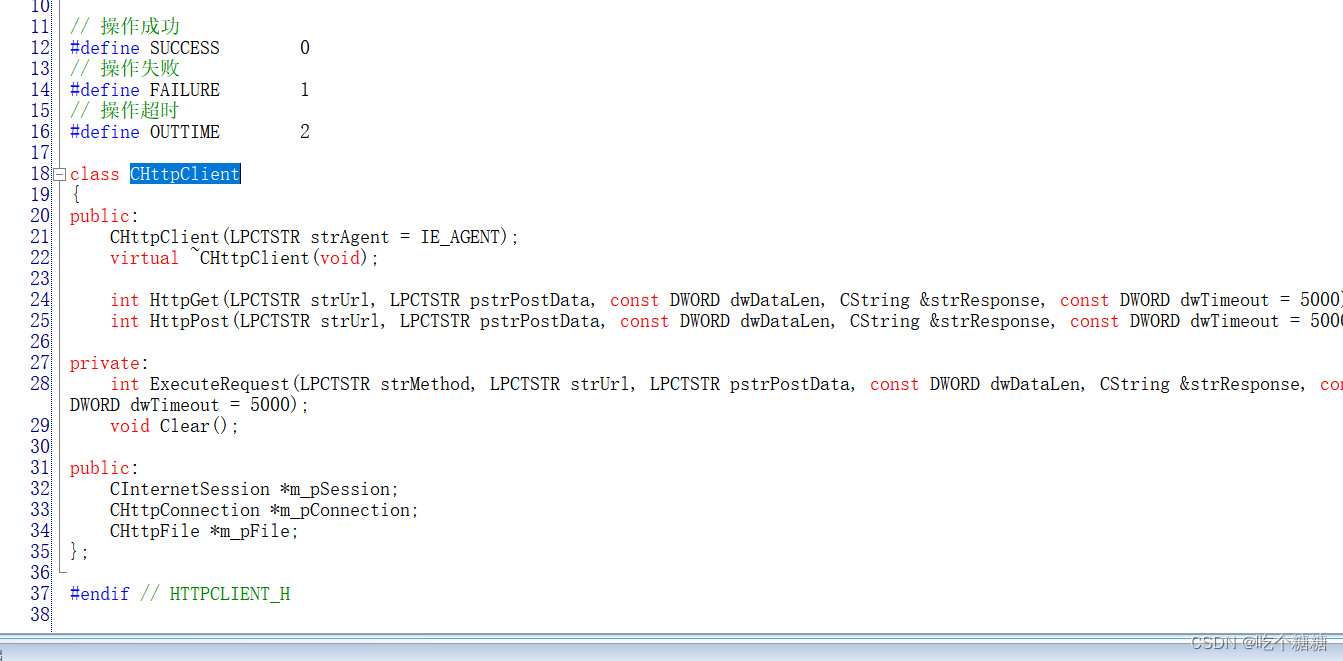

generate_response函数是实现文章翻译的核心。它首先通过Medium API获取文章的Markdown内容,这里我使用了rapidapi开放接口封装成tool来获取文章内容,然后使用文本分割器将文章分割成小块,最后利用预训练的语言模型对每个文本块进行翻译,并将翻译结果整合输出。

@traceable

def generate_response(input_text):

llm = LLMs(model_name="glm-3-turbo", temprature=0.7).get_llm()

system_prompt = """你是一位专业的技术文章翻译专家。我们将进行一次多轮对话,你需要将一篇英文 Markdown 文章翻译成中文。

请按照以下规则进行:

1. 我会每次提供文章的一部分内容,你需要将其翻译成中文。

2. 请不要添加任何其他文字即可。

"""

prompt = PromptTemplate(input_variables=["context"], template="{context}")

# 如果article.md存在,就直接读取,如果不存在,则写入

if os.path.exists(f"articles/{input_text}.md"):

with open(f"articles/{input_text}.md", "r") as f:

article_markdown = f.read()

else:

with open(f"articles/{input_text}.md", "w") as f:

medium_tool = med_art.GetMediumTool()

article_markdown = medium_tool.run(input_text)

f.write(article_markdown)

memory = ConversationBufferMemory()

chain = LLMChain(llm=llm, prompt=prompt, memory=memory)

text_splitter = RecursiveCharacterTextSplitter(chunk_size=2000, chunk_overlap=0, separators=["\n\n"])

texts = text_splitter.split_text(article_markdown)

chinese_translation = ''

for text in texts:

result = chain.run(text)

chinese_translation += "\n\n" + result

st.write(result)

return

获取文章的tool即:GetMediumTool,通过调用rapidapi的接口,来获取文章,该接口免费版本每月有一定的额度,需要自行解决网络问题才能使用。

class GetMediumTool(BaseTool):

name = "custom_api_tool"

description = "一个用于根据文章id获取medium文章的工具"

args_schema: Type[BaseModel] = Input

def _run(self, article_id: str) -> str:

"""使用该工具调用API"""

base_url = "https://medium2.p.rapidapi.com"

headers = {

"X-RapidAPI-Key": os.environ.get("RAPID_API_KEY"),

"X-RapidAPI-Host": "medium2.p.rapidapi.com"

}

url = f"{base_url}/article/{article_id}/markdown"

response = requests.get(url, headers=headers)

response.raise_for_status()

result = response.json()['markdown']

print(type(result))

return result

def run(self, article_id: str, verbose: bool = False, color: str = 'black', callbacks=None, llm_prefix='', observation_prefix='') -> str:

"""调用工具的入口函数"""

if 'Observation:' in article_id:

import json

dict_data = json.loads(article_id.replace('\nObservation:', '').replace("'", "\""))

article_id = dict_data['article_id']

# 判断article_id是个json字符串

if isinstance(article_id, dict):

article_id = article_id['article_id']

return self._run(article_id)

多轮对话翻译

为了提高翻译的连贯性和准确性,我们引入了多轮对话翻译机制。通过对话记忆,系统可以记住之前的翻译内容,从而在后续的翻译中保持上下文的连贯性。

memory = ConversationBufferMemory()

chain = LLMChain(llm=llm, prompt=prompt, memory=memory)

通过上述步骤,我们不仅实现了文章的自动翻译,还确保了翻译的质量和用户体验。这种结合AI技术和编程工具的方法,为解决实际问题提供了有效的解决方案。

文本分割与处理

在generate_response函数中,我们使用了RecursiveCharacterTextSplitter来分割文章。这种分割器能够根据文本中的自然分隔符(如换行符)来分割文本,确保每个文本块在语义上相对独立,便于后续的翻译处理。

text_splitter = RecursiveCharacterTextSplitter(chunk_size=2000, chunk_overlap=0, separators=["\n\n"])

texts = text_splitter.split_text(article_markdown)

这里,chunk_size设置为2000字符,确保每个文本块不会过大,以便于翻译模型处理。chunk_overlap设置为0,意味着每个文本块之间没有重叠,这样可以减少翻译时的冗余。

翻译与输出

翻译过程中,我们利用预训练的语言模型对每个文本块进行翻译,并将翻译结果实时显示在Streamlit界面上。这不仅让用户能够即时看到翻译进度,也便于用户对翻译结果进行实时检查和反馈。

for text in texts:

result = chain.run(text)

chinese_translation += "\n\n" + result

st.write(result)

每次翻译完成后,翻译结果会被添加到chinese_translation变量中,并显示在界面上。这样,用户可以逐步查看翻译结果,确保翻译的准确性和连贯性。

多轮对话翻译的实现

多轮对话翻译通过ConversationBufferMemory实现,它允许系统记住之前的对话内容,从而在后续的翻译中保持上下文的连贯性。这种机制特别适用于处理长篇文章,可以确保翻译的整体一致性。

memory = ConversationBufferMemory()

chain = LLMChain(llm=llm, prompt=prompt, memory=memory)

通过这种方式,系统能够在翻译过程中不断学习和调整,以适应文章的特定风格和术语,从而提供更加精准和自然的翻译结果。

总结

通过本项目,我们不仅实现了一个高效的Medium文章翻译工具,还深入了解了如何结合AI技术和编程工具来解决实际问题。这不仅提升了个人学习效率,也为其他需要翻译服务的场景提供了参考和启示。通过Streamlit构建的交互式界面,用户可以轻松地输入文章ID并获取翻译结果,整个过程直观且高效。此外,多轮对话翻译机制的引入,进一步提高了翻译的质量和用户体验,使得翻译结果更加准确和自然。