文章目录

- 2.1 Chart包方式安装kafka集群

- 5.开始安装

- 2.2 命令行方式安装kafka集群

- 搭建 Kafka-UI

- 三、kafka集群测试

- 3.1 方式一

- 3.2 方式二

- 四、kafka集群扩容

- 4.1 方式一

- 4.2 方式二

- 五、kafka集群删除

参考文档

[Helm实践---安装kafka集群 - 知乎 (zhihu.com)](https://zhuanlan.zhihu.com/p/642515749)

[K8S Kraft Kafka 集群搭建 - 掘金 (juejin.cn)](https://juejin.cn/post/7330515218605637667)

2.1 Chart包方式安装kafka集群

bitnami/kafka 就是原生的 Kafka,confluentinc 是在原生 Kafka 的基础上加了一些东西,但他还是兼容原生 Kafka,有兴趣的自己去看

1.添加helm仓库地址

helm repo add bitnami https://charts.bitnami.com/bitnami

1.更新仓库

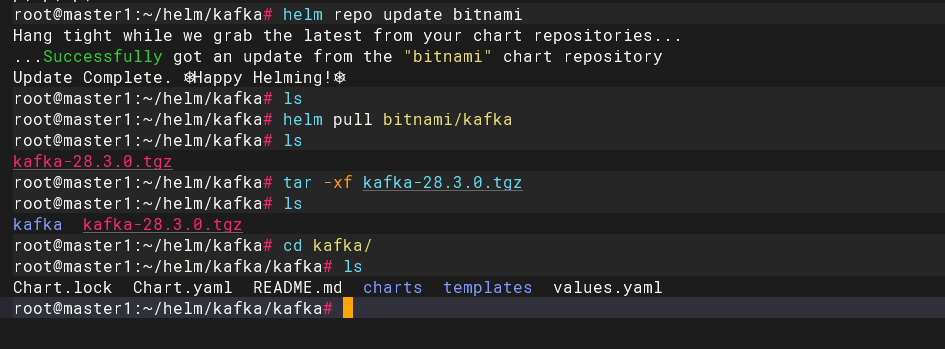

helm repo update bitnami

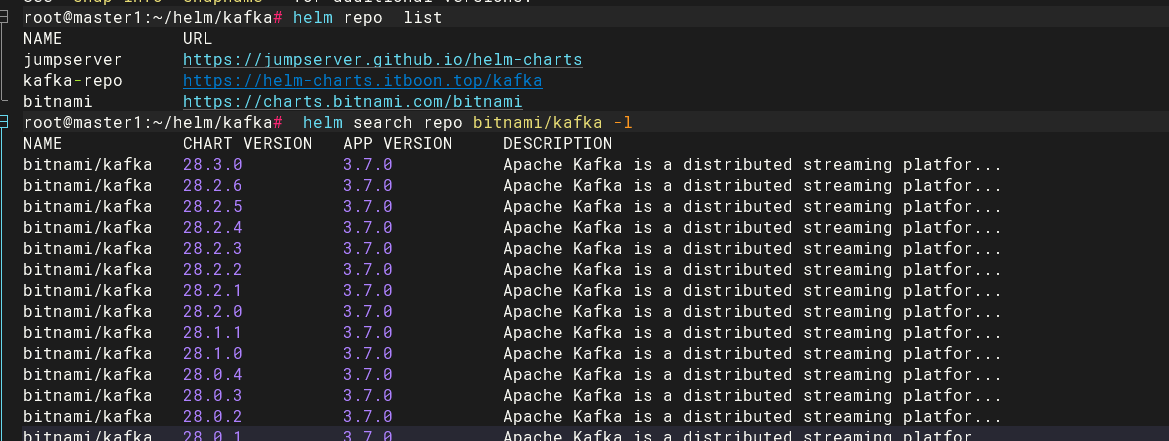

1.查看kafka的Chart包的历史版本

root@master1:~/helm/kafka# helm search repo bitnami/kafka -l

NAME CHART VERSION APP VERSION DESCRIPTION

bitnami/kafka 28.3.0 3.7.0 Apache Kafka is a distributed streaming platfor...

bitnami/kafka 28.2.6 3.7.0 Apache Kafka is a distributed streaming platfor...

bitnami/kafka 28.2.5 3.7.0 Apache Kafka is a distributed streaming platfor...

bitnami/kafka 28.2.4 3.7.0 Apache Kafka is a distributed streaming platfor...

bitnami/kafka 28.2.3 3.7.0 Apache Kafka is a distributed streaming platfor...

(2).查看chart包格式: helm show chart chart包名 或 helm show values chart包名 (查看详细信息)

2.下载最新chart包

[root@k8s-master01 ~]# helm pull bitnami/kafka

如果想要下载指定版本,需要指定–version参数

[root@k8s-master01 ~]# helm pull bitnami/kafka --version 23.0.0

(3).拉取chart包格式:

helm pull 远程仓库chart包名 --version 0.4.3 --untar #从远程仓库拉取指定版本的chart包到本地并解压,--untar是解压,不加就是压缩包

helm pull 远程仓库chart包名 --untar #从远程仓库拉取最新版本的chart包到本地并解压,--untar是解压,不加就是压缩包

3.解压chart包

[root@k8s-master01 ~]# tar -xf kafka-23.0.1.tgz

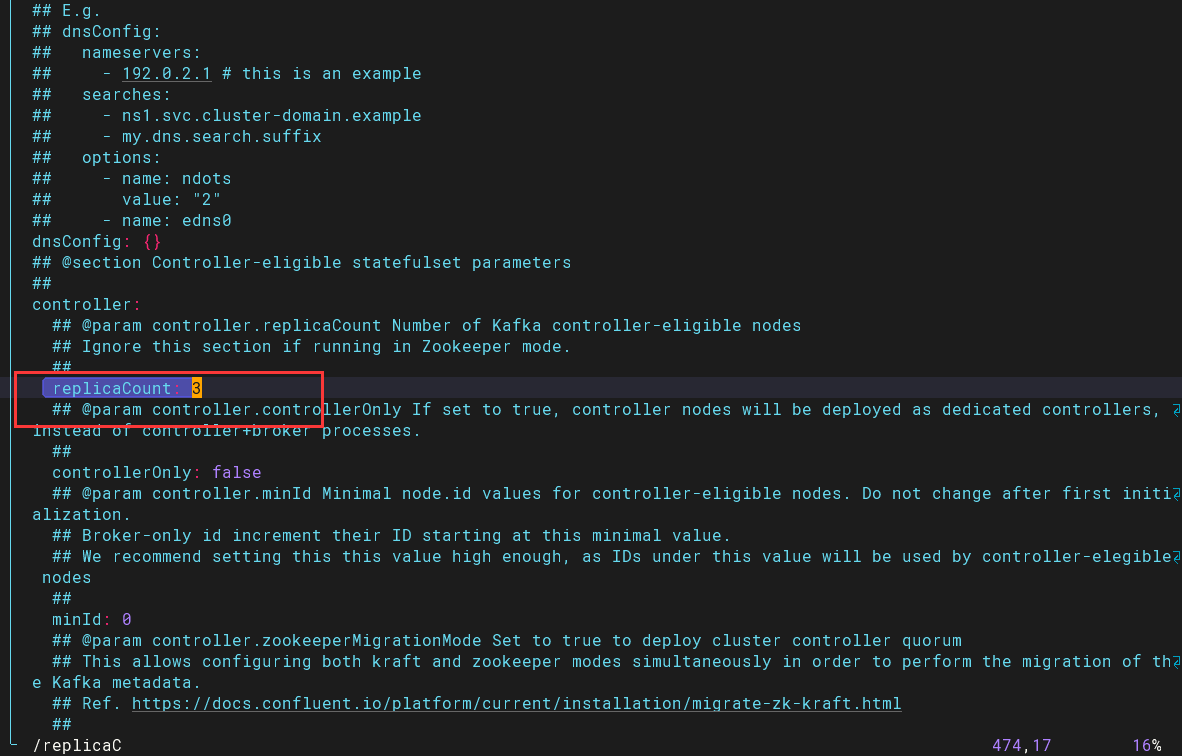

4.修改values.yaml相应配置

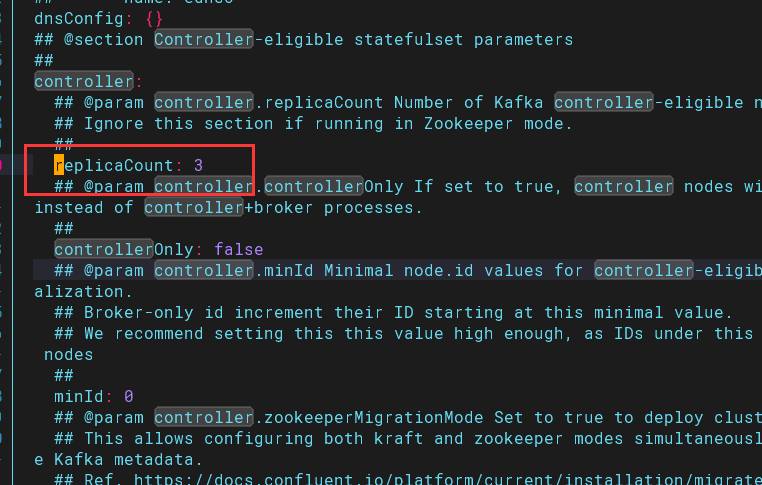

需要修改replicaCount的值为3

$ cd /root/helm/kafka/kafka

$ vim values.yaml

根据自己需要修改image(可不改)

$ cd /root/kafka

$ vim values.yaml

...

...

image:

registry: registry.cn-hangzhou.aliyuncs.com

repository: abroad_images/kafka

tag: 3.5.0-debian-11-r1

image:

registry: registry.cn-hangzhou.aliyuncs.com

repository: abroad_images/kubectl

tag: 1.25.11-debian-11-r4

image:

registry: registry.cn-hangzhou.aliyuncs.com

repository: abroad_images/bitnami-shell

tag: 11-debian-11-r130

image:

registry: registry.cn-hangzhou.aliyuncs.com

repository: abroad_images/kafka-exporter

tag: 1.7.0-debian-11-r11

image:

registry: registry.cn-hangzhou.aliyuncs.com

repository: abroad_images/jmx-exporter

tag: 0.18.0-debian-11-r34

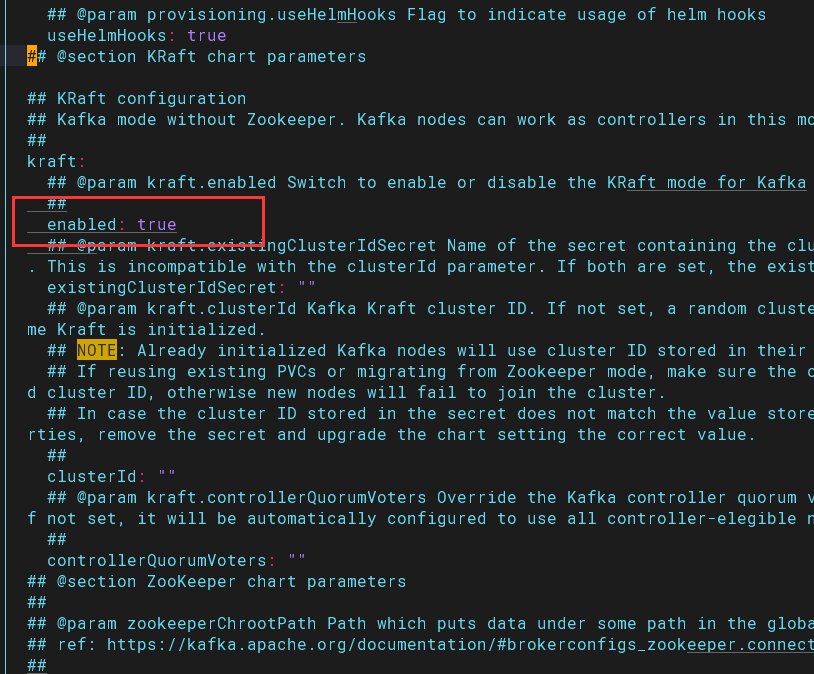

如果使用指定的zookeeper,kraft模式要关闭,修改kraft.enable 的值为false,新版kafka新增了一个kraft模式,他与zookeeper是冲突的,不能同时使用

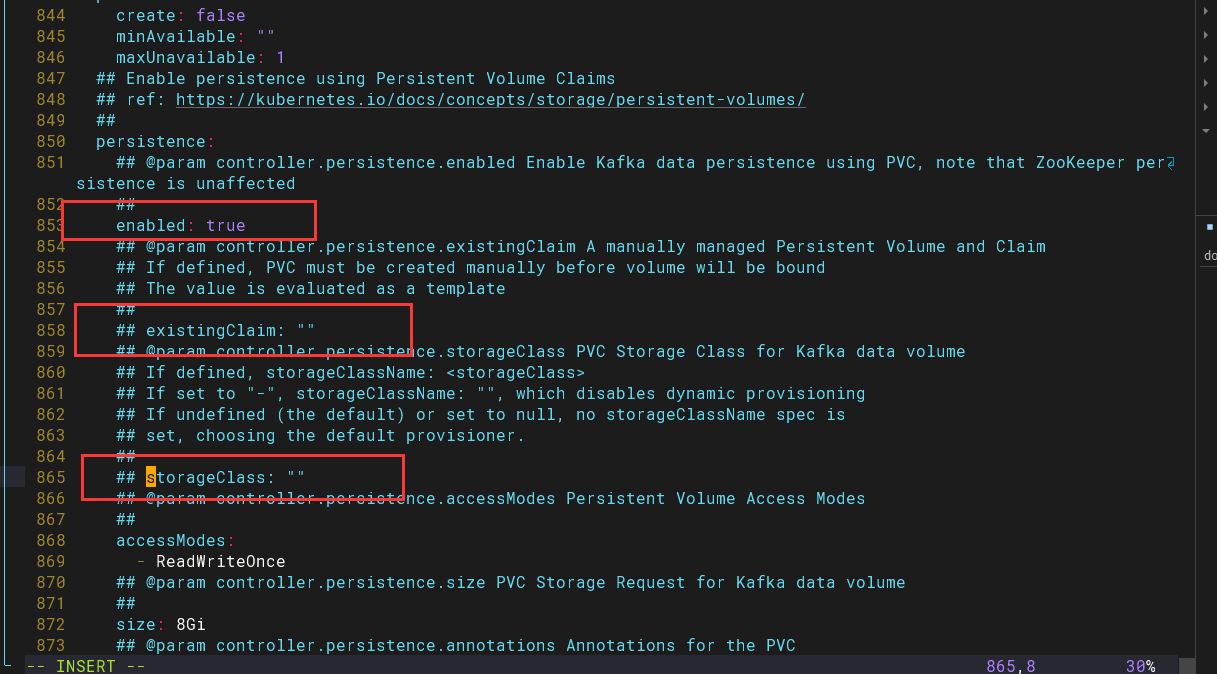

根据自己需要修改持久化配置,这里因为是测试环境没有使用持久化(生产必须要使用持久化)。其中修改内容如下:

- enabled修改为false

- 注释existingClaim

- 注释storageClass

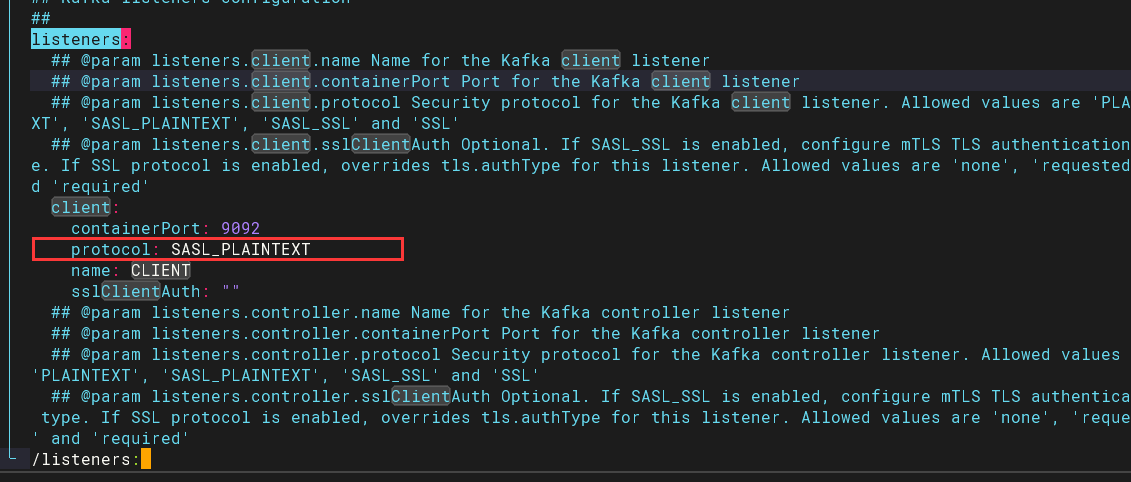

客户端需不需要认证主要是这里

listeners:

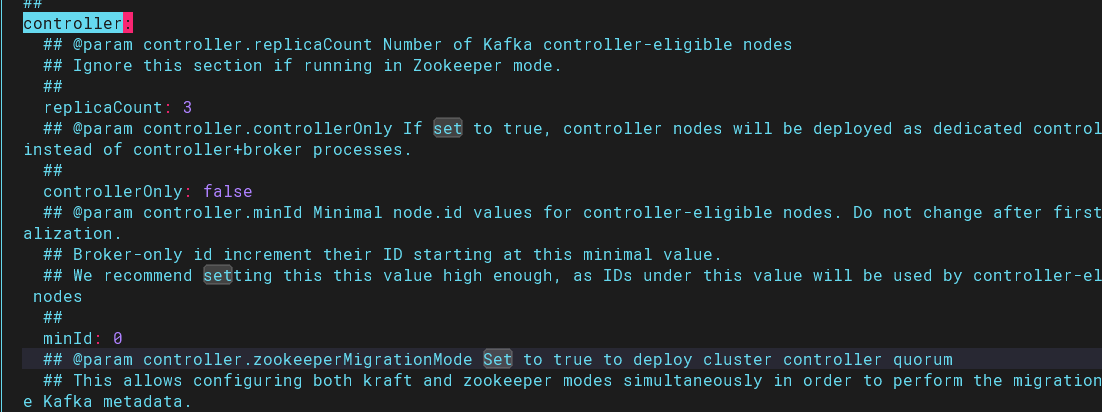

默认controller可以兼职broker

controller:

5.开始安装

[root@k8s-master01 kafka]# helm install -n kafka kafka .

6.观察到kafka集群已经安装完成

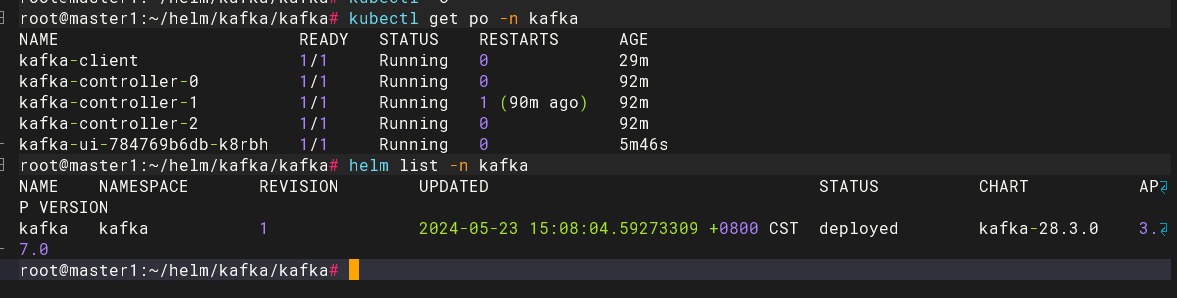

root@master1:~/helm/kafka/kafka# kubectl get po -n kafka

NAME READY STATUS RESTARTS AGE

kafka-client 1/1 Running 0 29m

kafka-controller-0 1/1 Running 0 92m

kafka-controller-1 1/1 Running 1 (90m ago) 92m

kafka-controller-2 1/1 Running 0 92m

kafka-ui-784769b6db-k8rbh 1/1 Running 0 5m46s

7.查看安装的版本信息

root@master1:~/helm/kafka/kafka# helm list -n kafka

NAME NAMESPACE REVISION UPDATED STATUS CHART APP VERSION

kafka kafka 1 2024-05-23 15:08:04.59273309 +0800 CST deployed kafka-28.3.0 3.7.0

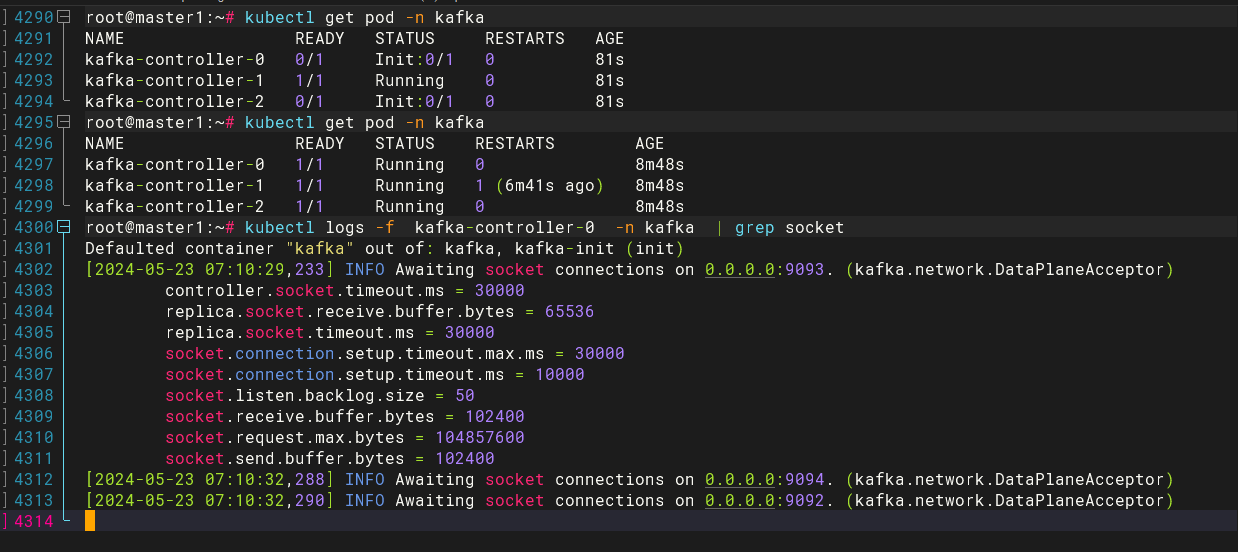

8.验证kafka与zookeeper是否绑定,观察到已成功绑定

[root@k8s-master kafka]# kubectl logs -f kafka-0 -n kafka | grep socket

5.查看安装的values

[root@k8s-master]# helm get values kafka -n kafka

2.2 命令行方式安装kafka集群

1.直接安装

$ helm install kafka bitnami/kafka --set zookeeper.enabled=false --set replicaCount=3 --set externalZookeeper.servers=zookeeper --set persistence.enabled=false -n public-service

helm install kafka kafka --values ./kafka/values.yaml \

--set replicaCount=1 \

--set kafka.kafkaConfigOverrides=transaction.state.log.replication.factor=1 \

--set kafka.kafkaConfigOverrides=transaction.state.log.min.isr=1 \

--set kafka.kafkaConfigOverrides=default.replication.factor=1 \

--set kafka.kafkaConfigOverrides=num.io.threads=2 \

--set kafka.kafkaConfigOverrides=num.network.threads=2 \

--set kafka.kafkaConfigOverrides=inter.broker.protocol.version=3.5.1 \

--set kafka.kafkaConfigOverrides=offsets.topic.replication.factor=1 \

--set kafka.kafkaConfigOverrides=transaction.state.log.num.partitions=50

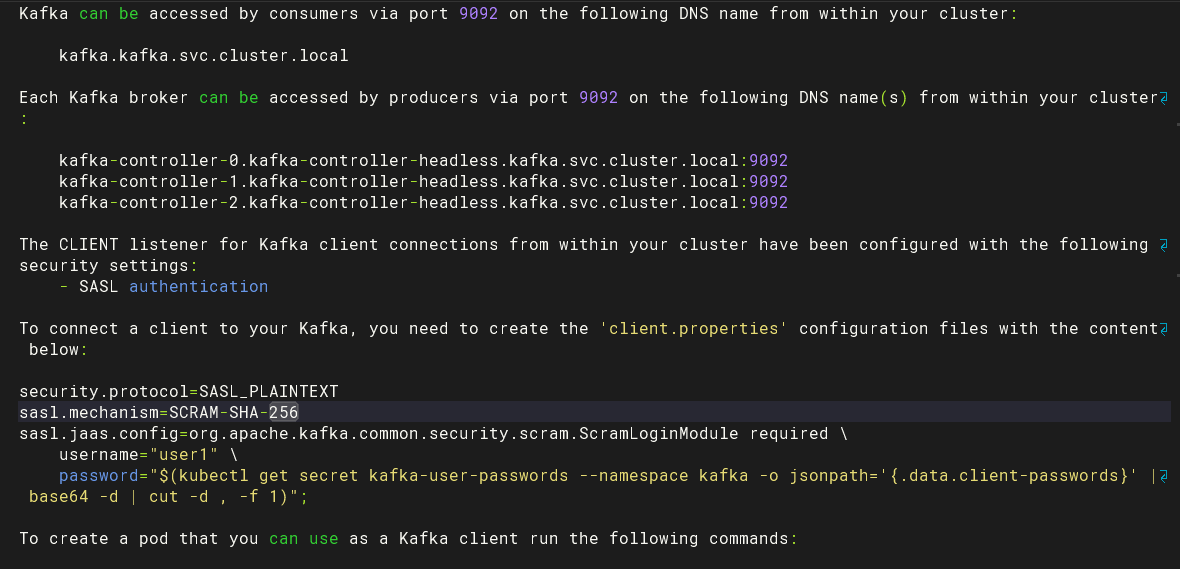

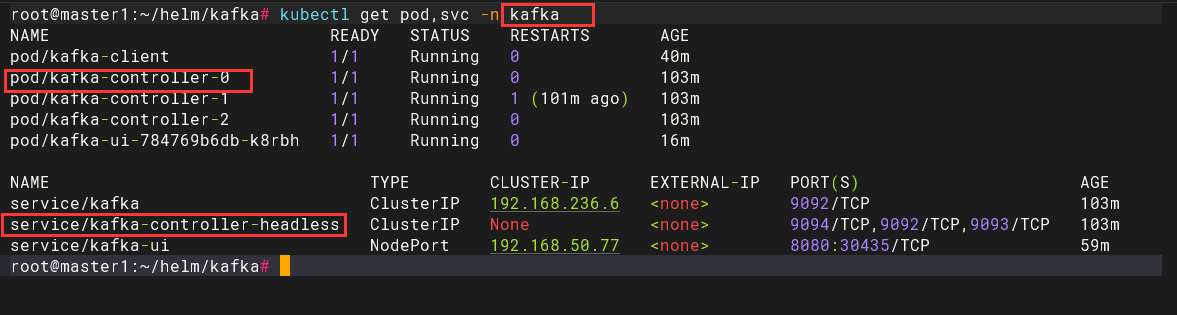

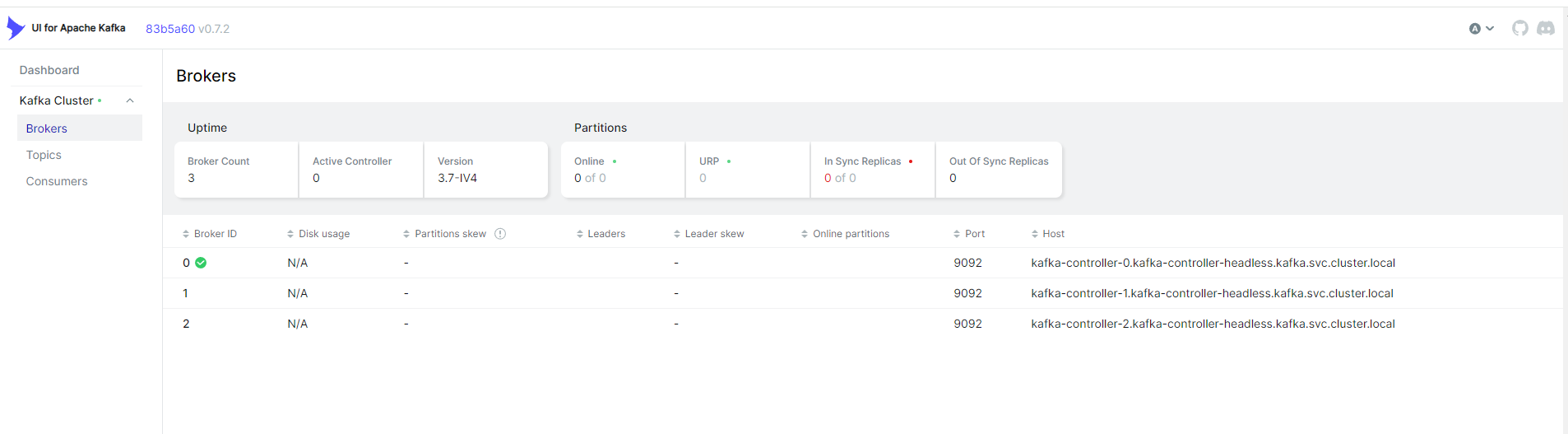

搭建 Kafka-UI

kafka-web-ui.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: kafka-ui

labels:

app: kafka-ui

namespace: kafka

spec:

replicas: 1

selector:

matchLabels:

app: kafka-ui

template:

metadata:

labels:

app: kafka-ui

spec:

containers:

- name: kafka-ui

image: provectuslabs/kafka-ui:latest

env:

- name: KAFKA_CLUSTERS_0_NAME

value: 'Kafka Cluster'

- name: KAFKA_CLUSTERS_0_BOOTSTRAPSERVERS

value: 'kafka-controller-0.kafka-controller-headless.kafka.svc.cluster.local:9092,kafka-controller-1.kafka-controller-headless.kafka.svc.cluster.local:9092,kafka-controller-2.kafka-controller-headless.kafka.svc.cluster.local:9092'

- name: KAFKA_CLUSTERS_0_PROPERTIES_SECURITY_PROTOCOL

value: 'SASL_PLAINTEXT'

- name: KAFKA_CLUSTERS_0_PROPERTIES_SASL_MECHANISM

value: 'PLAIN'

- name: KAFKA_CLUSTERS_0_PROPERTIES_SASL_JAAS_CONFIG

value: 'org.apache.kafka.common.security.scram.ScramLoginModule required username="user1" password="xY71glsywM";'

resources:

requests:

memory: "256Mi"

cpu: "100m"

ports:

- containerPort: 8080

---

apiVersion: v1

kind: Service

metadata:

name: kafka-ui

namespace: kafka

spec:

selector:

app: kafka-ui

type: NodePort

ports:

- protocol: TCP

port: 8080

targetPort: 8080

参数详解

value: 'kafka-controller-0.kafka-controller-headless.kafka.svc.cluster.local:9092

kafkapod名称 svc名称 命名空间

浏览器访问

三、kafka集群测试

这里通过两种方式测试下kafka集群,区别只是一个是新起一个容器进行测试,另一个则是在原来的基础进行测试:

3.1 方式一

1.运行一个kafka-client,用于连接kafka集群

kubectl run kafka-client --restart='Never' --image docker.io/bitnami/kafka:3.7.0-debian-12-r6 --namespace kafka --command -- sleep infinity

上面参数说明:

- `--restart='Never'`: 设置 Pod 的重启策略为 "Never",这意味着 Pod 不会自动重启

- `--command -- sleep infinity`: 在容器中执行命令 `sleep infinity`,以保持 Pod 持续运行。

- `--command` 表示后面的内容是一个命令而不是一个参数,

- `sleep infinity` 是一个常用的命令,使得容器无限期地休眠

查看pod,已成功建立

root@master1:~/helm/kafka# kubectl get po -n kafka

NAME READY STATUS RESTARTS AGE

kafka-client 1/1 Running 0 51m

kafka-controller-0 1/1 Running 0 114m

kafka-controller-1 1/1 Running 1 (112m ago) 114m

kafka-controller-2 1/1 Running 0 114m

kafka-ui-784769b6db-k8rbh 1/1 Running 0 27m

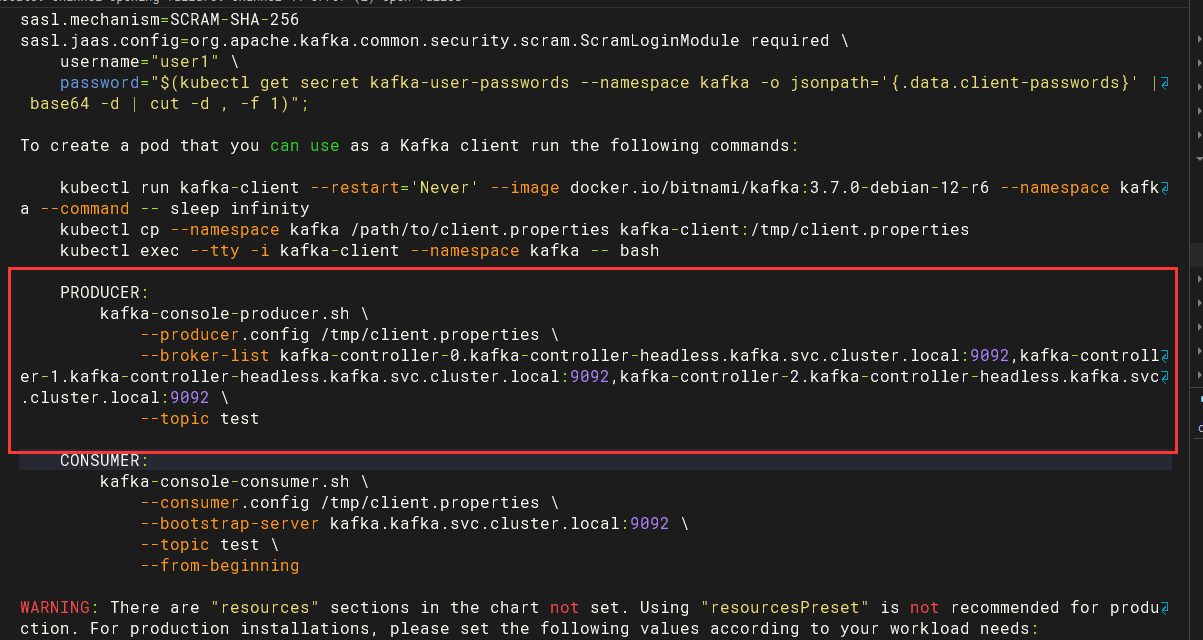

2.在k8s-master01节点上开启两个窗口,一个用于生产者,一个用作消费者。 (1)生产者窗口

进入kafka创建一个名为test的topic,出现>代表成功

kubectl exec -it kafka-client -n kafka -- /bin/bash

cd /opt/bitnami/kafka/bin

kafka-console-producer.sh \

--broker-list kafka-controller-0.kafka-controller-headless.kafka.svc.cluster.local:9092,kafka-controller-1.kafka-controller-headless.kafka.svc.cluster.local:9092,kafka-controller-2.kafka-controller-headless.kafka.svc.cluster.local:9092 \

--topic test

参数详解

- `kafka-console-producer.sh`:用于创建生产者

- `--broker-list 指定要连接的 Kafka Broker 列表。使用逗号分隔多个 Broker 的地址。在这里,指定了三个 Kafka Broker 的地址

- `--topic test`:指定要发布消息的主题名称,这里使用的是 "test"

(2)消费者窗口

kubectl exec -it kafka-client -n kafka -- /bin/bash

cd /opt/bitnami/kafka/bin

kafka-console-consumer.sh \

--bootstrap-server kafka.kafka.svc.cluster.local:9092 \

--topic test \

--from-beginning

上面参数说明:

- `kafka-console-consumer.sh`:用于启动消费者

- `--bootstrap-server localhost:9092`:指定用于引导连接到 Kafka 集群的 Kafka Broker 的地址。使用的是本地主机(localhost)上的 Kafka Broker,并监听 9092 端口

- `--topic test`:指定要发布消息的主题名称,这里使用的是 "test"

- `--from-beginning`:设置消费者从主题的开始处开始消费消息。这意味着消费者将从主题中的最早可用消息开始消费

3.开始测试,观察到消费正常

(1)生产者窗口

>test2

>test1

(2)消费者窗口

test2

test1

3.2 方式二

1.进入kafka创建一个名为testtopic的topic

kubectl exec -it kafka-controller-0 -n kafka -- /bin/bash

cd /opt/bitnami/kafka/bin

kafka-topics.sh \

--create \

--bootstrap-server kafka-controller-0.kafka-controller-headless.kafka.svc.cluster.local:9092 \

--replication-factor 1 --partitions 1 --topic testtopic

上面参数说明:

--create:指示kafka-topics.sh命令创建一个新的主题kafka-topics.sh:用于创建topic--bootstrap-server localhost:9092:指定用于引导连接到 Kafka 集群的 Kafka Broker 的地址。使用的是本地主机(localhost)上的 Kafka Broker,并监听 9092 端口--replication-factor 1:设置主题的副本因子(replication factor),指定每个分区的副本数量。--partitions 1:设置主题的分区数,指定要创建的分区数量--topic testtopic:指定要创建的主题的名称,这里使用的是 “testtopic”

2.启动消费者

kafka-console-consumer.sh \

--bootstrap-server localhost:9092 \

--topic testtopic

上面参数说明:

kafka-console-consumer.sh:用于创建消费者--bootstrap-server localhost:9092:指定用于引导连接到 Kafka 集群的 Kafka Broker 的地址。使用的是本地主机(localhost)上的 Kafka Broker,并监听 9092 端口

3.新起一个窗口后,进入kafka,启动一个生产者后,输出hello字段

kubectl exec -it kafka-0 -n public-service -- bash

kafka-console-producer.sh --bootstrap-server localhost:9092 --topic testtopic

>hello

上面参数说明:

kafka-console-consumer.sh:用于创建生产者--bootstrap-server localhost:9092:指定用于引导连接到 Kafka 集群的 Kafka Broker 的地址。使用的是本地主机(localhost)上的 Kafka Broker,并监听 9092 端口

4.在消费者窗口上进行查看,观察到消费正常

kafka-console-consumer.sh --bootstrap-server localhost:9092 --topic testtopic

hello

四、kafka集群扩容

关于kafka集群扩容,这里介绍两种方式:一种是修改副本数进行扩容,另一种是使用helm upgrade进行扩容

4.1 方式一

1.修改values.yaml相应配置,搜索replicaCount,将副本数修改为5

[root@k8s-master01 ~]# cd /root/kafka

[root@k8s-master01 kafka]# vim values.yaml

2.开始扩容

[root@k8s-master01 ~]# cd /root/kafka

[root@k8s-master01 kafka]# helm upgrade -n kafka kafka .

3.查看pod建立情况,观察到已经成功扩容

4.2 方式二

其实这种方式只针对命令行方式安装kafka集群

1.直接使用helm upgrade命令进行扩容

$ helm upgrade kafka bitnami/kafka --set zookeeper.enabled=false --set replicaCount=3 --set externalZookeeper.servers=zookeeper --set persistence.enabled=false -n public-service

2.查看pod建立情况,观察到已经成功扩容

五、kafka集群删除

1.查看安装的集群

[root@k8s-master01 kafka]# helm list -A

NAME NAMESPACE REVISION UPDATED STATUS CHART APP VERSION

kafka public-service 2 2023-07-08 20:51:17.114862828 +0800 CST deployed kafka-23.0.1 3.5.0

zookeeper public-service 1 2023-07-08 17:16:23.567379001 +0800 CST deployed zookeeper-11.4.3 3.8.1

2.删除kafka集群

[root@k8s-master01 kafka]# helm delete kafka -n kafka