一 Pod基础概念:

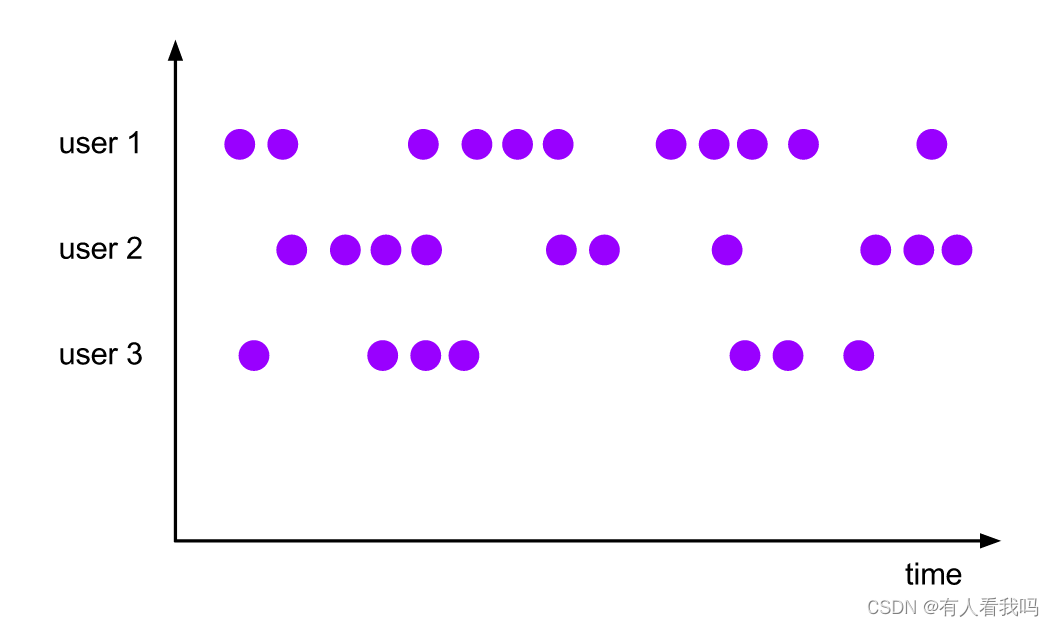

①Pod是kubernetes中最小的资源管理组件,Pod也是最小化运行容器化应用的资源对象。一个

Pod代表着集群中运行的一个进程。

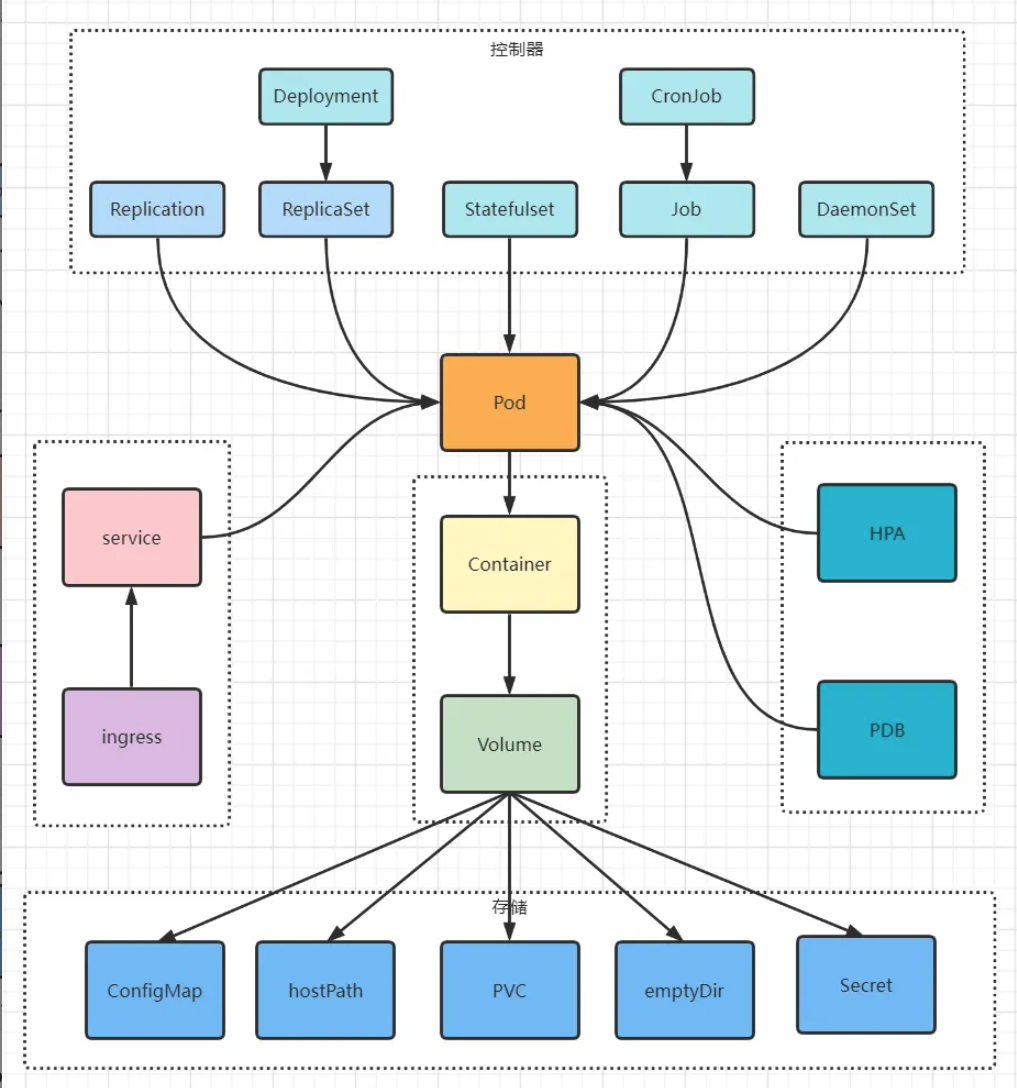

②kubernetes中其他大多数组件都是围绕着Pod来进行支撑和扩展Pod功能的,

例如,用于管理Pod运行的StatefulSet和Deployment等控制器对象,用于暴露Pod应用的Service和Ingress对象,为Pod提供存储的PersistentVolume存储资源对象等。

1 在Kubrenetes集群中Pod有如下两种使用方式:

●一个Pod中运行一个容器。“每个Pod中一个容器”的模式是最常见的用法;在这种使用方式中,你

可以把Pod想象成是单个容器的封装,kuberentes管理的是Pod而不是直接管理容器。

●在一个Pod中同时运行多个容器。一个Pod中也可以同时封装几个需要紧密耦合互相协作的容

器,它们之间共享资源。这些在同一个Pod中的容器可以互相协作成为一个service单位,比如一个

容器共享文件,另一个“sidecar”容器来更新这些文件。Pod将这些容器的存储资源作为一个实体来

管理。

举例:sidecar如用于收集日志的filebeat 或者收集监控数据zabbix agent的容器

2 pod中运行容器的原则

①一个Pod下的容器必须运行于同一节点上。

②现代容器技术建议一个容器只运行一个进程,该进程在容器中PID命令空间中的进程号为1,可

直接接收并处理信号,进程终止时容器生命周期也就结束了。

③若想在容器内运行多个进程,需要有一个类似Linux操作系统init进程的管控类进程,以树状

结构完成多进程的生命周期管理。运行于各自容器内的进程无法直接完成网络通信,这是由于容器

间的隔离机制导致,

④k8s中的Pod资源抽象正是解决此类问题,Pod对象是一组容器的集合,这些容器共享Network、

UTS及IPC命令空间,因此具有相同的域名、主机名和网络接口,并可通过IPC直接通信。

⑤ Pod资源中针对各容器提供网络命令空间等共享机制的是底层基础容器pause,基础容器(也可

称为父容器)pause就是为了管理Pod容器间的共享操作,这个父容器需要能够准确地知道如何去

创建共享运行环境的容器,还能管理这些容器的生命周期。为了实现这个父容器的构想kubernetes

中,用pause容器来作为一个Pod中所有容器的父容器。

3 这个pause容器有两个核心的功能

① 提供整个Pod的Linux命名空间的基础。(共享NET、MNT、UTS及IPC、PID命名空间),pod

的容器组共享网络和存储资源。

② 启用PID命名空间,它在每个Pod中都作为PID为1进程(init进程),并回收僵尸进程。

4 pause容器使得Pod中的所有容器可以共享两种资源

网络:

每个Pod都会被分配一个唯一的IP地址。Pod中的所有容器共享网络空间,包括IP地址和端口。

Pod内部的容器可以使用localhost互相通信。Pod中的容器与外界通信时,必须分配共享网络资源

(例如使用宿主机的端口映射)。

存储:

Pod可以指定多个共享的Volume。Pod中的所有容器都可以访问共享的Volume。Volume也可以用

来持久化Pod中的存储资源,以防容器重启后文件丢失。

总结:

每个Pod都有一个特殊的被称为“基础容器”的Pause容器。Pause容器对应的镜像属于Kubernetes

平台的一部分,除了Pause容器,每个Pod还包含一个或者多个紧密相关的用户应用容器。

4 kubernetes中的pause容器主要为每个容器提供以下功能:

①给 pod中的 所有应用容器提供 网络(共享IP)和 存储(共享存储)资源的共享;

②作为PID=1进程(init进程),管理整个pod容器组的生命周期

协调他的容器生命周期

提供健康检查和生存探针

5 Kubernetes设计这样的Pod概念和特殊组成结构有什么用意?

●原因一:在一组容器作为一个单元的情况下,难以对整体的容器简单地进行判断及有效地进行行

动。比如,一个容器死亡了 那么引入与业务无关的Pause容器作为Pod的基础容器,以它的状态代

表着整个容器组的状态,这样就可以解决该问题。

●原因二:Pod里的多个应用容器共享Pause容器的IP,共享Pause容器挂载的Volume,这样简化

了应用容器之间的通信问题,也解决了容器之间的文件共享问题。

6 通常把Pod分为两类:

① 自主式Pod

这种Pod本身是不能自我修复的,当Pod被创建后(不论是由你直接创建还是被其他Controller),

都会被Kuberentes调度到集群的Node上。直到Pod的进程终止、被删掉、因为缺少资源而被驱

逐、或者Node故障之前这个Pod都会一直保持在那个Node上。

Pod不会自愈。如果Pod运行的Node故障,或者是调度器本身故障,这个Pod就会被删除。同样的,如果Pod所在Node缺少资源

或者Pod处于维护状态,Pod也会被驱逐。

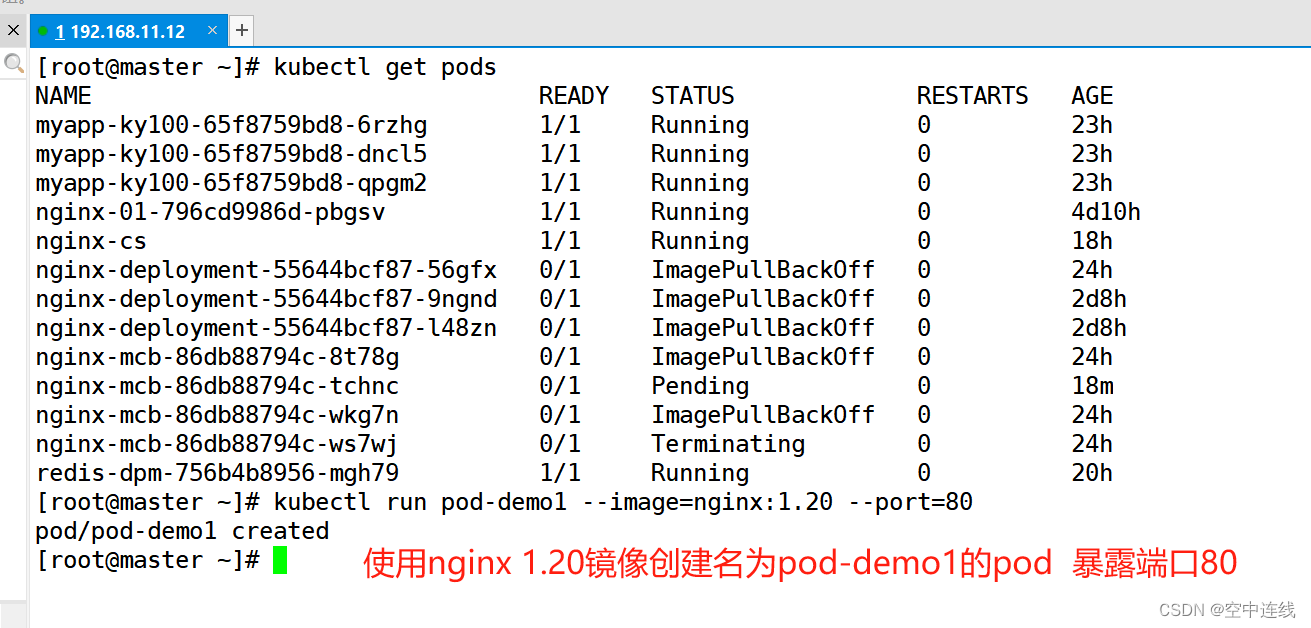

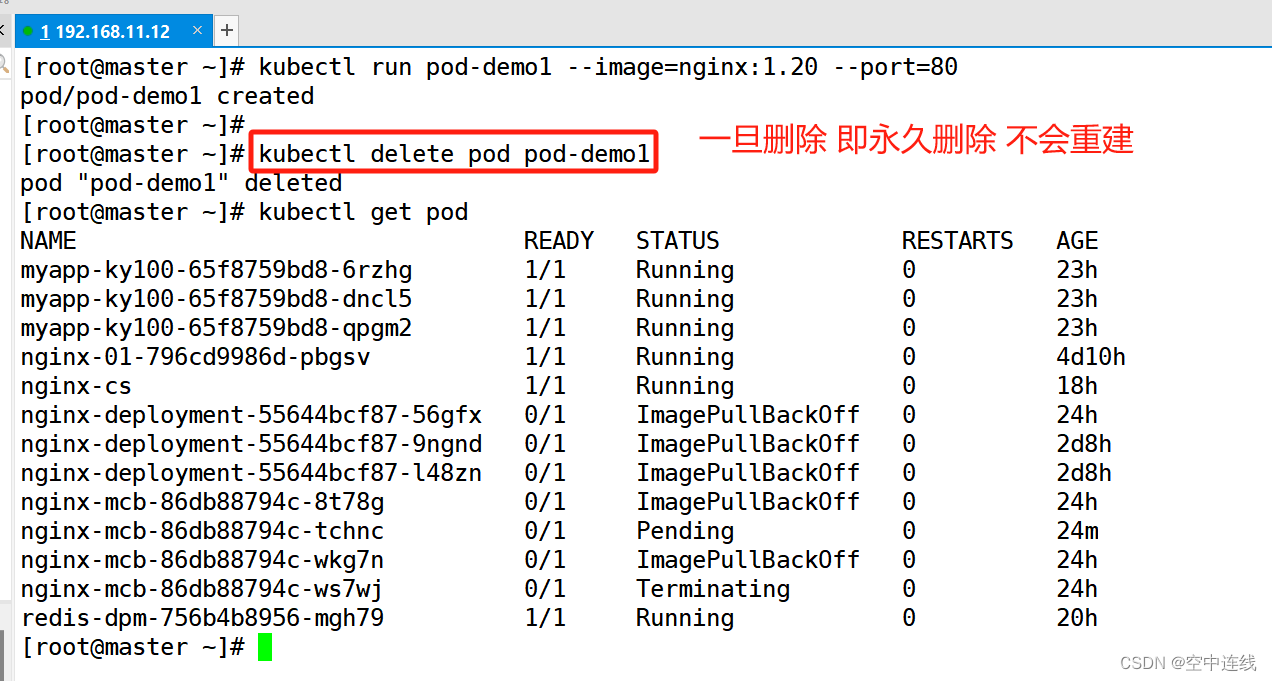

总结:由scheduler调度到node节点创建,但是没有自愈能力,一旦pod删除或异常退出不会 被拉起。没有控制器管理,也没有副本和滚动更新的功能

通过kubectl run创建

kubectl run pod-demo1 --image=nginx:1.20 --port=80

验证通过scheduler调度

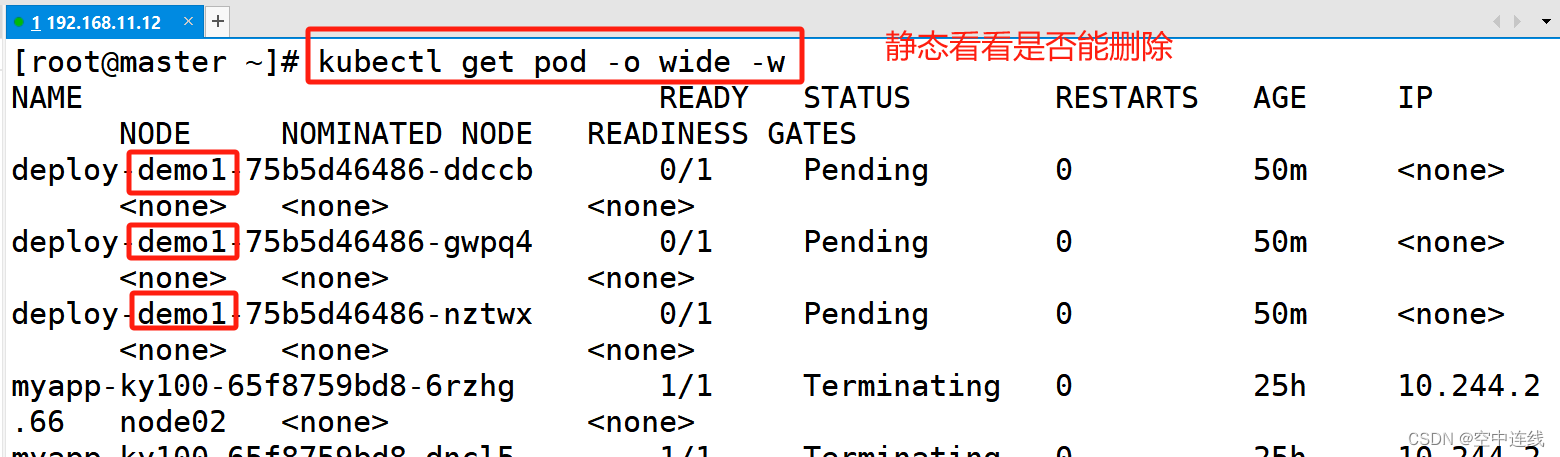

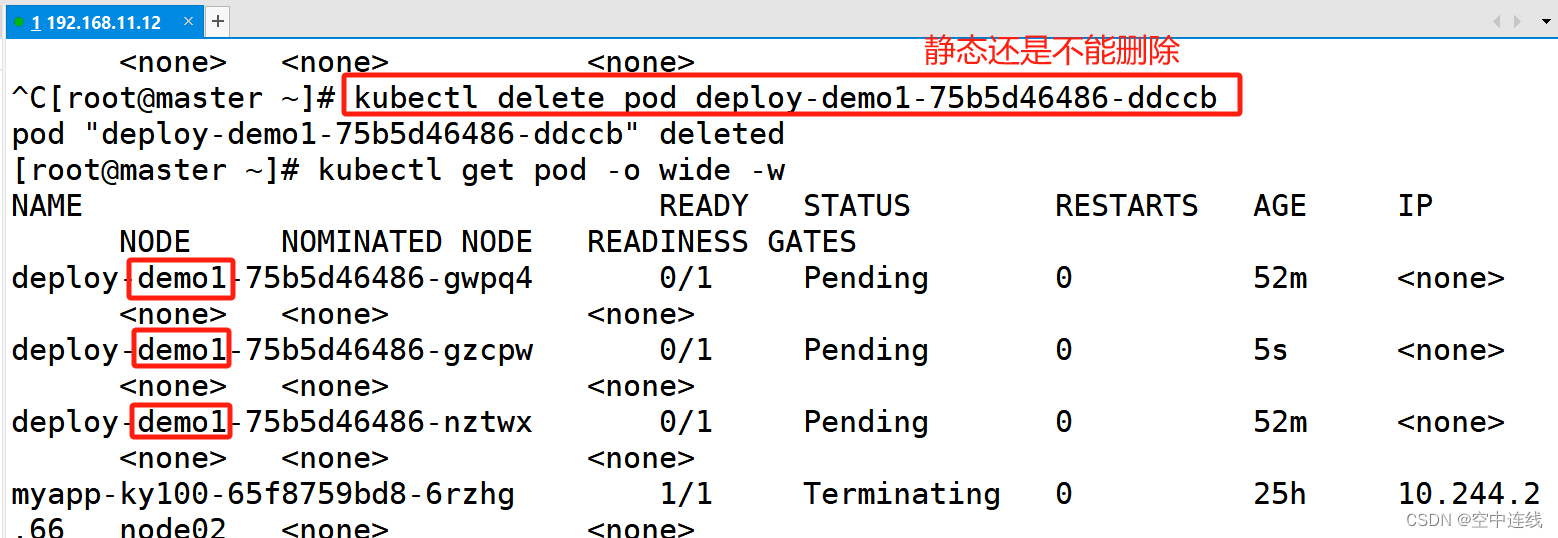

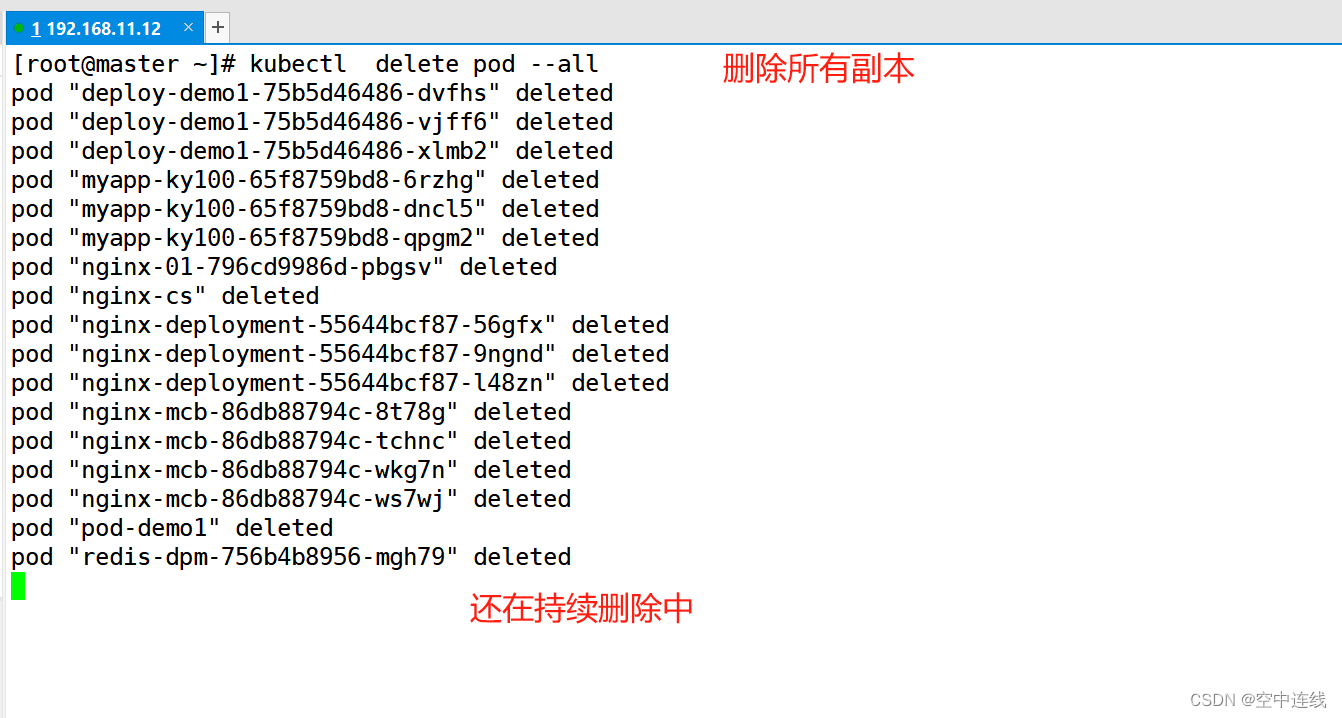

② 控制器管理的Pod

Kubernetes使用更高级的称为Controller的抽象层,来管理Pod实例。Controller可以创建和管理多

个Pod,提供副本管理、滚动升级和集群级别的自愈能力。例如,如果一个Node故障,Controller

就能自动将该节点上的Pod调度到其他健康的Node上。虽然可以直接使用Pod,但是在Kubernetes

中通常是使用Controller来管理Pod的。

总结:由scheduler调度到node节点,如果一旦pod被删除或异常退出,控制器会拉起pod让 其保持为期望的副本数。这类pod可以有副本数和滚动更新的功能

基于pod控制器创建pod

删除pod验证会被重新拉起

验证通过scheduler调度

验证可以滚动更新

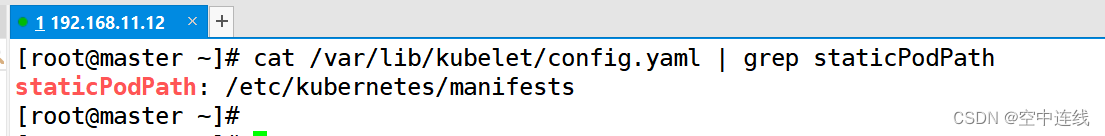

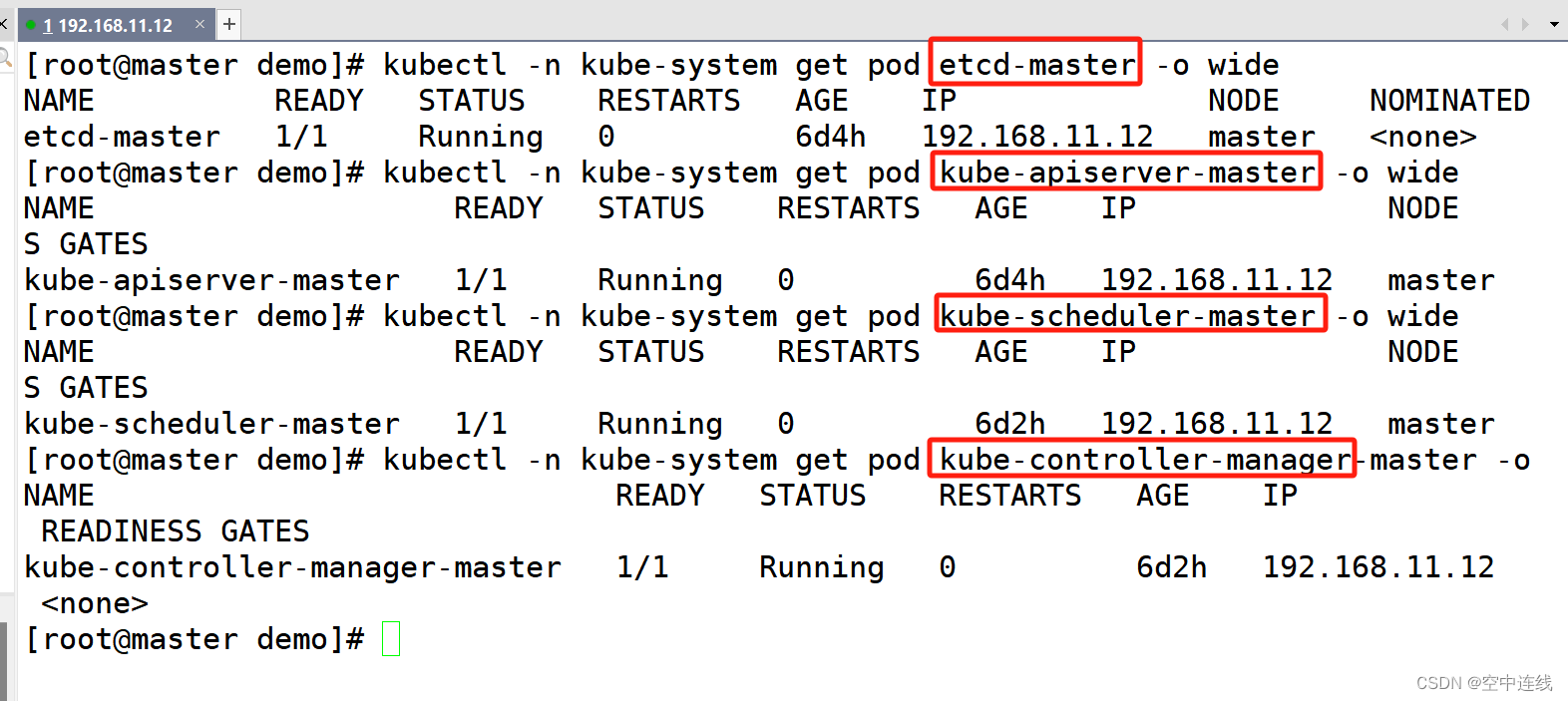

③ 静态Pod

静态 Pod 直接由特定节点上的 kubelet 进程来管理,不通过 master 节点上的 apiserver 。无法与控制器 Deployment 或者 DaemonSet 进行关联,它由 kubelet 进程自己来监控,当 pod 崩溃时重启该 pod , kubelete 也无法对他们进行健康检查。

静态 pod 始终绑定在某一个 kubelet ,并且始终运行在同一个节点上。 kubelet 会自动为每一个静态 pod 在 Kubernetes 的 apiserver 上创建一个镜像 Pod(Mirror Pod),因此我们可以在 apiserver 中查询到该 pod,但是不能通过 apiserver 进行控制(例如不能删除)。

总结:静态pod是不被scheduler调度的。静态pod是在node节点上的kubelet自行管理,始终与

kubelet在同一个node节点上。通过向apiserver发送请求无法直接删除。在node节点

的/etc/kubernetes/manifests目录中放置pod的yaml配置文件 kubelet就会自动根据yaml配置文件创建静态pod

①存放静态pod的yaml文件的位置

查看kubelet配置文件 /var/lib/kubelet/config.yaml

cat /var/lib/kubelet/config.yaml | grep staticPodPath

② kubeadm部署的master节点的四大组件都是通过静态pod创建并运行

也可以通过下面命令找到kubelet对应的启动配置文件,修改node节点的kubelet配置文件,添加

静态Pod的环境变量配置 --pod-manifest-path 参数

vim /usr/lib/systemd/system/kubelet.service.d/10-kubeadm.conf

Environment="KUBELET_SYSTEM_PODS_ARGS=--pod-manifest-path=/etc/kubernetes/manifests --allowprivileged=true"

systemctl daemon-reload

systemctl restart kubelet静态pod无法用kubectl delete删除 除非将文件从/etc/kubernetes/manifests目录中挪走

运行中的 kubelet 周期扫描配置的目录下文件的变化,当这个目录中有文件出现或消失时创建或删除 pods。

在 Master 节点同样也可以看到该 Pod,如果执行 kubectl delete pod static-web-node01 命令删除

该 Pod 发现,并不能删除。

静态pod的yaml文件从/etc/kubernetes/manifests目录中挪走 删除

二 容器的分类:

1 基础容器(infrastructure container)

维护整个 Pod 网络和存储空间

① node 节点中操作,启动一个Pod时,k8s会自动启动一个基础容器

cat /opt/kubernetes/cfg/kubelet

......

--pod-infra-container-image=registry.cn-hangzhou.aliyuncs.com/google-containers/pause-amd64:3.0"

② 每次创建 Pod 时候就会创建,运行的每一个Pod都有一个 pause-amd64 的基础容器自动会运行,对于用户是透明的

docker ps -a

registry.cn-hangzhou.aliyuncs.com/google-containers/pause-amd64:3.0 "/pause"

2 初始化容器(initcontainers)

//Init容器必须在应用程序容器启动之前运行完成,而应用程序容器是并行运行的,所以Init容器能够提供了一种简单的阻塞或延迟应用容器的启动的方法。

① Init 容器与普通的容器非常像,除了以下两点:

●Init 容器总是运行到成功完成为止(传统容器 需先启动jdk,再启动应用服务如:tomcat)

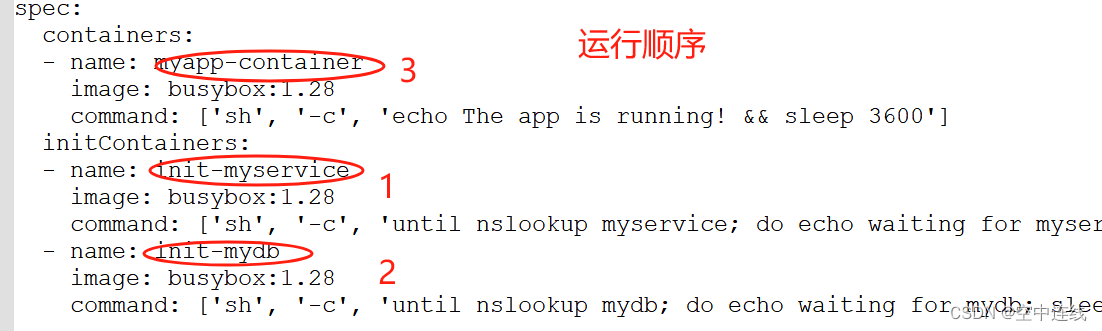

●每个 Init 容器都必须在下一个 Init 容器启动之前成功完成启动和退出

如果 Pod 的 Init 容器失败,k8s 会不断地重启该 Pod,直到 Init 容器成功为止。然而,如果 Pod

对应的重启策略(restartPolicy)为 Never,它不会重新启动。

② Init 的容器作用

因为init容器具有与应用容器分离的单独镜像,其启动相关代码具有如下优势:

●Init 容器可以包含一些安装过程中应用容器中不存在的实用工具或个性化代码。例如,没有必要

仅为了在安装过程中使用类似 sed、 awk、 python 或 dig 这样的工具而去FROM 一个镜像来生成

一个新的镜像。

●Init 容器可以安全地运行这些工具,避免这些工具导致应用镜像的安全性降低。

●应用镜像的创建者和部署者可以各自独立工作,而没有必要联合构建一个单独的应用镜像。

●Init 容器能以不同于Pod内应用容器的文件系统视图运行。因此,Init容器可具有访问 Secrets 的权限,而应用容器不能够访问。

●由于 Init 容器必须在应用容器启动之前运行完成,因此 Init 容器提供了一种机制来阻塞或延迟应用容器的启动,

直到满足了一组先决条件。一旦前置条件满足,Pod内的所有的应用容器会并行启动。

③ Init 的容器:jdk python语言

3 应用容器(Maincontainer)

淘宝 jd 拼多多

并行启动

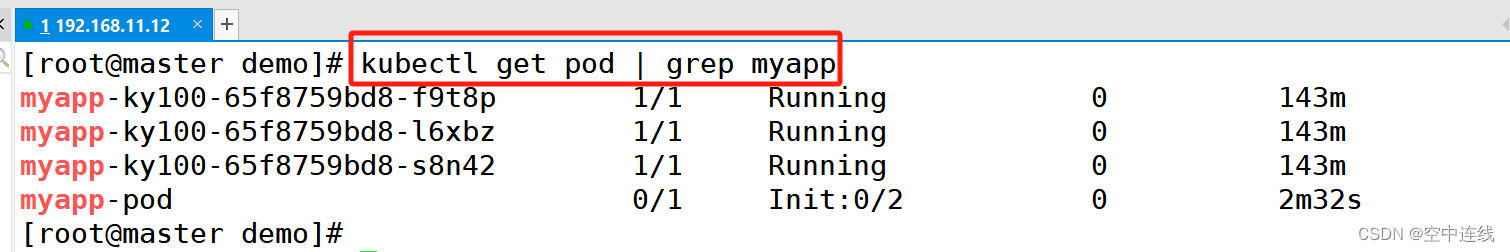

官网示例:

https://kubernetes.io/zh-cn/docs/concepts/workloads/pods/init-containers/

apiVersion: v1

kind: Pod

metadata:

name: myapp-pod

labels:

app: myapp

spec:

containers:

- name: myapp-container

image: busybox:1.28

command: ['sh', '-c', 'echo The app is running! && sleep 3600']

initContainers:

- name: init-myservice

image: busybox:1.28

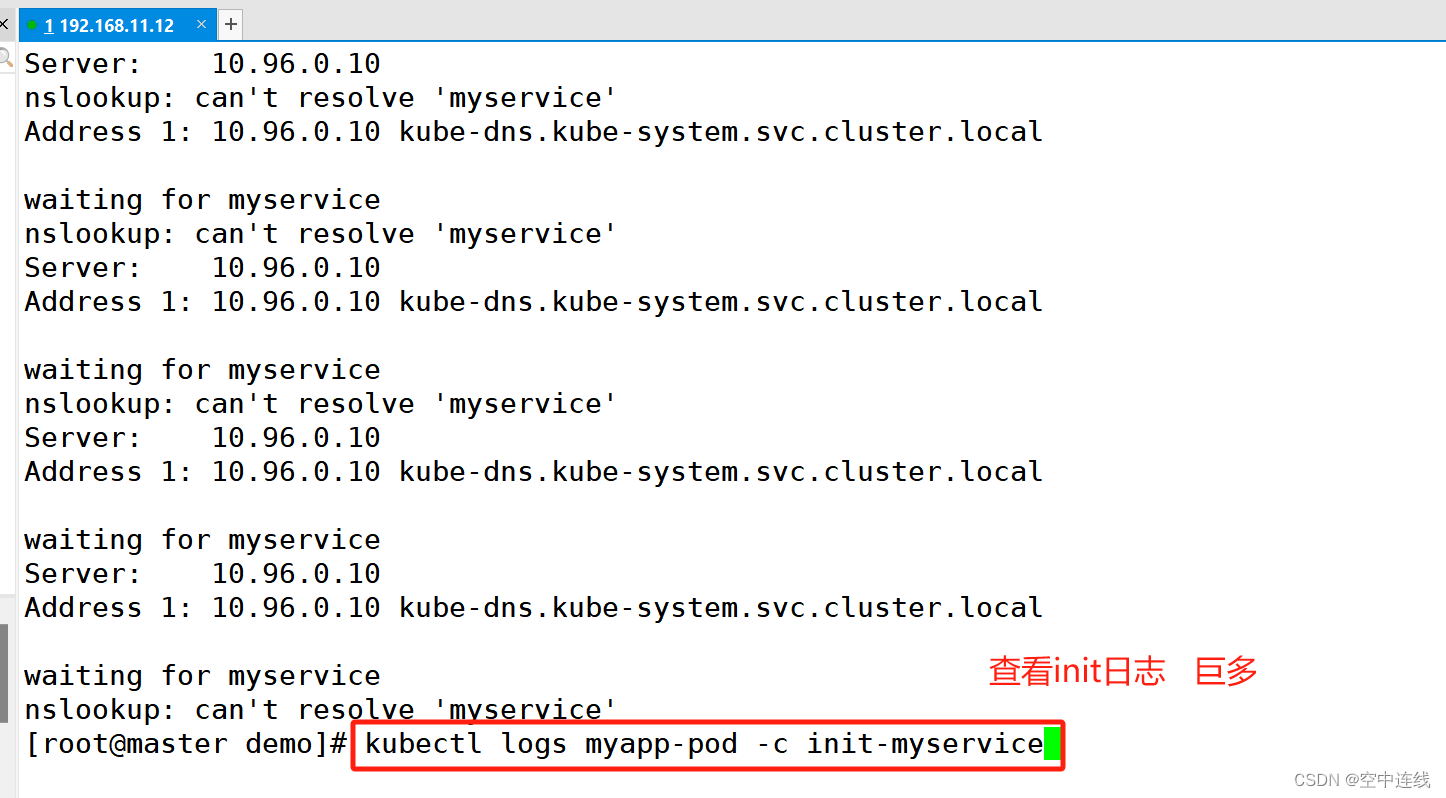

command: ['sh', '-c', 'until nslookup myservice; do echo waiting for myservice; sleep 2; done;']

- name: init-mydb

image: busybox:1.28

command: ['sh', '-c', 'until nslookup mydb; do echo waiting for mydb; sleep 2; done;']

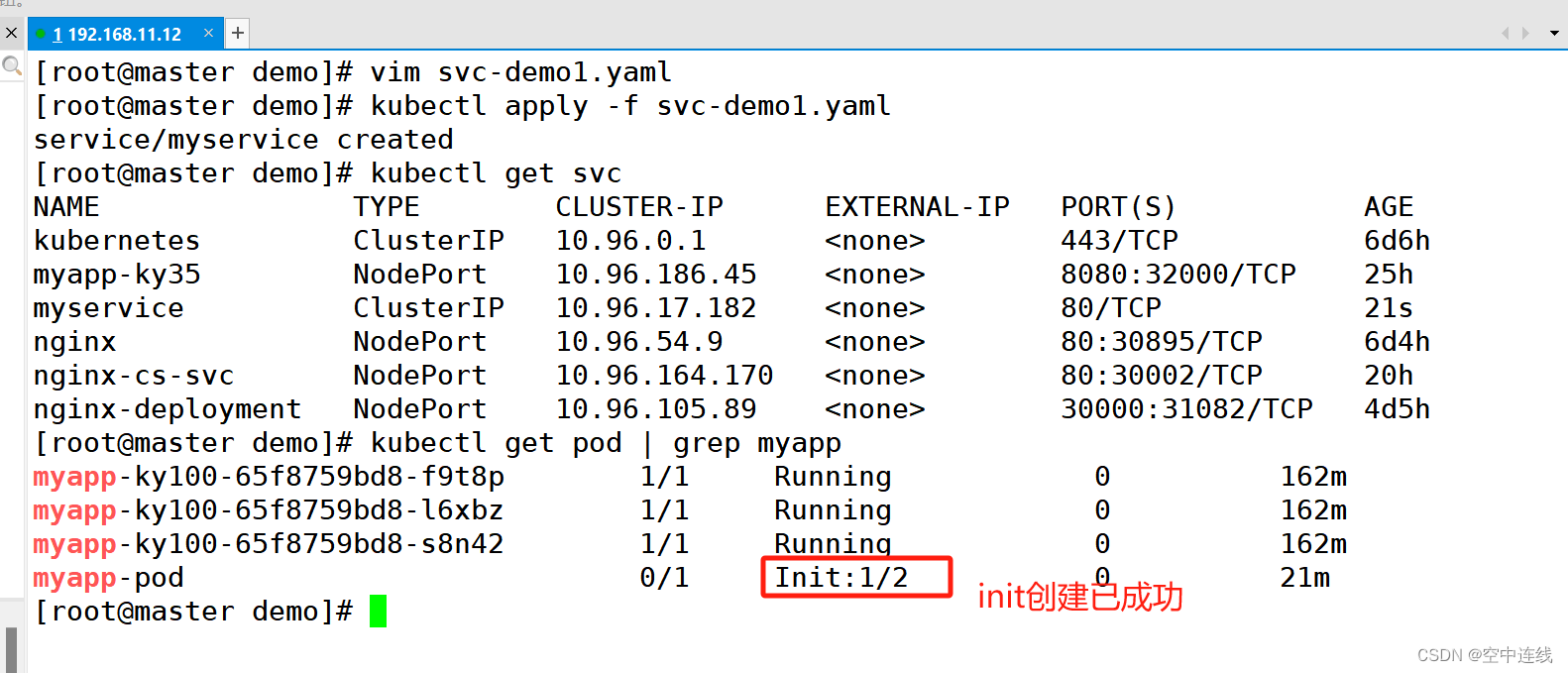

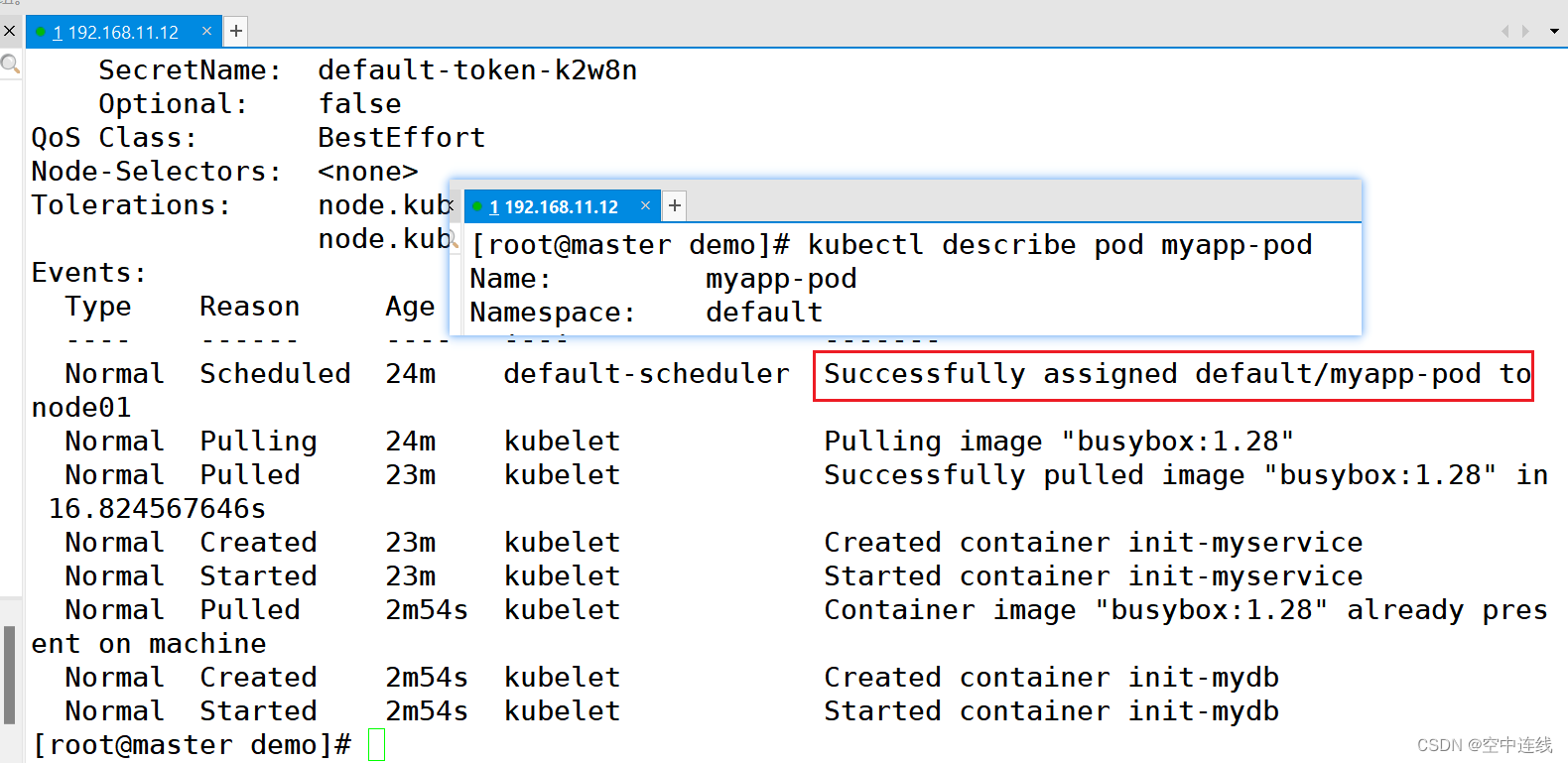

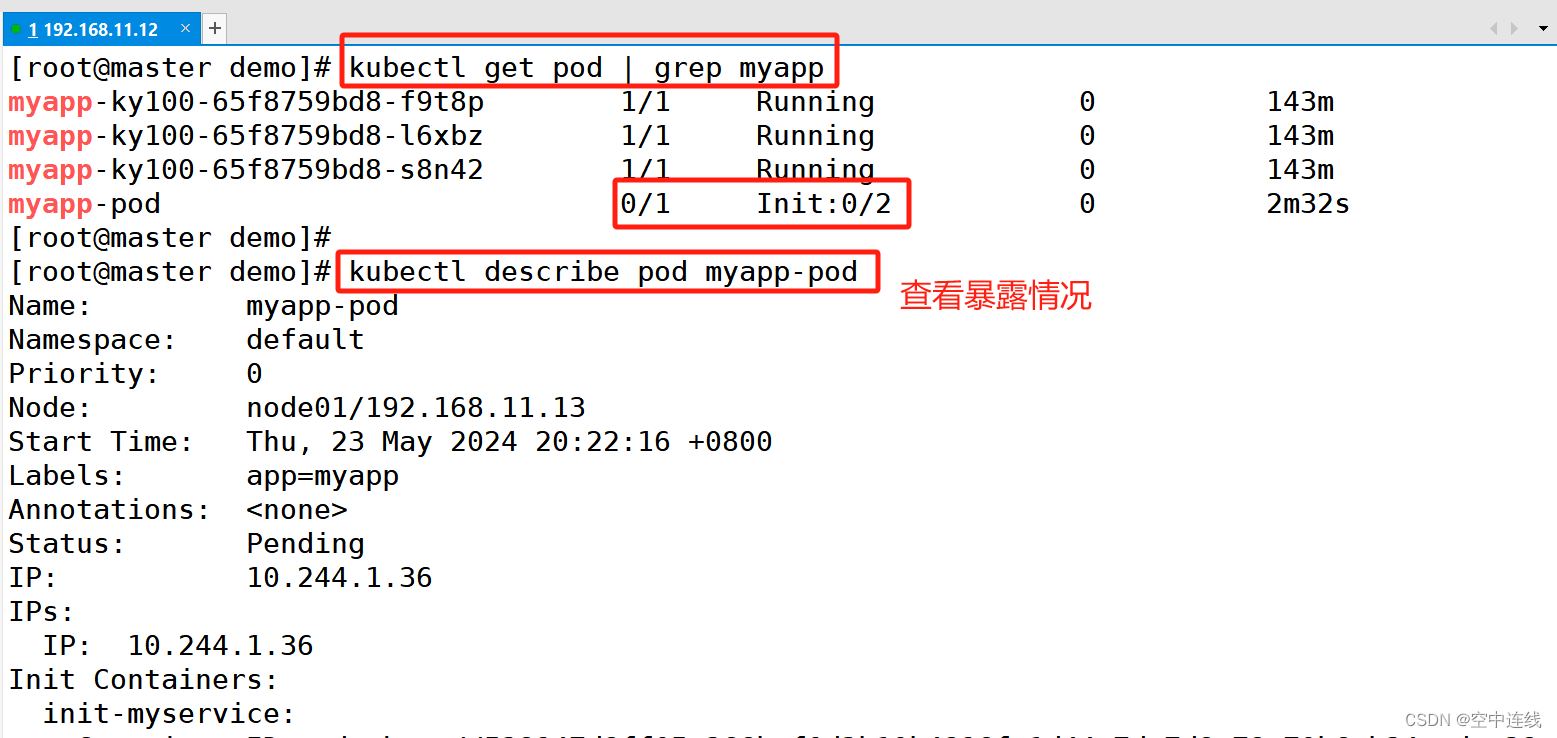

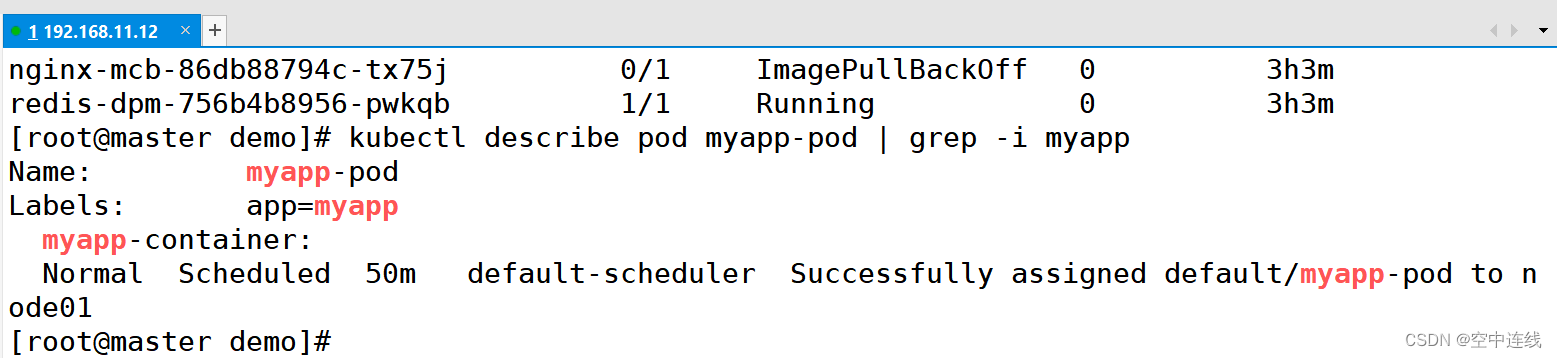

kubectl describe pod myapp-pod

kubectl logs myapp-pod -c init-myservice

这个例子是定义了一个具有 2 个 Init 容器的简单 Pod。 第一个等待 myservice 启动, 第二个等待

mydb 启动。 一旦这两个 Init容器都启动完成,Pod 将启动 spec 中的应用容器。

apiVersion: v1

kind: Service

metadata:

name: myservice

spec:

ports:

- protocol: TCP

port: 80

targetPort: 80

selector:

name: nginx-ky35

注意:初始化容器 都会从上到下

精确定位查找:

这个也可以查找

这个也可以查找

又一个 :

vim myservice.yaml

apiVersion: v1

kind: Service

metadata:

name: myservice

spec:

ports:

- protocol: TCP

port: 80

targetPort: 9376

kubectl create -f myservice.yaml

kubectl get svc

kubectl get pods -n kube-system

kubectl get podsvim mydb.yaml

apiVersion: v1

kind: Service

metadata:

name: mydb

spec:

ports:

- protocol: TCP

port: 80

targetPort: 9377

kubectl create -f mydb.yaml

kubectl get pods胡吹一句:网络三剑客用途特别广

特别说明:

●在Pod启动过程中,Init容器会按顺序在网络和数据卷初始化之后启动。每个容器必须在下一个容

器启动之前成功退出。

●如果由于运行时或失败退出,将导致容器启动失败,它会根据Pod的restartPolicy指定的策略进行

重试。然而,如果Pod的restartPolicy设置为Always,Init容器失败时会使用RestartPolicy策略。

●在所有的Init容器没有成功之前,Pod将不会变成Ready状态。Init容器的端口将不会在Service中

进行聚集。正在初始化中的Pod处于Pending状态,但应该会将Initializing状态设置为true。

●如果Pod重启,所有Init容器必须重新执行。

●对Init容器spec的修改被限制在容器image字段,修改其他字段都不会生效。更改Init容器的image

字段,等价于重启该Pod。

●Init容器具有应用容器的所有字段。除了readinessProbe,因为Init容器无法定义不同于完成

(completion)的就绪(readiness)之外的其他状态。这会在验证过程中强制执行。

●在Pod中的每个app和Init容器的名称必须唯一;与任何其它容器共享同一个名称,会在验证时抛

出错误。

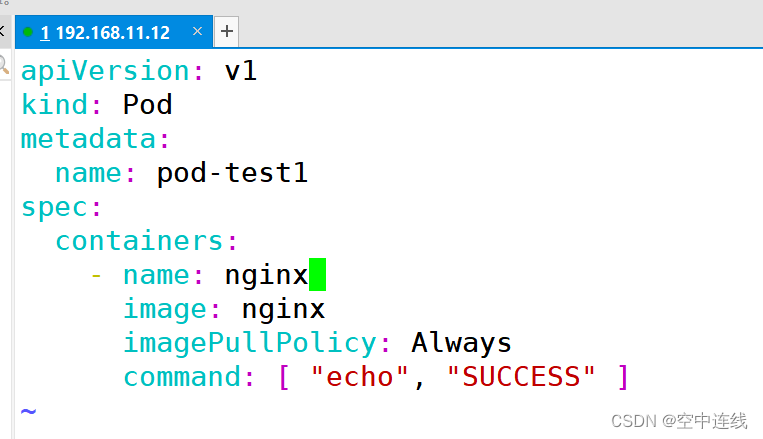

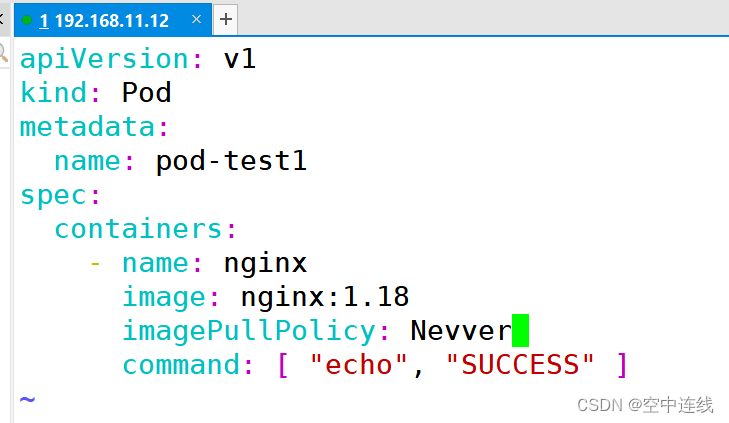

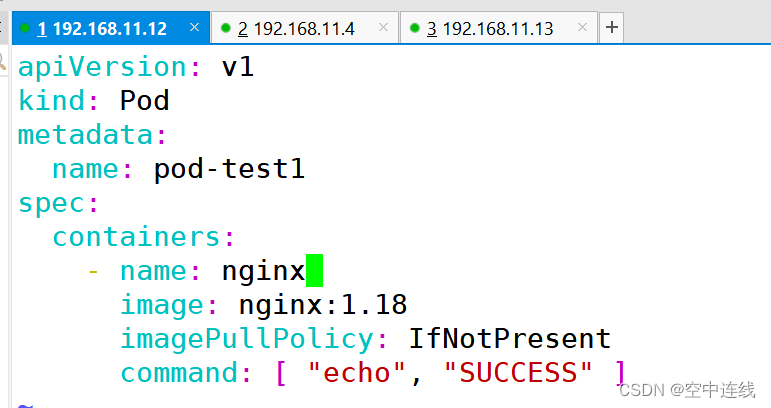

三 镜像拉取策略(image PullPolicy):

Pod 的核心是运行容器,必须指定容器引擎,比如 Docker,启动容器时,需要拉取镜像,k8s 的

镜像拉取策略可以由用户指定:

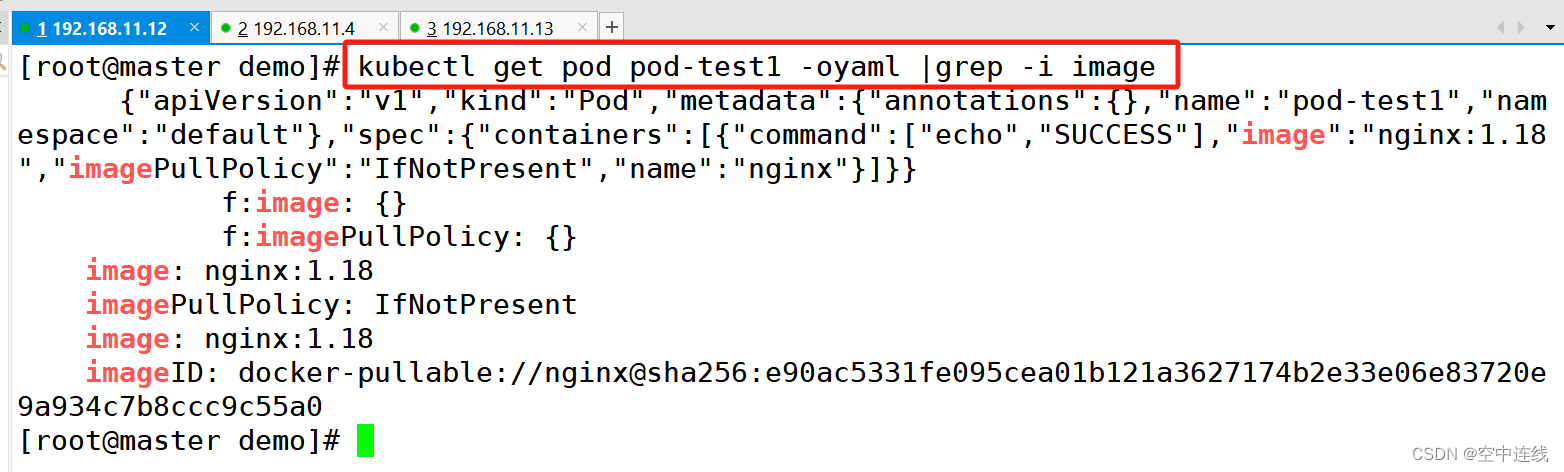

1 IfNotPresent:在镜像已经存在的情况下,kubelet 将不再去拉取镜像,仅当本地缺失时才从仓

库中拉取,默认的镜像拉取策略

2 Always:每次创建 Pod 都会重新拉取一次镜像;

3 Never:Pod 不会主动拉取这个镜像,仅使用本地镜像。

注意:对于标签为“:latest”的镜像文件,其默认的镜像获取策略即为“Always”;而对于其他标签的

镜像,其默认策略则为“IfNotPresent”。

镜像拉取策略(imagePullPolicy)

IfNotPresent 优先使用本地已存在的镜像,如本地没有则从仓库去拉取镜像

Always 总是从仓库拉取镜像,无论本地是否已存在镜像

AlwaysNever 总是不从仓库拉取镜像,仅使用本地镜像

nginx:latest

官方示例:

https://kubernetes.io/docs/concepts/containers/images

kubectl apply -f - <<EOF

apiVersion: v1

kind: Pod

metadata:

name: private-image-test-1

spec:

containers:

- name: uses-private-image

image: $PRIVATE_IMAGE_NAME

imagePullPolicy: Always

command: [ "echo", "SUCCESS" ]

EOF

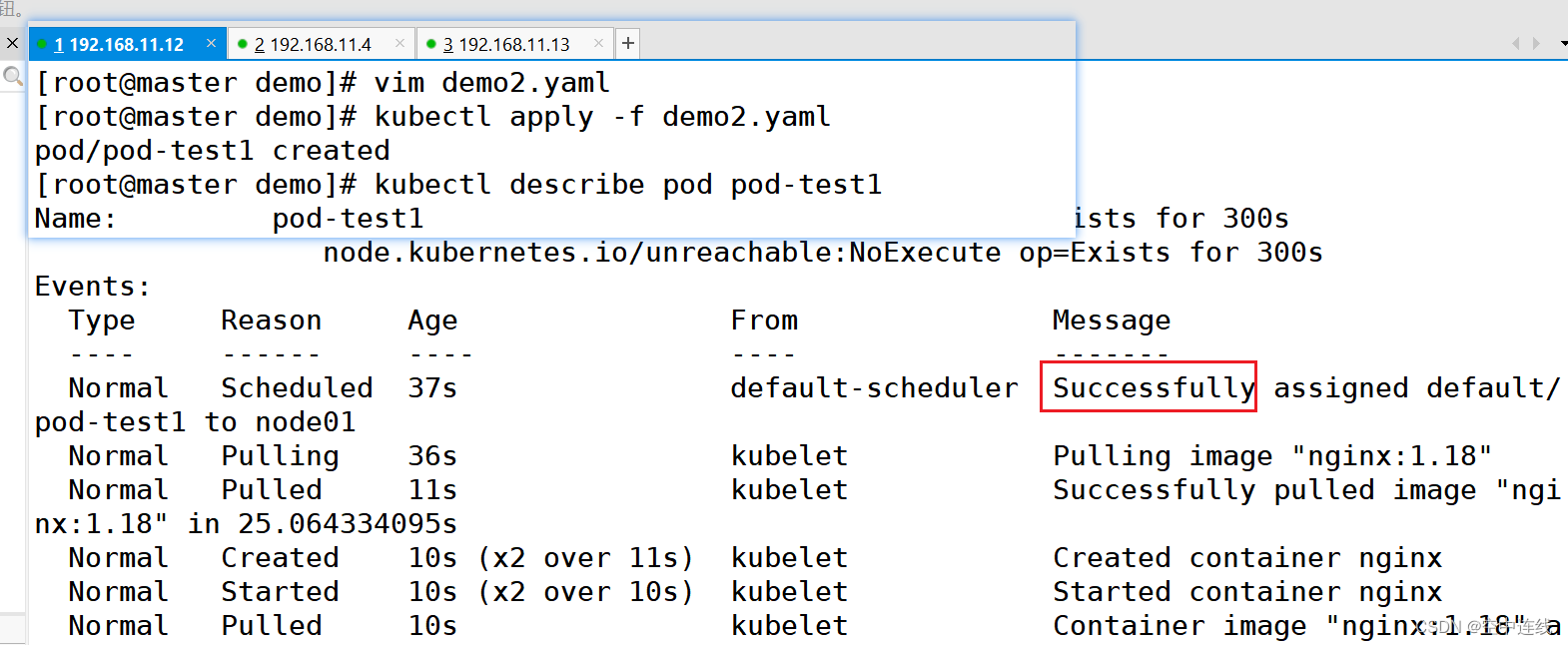

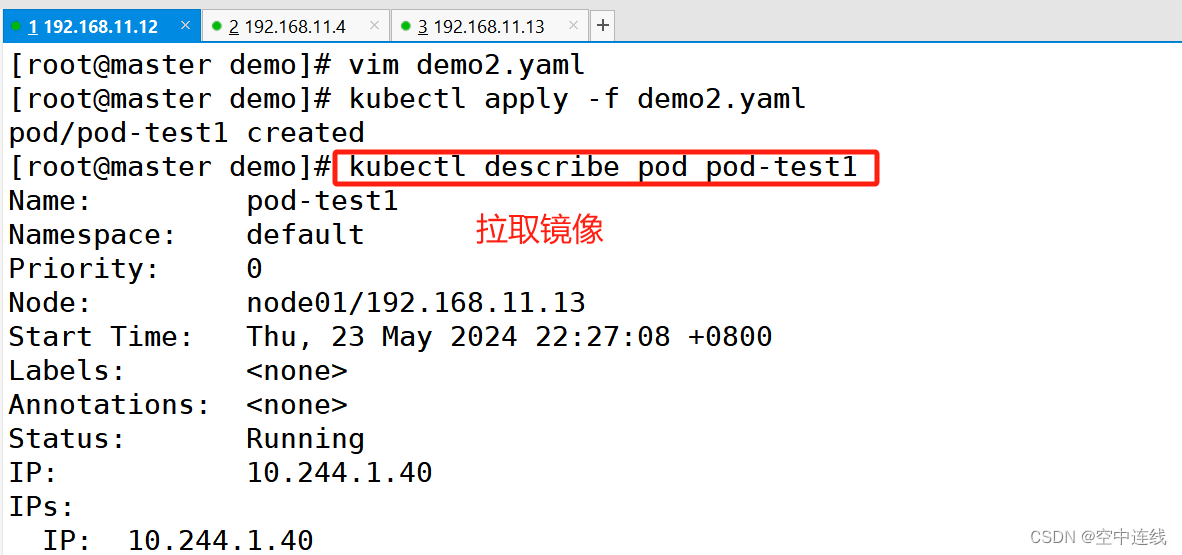

[root@master demo]# kubectl describe pod pod-test1

Never:

Pod 不会主动拉取这个镜像,仅使用本地镜像

apiVersion: v1

kind: Pod

metadata:

name: pod-test1

spec:

containers:

- name: nginx

image: nginx:1.18

imagePullPolicy: Nevver

command: [ "echo", "SUCCESS" ]

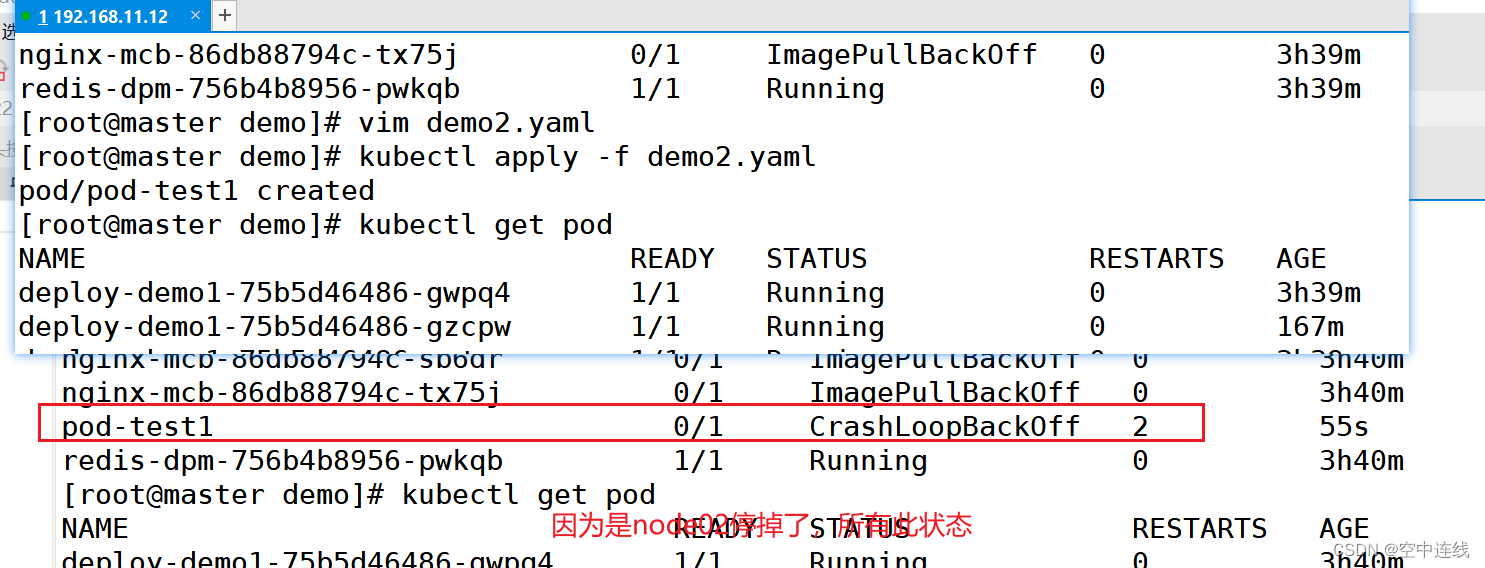

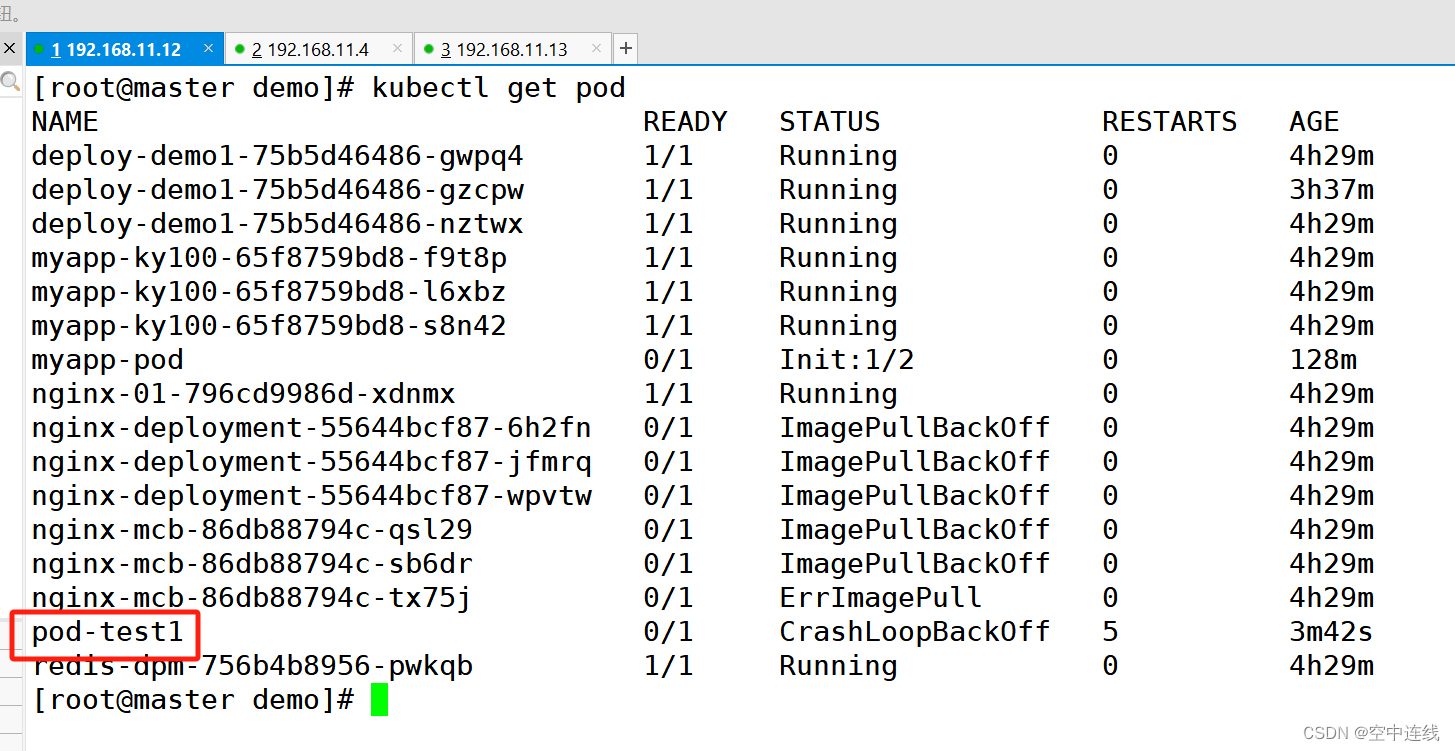

[root@master demo]# kubectl apply -f demo2.yaml

[root@master demo]# kubectl get pod[root@master demo]# kubectl describe pod pod-test1

IfNotPresent

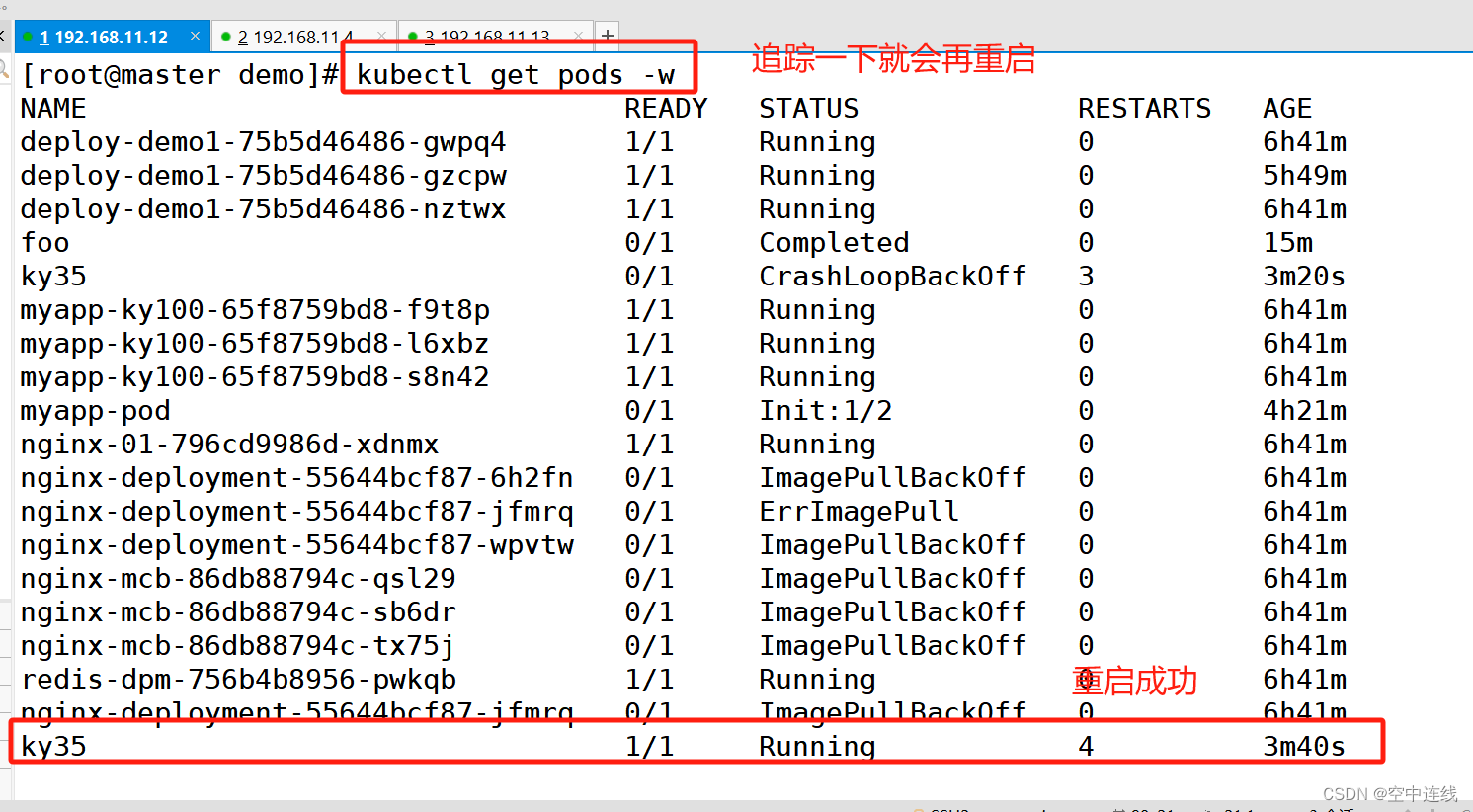

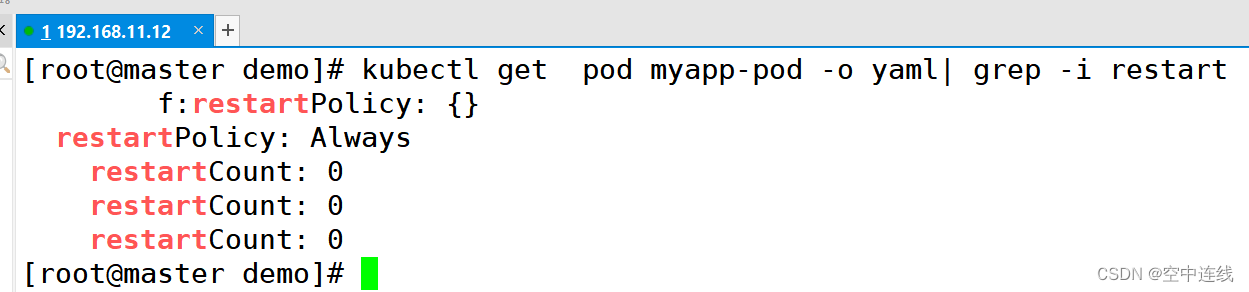

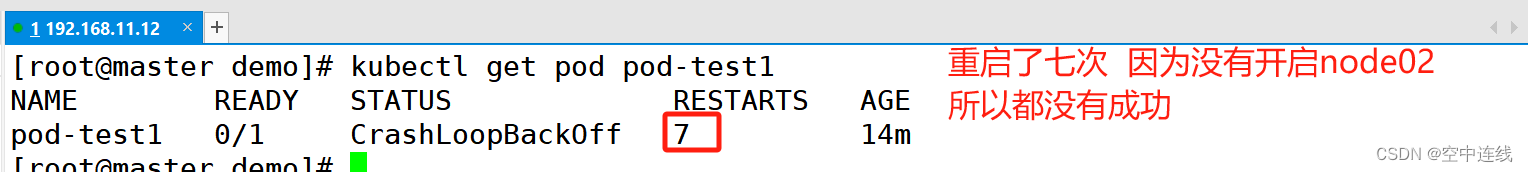

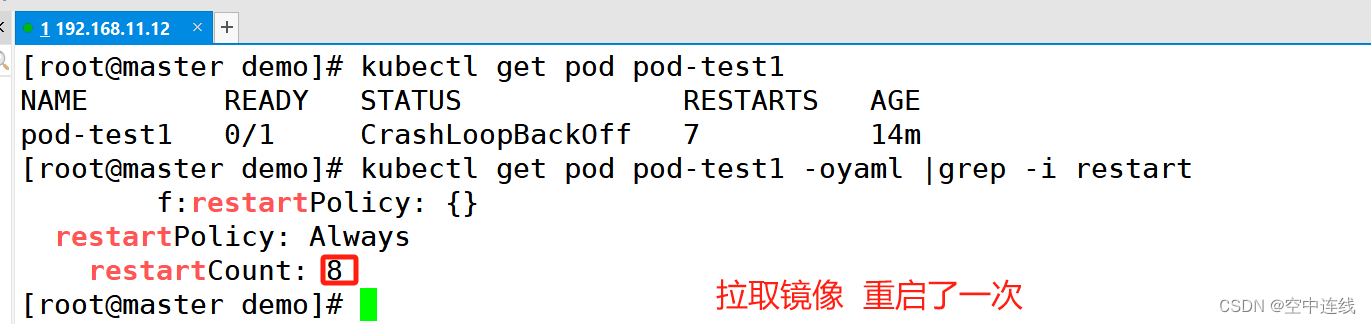

四 重启策略(restartPolicy)

当 Pod 中的容器退出时通过节点上的 kubelet 重启容器。适用于 Pod 中的所有容器。

1、Always:当容器终止退出后,总是重启容器,默认策略

2、OnFailure:当容器异常退出(退出状态码非0)时,重启容器;正常退出则不重启容器

3、Never:当容器终止退出,从不重启容器。

注意:K8S 中不支持重启 Pod 资源,只有删除重建

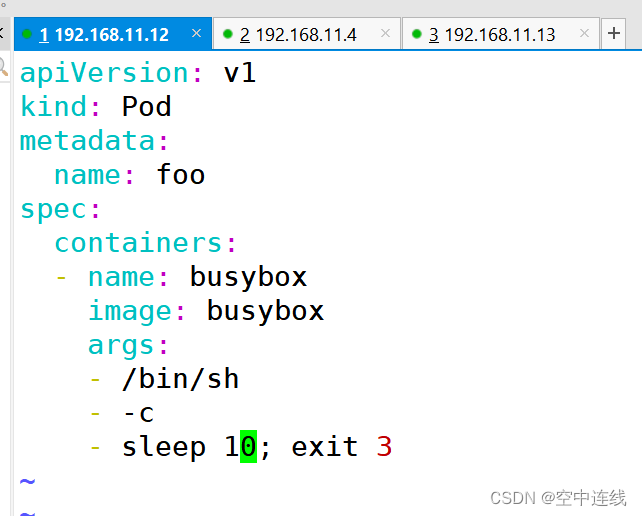

apiVersion: v1

kind: Pod

metadata:

name: foo

spec:

containers:

- name: busybox

image: busybox

args:

- /bin/sh

- -c

- sleep 30; exit 3

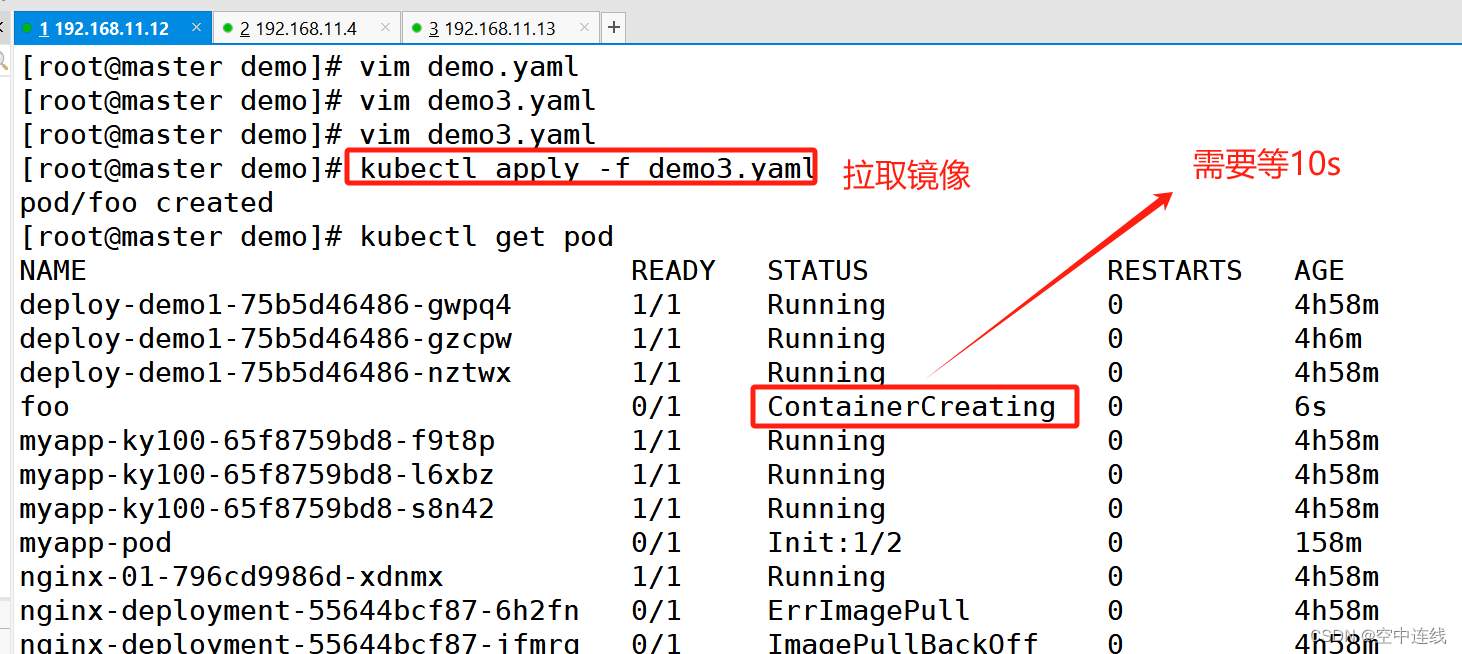

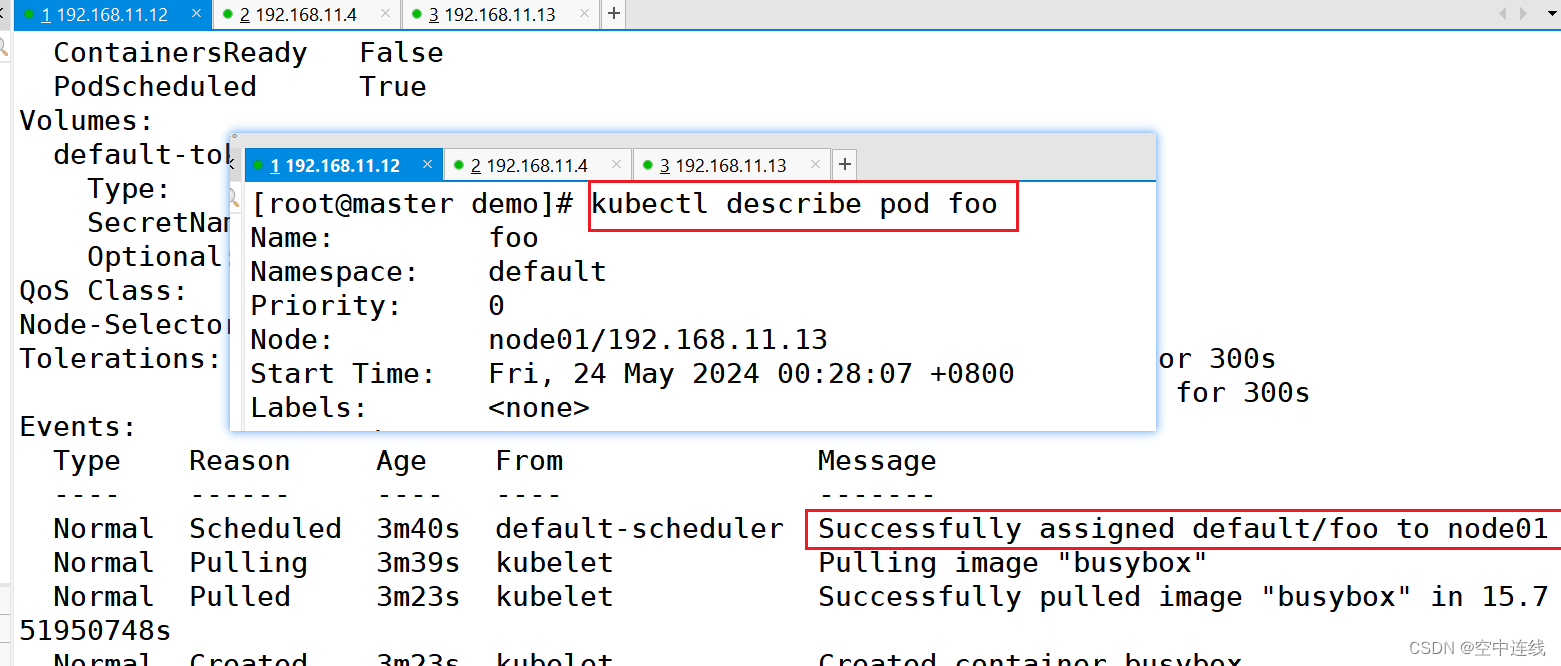

[root@master demo]# kubectl apply -f demo3.yaml

[root@master demo]# kubectl get pod

[root@master demo]# kubectl describe pod pod-test1

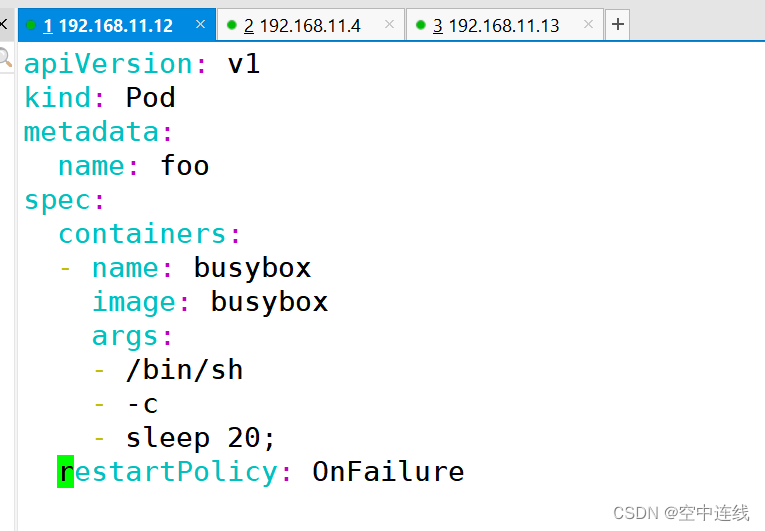

apiVersion: v1

kind: Pod

metadata:

name: foo

spec:

containers:

- name: busybox

image: busybox

args:

- /bin/sh

- -c

- sleep 20;

restartPolicy: OnFailure

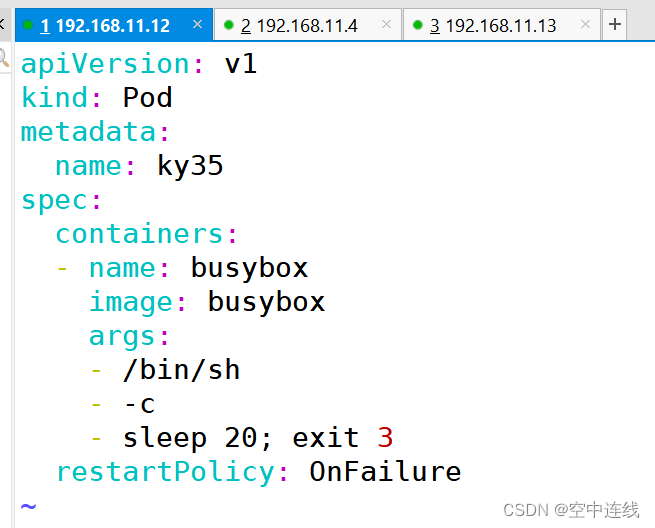

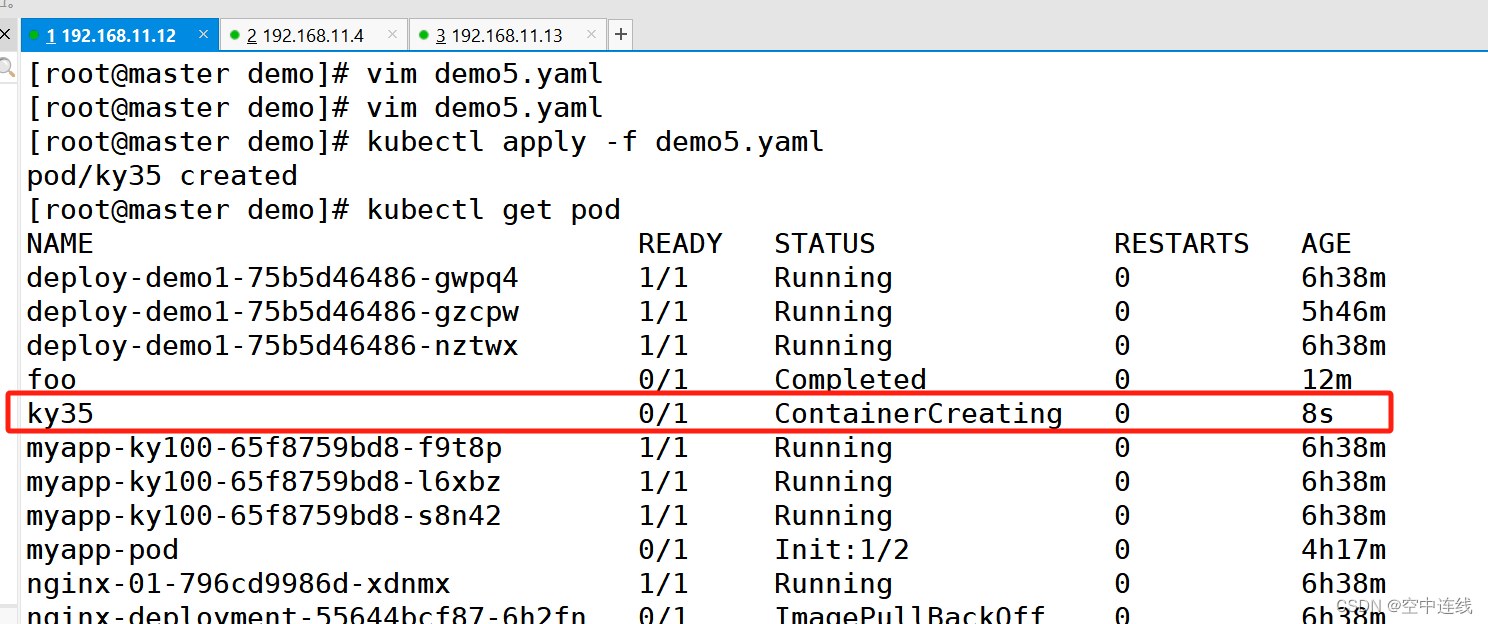

apiVersion: v1

kind: Pod

metadata:

name: ky35

spec:

containers:

- name: busybox

image: busybox

args:

- /bin/sh

- -c

- sleep 20; exit 3

restartPolicy: OnFailure